Query-Efficient Black-box Adversarial Attacks Guided by a Transfer-based Prior

阅读笔记

文章信息:Dong, Yinpeng., Cheng, Shuyu., Pang, Tianyu., Su, Hang., & Zhu, Jun. (2021). Query-Efficient Black-box Adversarial Attacks Guided by a Transfer-based Prior. IEEE Transactions on Pattern Analysis and Machine Intelligence. (TPAMI2021)

Abstract

存在的问题:现有的方法不可避免地存在攻击成功率低或查询效率低的问题,因为在信息有限的高维输入空间中很难估计梯度。

提出的方法:两种基于偏置采样和梯度平均的先验引导随机无梯度算法prior-guided random gradient-free-BS(PRGF-BS)、prior-guided random gradient-free-GA(PRGF-GA),方法可以同时利用代理模型的梯度和查询信息提供的基于传输的先验知识。

实验结果:与现有技术相比,两种方法都需要更少的查询来攻击黑盒模型,成功率更高。

1、Introdution

黑盒攻击比白盒攻击更符合实际应用,黑盒攻击的常规思路是用近似梯度代替真实的梯度。黑盒攻击大致分为:基于转移的攻击算法、基于查询的攻击算法。基于转移的攻击算法成功率底下的原因是当替代模型的梯度指向目标模型的非对抗区域时缺乏调整过程。基于查询的攻击算法查询效率低下(需要大量的查询)的原因是对先验的利用不足。提出方法来上述解决问题并改进黑盒攻击:

- 方法1(BS):通过使用偏向于转移梯度的随机样本查询目标模型,并获取相应的损失值。

- 方法2(GA):对转移梯度和由普通RGF方法提供的梯度估计进行加权平均。

这两个方法都可以灵活的整合其他的先验知识:具体例子:将常用data-denpendent prior和transfer-based prior一起整合在算法中。还提供了关于如何接受两个先验信息的理论分析。此外,将方法扩展到多个代理模型可用的方案,广泛的实验表明,两种方法都在黑盒攻击成功率和查询效率方面显着优于先前的最先进的方法,验证了对黑盒攻击的算法的优势。

Contribution:

- 提出通过替代模型的梯度给出的transfer-based prior来提高黑盒对抗攻击。由于对抗样本的转移性,transfer-based prior提供了真实梯度的丰富先前信息。

- 提出了两个prior-guided的随机梯度(PRGF)算法来利用基于偏置的采样和梯度平均的transfer-based prior。理论分析导出了基于转移的基于转移的最佳系数。

- 通过整合data-denpendent prior和多个替代模型来体现算法的灵活性。

- 验证了所提出的方法可以提高黑盒对抗性攻击的成功率,并与最先进的方法相比,减少了查询数。

2、Background

2.1 Adversarial Setup

介绍了关于对抗性的一些知识,并补充说明:为了清晰介绍框架和算法时用的都是无目标攻击,但在有目标攻击上也是同样适用的。

2.2 Black-box Attacks

基于转移的攻击通过替代百盒模型来生成对抗样本;当损失值能过通过查询获取时,一些基于查询的攻击方法通过零阶优化方法生成对抗样本。RGF(random gradient-free)方法中生成估计梯度的方法:

θ

\theta

θ 是控制采样方差的参数,

μ

\mu

μ是在扰动P中采样的随机向量,

g

^

\hat{g}

g^是所估计的梯度。(NES算法与之不同点是NES是在高斯分布上进行的对偶采样)

有些估计梯度的方法几乎最优,但是查询的效率需要改进,本文提出的方法用了基于转移的先验知识(transfer-based prior),而且这种方法还能结合其他的先验知识,通过结合data-denpendent prior为例子,展示算法的灵活性。

2.3 Attacks based on both Transferability and Queries

也有一些工作是同时用了对抗样本的转移性和模型查询的黑盒攻击,训练局部替代模型来模仿具有合成数据集的黑盒模型,再通过查询的方法获得标签从而生成对抗样本,然后这个对抗样本(由于转移性)就可以攻击成功之前的黑盒模型。

虽然最近的工作还使用代理模型的梯度来提高黑盒攻击的查询效率,但是它关注的是不同的攻击场景,只能获取硬标签输出,但是此方法考虑对抗设置可以访问丢失值。此外,该方法通过一个预设的超参数来控制转移梯度的强度,但此方法通过基于梯度估计框架的理论分析来获得其最佳值。值得一提的是,一项类似但独立的工作也使用代理梯度来改进零阶优化,但他们没有将其方法应用于黑箱对抗攻击。

3、 Gradient Estimation Framework

梯度评估框架的目的:更准确地评估梯度来提高黑盒攻击的成功率。

g

^

\hat{g}

g^是所估计的梯度,L(

g

^

\hat{g}

g^)是损失函数,E是期望,有一篇工作是公式里面没有b,但是这样采用的损失函数的值将随着估计量g的大小的变化而不同,但是影响攻击性能的是梯度的方向,而不是大小。因此,在公式(7)中加入了比例因子b,并最小化了误差w.r.t.b,这可以忽略量级对估计量ˆg损失的影响。

4、 Methods

直接用RGF方法而不结合先验信息会导致查询效率低下,因此,提出利用基于转移的先验知识,通过有偏采样或梯度平均来改进RGF估计。

其中

α

\alpha

α是转移梯度v(归一化后)与真实梯度的余弦相似度;

倒

三

角

f

(

x

)

‾

\overline{倒三角f(x)}

倒三角f(x)是真实梯度l2范数规范化。

4.1 PRGF with Biased Sampling

RGF方法取样随机向量是在一个没有带有信息的分布上取的,这里提出的第一个方法对朝向转移梯度V偏差的随机向量进行采样,以充分利用先前的信息(假设抽样分布P是在D维输入空间的单位超球面-》为了让从P中抽样的u满足

∣

∣

u

i

∣

∣

2

||ui||_2

∣∣ui∣∣2=1)。如果f关于x处处可微,那么在公式5中估计梯度

g

^

\hat{g}

g^的损失函数为:

C

⃗

\vec C

C满足:1、半正定矩阵;2、迹为1。问题变成优化

C

⃗

\vec C

C来最小化损失函数。又通过矩阵的知识,可以将

C

⃗

\vec C

C写成

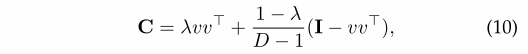

本文提出采样偏向于转移梯度v以利用其先前信息。因此,我们将

C

⃗

\vec C

C的一个特征向量指定为v,并让对应的特征值

λ

\lambda

λ(属于0-1)设置为可调节系数。对于其他特征值,将它们设置为平等,因为没有任何关于其他特征向量的知识。并且很容易构造一个随机向量{ui}(i=1-q),并且也满足公式10:

ξ

\xi

ξi是在D维单位超球面的均匀采样的值,问题就变成了优化

λ

\lambda

λ来最小化损失函数(

C

⃗

\vec C

C和ui都和

λ

\lambda

λ有关,且只有

λ

\lambda

λ可调节)注意,当λ= 1/d和c = (1/D)*I时,使得随机向量从超球面均匀分布选取时,方法将退化为普通的RGF方法,并且如果

λ

\lambda

λ在[0-1/D)之间,这个基于转移的梯度比随机向量误差还大,所以需要用一个较小的

λ

\lambda

λ值去搜索其他的方向,将公式10带入公式9中:

从公式可以看出,

α

2

\alpha^2

α2

↑

\uparrow

↑、q

↓

\downarrow

↓时,

λ

∗

\lambda^*

λ∗

↑

\uparrow

↑。并且

λ

∗

\lambda^*

λ∗

↑

\uparrow

↑时,近似的梯度就越接近真实的梯度;所需的查询次数少。

λ

∗

\lambda^*

λ∗=1时,不需要采样q个随机向量,因为它们所有都等于v,所以直接返回v当做估计的梯度(会减少很多需要的查询次数)。算法伪代码如下:

4.2 PRGF with Gradient Averaging

原始的RGF算法是将所得的估计梯度直接平均得到,但是其实基于转移的梯度也可以被认为是真实梯度的估计,所以很自然地想到能不能把这两个梯度合并成一个,也许能更接近原始梯度,所以使用了加权平均策略。如下图所示:

v是通过估计梯度后规范化处理后的梯度,公式最后那个数(太难打出来了)是通过原始RGF方法估计后的梯度的平均值,

μ

\mu

μ的作用和前面的

λ

\lambda

λ类似,起到平衡的作用。就可以通过优化

μ

\mu

μ来优化损失:

其中

β

\beta

β是原始RGF估计值和真实梯度的余弦相似度(与

α

\alpha

α类似的)、D为输入维度,q为查询的次数,

μ

∗

\mu^*

μ∗关于

α

\alpha

α单增,关于E(

β

\beta

β)单减。当

μ

∗

\mu^*

μ∗小于1时,需要算公式13后面的那个,所以会耗费一些查询,当

μ

∗

\mu^*

μ∗接近于1时,从公式13可以看出,直接用v当做估计值,为了权衡查询次数,设置参数c当

μ

∗

\mu^*

μ∗>=c时,就直接返回v当做估计值,算法的伪代码如下:

下面是将几个方法在一起比较,看

α

\alpha

α和损失的曲线,并且得出结论PRGF-GA方法在这几个方法中是利用转移先验知识最好的。

4.3 Estimation of Cosine Similarity

为了算法的完整而进行的对余弦相似度的评估。

5 Extensions

在本节中,扩展了算法,以结合使用data-dependent prior、多个代理模型来提供transfer-based prior。

5.1 Data-dependent Prior

data-dependent prior这个普遍的方法提出来是为了降低查询复杂度的,本文通过这个启发,在没有牺牲很多梯度估计的精确度的前提下,减少输入空间维数的输入结构,接下来具体介绍如何将这种思想结合到RGF、PRGF-BS、PRGF-GA。

RGF:

PRGF-BS:在前面提到这个方法时相同地方法得到

C

⃗

\vec C

C一个特征向量v(tranfer-based prior),其他的特征向量是通过data-dependent prior方法获取正交基:

其他的步骤跟前文提到的一样。

PRGF-GA:在RGF的子空间上获得梯度估计值,而不是原始的RGF空间上:

下式左边是右边最后一项在data-dependent prior子空间上的投影(其他步骤都相同):

5.2 Multiple Surrogate Models

主要思想是在一个Multiple Surrogate Models(多个替代模型)上获得一个更有效的tranfer-based prior。将多个模型在x上的梯度算出来,然后直接取平均就可以得到v,之后的求解与PRGF-BS或PRGF-GA攻击算法相同。

6、 Experiments

6.1节介绍实验设置,6.2节介绍梯度评估的结果,6.3节介绍在ImageNet上的攻击算法比较,6.4节介绍在Cifar10上的攻击算法比较。

参数评估图:

梯度是每迭代十次估计一次:

关于表1的一些发现:1、与最先进的攻击相比,所提出的方法通常会导致更高的攻击成功率和更少的查询;2、基于传输的先验为黑盒攻击提供有用的先验信息,因为基于PRGF的方法比普通RGF方法性能更好;3、在PRGF-BS中使用固定的λ或在PRGF-GA中使用固定的µ不能超过其最佳值的性能,尽管它们已经产生了与最先进方法相当的性能;4、结果还证明,依赖于数据的先验与所提出的基于传输的先验是正交的,因为集成依赖于数据的先验可以得到更好的结果;5、在大多数情况下,PRGF-GA需要的查询比PRGF-BS稍微少一些,这与图1中的损失曲线一致。

关于替代模型做的一些消融实验:

在Cifar10上的一些结果:

7、Conclusion

本文提出了两种改进黑盒攻击的先验引导无梯度算法。我们的方法可以分别通过偏置采样和梯度平均利用代理模型的梯度给出的基于转移的先验。在梯度估计框架下,我们通过两种方法中导出的最优系数将基于传输的先验知识与模型查询进行了适当的整合。此外,我们通过合并依赖于数据的先验知识和利用多个代理模型来扩展所提出的方法。实验结果一致地证明了我们的方法的有效性,与各种最先进的攻击方法相比,这种方法需要更少的查询来攻击黑盒模型,成功率更高。我们的代码在:https://github.com/thu-ml/Prior-Guided-RGF。

2310

2310

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?