受到基于 Transformer 的模型在计算机视觉各种任务中提取远程特征的能力的启发 [24],[25],[26],[27],前期工作 [28],[29],[ 30]、[31]、[32]、[33]、[34]引入了用于HSI分类的变压器结构,并取得了可喜的结果。 与CNN不同的是,Transformer不受感受野的限制。 多头自注意力(MHSA)是变压器的主要组成部分,它可以对所有像素的相关性进行建模。 借助 MHSA,变压器可以捕获空间和光谱维度上的全局关系,这为 HSI 分类任务提供了一种新的有效方法。 然而,当前基于变压器结构的模型不足以利用多尺度光谱空间信息。 [29]中的工作仅关注利用变压器捕获谱相关性,但没有考虑变压器获取空间信息的能力。 [28]和[30]中的工作捕获了远程空间特征,但忽略了短程空间信息的重要性。 因此,这些基于变压器的模型的分类性能受到它们从光谱空间角度同时提取短程特征和长程特征的能力的限制。 基于对上述工作的研究,主要解决以下三个问题。

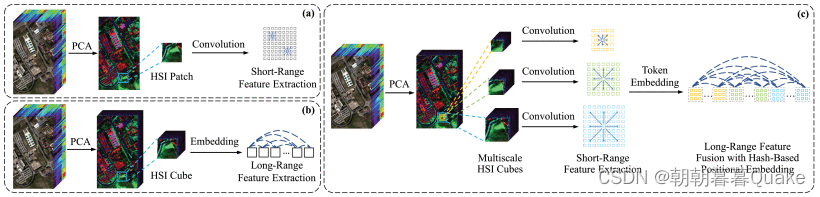

首先,我们注意到 CNN 可以有效地提取短程光谱空间信息。 然而,由于感受野有限,其捕获长距离光谱空间信息的能力不足,如图1(a)所示。 相反,Transformer 显示出学习远程特征之间相互关系的能力,如图 1(b)所示。 因此,直观地说,HSI 分类任务中 CNN 和 Transformer 的结合将增强短程依赖性和长程依赖性的光谱空间特征提取,如图 1(c)所示。 值得注意的是,合并 CNN 和 Transformer 在计算机视觉领域表现出了良好的性能 [35]、[36]、[37]、[38],但在 HSI 分类中尚未得到深入研究。

Hyperspectral Image Classification Using Spectral–Spatial Token Enhanced Transformer With Hash-Based

于 2024-04-17 10:31:59 首次发布

本文探讨了Transformer在HSI分类中的应用,指出现有模型未能充分利用多尺度信息。作者提出结合CNN和Transformer的优势,以增强短程和长程光谱空间特征提取,尤其是在解决空间依赖性方面。

本文探讨了Transformer在HSI分类中的应用,指出现有模型未能充分利用多尺度信息。作者提出结合CNN和Transformer的优势,以增强短程和长程光谱空间特征提取,尤其是在解决空间依赖性方面。

1599

1599

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?