Depth-wise Convolution详细定义

详细定义请参照下面链接:

https://towardsdatascience.com/a-basic-introduction-to-separable-convolutions-b99ec3102728

快速了解

在学习Depth-wise Conv之前先了解一下传统的Convolution:

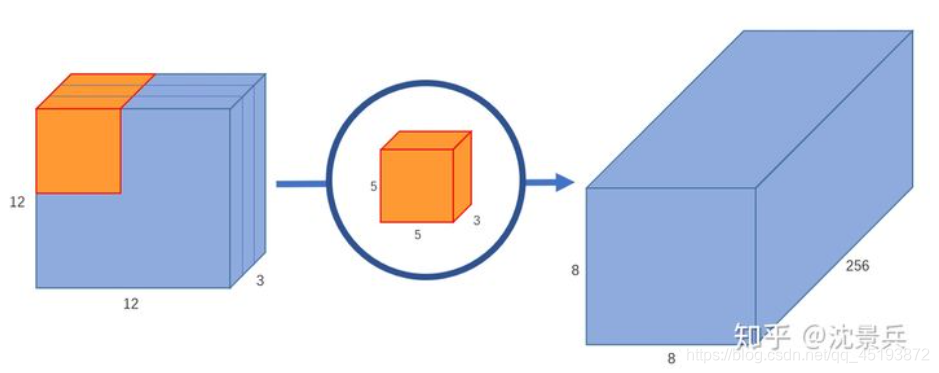

对于普通卷积:

我们从[12,12,3]的input feature map到[8,8,256]的output feature map,需要256个[5,5,3]的卷积核。参数量为256 x 5 x 5 x 3 = 19200,乘法次数为256 x 5 x 5 x 3 x 8 x 8 = 1228800(可以理解为FLOPs)。

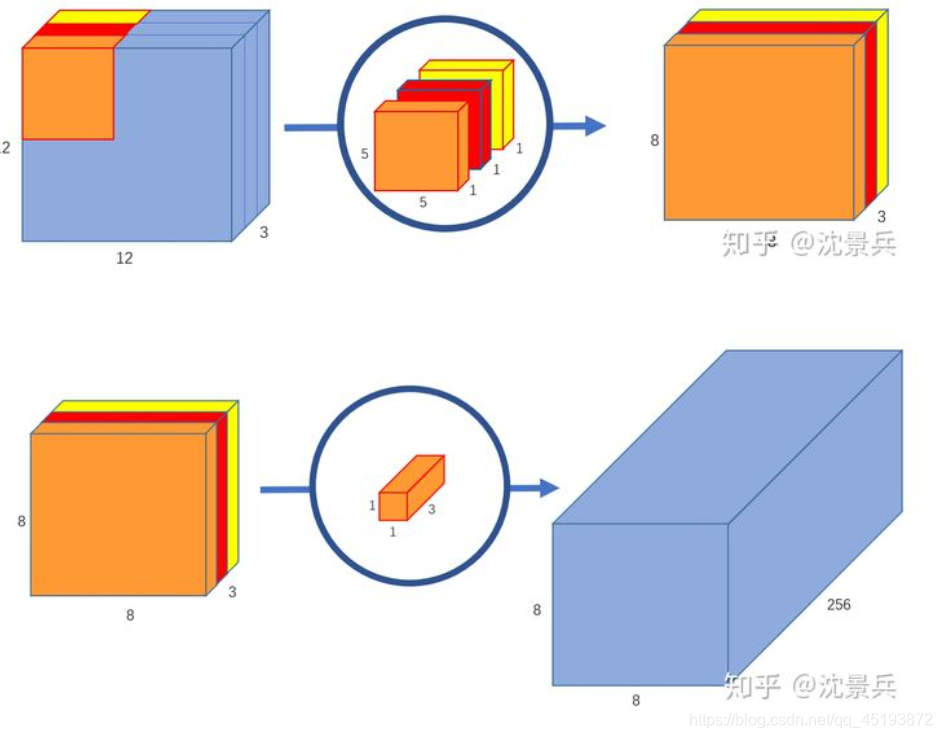

对于depth-wise卷积:

Depth-wise Conv分为2个卷积过程:Separable Conv 以及 Point-wise Conv.

同样的,从[12,12,3]的input feature map到[8,8,256]的output feature map,需要3个[5,5,1]的卷积核和256个[1,1,3]的卷积核。参数量为3 x 5 x 5 x 1 + 256 x 1 x 1 x 3 = 843,乘法次数为3 x 5 x 5 x 1 x 8 x 8 + 256 x 1 x 1 x 3 x 8 x 8 = 53952(FLOPs)。

如此一来,depth-wise conv的FLOPs只有普通卷积的~4.4%,EfficientNet的参数量少也就不足为奇了。

那么,为什么推理速度反而更慢呢?

这就要说说,如何衡量推理速度了:

细致了解推理速度影响因素请参照:https://zhuanlan.zhihu.com/p/122943688

简单概括:

简单来说,depth-wise卷积的FLOPs更少没错,但是在相同的FLOPs条件下,depth-wise卷积需要的IO读取次数是普通卷积的100倍,因此,由于depth-wise卷积的小尺寸,相同的显存下,我们能放更大的batch来让GPU跑满,但是此时速度的瓶颈已经从计算变成了IO。自然desired小尺寸卷积应该有的快速的特性,也无法实现。

当然,也不该如此绝望,也许未来某天GPU的IO性能进一步提升,基于depth-wise卷积的工作就可以真正称得上是Efficient了!

转载自:https://zhuanlan.zhihu.com/p/149564248

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?