2022年6月1日,上海交通大学教授 李仁涵,在清华一场论坛上的分享。

主要有四点体会:

一是国际人工智能治理正在加速可操作化(为什么)

国际技术标准组织(IEEE,ISO/JTC1)2016年开始,2021年进入井喷期,比如,2021年6月出台的IEEEP7000-P7013,系统设计期间解决伦理问题的模型过程的标准。

具体方面:

数据治理领域,数据信托、公共数据开放、公民数字身份

算法治理领域,政府投资可信AI、公共部门采用可信AI

网络治理领域,间接管制

监管政策领域,监管机构、监管框架、监管基础能力

产业政策领域,中小企业、技术与场景人才培养

社会政策领域,数字技能培训、人工智能知识普及

二是AI发展带来的社会属性问题(是什么)

人工智能是一种通过机器模拟人类认知能力的技术。对它的要求也需要像人的要求那样,才能和谐相处。

随着人工智能技术的发展,社会属性问题随之而来。主要有:一是安全问题。已经发生,只要涉及到国家安全、社会安全、经济安全、个人安全等。二是伦理问题。也已经发生,主要涉及到人们的隐私、公平、透明、歧视、就业等。三是不可控或变异安全问题,尚未发生,属于非常规问题,未来如果出现,有可能会不可控,对人与社会造成伤害。

因此,需要从技术与治理两个层面应对AI带来的问题。一是发挥技术支撑作用,建立可信可控的AI。二是加强国内治理,对标国际规则。通过制定标准、规则、法律、监管和执法规范AI治理。

三是建立人工智能平台(体系)(怎么办)

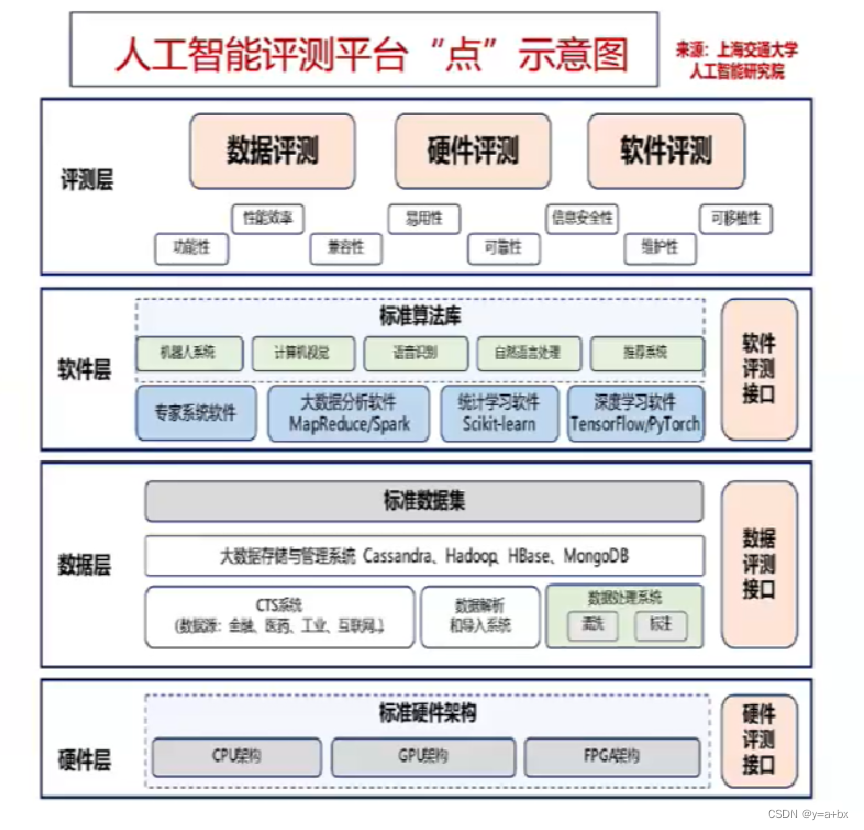

建立AI评测平台(体系)有助于AI治理落地。可以先从常规安全问题和伦理问题着手,非常规安全问题(不可控或变异)可以开展前瞻性研究。具体有以下几点建议:

在研究量化的AI技术衡量指标基础上,健全AI数据标准、测评、知识产权等服务体系,打造标准化格式的数据集。

围绕产业术语、参考框架、算法模型、基础理论、关键技术以及产品和服务、行业应用、安全(可控与非可控)和伦理等等,为各领域AI技术应用提供标准、指南和实践案例等。

建立针对AI技术标准化评测方法体系(国际化),形成有效的AI监管和审核工具。

四、人工智能伦理问题能否通过特定的治理工具得到解决?在AI评测平台中如何考虑伦理问题?

短时间只能解决小部分,整个过程还是要从无序到有序。伦理是柔性的,如果有刚性的比如法律法规,技术标准等,则比较好实现。比如,招聘中,就存在歧视的问题,很难有统一的评判标准,都是公司从自身需求出发。

将来,AI评测平台或者说治理工具都是多样化的,扁平化的,不像过去由上到下贯通的。

AI评测平台对于伦理需要进一步开发研发,然后标准、法律法规同步进行。这个过程需要实践、案例、国际合作等多元主体共建。

这篇博客探讨了人工智能治理的加速可操作化,强调了AI带来的安全、伦理和社会属性问题。提出建立AI评测平台以解决这些问题,并强调伦理问题的解决需要技术与治理并重,同时建议在标准化、法规制定和国际合作方面加强努力。

这篇博客探讨了人工智能治理的加速可操作化,强调了AI带来的安全、伦理和社会属性问题。提出建立AI评测平台以解决这些问题,并强调伦理问题的解决需要技术与治理并重,同时建议在标准化、法规制定和国际合作方面加强努力。

4384

4384

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?