本文表明,掩码自编码器(MAE) 是用于计算机视觉的可扩展自监督学习器。我们的 MAE 方法很简单:我们屏蔽输入图像的随机块并重建丢失的像素。它基于两个核心设计。

首先,我们开发了一个非对称编码器-解码器架构,其中一个编码器只对可见的补丁子集进行操作(没有掩码标记),还有一个轻量级的解码器,可以从潜在表示和掩码标记重建原始图像。其次,我们发现掩饰的比例很高 ,输入图像的 75%,产生一个重要且有意义的自我监督任务。结合这两种设计使我们能够高效地训练大型模型:我们加速训练(3 倍或更多)并提高准确性。我们的可扩展方法允许学习泛化良好的高容量模型:例如,在仅使用 ImageNet-1K 数据的方法中,vanilla、ViT-Huge 模型实现了最佳准确率 (87.8%)。下游任务中的传输性能优于有监督的预训练,并显示出有希望的扩展行为。

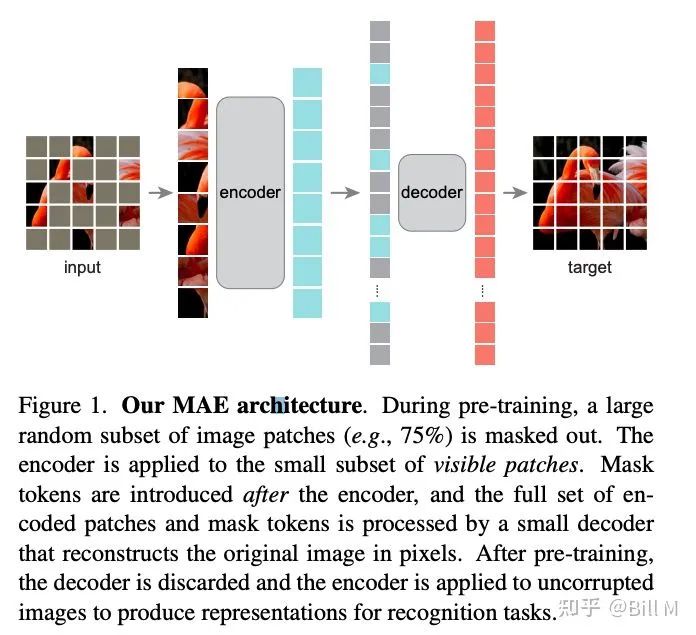

图 1 MAE 架构

在预训练期间,大量随机的图像块子集(例如 75%)被屏蔽掉。编码器应用于可见补丁的小子集。在编码器之后引入掩码标记,并且完整的编码块和掩码标记集由一个小型解码器处理,该解码器以像素为单位重建原始图像。预训练后,解码器被丢弃,编码器应用于未损坏的图像以生成识别任务的表示。

这个图灰色的就是加mask抹掉的,填一些平均值之类的,通过encoder后又嵌入原来的位置,然后通过decoder解码组合出目标图片。图中encoder比decoder大许多,encoder输入也没有像decodeer输入一样有mask填补的全部的 patch,而且encoder的输入是随机打乱的,这样是因为做有些下游任务,预训练的时候有些没观测到,而下游任务比如目标检测,分割 是全部观测到了,这样就会有个gap,所以encoder输入是没有灰色的块,就是pre-training和fine-tuning有个gap,这个gap会影响你的效果。做 loss的时候可见部分不需要loss。

Introduction

深度学习见证了能力和容量不断增长的架构的爆炸式增长 [28, 24, 47]。在硬件快速增长的帮助下,今天的模型很容易过拟合一百万张图像[13],并开始需要数亿张——通常是公众无法访问的——标记图像[16]。

这种对数据的需求已经通过自监督预训练在自然语言处理 (NLP) 中成功解决。基于 GPT [40, 41, 4] 中的自回归语言建模和 BERT [14] 中的掩码自动编码的解决方案在概念上很简单:它们移除了一部分数据并学习预测移除的内容。这些方法现在可以训练包含超过一千亿个参数的可泛化 NLP 模型 [4]。

掩码自编码器的想法,一种更通用的去噪自编码器 [48],很自然,也适用于计算机视觉。事实上,在 BERT 之前,与视觉密切相关的研究 [49, 39]。然而,尽管在 BERT 成功之后人们对这个想法产生了浓厚的兴趣,但视觉中自动编码方法的进展落后于 NLP。

我们问:是什么使视觉和语言之间的掩码自动编码不同?我们尝试从以下几个角度来回答这个问题:

1、直到最近,架构还是不同的。在视觉方面,卷积网络 [29] 在过去十年中占主导地位 [28]。卷积通常在规则网格上运行,将诸如掩码标记 [14] 或位置嵌入 [47] 之类的“指标”集成到卷积网络中并不容易。然而,这种架构差距已通过引入 Vision Transformers (ViT) [16] 得到解决,不应再成为障碍。

2、语言和视觉的信息密度不同。语言是人类生成的具有高度语义和信息密集度的信号。当训练一个模型来预测每个句子只预测几个丢失的单词时,这个任务似乎会导致复杂的语言理解。相反,图像是具有大量空间冗余的自然信号——例如,可以从相邻的块中恢复丢失的块,而对parts、对象和场景的高级理解很少。为了克服这种差异并鼓励学习有用的特征,我们展示了一个简单的策略在计算机视觉中效果很好:屏蔽了很大一部分的随机补丁。这种策略在很大程度上减少了冗余并创建了一项具有挑战性的自我监督任务,需要超越低级图像统计的整体理

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

439

439

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?