目录

摘要

本文提出了一种特征自适应网络(FAN)以实现监控人脸识别与人脸规范化(face normalization)。其中人脸规范化主要用于图像超分。

然而现有的人脸超分方法往往需要pixel-to-pixel的成对训练数据,但这在实际情况系往往是找不到的。文本所提出的FAN可以利用成对及不成对的数据,将特征分解为身份特征和身份无关特征并适用于身份特征的分布(?)。

除此之外,文章还提出了一种随机尺度增广(RSA)方法以学习分辨率鲁棒的身份特征(优于现有的固定尺度增广方法)。

一、介绍

现有的人脸超分方法很难应对监控人脸问题,因为这些方法往往忽略了身份信息且需要成对的训练数据。

本文探究的问题是在给定监控人脸下学习鲁棒的身份特征信息,同时利用这些特征增强面部细节以及中间姿势、光照、表情(neutral PIE)。

所谓的“人脸规范化”与传统的人脸超分目标相同,但其不需要使得原始LR图像与超分图像满足pixel-tp-pixel关系。

FAN与现有的人脸超分方法比较,其优点在于:

- 同时适用于人脸识别与超分两项任务

- 训练集数据可以成对也可以不成对,而传统超分需要成对的训练数据

- FAN在提高图像分辨率的同时,也对背景信息及PIE(姿势、光照、表情)做了增强

二、相关工作

2.1 人脸识别

现状:

- 在传统人脸识别数据集上表现良好的方法无法处理无约束的LR图像(eg:监控人脸图像)

- 解决监控人脸问题的一种常见方法:为LR和HR图像学习一个统一的特征空间

同时,保留身份信息的人脸超分方法也是一个主流方向:

2.2 人脸规范化

三、特征自适应网络

3.1 框架概述

本工作的目标为:

- 分辨率鲁棒的人脸识别

- 身份保留和分辨率增强的人脸规范化

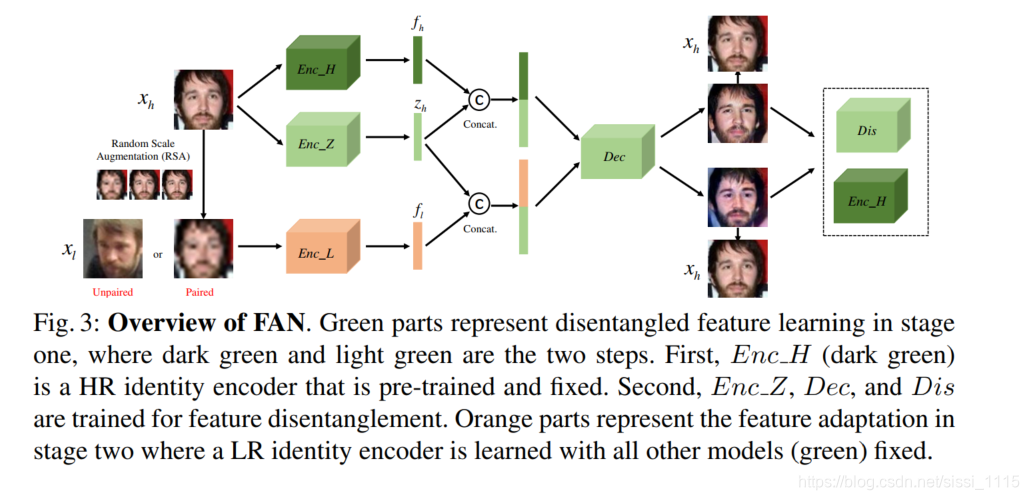

本工作的步骤保留两个:

- 绿色部分 :解离特征学习

- 橙色部分 :特征自适应

特征解离已经成功的应用于人脸识别和人脸合成,解离表示不仅对人脸合成具有生成性,还对人脸识别具有判别性。

因此,在工作的第一个stage,本文采用HR人脸图像训练特征解离架构,将人脸图像encode为身份特征和非身份特征,并将这两种特征组合起来生成所需的HR图像;在工作的第二个stage,本文将解离架构的所有模型固定,对于HR-LR输入图像(paired或unpaired)实现了特征自适应。从而可以学习一个LR特征encoder,用于从LR人脸图像中提取具有判别性的身份特征。

同时,为了实现分辨率鲁棒的人脸识别,本文提出了Random Scale Augmentation(RSA)以克服固定尺度增广产生的相关缺点。

3.2 特征解离学习

特征解离框架包括五个模块:

| 模块 | |

|---|---|

| 身份特征encoder | Enc_H |

| 非线性特征encoder | Enc_Z |

| decoder | Dec |

| 线性分类器 | FC |

| 判别器 | Dis |

具体身份特征解离过程分为两步:

- 使用HR及下采样LR得到的LR图像以及标准

softmax loss和M-L2正则化训练一个state-of-art模型,将训练好的feature encoder称为Enc_H,其将在后面的步骤中保持不变,通过输入的HR图像 x h x_h xh提供编码后的身份特征:

f h = E n c _ H ( x h ) f_h=Enc\_H(x_h) fh=Enc_H(xh) - 第二步,通过对抗训练及图像重建学习非身份特征:

z h = E n c _ Z ( x h ) z_h=Enc\_Z(x_h) zh=Enc_Z(xh)

与先前的特征解离方法不同的是:

- 对于

z

h

z_h

zh的损失函数,区别于最小化

身份分类损失(由于是无界的因此不稳定?),本文提出加强非身份特征,将其均匀的分类到所有的身份上以保证身份的不相关性(?):

L z = ∣ ∣ F C ( z h ) − y z ∣ ∣ 2 2 L_z=||FC(z_h)-y_z||_2^2 Lz=∣∣FC(zh)−yz∣∣22

这个损失的梯度只用于更新Enc_Z而不更新FC。

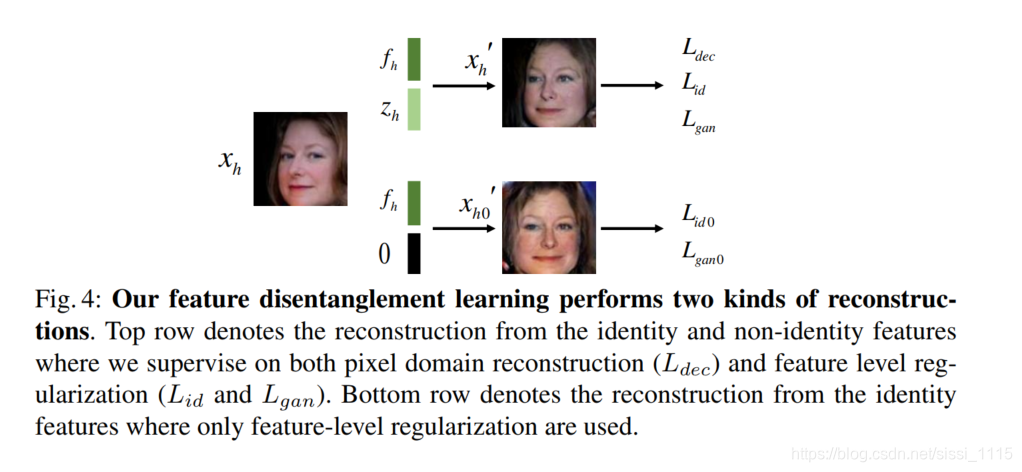

解离特征被用于生成人脸图像 x h ′ = D e c ( f h , z h ) x'_h=Dec(f_h,z_h) xh′=Dec(fh,zh),其目标是恢复输入: L d e c = ∣ ∣ x h ′ − x h ∣ ∣ 2 2 L_{dec}=||x'_h-x_h||_2^2 Ldec=∣∣xh′−xh∣∣22。由于 f h f_h fh对人脸识别具有判别性,因此在第一步中需要将 f h f_h fh中的非身份部分丢弃。图像重建将鼓励 E n c Z Enc_Z EncZ编码非身份特征 z h z_h zh,这是在恢复输入图像时对 f h f_h fh的补充。 - 本文使用了

身份相似度正则化以及基于GAN的判别器损失以加强身份相似度及提高生成人脸的视觉质量。对于身份损失,本文采用Enc_H提取特征并正则化特征间的距离: L i d = ∣ ∣ E n c _ H ( x ; h ) − f h ∣ ∣ 2 2 L_{id}=||Enc\_H(x;_h)-f_h||_2^2 Lid=∣∣Enc_H(x;h)−fh∣∣22;采用二元交叉熵损失作为判别器损失。 - 本文还从身份特征中重构了人脸图像: x h 0 ′ = D e c ( f h , 0 ) x'_{h0}=Dec(f_h,0) xh0′=Dec(fh,0),0表示和 z h z_h zh相同维度的0向量。由于非身份部分为0,因此期望的生成图像应该是保留身份且规范化的人脸(没有变化的非人脸因素eg:PIE)。由于没有ground-truth目标图像,本文分别采用身份损失及GAN损失,如下图所示。

这样仅由身份特征重建的好处在于:

- 鼓励仅用身份特征合成身份保留人脸,从而防止了非身份特征编码身份信息(?),以得到更好的解离效果。

- Dec仅从身份特征重建身份保留人脸的能力有助于面部细节的加强(?)

3.3 成对及不成对数据的特征自适应

只使用HR训练Dec的原因是为了使Dec生成HR图像,提高人脸规范化的分辨率。然而这个框架并不适用于LR输入。因此,文章提出了一种特征自适应方案来学习LR编码器Enc_L,用于LR人脸识别和规范化。这里的目标是学习一种能够处理不同分辨率输入人脸的特征提取器。

3.3.1 用于训练的paired data

对于传统方法,paired data指的就是HR图像以及通过固定几种下采样因子得到的对应LR图像,但这种数据不能很好地模拟现实监控图像中的各种分辨率情况。

为了解决这个问题,本文提出了一种Random Scale Augmentation(RSA),即将给定的HR图像下采样到随机的分辨率,将这样得到的LR图像及HR图像称为像素上对应的paired data。

3.3.2 用于训练的unpaired data

unpaired data表示的是来自一个个体的HR图像和LR图像,但并没有像素上的对应。

如上图所示,根据T-SNE图像展示的特征分布,可以看出paired data和unpaired data间的分布是完全不同的。

FAN可以通过将解离的特征进行人脸规范化解决unpaired data的问题。

再根据上图所示,FAN的架构中同时实现像素级别和图像级别的相似性监督。

- 具体来说,

x

l

x_l

xl是随机下采样得到的或来自unpaired数据的LR图像,这里采用

bicubic插值使其与 x h x_h xh的维度相当,然后通过 E n c _ L Enc\_L Enc_L提取身份特征 f l f_l fl,通过正则化使其与对应的HR输入图像的解离特征相似(像素级别):

L e n c = ∣ ∣ E n c _ L ( x l ) − E n c _ H ( x h ) ∣ ∣ 2 2 L_{enc}=||Enc\_L(x_l)-Enc\_H(x_h)||_2^2 Lenc=∣∣Enc_L(xl)−Enc_H(xh)∣∣22

这种特征级别的正则化使得在解离特征空间,LR图像的特征适应于HR图像的特征。 - 在第一阶段,

D

e

c

Dec

Dec被训练通过输入HR图像的身份及非身份特征,生成HR图像。如果KaTeX parse error: Undefined control sequence: \- at position 4: Enc\̲-̲L可以encode身份保留的特征,那么这种特征就可以代替原始的HR图像身份特征,以恢复输入的HR图像。因此,本文提出了在恢复后的人脸图像空间上的图像级别的正则项:(??再看看)

L e n c _ d e c = ∣ ∣ D e c ( f l , E n c _ Z ( x h ) − x h ∣ ∣ 2 2 L_{enc\_dec}=||Dec(f_l,Enc\_Z(x_h)-x_h||_2^2 Lenc_dec=∣∣Dec(fl,Enc_Z(xh)−xh∣∣22

由于从HR图像上encode得到的非身份特征有助于生成输出的图像,因此可以将原始的HR图像作为target进行监督(??)。

上述的特征级别正则项和图像级别正则项都可以促进

E

n

c

_

L

Enc\_L

Enc_L学习鲁棒的身份特征

f

l

f_l

fl,通过改变输入的LR图像的分辨率,

f

l

f_l

fl就会分辨率鲁棒。

除此之外,本文还使用预训练好的判别器

D

i

s

D_{is}

Dis及

E

n

c

H

Enc_H

EncH,使得生成的输出图像更realistic以及具有身份保持性。

上图为具体的训练步骤,首先我们通过HR图像及下采样得到的LR图像对

E

n

c

_

H

Enc\_H

Enc_H进行训练(stage 1.1),接下来我们固定

E

n

c

_

H

Enc\_H

Enc_H仅使用HR图像进行特征解离训练(stage 1.2),最后我们将其余模型固定,训练

E

n

c

_

L

Enc\_L

Enc_L(stage 2)。

Inference 本文通过LR输入图像提取了身份特征 f l = E n c _ L ( x l ) f_l=Enc\_L(x_l) fl=Enc_L(xl)以用于人脸识别,并且通过 D e c ( f l , 0 ) Dec(f_l,0) Dec(fl,0)将非身份特征设为0以实现人脸规范化,通过这样的方式就可以在架构实现中不需要HR图像,以使用unpaired data。

四、实验

4.1 实现细节

数据集: 在精炼的MSCeleb-1M (MS1M)上训练, 在LFW, SCface , QMUL-SurvFace 及WIDER FACE上测试。令HR图像作为图库,使用不同分辨率的LR图像(在三个距离捕获:4.2m , 2.6m 和1.0m )组成probe集进行人脸识别。

训练设置: 采用5个面部标志对齐人脸,通过bicubic将输入的LR图像放缩到128x128

4.2 消融分析

特征解离的影响: 通过训练的Dec可以可视化解离身份特征

f

h

f_h

fh及非身份特征

z

h

z_h

zh,如图所示,

f

h

f_h

fh和

z

h

z_h

zh的融合可以成功地恢复原始图像。

单独使用身份特征可以生成一个保留身份的正面人脸,而非身份特征可以捕获PIE的变化和背景信息。上述表明了我们的架构有效地分离了身份和非身份特征。

本文提出特征自适应网络(FAN),用于解决监控人脸识别和人脸规范化问题。FAN克服了传统超分方法依赖成对训练数据的限制,能利用成对和不成对数据,通过特征解离学习身份和非身份特征。FAN还引入随机尺度增广(RSA)以学习分辨率鲁棒的身份特征。实验表明,FAN在提高分辨率的同时增强了面部细节和PIE(姿势、光照、表情)信息,且适用于身份识别和图像超分任务。

本文提出特征自适应网络(FAN),用于解决监控人脸识别和人脸规范化问题。FAN克服了传统超分方法依赖成对训练数据的限制,能利用成对和不成对数据,通过特征解离学习身份和非身份特征。FAN还引入随机尺度增广(RSA)以学习分辨率鲁棒的身份特征。实验表明,FAN在提高分辨率的同时增强了面部细节和PIE(姿势、光照、表情)信息,且适用于身份识别和图像超分任务。

1221

1221

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?