来源:专知

本文为论文介绍,建议阅读5分钟

本文探索了如何从算法和硬件实现的角度,使用QNNs实现高能效的物联网和边缘应用。

物联网(IoT)的快速普及与由深度学习算法驱动的机器学习革命同时发生。在这些发展的交汇处,智能感知系统旨在集成感知、基于深度学习的捕获数据解释以及对处理结果的反应。由于电池供电的物联网传感器节点在电力、内存和计算资源方面受到严格限制,将深度学习算法部署在这些系统上需要在算法和硬件领域进行仔细的联合优化。量化神经网络(QNNs)使用低位宽整数格式来表示模型参数和中间结果。这不仅缩小了它们的内存和存储占用,而且通过利用专门用于低精度整数运算的硬件,可以优化推理的操作效率。

本文探索了如何从算法和硬件实现的角度,使用QNNs实现高能效的物联网和边缘应用。其关键贡献的共同点在于关注端到端应用,旨在评估QNNs在提高全系统效率方面的潜力。

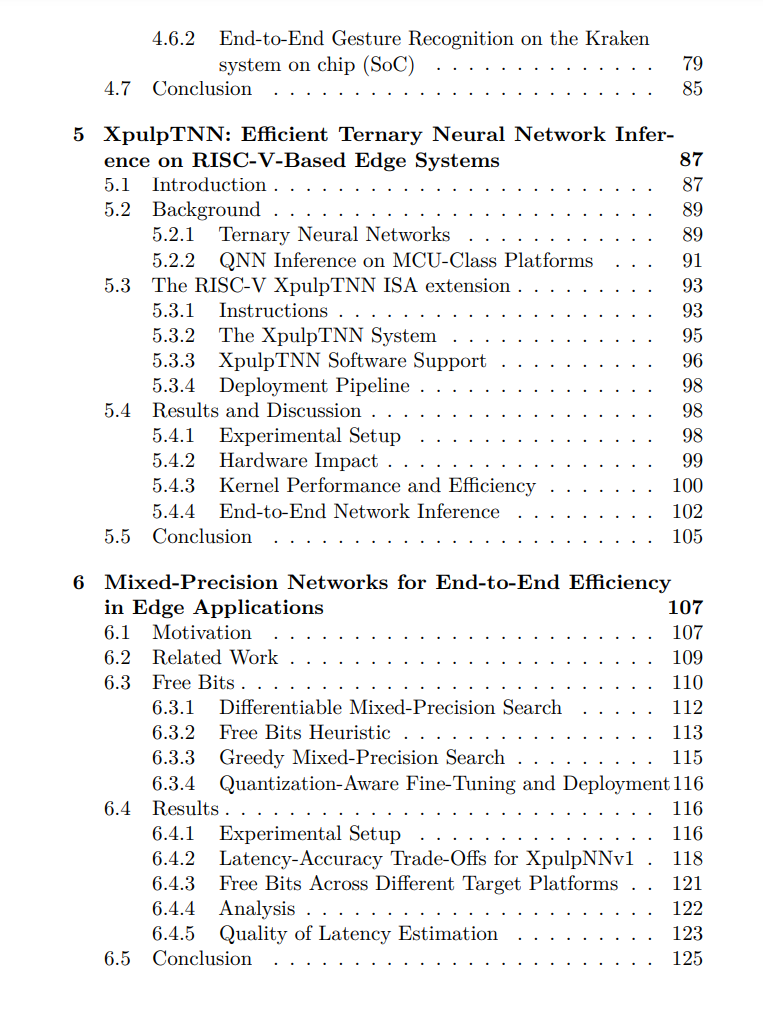

为了高效评估不同量化策略对端到端应用能效的影响,我们首先提出了一种将全精度网络自动转换为可训练和可部署的纯整数量化对应物的方法。然后,我们探讨了极端量化(如三值神经网络,TNNs)的现实潜力。通过动态视觉传感器数据的端到端手势识别示例,我们展示了基于TNN的处理流水线在精度和能效方面的最新成果。接下来,我们提出了特定于TNN的RISC-V指令集架构(ISA)扩展,在硅面积和功耗几乎没有增加的情况下,使实际基准网络的吞吐量提高了40%。

虽然极端量化在能效提升方面最具潜力,但在更具挑战性的任务上会带来显著的精度损失。为了优化网络的统计性能和端到端推理能效之间的权衡,我们提出了一种方法,针对特定网络和硬件目标平台,找到延迟优化的逐层混合精度量化策略,在微控制器级平台上,在1000类ImageNet数据集上实现了与全精度等效的分类精度,同时端到端推理延迟降低了多达30%。

关于我们

数据派THU作为数据科学类公众号,背靠清华大学大数据研究中心,分享前沿数据科学与大数据技术创新研究动态、持续传播数据科学知识,努力建设数据人才聚集平台、打造中国大数据最强集团军。

新浪微博:@数据派THU

微信视频号:数据派THU

今日头条:数据派THU

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?