作者:禅与计算机程序设计艺术

1.简介

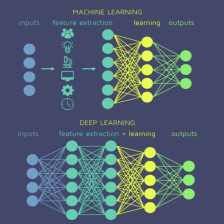

本文作者是资深人工智能专家、资深程序员和软件架构师,他主要从事机器学习、深度学习以及自然语言处理领域的研究工作。近年来由于在自然语言处理、机器学习和图像识别等领域的突破性进展,人们越来越重视对人类语言的理解和建模。语言模型可以帮助计算机更好地理解和生成文本,实现自动问答、聊天机器人、搜索引擎、翻译系统等功能。此外,基于深度学习的语言模型也可以在多语言之间迁移,并帮助构建跨语言的任务,比如:自动摘要、文章审核、语言检测等。

本文将从以下几个方面,阐述如何训练一个深度学习语言模型:

- 使用BERT训练BERT预训练模型;

- 微调BERT预训练模型进行下游任务微调;

- 对BERT模型进行蒸馏、增量学习和前瞻学习;

- 探索BERT模型中潜藏的预训练知识,包括词向量、句法结构和上下文特征等;

- BERT模型的改进方法,如参数共享、更小的网络架构、多任务学习、数据增强、动态mask、投影层、LayerDrop、下游任务的微调策略等。

最后,还会给出一些最佳实践建议,以助读者更好地掌握BERT相关知识,提升深度学习语言模型的应用能力。

2.基本概念术语说明

2.1 Transformer(变压器)

Transformer模型是一种无门槛的最新NLP模型架构,它能够在多个NLP任务上取得state-of-the-art的效果。其特点如下:

-

全局注意力机制:Transformer模型使用了全局注意力机制,即输入序列中的每个位置

订阅专栏 解锁全文

订阅专栏 解锁全文

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?