在默认情况下,无论是 LLM 还是代理都是无状态的,每次模型的调用都是独立于其他交互的。也就是说,我们每次通过 API 开始和大语言模型展开一次新的对话,它都不知道你其实昨天或者前天曾经和它聊过天了。

你肯定会说,不可能啊,每次和 ChatGPT 聊天的时候,ChatGPT 明明白白地记得我之前交待过的事情。

的确如此,ChatGPT 之所以能够记得你之前说过的话,正是因为它使用了记忆(Memory)机制,记录了之前的对话上下文,并且把这个上下文作为提示的一部分,在最新的调用中传递给了模型。在聊天机器人的构建中,记忆机制非常重要。

使用 ConversationChain

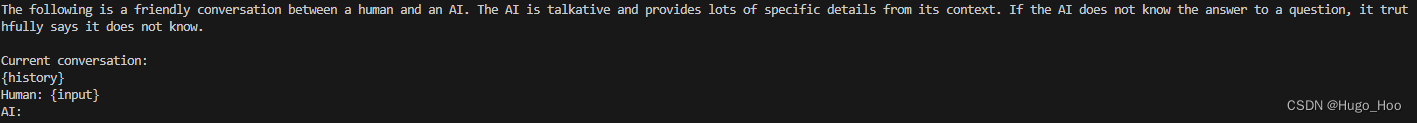

不过,在开始介绍 LangChain 中记忆机制的具体实现之前,先重新看一下我们上一节课曾经见过的 ConversationChain。

这个 Chain 最主要的特点是,它提供了包含 AI 前缀和人类前缀的对话摘要格式,这个对话格式和记忆机制结合得非常紧密。让我们看一个简单的示例,并打印出 ConversationChain 中的内置提示模板,你就会明白这个对话格式的意义了。

#初始化语言模型

from langchain_openai import ChatOpenAI

llm=ChatOpenAI(

openai_api_key='替换为你的API密钥',

base_url='https://api.chatanywhere.tech/v1',

model='gpt-3.5-turbo',

temperature=0.7,

)

#初始化对话链

from langchain.chains import ConversationChain

conv_chain = ConversationChain(

llm=llm,

)

#打印对话的模型

print(conv_chain.prompt.template)

使用 ConversationBufferMemory

在 LangChain 中,通过 ConversationBufferMemory(缓冲记忆)可以实现最简单的记忆机制。

#使用 ConversationBufferMemory在 LangChain 中,

#通过 ConversationBufferMemory(缓冲记忆)可以实现最简单的记忆机制。

from langchain.chains.conversation.memory import ConversationBufferMemory

conversat

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

328

328

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?