文章地址:https://arxiv.org/abs/2111.15193

1. Motivation

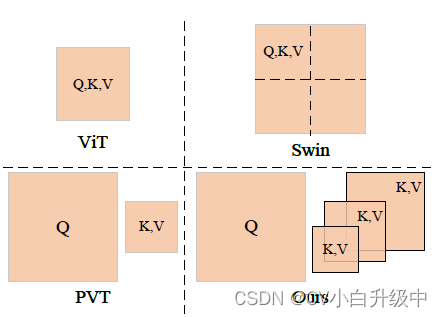

ViT的每层特征的感受野大小是相似的,导致无法处理多尺度目标大小的任务。

2. Contribution

提出SSA,将attention head分组,每组负责不同的attention granularity,来处理hybrid-scale attention

3. Methods

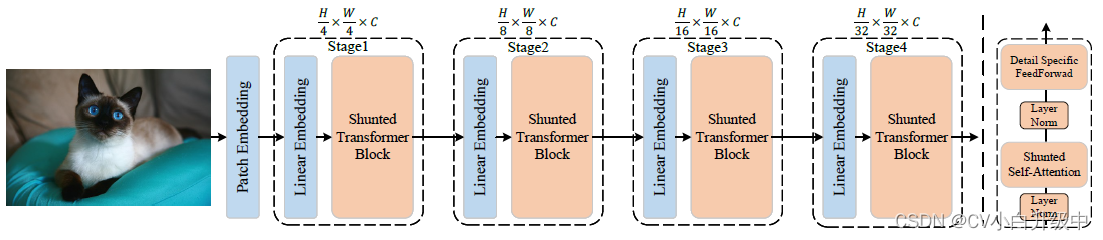

3.1 Shunted transformer block

Shunted self-attention: multi-head self-attention中不同head的key和value采用不同的下采样率

Data-specific f

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2288

2288

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?