ICLR22 :https://arxiv.org/pdf/2110.04572.pdf

文章卖点主要集中在:

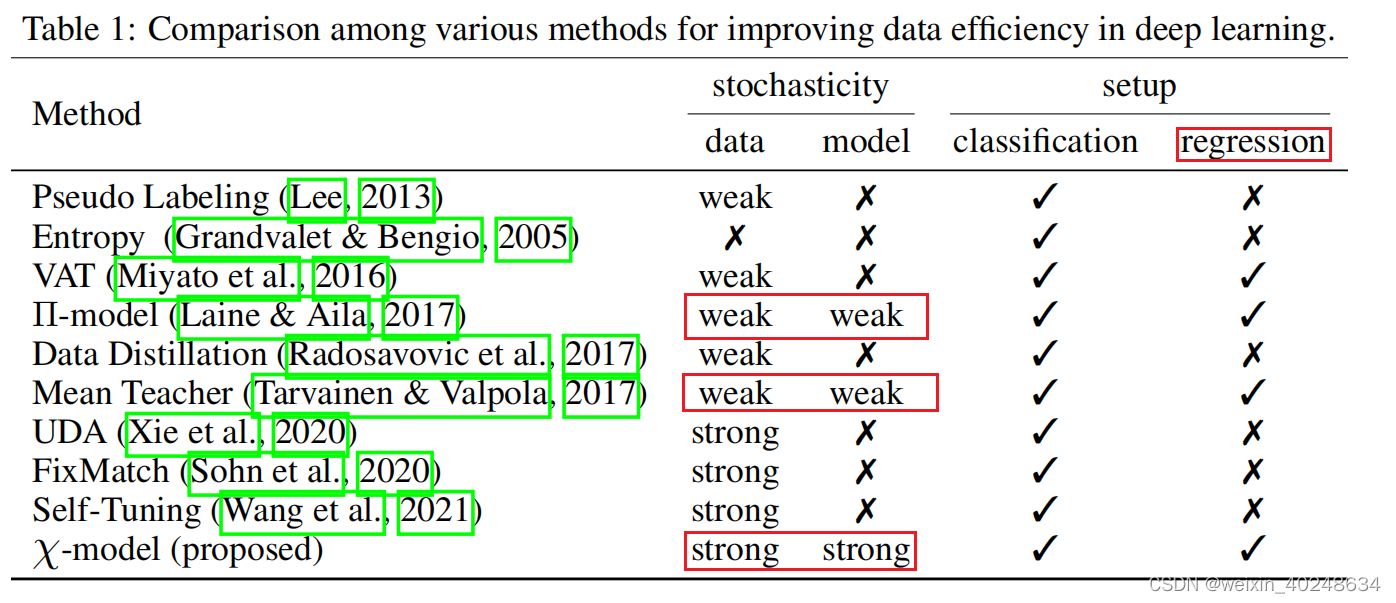

- 同时使用了data augmentation 和model 的consistant learning, 而且使用的都是强扰动后的一致性。

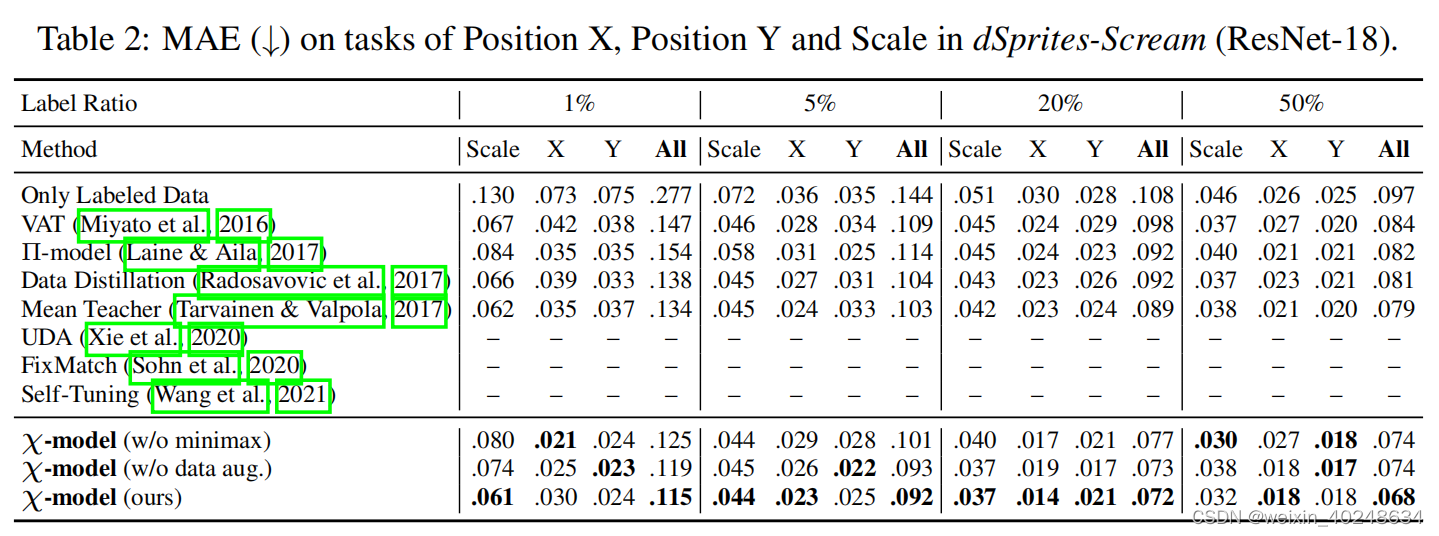

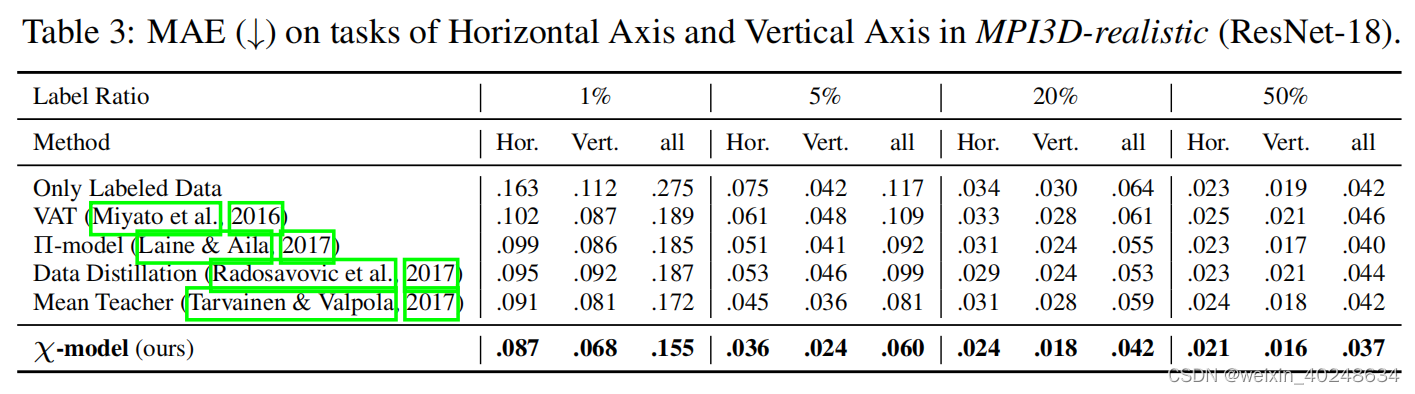

- 在回归settiing 上做了实验

1. data stochasticty( use augmentations)

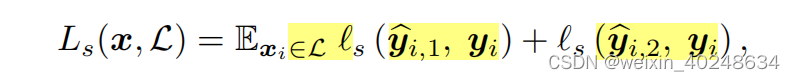

1.1 有监督+ unlabel loss

2. model stochasticty (adversary)

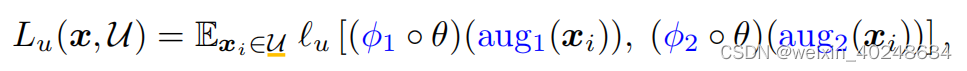

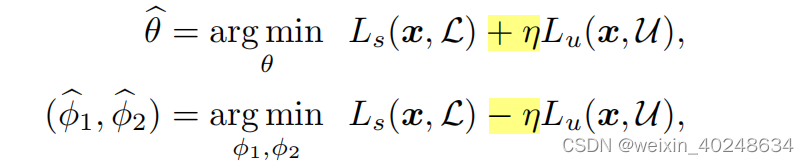

使用minmax prinple 以对抗的方式来训练header

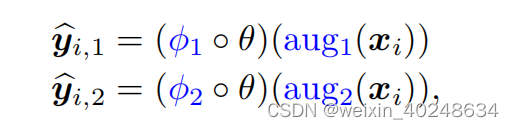

这里 第二步就是两个不同的headers

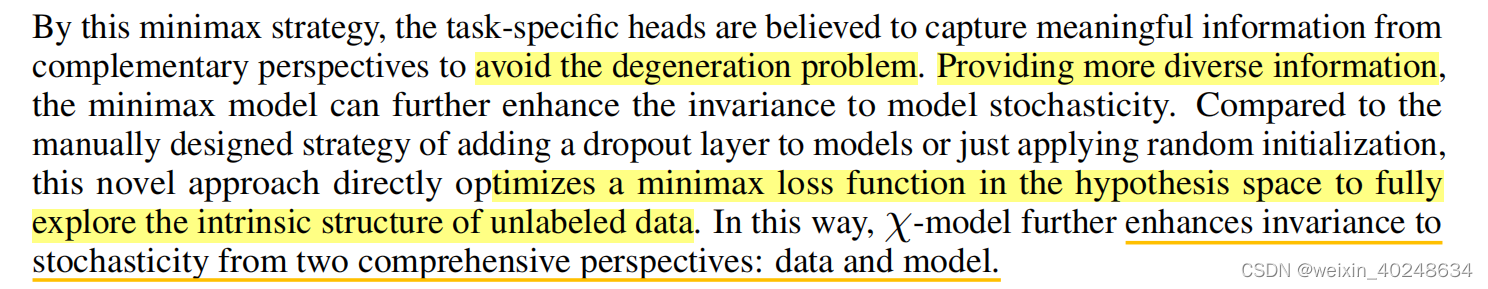

通过这种极大极小策略,特定任务的头部被认为可以从互补的角度捕获有意义的信息,以避免退化问题。极大极小模型提供更多样的信息,可以进一步增强模型随机性的不变性

3063

3063

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?