在利用自定义损失函数进行损失计算的时候,需要使用到sigmoid函数。当在训练模型的时候,使用torch.nn.Sigmoid()对输出进行处理,但是提示__init__错误。我发现光sigmoid()就有三种调用的方式:torch.sigmoid(),torch.nn.Sigmoid()和torch.nn.functional.sigmoid()。

torch.sigmoid():

这是一个方法,包含了参数和返回值。

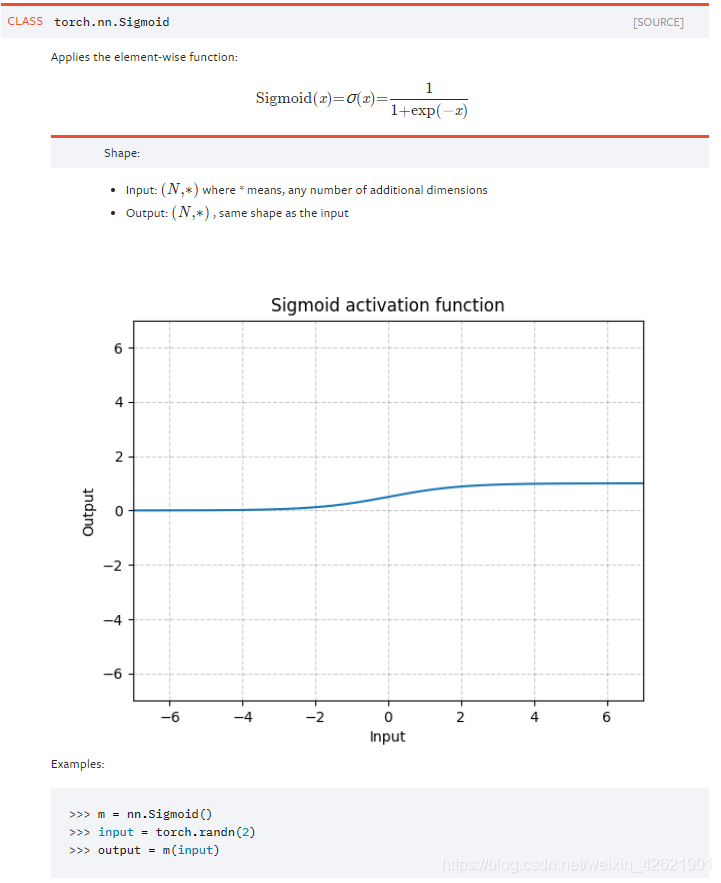

torch.nn.Sigmoid():

可以看到,这个是一个类。在定义模型的初始化方法中使用,需要在_init__中定义,然后在使用。

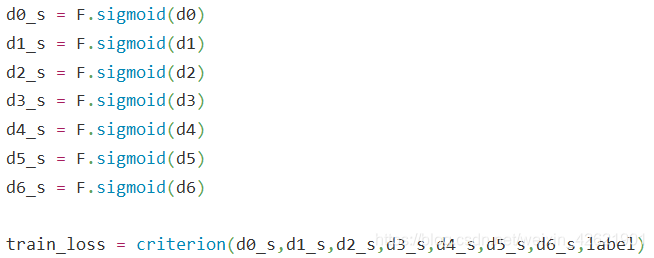

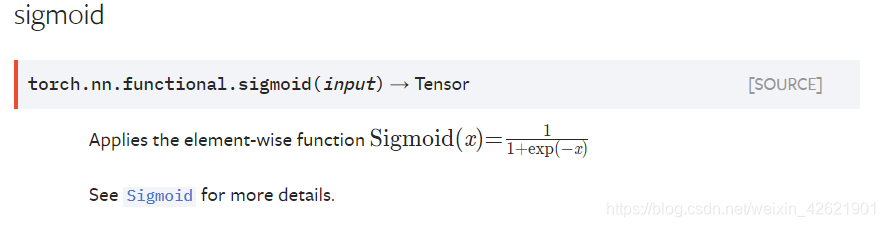

torch.nn.functional.sigmoid():

这其实是一个方法,可以直接在正向传播中使用,而不需要初始化。**在训练模型的过程中,也可以使用。**例如:

本文探讨了PyTorch中的torch.sigmoid()、torch.nn.Sigmoid()和torch.nn.functional.sigmoid()三者,虽然功能相同,但在模型训练中使用场景有所不同。torch.sigmoid()直接调用,torch.nn.Sigmoid()作为类在模型初始化时使用,torch.nn.functional.sigmoid()则可在正向传播中直接应用。

本文探讨了PyTorch中的torch.sigmoid()、torch.nn.Sigmoid()和torch.nn.functional.sigmoid()三者,虽然功能相同,但在模型训练中使用场景有所不同。torch.sigmoid()直接调用,torch.nn.Sigmoid()作为类在模型初始化时使用,torch.nn.functional.sigmoid()则可在正向传播中直接应用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2729

2729

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?