文章目录

一、SVC的重要属性补充

#属性n_support_:调用每个类别下的支持向量的数目

clf_proba.n_support_

#属性coef_:每个特征的重要性,这个系数仅仅适合于线性核

clf_proba.coef_

#属性intercept_:查看生成的决策边界的截距

clf_proba.intercept_

#属性dual_coef_:查看生成的拉格朗日乘数

clf_proba.dual_coef_

clf_proba.dual_coef_.shape

#注意到这个属性的结构了吗?来看看查看支持向量的属性

clf_proba.support_vectors_

clf_proba.support_vectors_.shape

#注意到dual_coef_中生成的拉格朗日乘数的数目和我们的支持向量的数目一致

#注意到KKT条件的条件中的第五条,所有非支持向量会让拉格朗日乘数为0

#所以拉格朗日乘数的数目和支持向量的数目是一致的

#注意,此情况仅仅在二分类中适用!

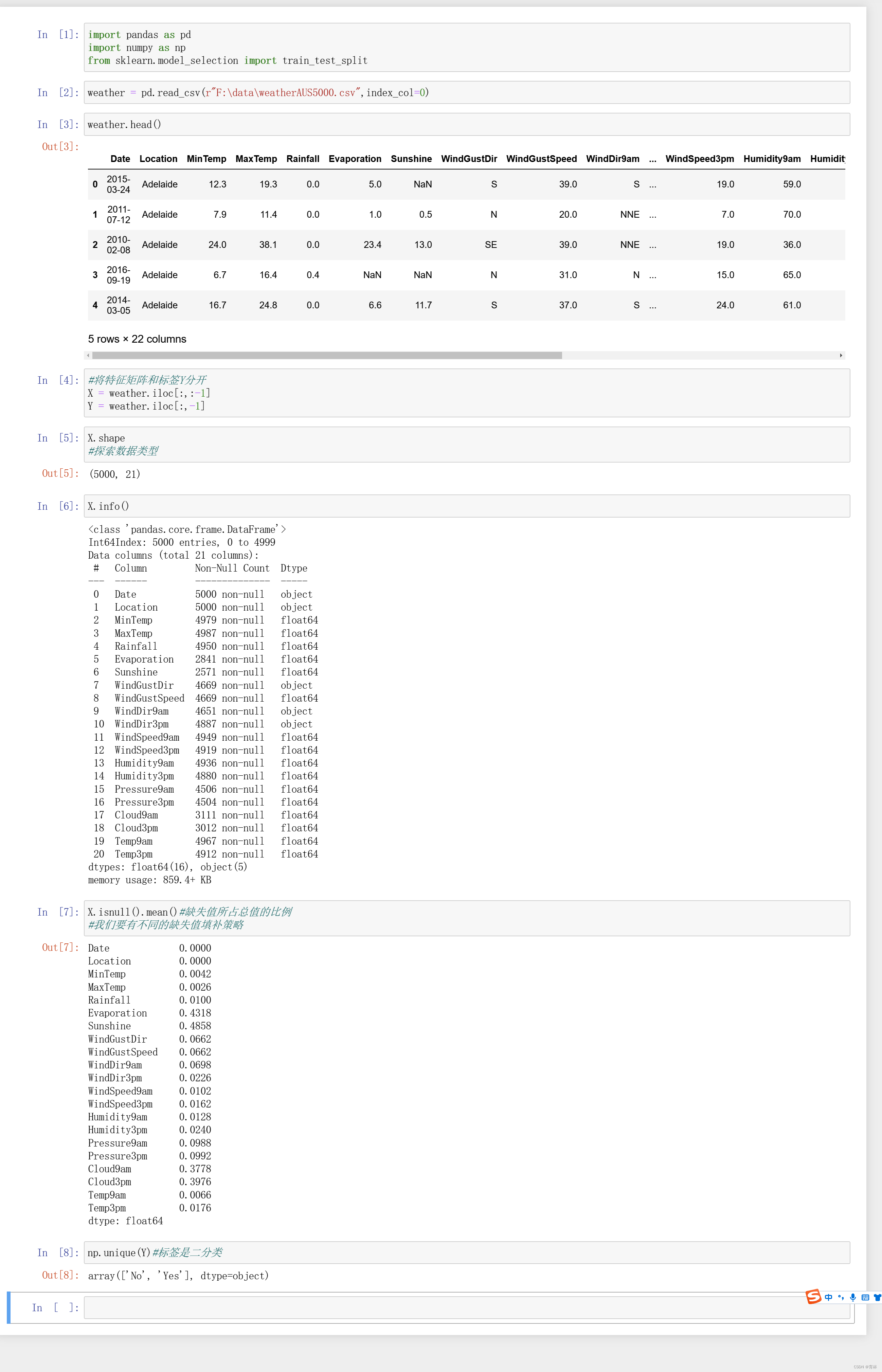

二、案例:导库导数据,探索特征

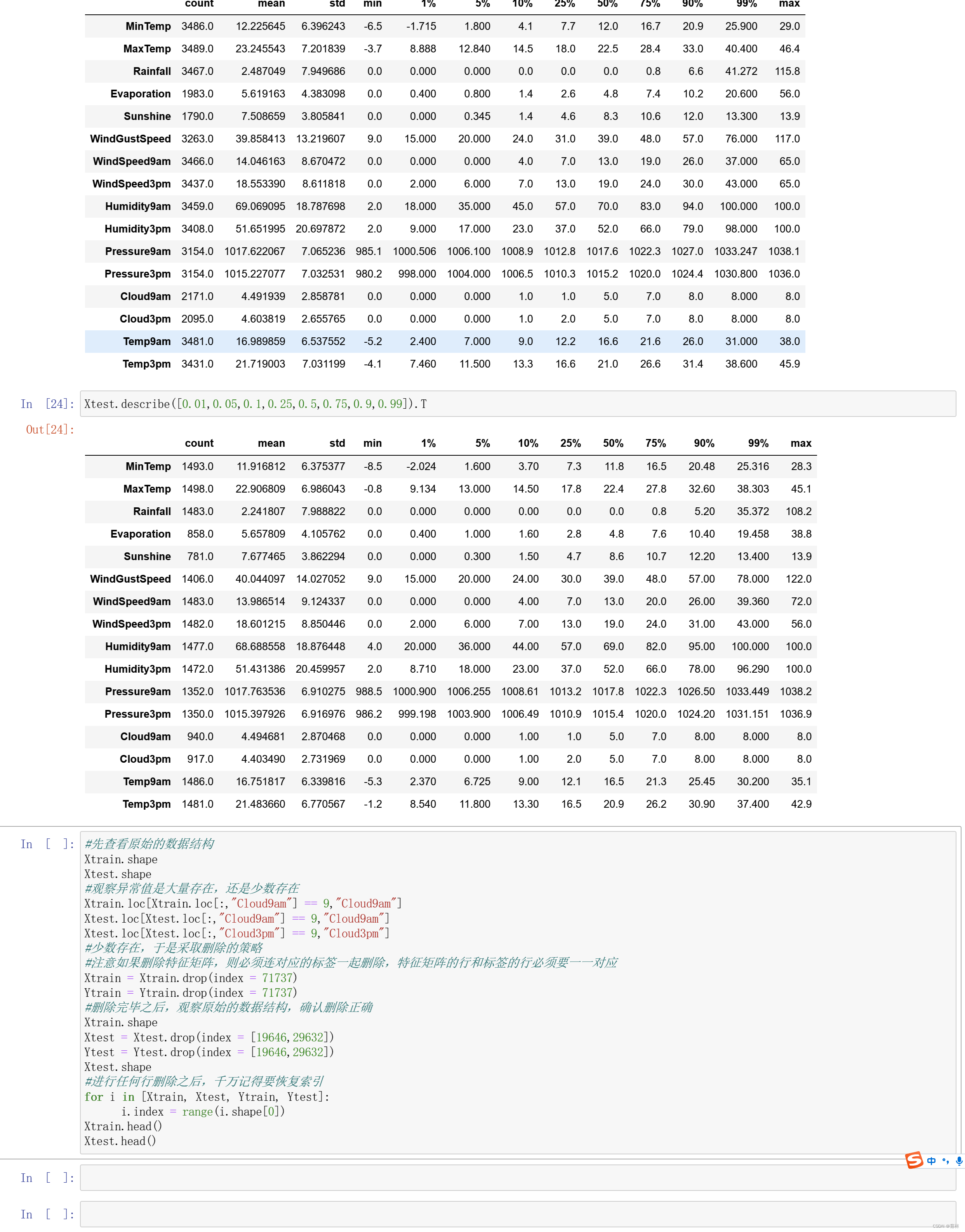

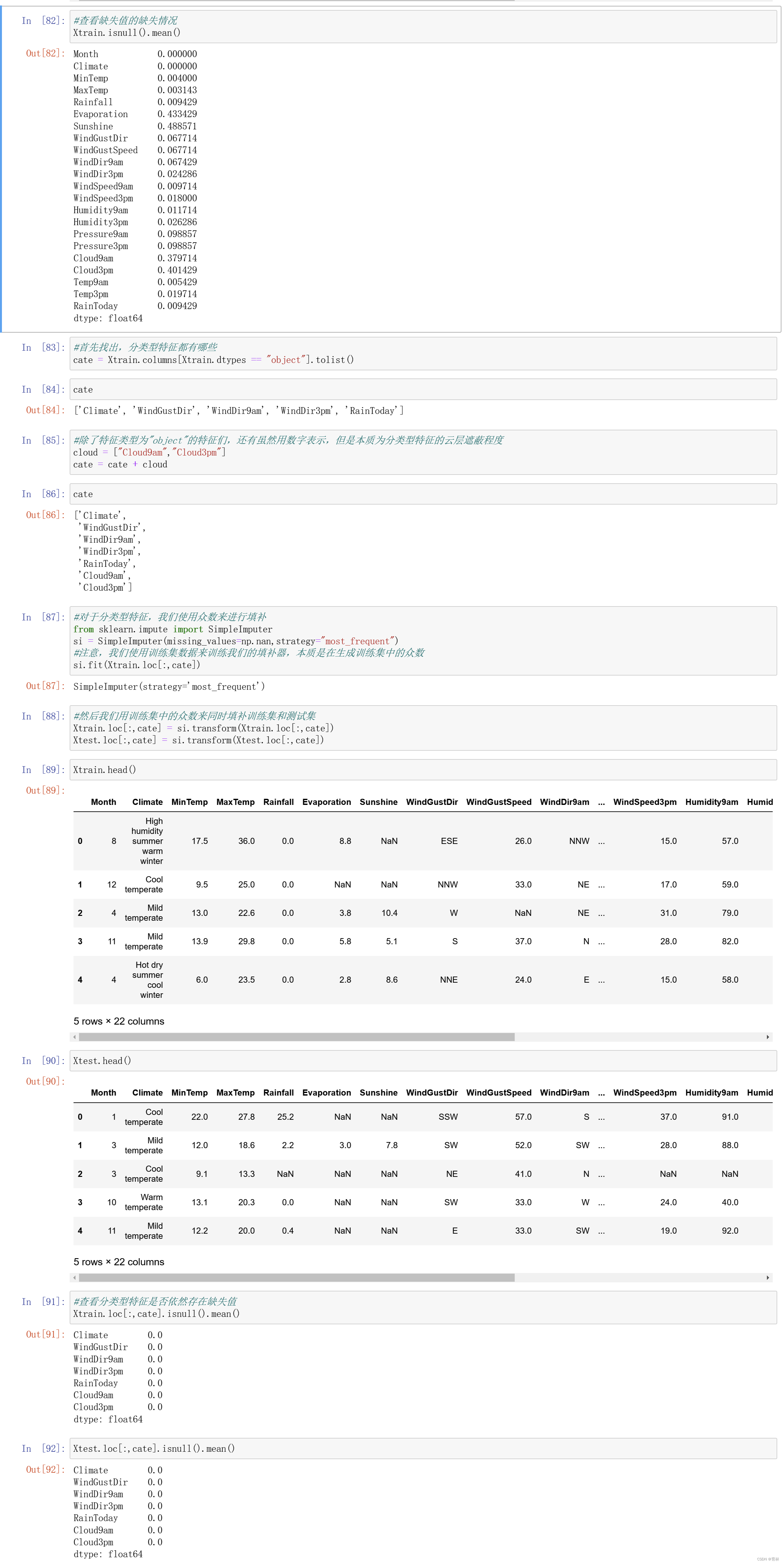

三、开始处理特征矩阵

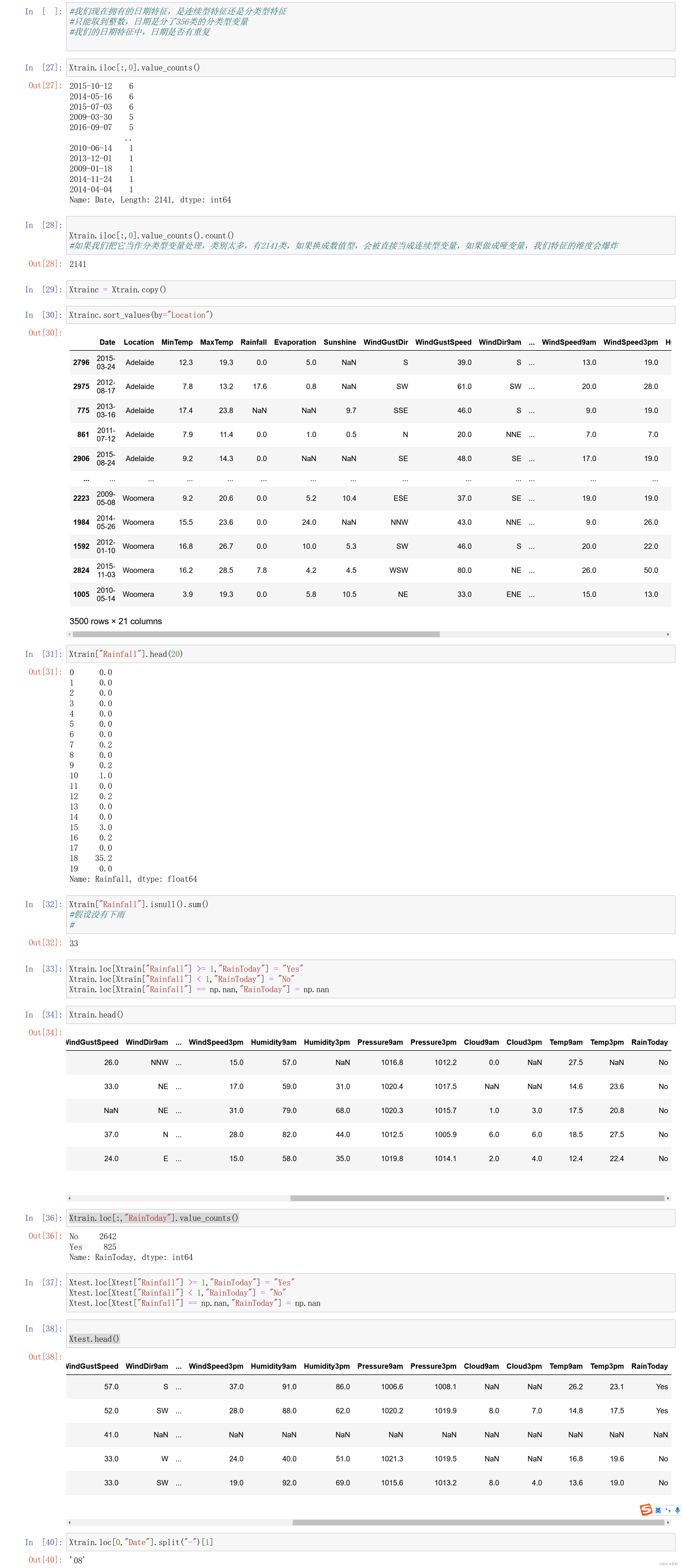

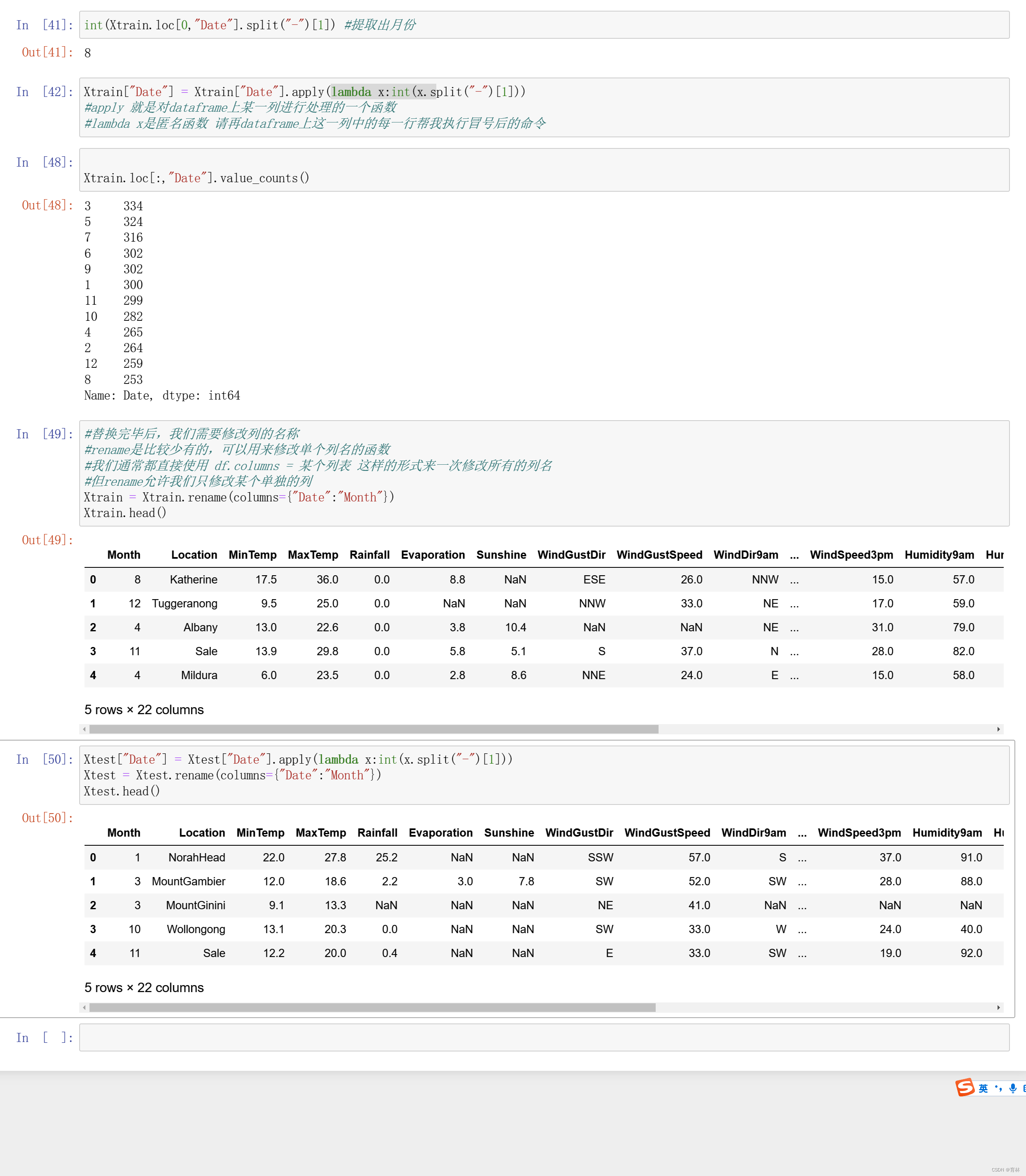

处理困难特征:日期

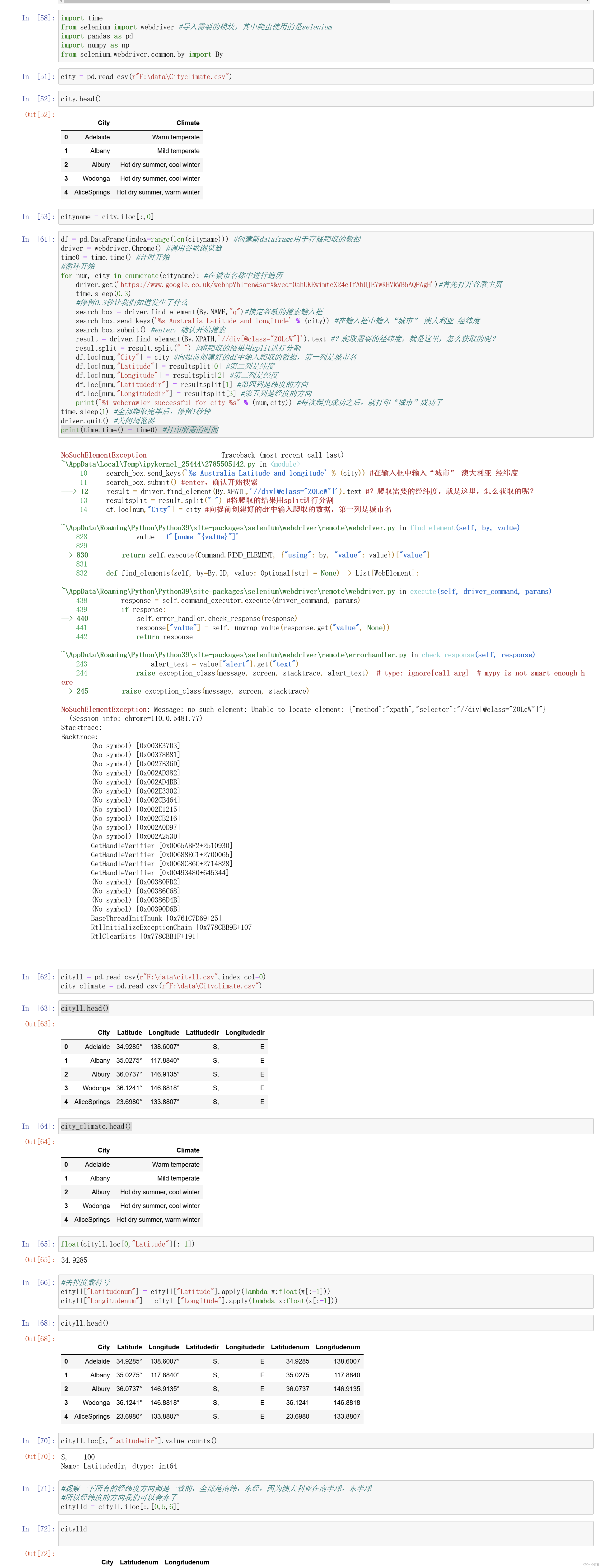

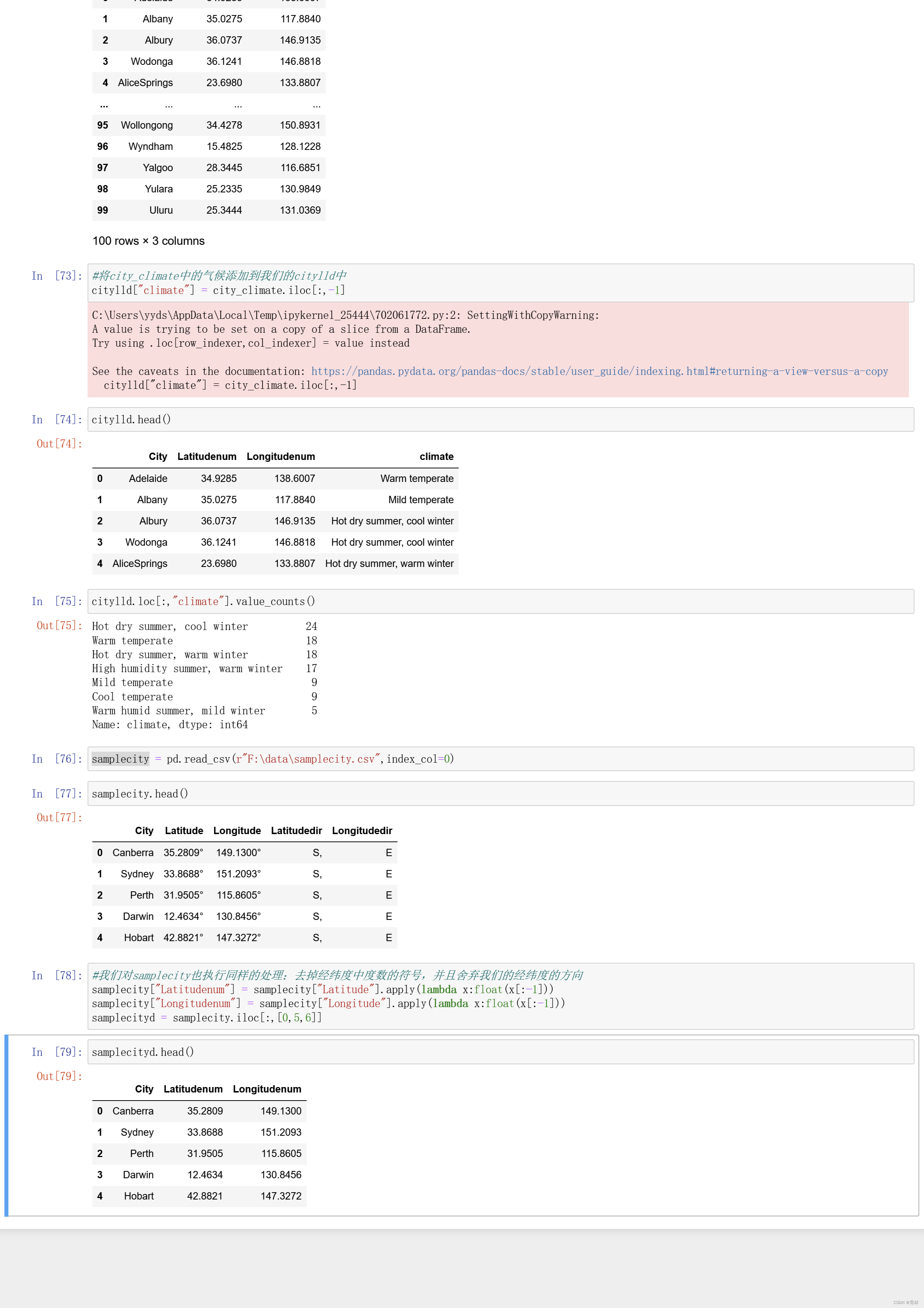

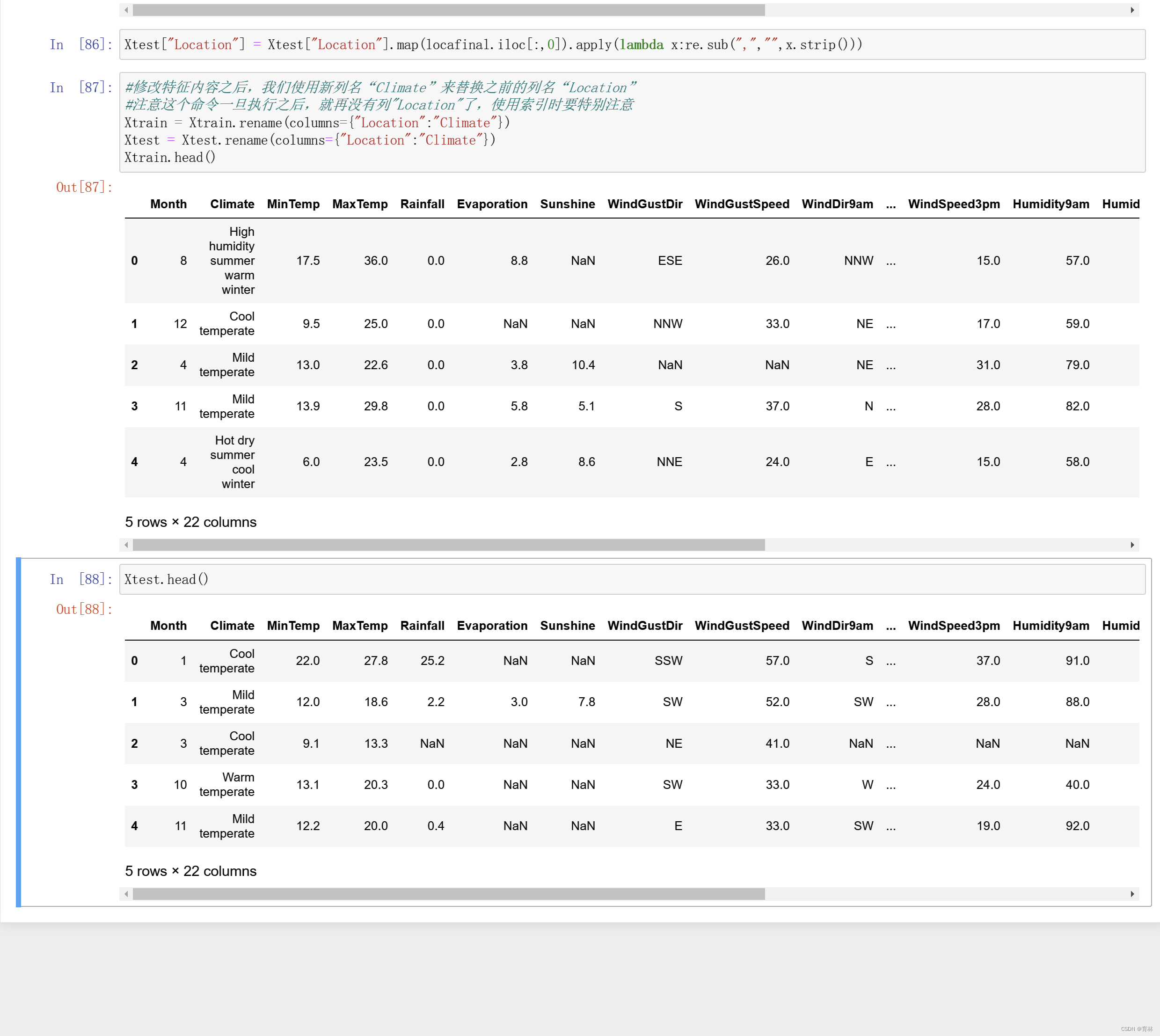

处理困难特征:地点

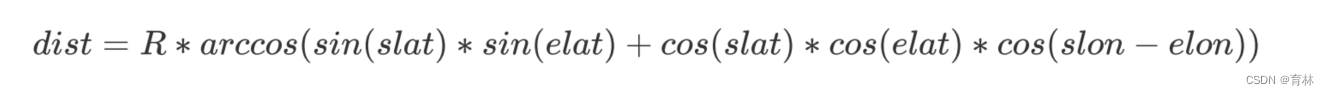

在地理上,两个地点之间的距离,由如下公式来进行计算:

其中R是地球的半径,6371.01km,arccos是三角反余弦函数,slat是起始地点的纬度,slon是起始地点的经度,elat是结束地点的纬度,elon是结束地点的经度。本质还是计算两点之间的距离。而我们爬取的经纬度,本质其实是角度,所以需要用各种三角函数和弧度公式将角度转换成距离。

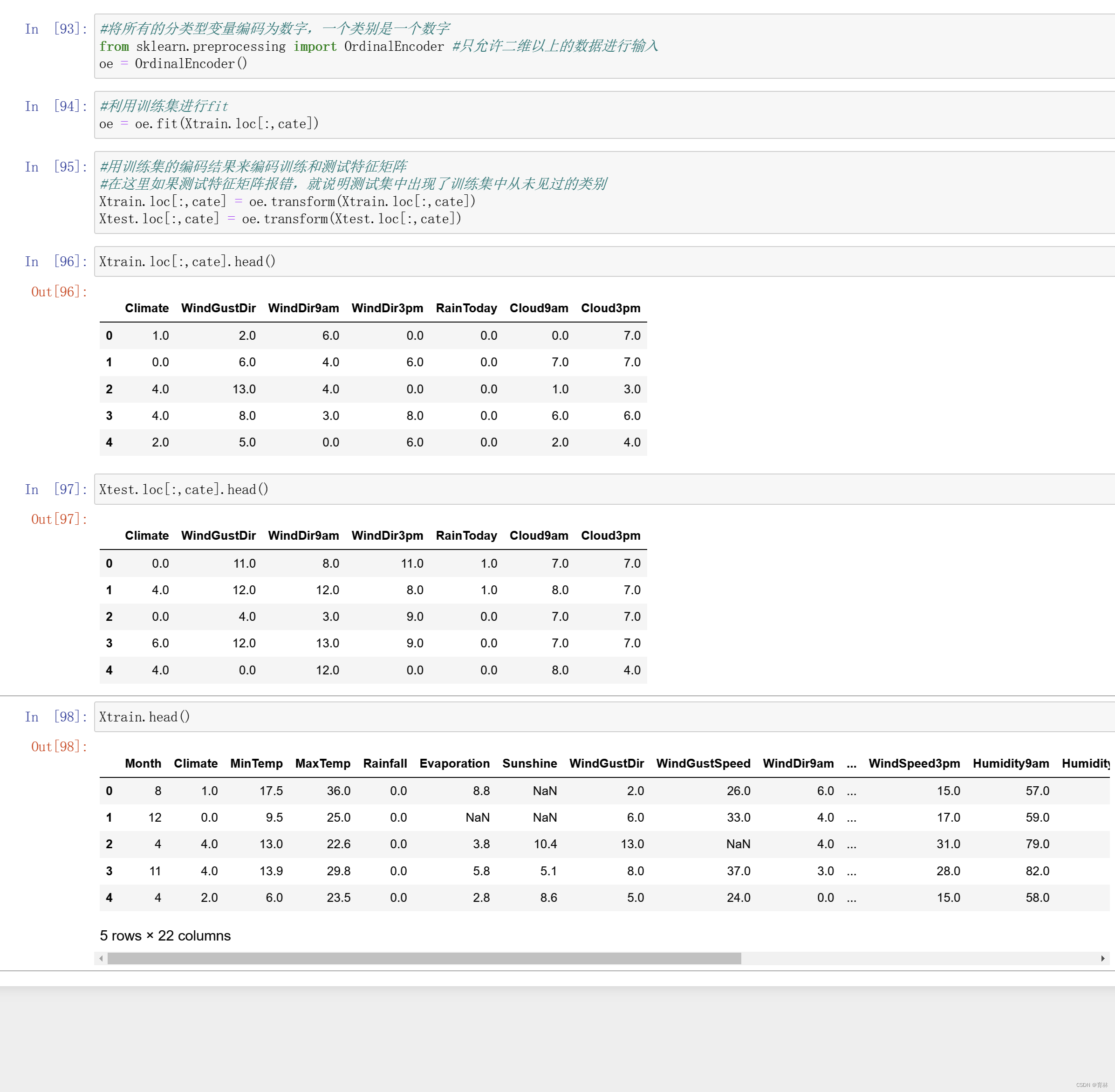

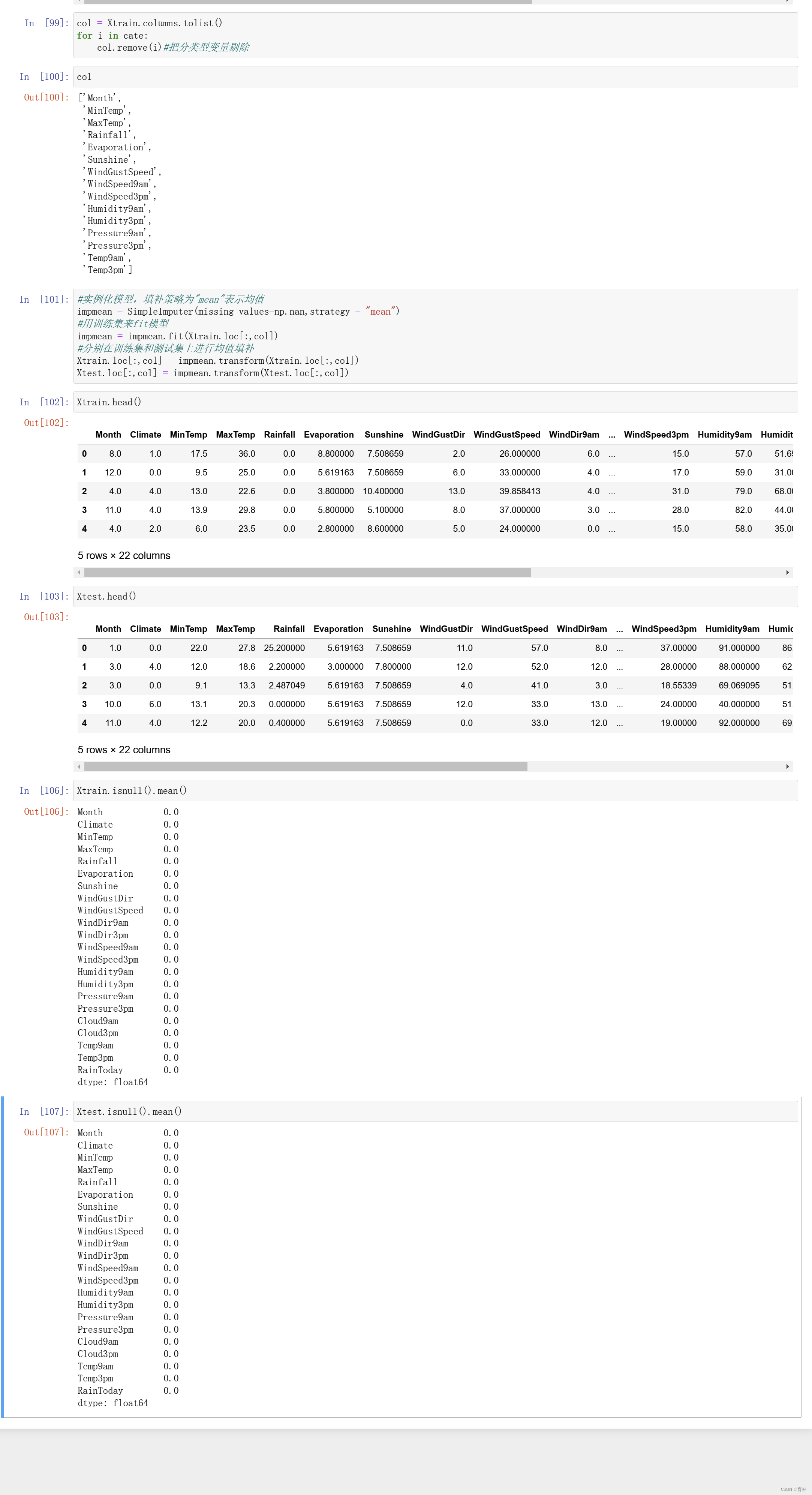

四、 编码

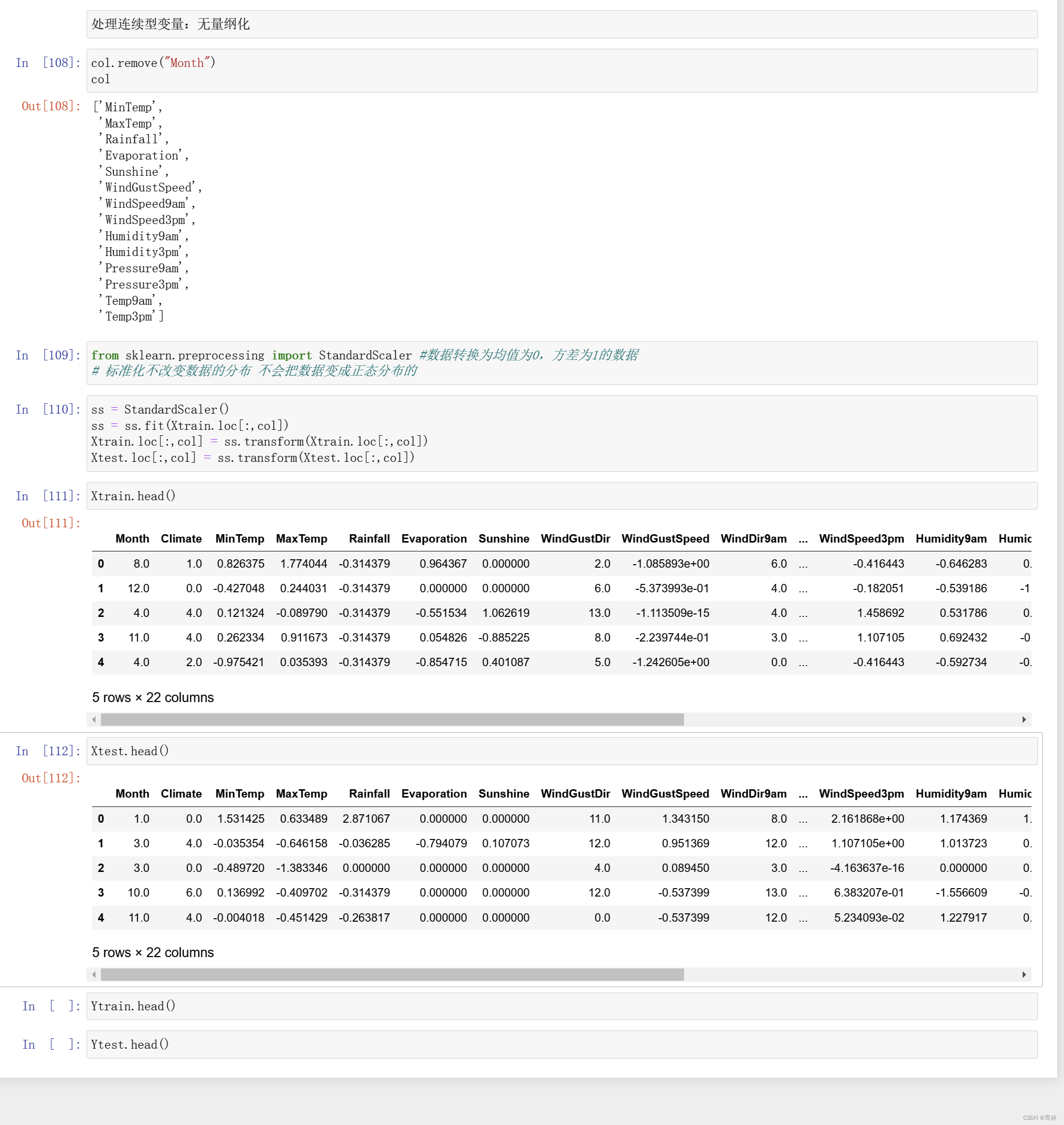

无量纲化

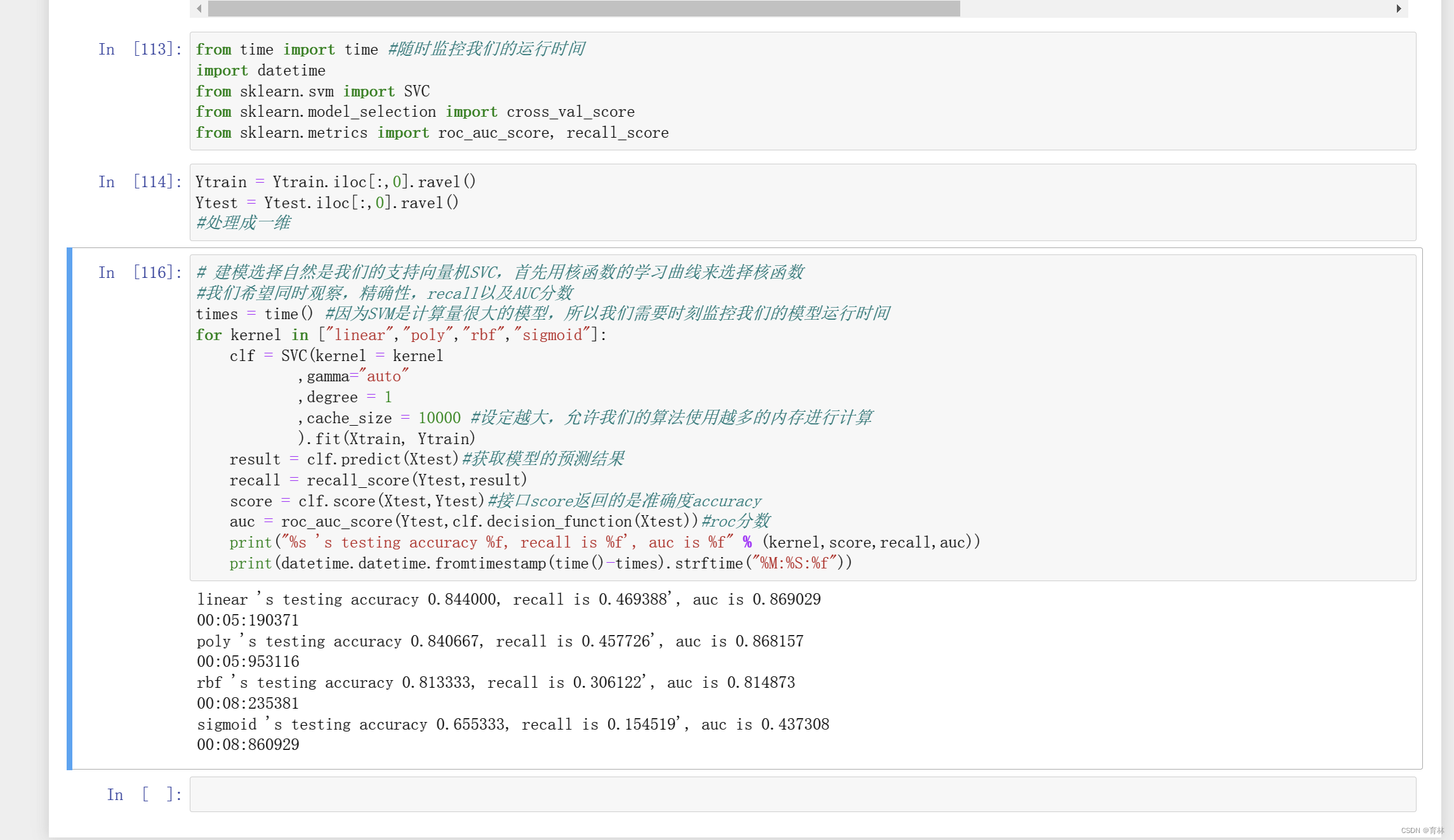

五、建模与评估

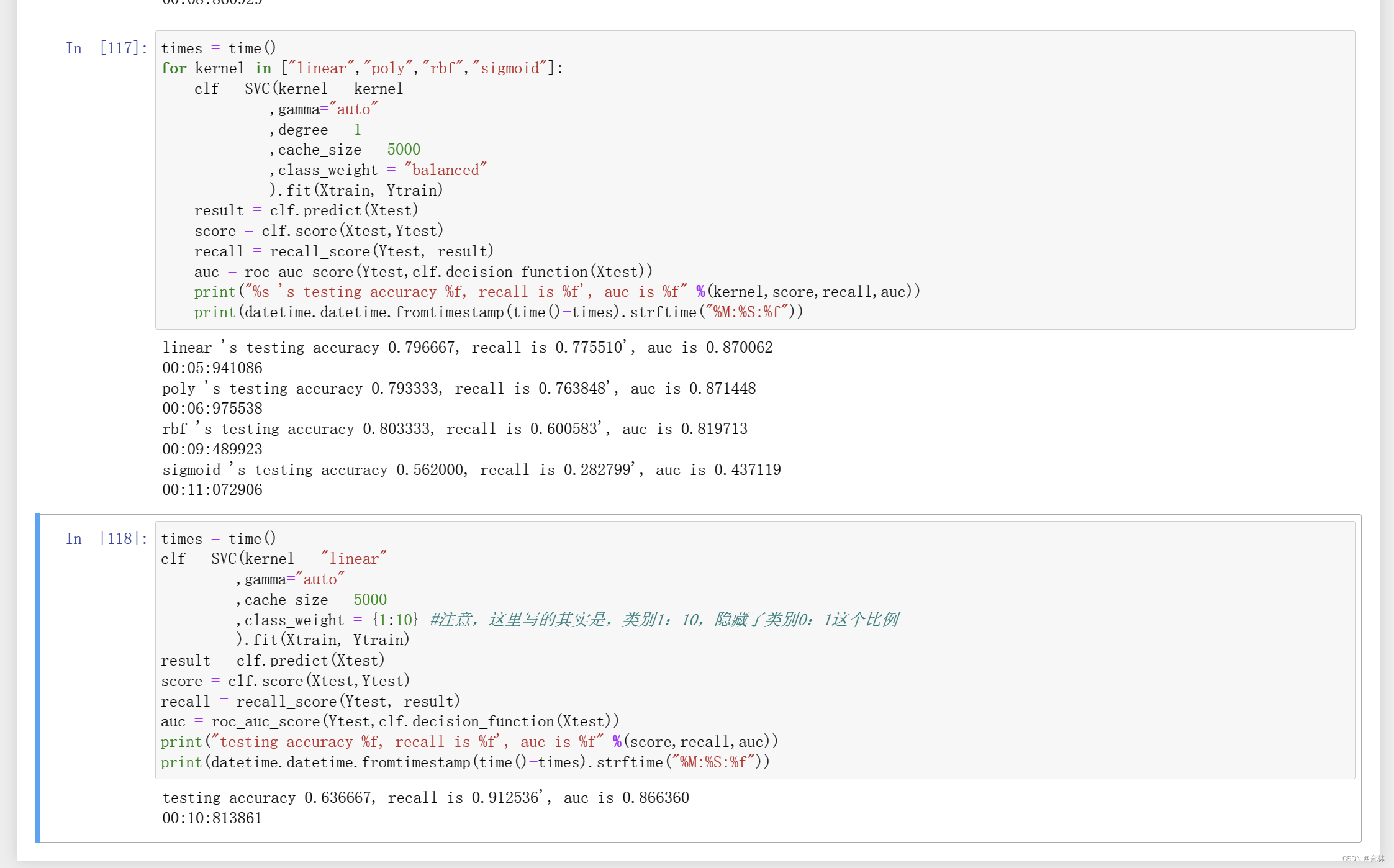

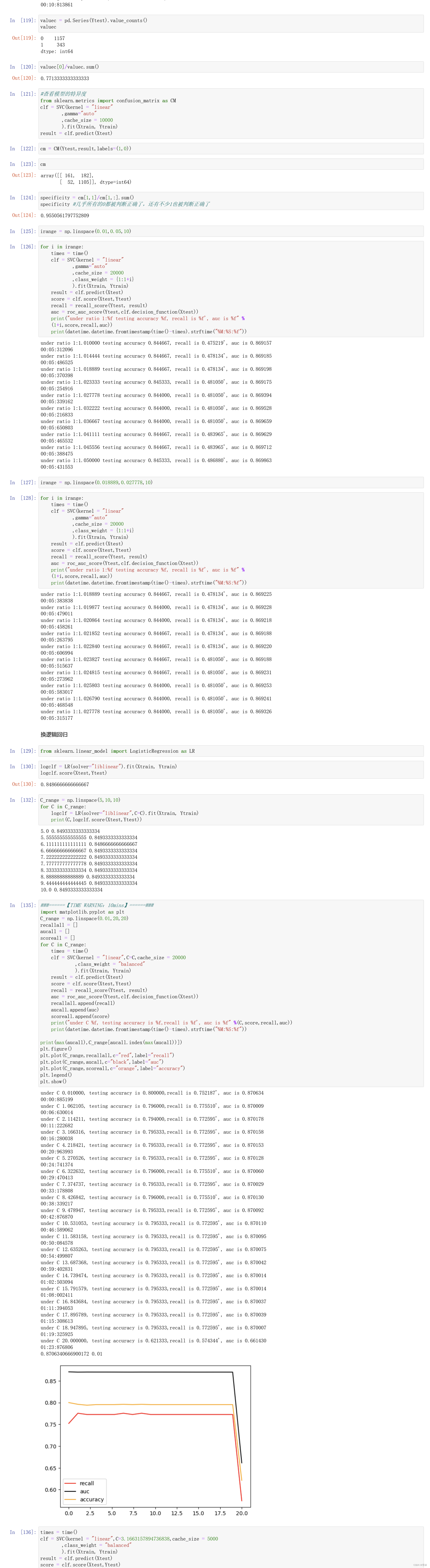

最求最高recall进行调参

在锁定了线性核函数之后,甚至可以将class_weight调节得更加倾向于少数类,来不计代价提升recall。

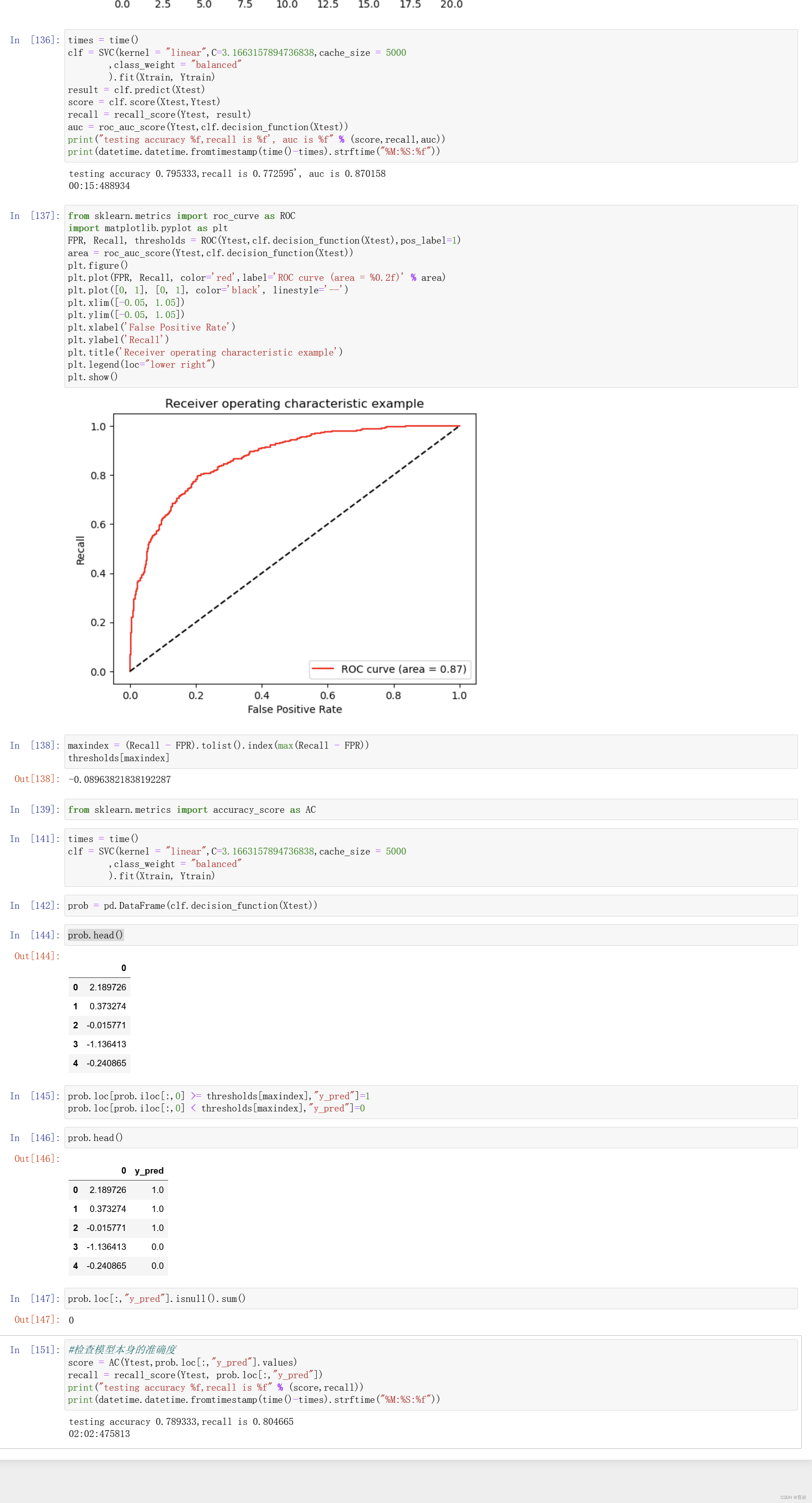

最求最高精确度进行调参

总结

学习了SVM原理,包括决策边界,损失函数,拉格朗日函数,拉格朗日对偶函数,软间隔硬间隔,核函数以及核函数的各种应用。我们了解了SVC类的各种重要参数,属性和接口,其中参数包括软间隔的惩罚系数C,核函数kernel,核函数的相关参数gamma,coef0和degree,解决样本不均衡的参数class_weight,解决多分类问题的参数decision_function_shape,控制概率的参数probability,控制计算内存的参数cache_size,属性主要包括调用支持向量的属性support_vectors_和查看特征重要性的属性coef_。接口中,我们学习了最核心的decision_function。除此之外,我们介绍了分类模型的模型评估指标:混淆矩阵和ROC曲线,还介绍了部分特征工程和数据预处理的思路。

3381

3381

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?