传感器 |免费全文 |在高分辨率无人机光学影像上应用全卷积架构对城市环境中单个树种进行语义分割 (mdpi.com)

2022 sensors

抽象

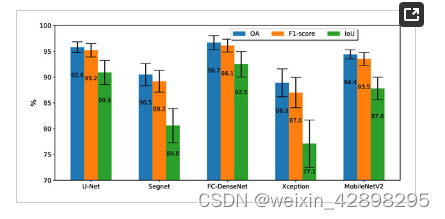

本研究提出并评估了五个深度全卷积网络(FCN),用于单个树种的语义分割:SegNet,U-Net,FC-DenseNet和两个DeepLabv3+变体。FCN设计的性能在分类精度和计算负载方面进行了实验评估。我们还验证了完全连接的条件随机场(CRF)作为后处理步骤以改进分割图的好处。分析是在飞越市区的无人机上的RGB相机捕获的一组图像上进行的。该数据集还包含一个面具,指示一种名为Dipteryx alata Vogel(也称为cumbaru)的濒危物种的出现,作为要识别的物种。实验分析显示了每种设计的有效性,并报告了平均总体准确率范围为88.9%至96.7%,F1得分在87.0%至96.1%之间,IoU为77.1%至92.5%。我们还意识到 CRF 不断提高性能,但计算成本很高。

1 简介

事实上,城市森林是具有独特属性和特点的森林的一个特例。城市森林通常被定义为位于城市地区的木本植被,通常仅限于分布在停车场、花园、小公园和城市道路沿线的单棵和/或成群的树木。它们可能与花坛有关,也可能与草本灌木形成对比[11]。首先,需要高空间分辨率的图像才能将它们区分为单个对象。其次,随着城市化进程的推进,城市树木在环境中受到街道、社区和工厂等城市模式的严重影响[12]。

考虑到无人机平台,Natesan 等人 [29] 提出了树种分类的深度学习框架。在这种方法中,预先描绘的树冠的图像是CNN的输入,将划定的树木分为三类之一:红松,白松和非松。

在过去几年中,发布了用于语义分割的真正端到端FCN架构,例如ScasNet中的全局到本地上下文聚合[37]和DeepLabv3+中的空洞空间金字塔池[38]。

在本文中,我们提出并评估了使用五种最先进的深度学习方法,使用来自无人机的RGB图像在城市环境中对单个树种进行语义分割识别。具体来说,我们专注于识别受威胁物种Dipteryx alata Vogel(也称为cumbaru)的树冠。

这项工作的主要贡献有三个方面:(I)评估深度学习方法在高空间分辨率RGB/UAV图像上分割单个树木的能力;(II)将U-Net、SegNet、FC-DenseNet和Deeplabv3+五种最先进的深度学习语义分割方法与Xception和MobileNetV2骨干网进行比较,用于在上述RGB/UAV图像上分割坎巴鲁树;以及(III)评估使用CRF作为单个树级语义分割的后处理步骤的改进。

2. 材料和方法

2.1. 研究区和数据采集

这项工作中使用的数据集包含巴西南马托格罗索州坎波格兰德市的无人机图像。

2.2. 语义分割方法

在过去的几年中,全卷积网络[33]因其能够以端到端的方式执行基于像素的分类而获得认可[42,43]。在本节中,我们简要描述了这项工作中评估的四种用于树分割的FCN架构:SegNet,U-Net,FC-DenseNet,以及与采用的主干相关的DeepLabv3+的两个变体:Xception和MobileNetV2。最后,我们重新审视了应用条件随机场(CRF)作为后处理技术以改善整体分割结果的想法。

2.2.1. 优网

U-Net具有编码器-解码器架构[34]。编码器是卷积层和最大池化层的堆栈。解码器是一个对称扩展路径,它使用可学习的反卷积滤波器对特征图进行上采样。该网络引入的主要新颖性是如何使用所谓的跳过连接。具体来说,它们允许将转置卷积层的输出与编码器级的对应特征图连接起来[44]。此步骤旨在检索收缩阶段学习的精细特征,以恢复原始输入图像的空间分辨率[34]。

3. 结果和讨论

3.1. 绩效评估

3.2. 可视化分析

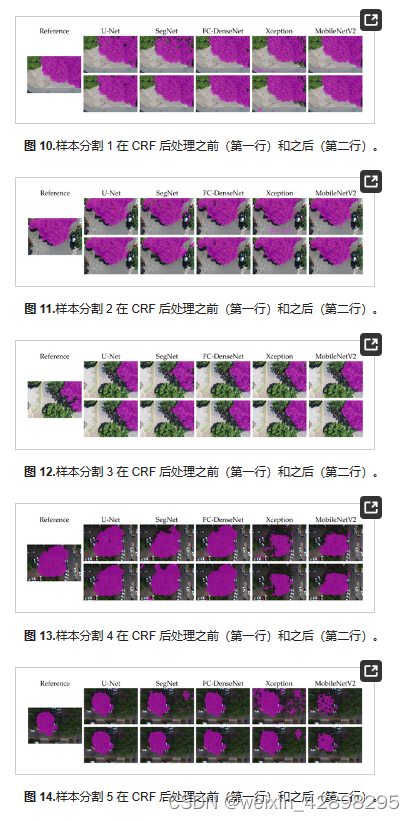

显示了我们数据集的五个样本图像的所有方法的结果。 参考显示在左侧,作为覆盖在输入图像上的地面实况掩码。右边接下来的四列包含每个网络产生的分割,其中上行和下行分别对应于CRF后处理前后的结果。

我们首先在CRF后处理之前分析了结果。与U-Net架构相比,SegNet倾向于在树冠区域产生孔洞。这种效果在图10、图11、图12和图13中尤为明显。图11和图14显示,SegNet在某些图像中也产生了许多误报。通常,它也无法检测到顶篷边缘,如图13所示。

4 结论与研究展望

在这项工作中,我们提出并评估了使用最先进的全卷积网络使用无人机平台获取的高空间分辨率RGB图像对受威胁树种进行语义分割。测试了五种架构:SegNet,U-Net,FC-DenseNet和两个DeepLabv3+变体,特别是Xception和MobileNetV2。该分析是在代表城市环境的数据集上进行的。实验表明,网络可以在监督下学习目标树种的区别特征。这一事实表明,只要有足够的代表性标记样本可用于训练,测试的FCN设计可以描绘其他树种。

在测试网络中,FC-DenseNet在整体准确率、F96得分和IoU方面分别取得了7.96%、1.92%和5.1%的最佳性能。排名第二和第三的是U-Net和DeepLabv3+ MobileNetV2,整体准确率,F1分数和IoU的差异分别为4.1%,7.3%和1.1%,其次是SegNet。DeepLabv3+ Xception的准确率最低,整体准确率为88.9%,F87得分为1.1%,IoU为77.1%。值得注意的是,这是所有评估网络中最复杂的。它包含的可学习参数比性能最好的网络FC-DenseNet多100倍。

DeepLabv3 + Xception是迄今为止要测试的网络中最复杂的。尽管在文献中它被认为是性能最佳的FCN之一,但与所有测试的网络相比,DeepLabv3+ Xception的精度最差。这一发现表明,训练数据不足以正确估计DeepLabv3+ Xception的参数。即使是更简单的MobileNetV2版本,只涉及1/20的可学习参数,在所有实验中都超过了Xception版本。

文章评估了五种深度学习模型(SegNet,U-Net,FC-DenseNet和两种DeepLabv3+变体)在高分辨率无人机RGB图像上对城市环境中单个树种(尤其是濒危物种DipteryxalataVogel)进行语义分割的效果。实验结果显示FC-DenseNet表现最佳,而CRF后处理能提升分割质量但增加计算成本。

文章评估了五种深度学习模型(SegNet,U-Net,FC-DenseNet和两种DeepLabv3+变体)在高分辨率无人机RGB图像上对城市环境中单个树种(尤其是濒危物种DipteryxalataVogel)进行语义分割的效果。实验结果显示FC-DenseNet表现最佳,而CRF后处理能提升分割质量但增加计算成本。

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?