红外图像成像特点:由于红外图像是通过“测量”物体向外辐射的热量而获得的,故与可将光图像相比:分辨率差、对比度低、信噪比低、视觉效果模糊、灰度分布与目标反射特征无线性关系。

红外图像为什么有时候是黑白的,有时候是彩色的?

红外摄像仪得到的是灰度图像,就是黑白报纸上的照片那样的图像。灰度图像经过伪彩色增强,把原图中各像素点的灰度级按照某种映射函数变换成不同的色彩,才得到彩色图像。

红外图像是单通道图像,并不是三通道。我们看的的红外彩色图像实际上是伪彩色,这和我们看到的可见光的彩色还是不同的。

红外和可见光图像融合算法研究是什么?

可见光与红外图像融合(Visible and infrared image fusion)是图像融合领域的一个分支。

其在很多领域都有应用,例如可见光与红外图像融合跟踪(RGB-T tracking)、人脸识别、人耳识别、SLAM、国防领域。

图像融合不是简单的数据叠加,而是对多个图像传感器获得的互补或冗余信息进行集合的过程。它使得新图像满足图像处理中的特征提取、目标识别或分割的需要。因此,图像融合技术被广泛应用于计算机视觉、军事、遥感和医学等领域。

红外图像和可见光图像分别是通过红外成像传感器与可见光成像传感器获得的。由于两种传感器工作原理不同, 性能也就不同。

- 红外图像能较好地反应图像的热目标特性,但对场景亮度变化特征不敏感, 且图像清晰度较低;

- 可见光图像能够较好地反应目标所在的场景细节信息,且清晰度较高。

所以将它们两者的优势结合:

红外和可见光图像融合能有效地综合红外图像目标特征信息和可见光图像的场景细节信息,得到信息更全面的融合图像(利用可见光和红外图像包含互补的信息) 。

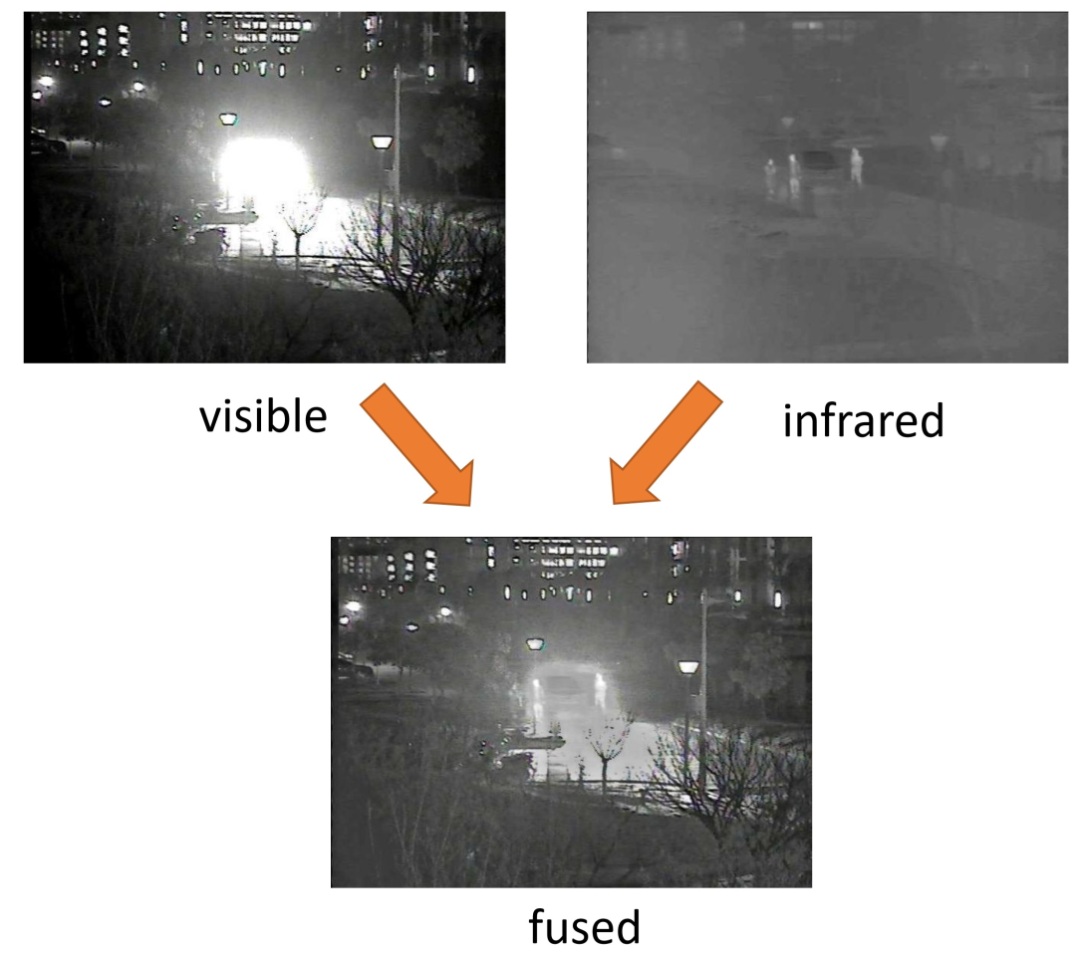

可见光图像容易受光照影响但包含很多细节信息,而红外图像不易受光照影响但是缺乏细节信息。下图展示了一个可见光与红外图像融合的例子。

从方法上来讲,传统的图像融合方法主要包含基于空间域的和基于变换域的方法:

- 基于空间域的方法是指直接在空间域对源图像进行操作从而得到融合图像的方法,主要包含基于像素的(pixel-based)、基于块的(block-based)和基于区域(region-based)的方法。

- 基于变换域的方法是指首先将源图像变换到某个变换域,然后在该变换域内进行图像融合(一般以系数的形式),最后再用逆变换得到融合图像的过程。常用的变换包括多尺度变换(例如小波变换)、压缩感知、稀疏表达等。

- 近年来,随着深度学习的发展,深度学习技术也被引入到了可见光与红外图像融合领域。包括CNN,GAN,AutoEncoder等在内的一些深度学习模型被应用到了可见光与红外图像融合领域,并“取得了不错的效果”。

因此,目前的图像融合方法主要有三种:基于空间域的方法、基于变换域的方法、基于深度学习的方法。

相关链接:

然后我看到知乎这个人一直在学习相关的融合技术,或许可以在它的博客看到相关的技术:奥本海默 - 知乎

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?