摘要:特征选择是数据挖掘与机器学习中一种至关重要的预处理技术,并受到越来越多的关注。然而,现有方法的相关性只包含有限的信息。为提高基于过滤式和信息论的特征选择方法的分类能力,减少所选子集的冗余,提出了一种基于相关-冗余权重的特征准则FSRRW。在这篇论文中,构造了特征相关-冗余权重RRW来提取重要的相关与冗余信息。然后,基于权重定义了一种新的特征相关性,包含了来自动态变化特征的更全面的信息。此外,通过最大化特征相关性以及最小化特征冗余提出了一个特征评价标准。所提出的算法和七种比较方法在20个基准数据集上进行了测试,大量实验表明,该准则具有较好的特征筛选能力,可以有效促进分类,且具有较好的适用性和鲁棒性。

关键词:信息论、特征选择、特征相关-冗余权重、特征相关性

1 引言

特征选择通过消除不相关或冗余的特征来保留特征数量最少且相关性最强的特征子集。面对数据分析中“维度诅咒”和计算成本过高的挑战,特征选择可以有效缓解上述问题。因此,特征选择已被证明是一项重要的数据预处理技术,并广泛应用于入侵检测、医学检测、有源电力滤波器、金融等领域。其中,高维和小样本数据集是经常面临的问题。因此,分类器很容易出现“过拟合”、效率低下以及分类准确率低的结果,分析高维数据集的核心特征并有效提高数据分析性能成为一个重要的课题。

特征选择方法主要可以分为三类:过滤式、包裹式和嵌入式。过滤式方法根据一些评估标准对特征进行评分,如相似性、一致性和稀疏性。此外,贡献值按降序排序,有影响力的特征会被依次选择直到达到所需数量或者特定阈值。最后,将选择的特征子集与特定的分类器进行整合。包裹式方法采用分类器训练结果作为目标函数来评价所选特征子集。两个目标函数依赖于最小化所选特征子集的大小,同时最大化分类精度。在嵌入式方法中,特征选择被集成到模型训练过程中,以同步获得训练好的模型和选择的特征。其中,过滤式方法高效且简单,尤其是对于高维数据集。但是过滤式方法容易受到特征评价标准的影响,增加所选子集的冗余度,降低所选算法的执行效率。因此,寻找合适的特征评价标准是基于过滤式特征选择算法的核心研究主题。

基于过滤式的特征选择方法评估特征和类之间的线性或非线性相关性。Lopez(2021)设计了一种源自Relieff的分布式特征加权算法,有效解决了传统算法在输入大规模样本时的缺陷。近年来,有关信息论衍生的特征选择算法的研究被提出并进一步改进。例如,Gao和Wu(2020)设计了一种基于互信息的相关分配和特征选择方法RAFS。RAFS将子集冗余度作为关联评价指标,估计每个特征的贡献分数。除此之外,为了解决冗余特征和变化的类标签之间的不平衡问题,提出了一种新的评价标准MR-MNCI。Zhang和Gao(2020)定义了考虑动态变化类的不确定性变化率,并引入了一种新的特征选择算法UCRFS。与以往的评价标准不同,PSSD关注最新选择的特征来构建特征评价标准,从而提高方法的效率。众所周知,在高维数据集中,多特征交互有可能与类标签强相关而单个候选特征通常与类标签弱相关。因此,评价标准很有必要考虑特征交互。为了解决上述问题,Zhou(2021)提出了一种基于在线流组特征的特征选择方法,通过线组内和线组之间的信息交换,将交互特征添加到选择的子集中。总之,基于信息论的特征评价标准主要关注特征相关性、交互性以及冗余度。值得注意的是,利用信息论构建一个考虑这三个属性的特征评价标准已经成为基于过滤式的特征选择方法中极其重要的挑战。

基于信息论的传统特征选择算法仅利用互信息或条件互信息来定义相关术语,因此相关信息不足。为了解决上述问题,本文构造了一个特征相关-冗余权重RRW来定义特征相关性。这个定义增强了相关信息,然后提出一种基于RRW的特征评价标准。主要的贡献如下:

- 设计了特征相关-冗余权重RRW。RRW获得联合互信息提供的相关性,同时根据条件互信息测量冗余项。

- 定义了特征相关性。几个条件互信息提供了一个新的特征相关性的定义。这个定义可以避免选择劣质的候选特征。

- 构建了特征评价标准。通过最大化特征相关性和最小化特征冗余来实现基于相关-冗余权重的特征准则FSRRW。

- 对提出的标准进行了实验测试。三个分类器在20个数据集上进行了七次比较。采用平均分类准确度和AUC作为分类评价指标。

本文的其余部分安排如下。第2部分回顾了基于过滤式和信息论的特征选择方法。基于相关-冗余权重的特征标准在第3部分中定义。在第4部分,设计实验证明本文提出标准的有效性。第5部分展示了实验讨论,第6部分提供了结果与未来工作方向。

2 相关工作

在数据分析和机器学习中,预处理可以解决分类精度低、过拟合和计算复杂度高的问题。基于过滤式和信息论的特征选择可以以较高的运算效率去除冗余特征,实现高维数据的有效降维。这部分回顾了几种基于过滤式和信息论的特征选择方法。

假设和

是两个随机离散变量,分别代表一个候选特征和一个已选择的特征。

是选择的特征子集,

表示关联的类。

用来评估

的贡献,获得最佳分数的特征将被选择到所选子集中。

是一个取值范围为

的参数。

Battiti(1994)应用互信息定义相关项和冗余项,然后提出互信息特征选择器MIFS。结合贪心策略,MIFS选择几个相关的特征组成选择的特征子集。其对应的表达式可以表示为:

Kwak和Choi(2002)认为如上等式特征冗余的权重过高,因此提出了一个信息分布均匀的MIFS,MIFS-U。在相同复杂度下,该方法利用均匀分布的信息有效提高了学习模型的准确性。MIFS-U被描述为:

此外,Hoque, Bhattacharyya和Kalita(2014)提出了MIFS-ND,它集成了非支配排序遗传算法NSGA-II来选择优势值和劣势值差异最大的特征。它阐述了特征-类和特征-特征互信息之间优势特征的数量。其对应的函数表示为:

Peng, Long和Ding(2015)发现MIFS只有在面对小规模的选定子集时才能发挥关键作用。随着所选特征数量的不断增加,知道接近原始特征子集的大小,冗余项迅速增加且被错误评价。它不适合获取更多的特征。因此,通过重置MIFS的参数制定了最小冗余最大相关性mRMR标准。

CIFE(Lin和Tang, 2006) 引入了类-相关冗余的概念来反映类相关性和冗余的复合效应。CIFE通过忽略高阶交互来降低计算复杂性。其对应的表达式为:

Yang和Moody(1999)通过最大化联合互信息JMI扩展特征相关性所涵盖的信息来筛选特征子集。JMI表示为:

然而,JMI低估了某些特征的重要性,这增加了所选子集的冗余度。例如,如果一个候选特征与某些已选择的特征有很强的相关性,而与其余特征有很大的独立性,那么这个候选特征仍然会获得低分。因此,Bennasar, Hicks和Setchi(2015)制定了联合互信息最大化JMIM来避免上述问题。同时,由于候选子集和选择子集之间的巨大差异,JMIM会导致信息不平衡。此外,考虑候选子集和所选子集之间的对称相关性级别,归一化联合互信息最大化NJMIM被提出。

Wang, Wei, Yang和Wang(2017)描述MRI为采用独立的分类信息来平衡新信息和候选特征产生的冗余之间的关系。MRI进一步发现了提供更多信息和更少冗余的潜在特征。这被表示为:

Gao, Hu和Zhang(2018a)发现所选特征提供的分类信息时动态变化的。DCFS将传统的特征相关性评价从互信息转变为条件互信息。其数学模型表示为:

Wang, Jiang和Jiang(2021)构建了“最大值中的最大值”特征评价标准,目标是有效识别出交互特征。其对应的表达式是:

Gu, Guo, Li和Xiao(2021)通过考虑特征对称不确定性并将交互特征集成到特征评价标准中,重新定义了特征相关性和冗余。因此提出了冗余分析和基于交互权重的特征选择RAIW。Zhang, Gao, Hu和Li(2021)设计了基于条件权重的联合相关性CWJR来消除联合互信息中的冗余。CWJR如公式10所示。此外,该算法总结了现有的信息论特征选择算法,并将其分为线性和非线性评价标准。

上述大部分特征选择方法通过互信息、条件互信息或联合互信息分别定义特征相关性和冗余。具有相似作用的特征很难被区分,所选特征子集会具有较高的冗余度。因此,通过分析特征相关性的定义,构建一个新的特征评价标准,可以有效提高分类识别能力。

3 基于相关-冗余权重的特征标准

3.1 条件和联合互信息分析

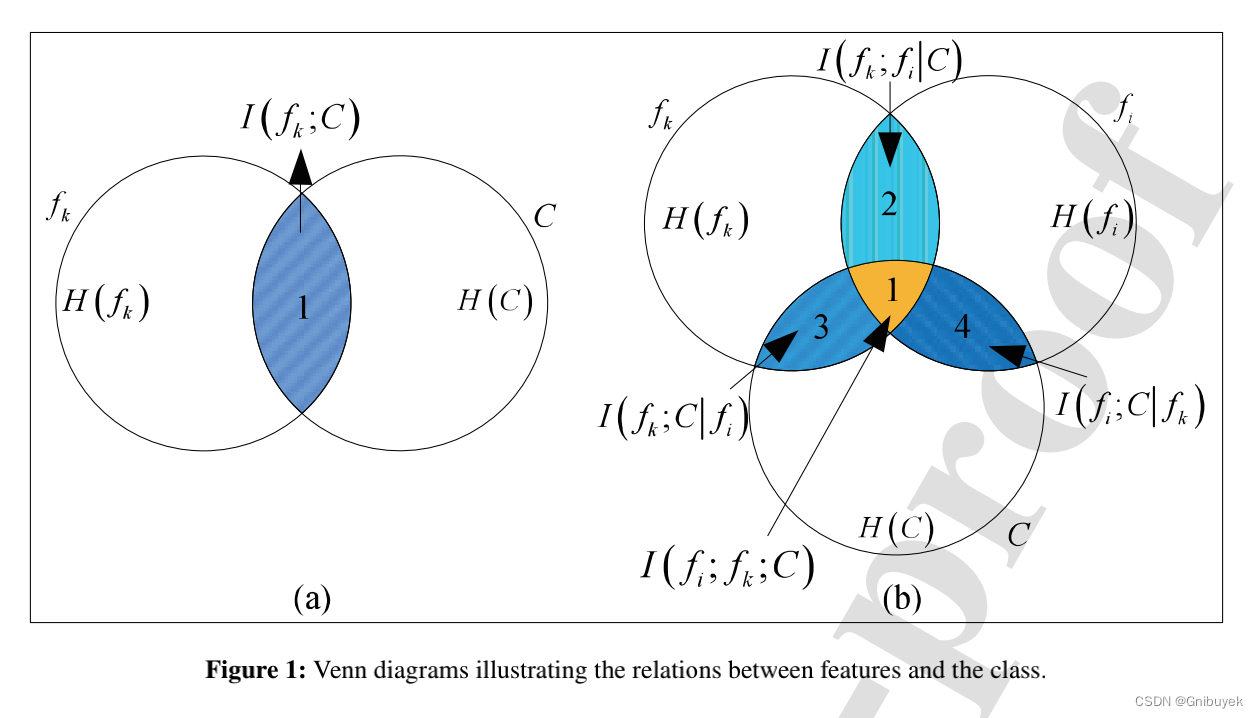

过滤式特征选择方法通常使用前向搜索策略选择最佳特征子集。在图1(a)中,区域1表示两个随机变量的互信息。如果一个随机变量被设置为类,另一个被设置为初始子集,则获得该类最大互信息的特征为第一个被选择的特征。

选择最优特征时,需要考虑候选特征、已选特征和类别之间的特征关系。图1(b)展示了不同区域包含的信息。区域1是由候选特征、已选特征和类标签共同提供的交互信息。交互值可以取正、负或零,分别对应组合信息的扩大、减小或稳定。候选特征和已选特征(区域1和2)计算出的互信息不是完全表示冗余,而是交互(区域1)和冗余(区域2)的复合。因此,选择来衡量冗余的权重。当确定好选择的特征后,从候选特征中获得的类信息为条件互信息(区域3)。同样,在考虑候选特征时,所选特征提供的类信息为

(区域4)。区域1,3和4的组合即为联合互信息

,这可以综合考虑所选子集动态变化时的相关性和交互性。

基于以上分析,利用条件互信息和联合互信息构造一个相关-冗余权重。然后,基于该权重定义特征相关性,并构造一种新的特征评价标准。

3.2 特征相关-冗余权重

本节构建了特征相关-冗余权重,然后基于相关-冗余权重定义了特征相关性和特征评价标准。

定义1 特征相关-冗余权重 RRW

特征相关-冗余权重用来区分具有相似作用的特征,其对应的表达式是:

在

的范围内。

表示候选特征和类相关性低但冗余程度大。

表示当前特征与类相关性较高。即

越接近2,当前候选特征被选择的可能性就越大。每个构建过程都考虑类所选所选特征、候选特征和类别的复合,这有利于关键特征的识别,从而提高分类性能。

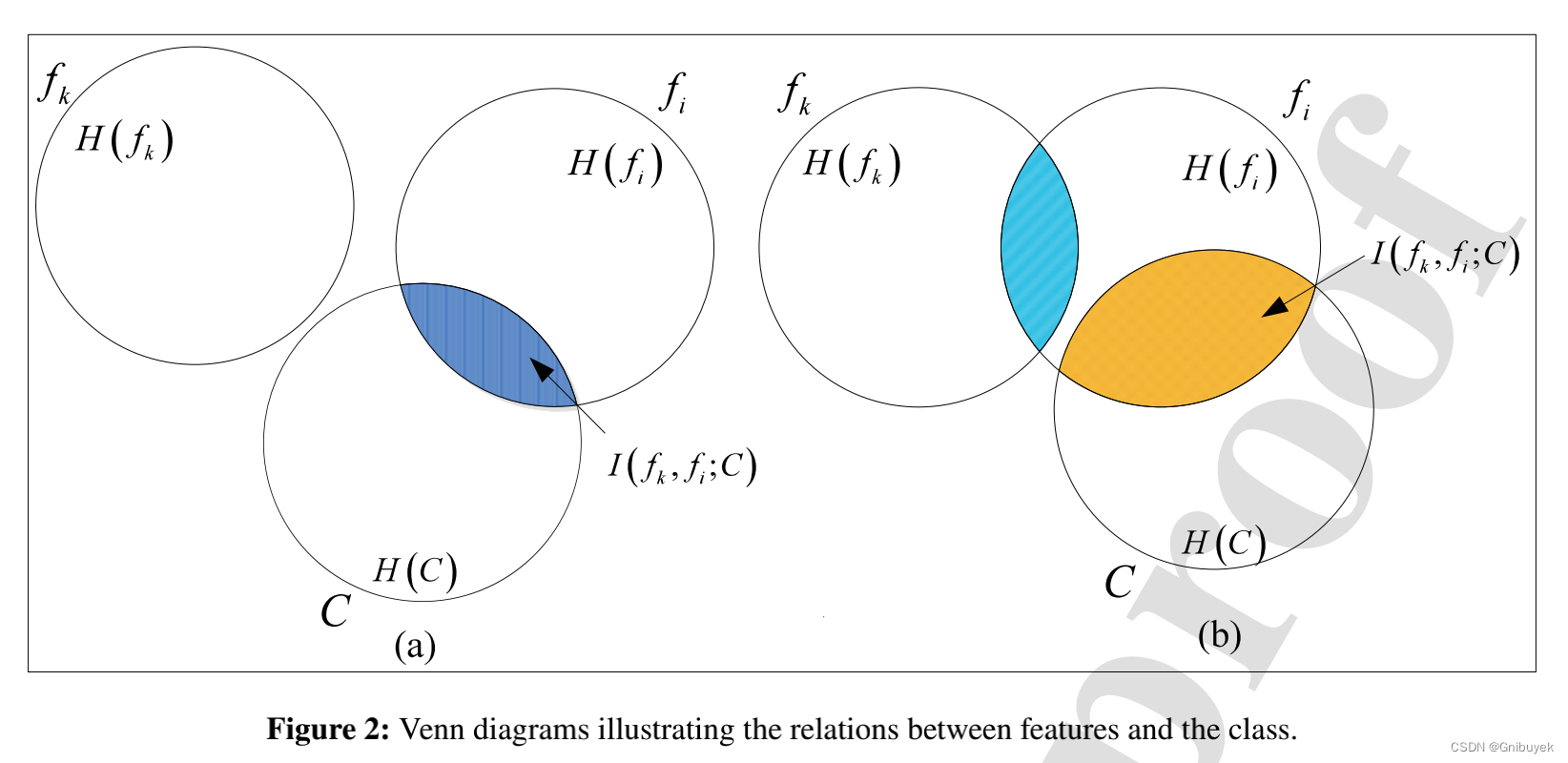

第一个选择的特征与类的相关性最大,因此选择的子集具有很强的相关性。随后的选择还应该保持候选特征和类标签之间的强相关性。尽管如此,候选特征和高维数据集中的类别之间不可避免会没有相关性。因此,如果选择特征和候选特征之间没有冗余(图2(a))或低冗余(图2(b)),当前候选特征的得分仍然会很高,从而导致错误的选择。因此,提出了一种新的特征相关性的定义。

定义2 特征相关性 FR

特征相关性是用于评估两个特征之间相关性的度量方法,可以描述为:

所提出的相关性的概念由于其新的权重而具有更好的特征自己搜索能力。同时,采用条件互信息解决了(图2)权重的特殊问题。在定义特征评价标准之前,对与其他算法相比在定义方面表现更好进行了解释。

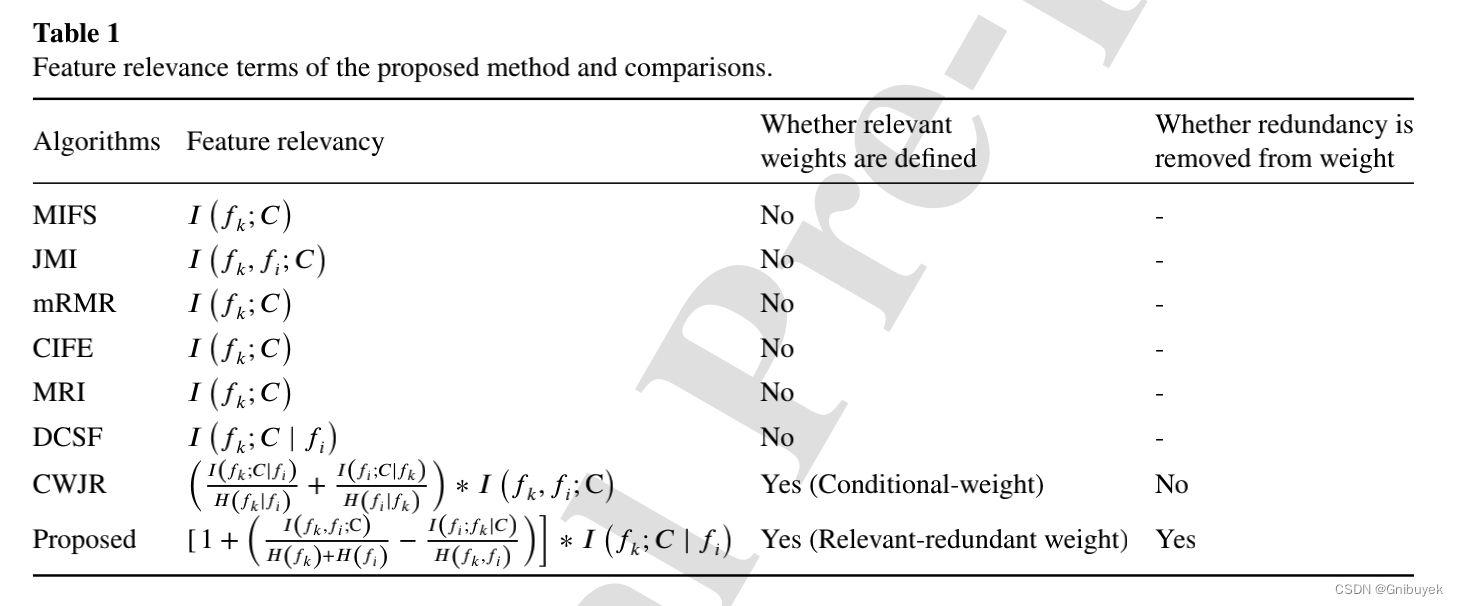

表1总结了所提出方法和比较算法的相关性的定义。在MIFS、mRMR、CIFE和MRI中,相关性的定义只考虑候选特征和类别的联系。DCSF考虑了所选特征分类中的动态信息变化。这些方法主要关注特征与类之间的相关性,当发生特征交互时会导致重要特征的丢失。CWJR和JMI使用联合互信息来评估特征相关性,包括特征交互。但是,由于联合互信息,JMI可能会导致冗余。其中CWJR采用条件权重从联合互信息中获取分类信息。尽管该方法试图减少联合互信息中的冗余,但在一定程度上仍会造成冗余选择。因此,FSRRW的相关性被设计为条件互信息。此外,所提出的权重还应用联合互信息来增强变化特征中的交互作用。RRW中条件互信息的冗余项明确了区分边界,并适用于小样本数据集。因此,从RRW得到的特征相关性不仅考虑了特征交互和分类信息,还避免了联合互信息的冗余。相关性是通过集成独特的权重和条件互信息生成的,可以更有效地区分作用相似的特征。因此,该定义用于评价单个特征的贡献。

3.3 提出的方法

这个部分介绍了基于相关-冗余权重的特征评价标准FSRRW。提出的特征评价标准是:

该标准通过最大化特征相关性且最小化特征冗余来评估单个候选特征的贡献。值越大说明候选特征对分类的效果越好。即使在图2所示的情况下,即

,也可以防止权重过大显著影响评分结果。此外,冗余使得最终评估的贡献值更小,导致当前候选特征难以选择。

所提出算法的伪代码如算法1所示,特征选择过程主要如下:首先,FSRRW初始化选择特征子集,选择特征数量

和贡献值

(第1-3行)。其次,计算每个候选特征

和类

之间的互信息。具有最大互信息的特征被添加到选择的数据集

中(第5-6行)。此外,每个候选特征的贡献由公式13评分,得到最优值的特征被添加到选择子集中(第7-14行)最后输出选择子集(第15行)。

3.4 复杂度分析

假设样本数为,初始数据集的维度为

,选择子集的大小为

。然后,每个特征的互信息、条件互信息和联合互信息需要用

个样本进行计算,所以时间复杂度为

。因此,提出的方法和比较方法的时间复杂度为

,实验结果将在第4节中讨论。

4 实验结果与分析

本节介绍了所提出算法和竞争算法的大量实验。第4.1节说明了实验设置。第4.2节介绍了使用的基准数据集。然后,在不同方面对提出算法和比较算法进行了实验。实验结果和进行的分析在第4.3节中展示。

4.1 实验设置

所有计算均在Inter(R) Core(TM) i7-7500 CPU @ 2.70-GHz和8G主存储器上进行。此外,为确保实验结果的公正性,每个实验在MATLAB中独立运行30次。将30组的平均结果和标准差作为评价指标。

在实验中,训练集和测试集通过10折交叉验证进行划分。同时,为了评估FSRRW的有效性,在三个分类器上测试所选择子集的分类精度:3近邻(3NN)、带RBF核的支持向量机(SVM)和随机森林(RF)。MIFS、JMI、mRMR、CIFE、MRI、DCSF和CWJR被用作对比算法。

实验设置如下。首先,对基准数据集进行预处理。连续型数据集均匀分布在五个等长的区间中。第二步是设置所选子集的大小,并验证提出算法与7种比较算法在不同分类器上的能力。然后随着选择子集的大小从1到,测试分类准确率。同时分类器统一使用3NN。最后,得出平均准确率和AUC以评估所提出方法的分类能力。

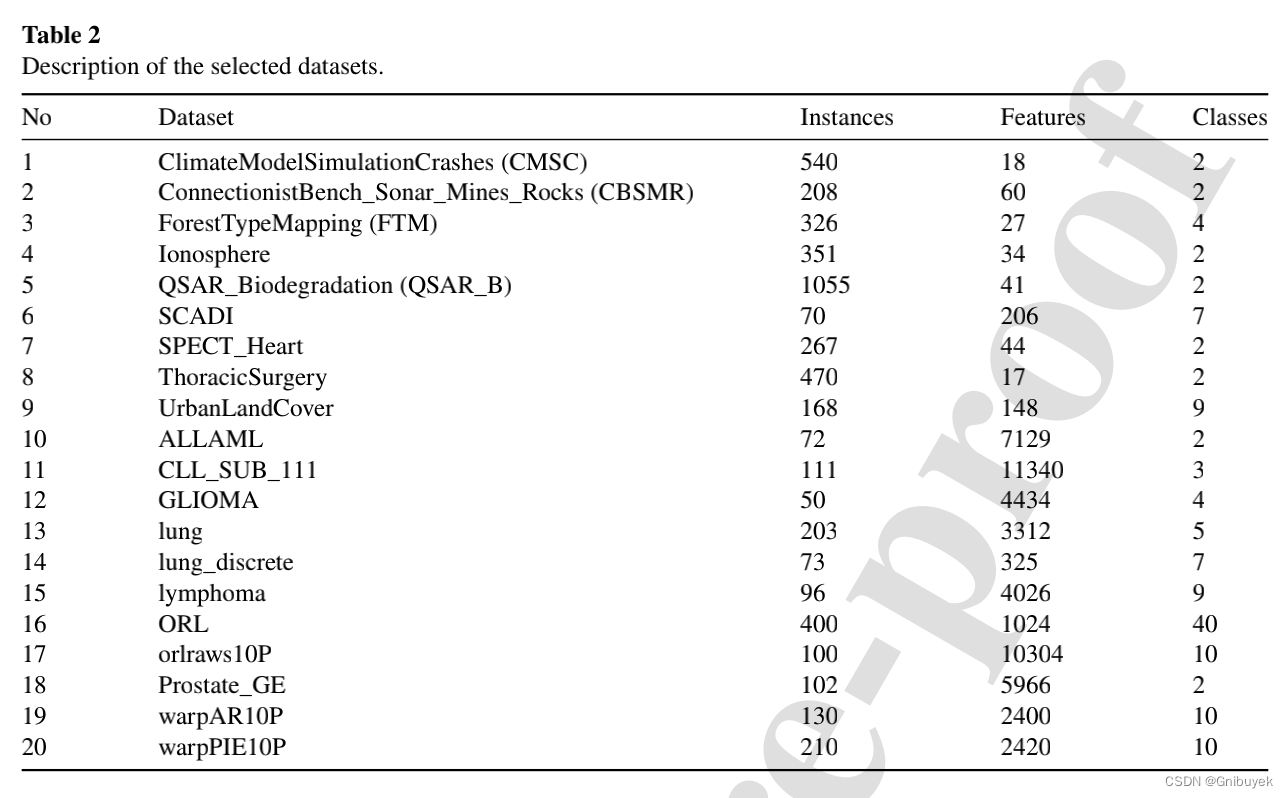

4.2 数据集描述

为了衡量所提出算法的适用性,选择了来自UCI和ASU的20个基准数据集。基本信息如表2所示。这些数据集包含了低、中、高维度,维度范围从17到11340,有利于测试所提出算法的适用性和可行性。此外,根据数据集的大小,当维度小于300时,选择的特征数量为10,其余数据集选择30个特征。

4.3 分类结果与分析

本节介绍了所提出算法结合不同分类器的实验。平均分类准确率和AUC用于评估提出的方法。

4.3.1 准确率评估

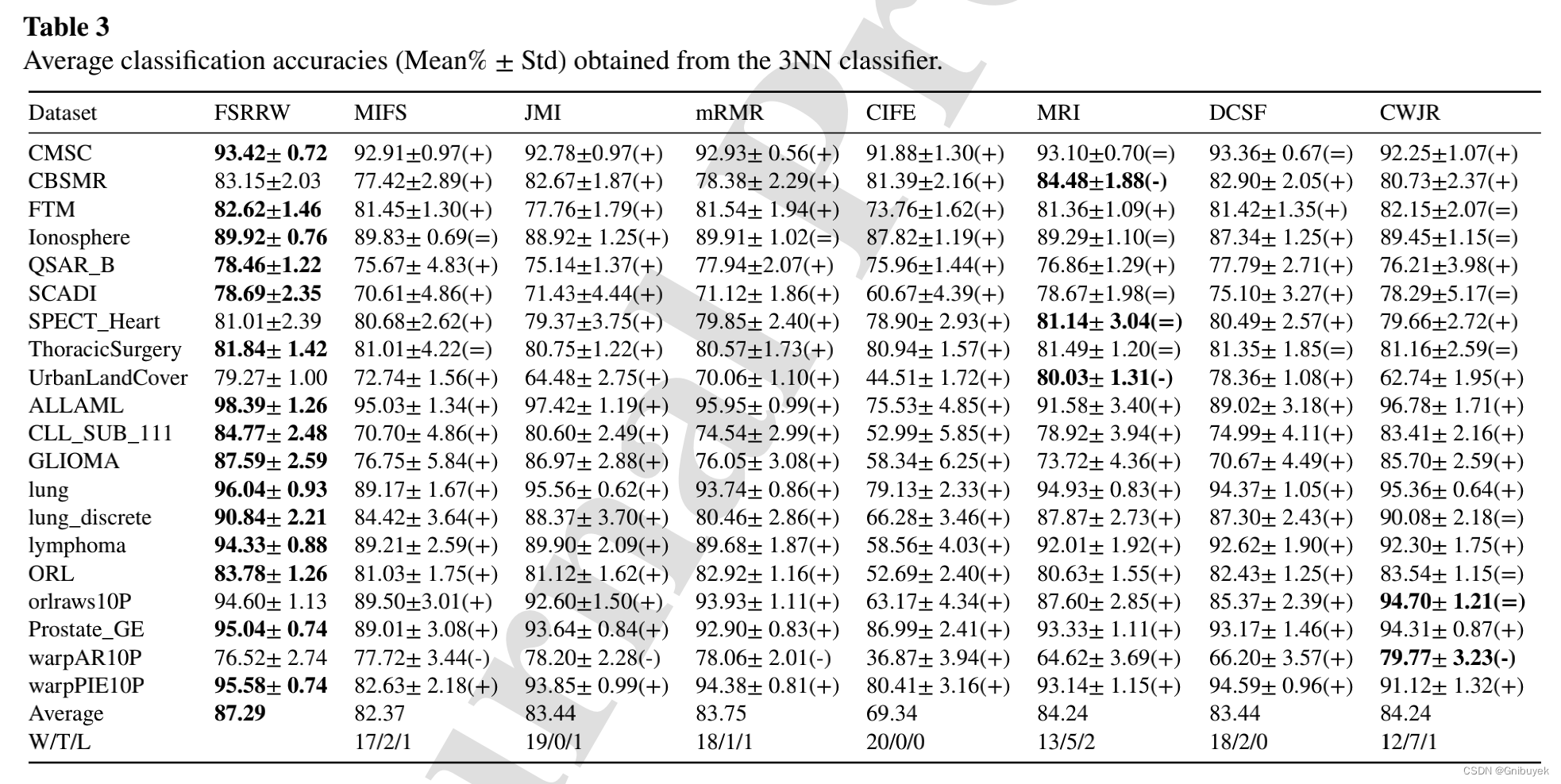

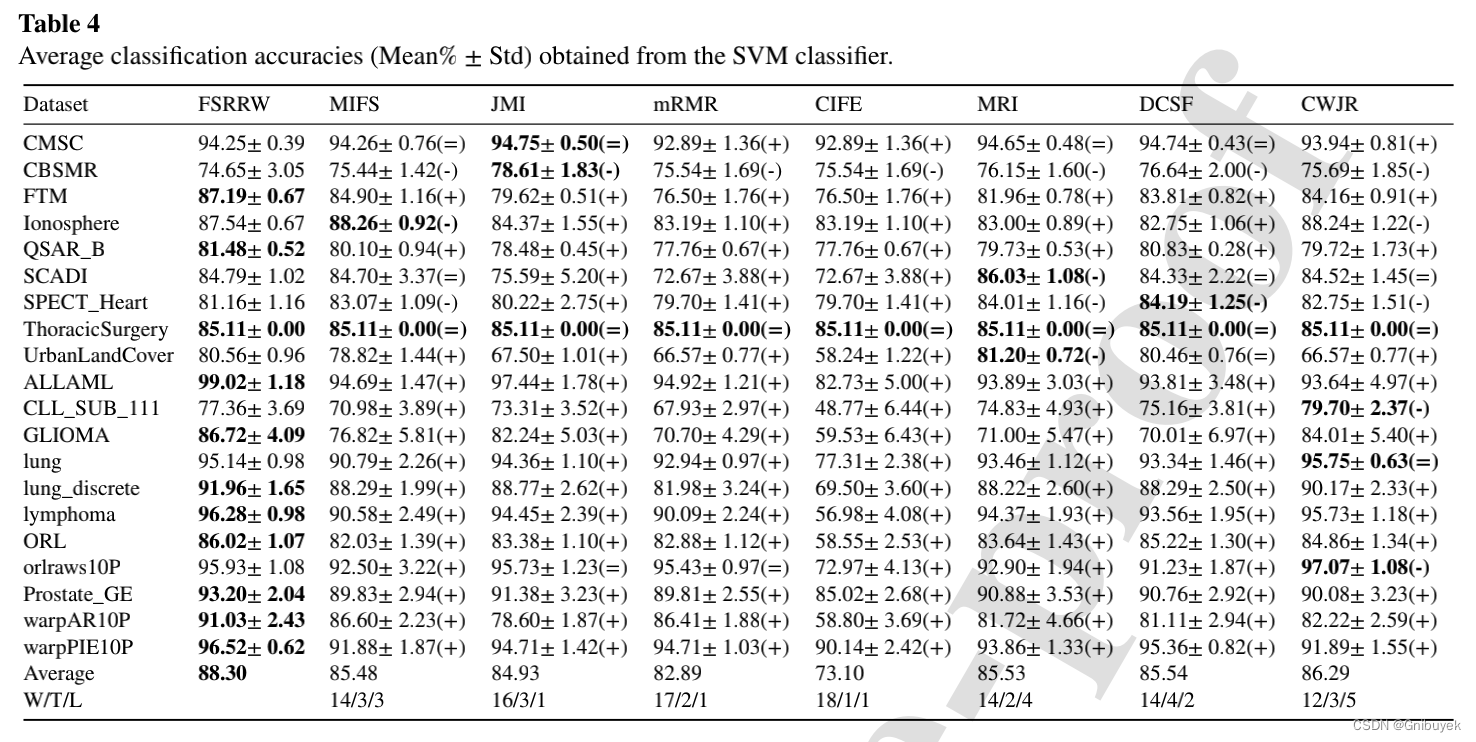

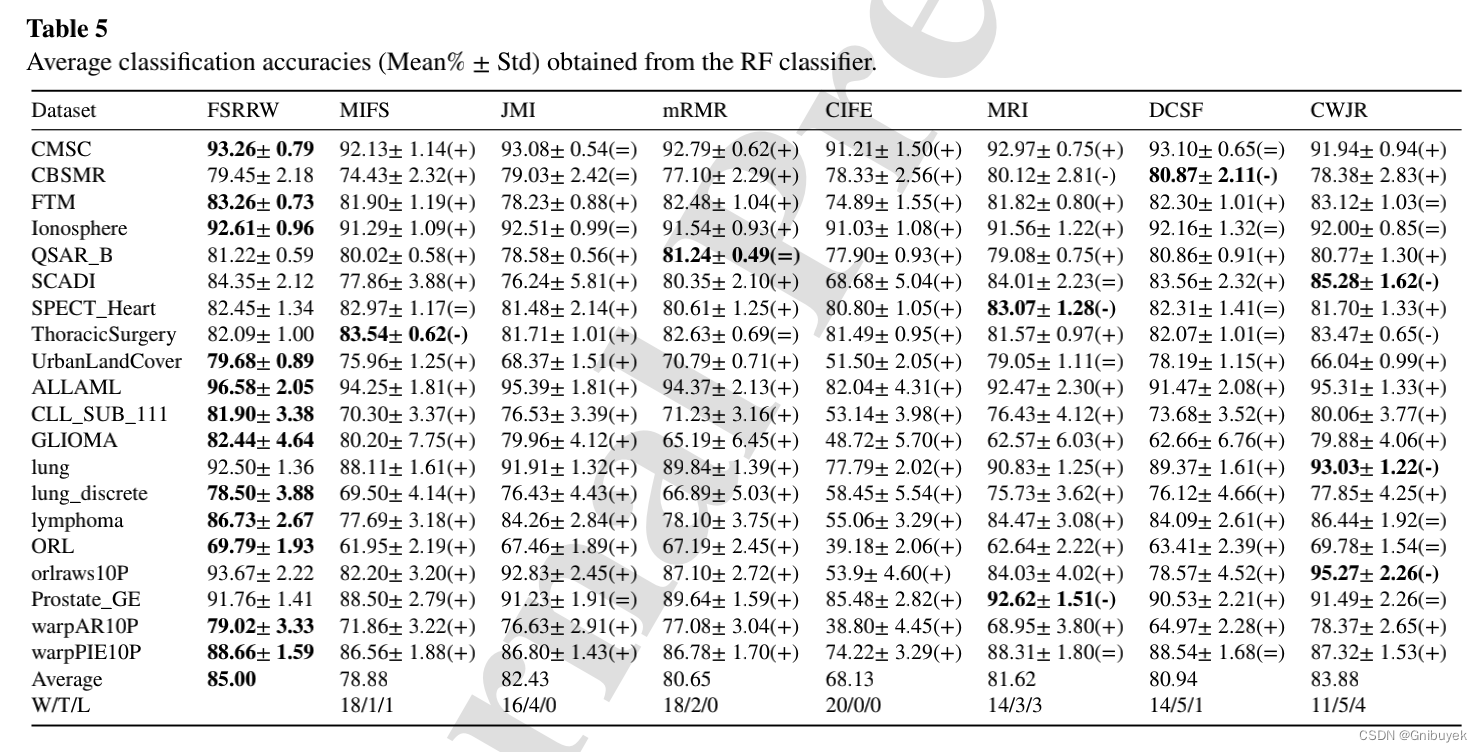

不同分类器上的实验结果如表3-5所示。标签“Average”代表20个数据集的平均分类准确度。最后一行“W/T/L”代表“赢/平/输”。(+/=/-)代表提出算法实现了“优于”、“平局”和“差于”其他算法。此外,最佳的分类准确度用粗体突出显示。

表3列出了3NN分类器下不同算法的平均分类准确度。如表3所示,所提出的方法在15个数据集上表现最好,在其余数据集中仅观察到细微差异。具体来说,FSRRW在数据集CBSMR、SPECT_Heart、UrbanLandCover和orlraws10P上取得了类似的分类结果。除此之外,FSRRW在所有数据集上实现了87.29%的最佳平均分类准确率。总体而言,这表明FSRRW表现出来最好的特征选择能力,可以有效提高分类器的识别效率。

在SVM分类器上获取的平均分类准确率记录在表4中。FSRRW表现出来11个最优和4个次优分类准确率。FSRRW在20个数据集上的平均分类准确率达到88.30%,是SVM分类器上表现最好的方法。所有结果表明,该算法能够有效消除冗余特征,在分类过程中起到关键作用。

表5展示了所提出方法在RF分类器上的性能。结合3NN和SVM分类器,可以观察到在RF分类器上的表现有所不同,但FSRRW仍然在12个数据集上达到最优分类准确率。虽然在数据集SCADI、lung和Prostate_GE上分类准确度排第二,但FSRRW和最优算法仅有细微的差距。此外,注意到“Average”中列出的结果达到了最优值,FSRRW可以提取信息量最大的特征子集。

结合如上表3-5,提出的算法与SVM集成可以获得更高的分类准确率。该算法与其他方法相比,在三个分类器上的表现是最好的。 显然,所提出算法的改进和实用性在不同分类器上保持稳定。

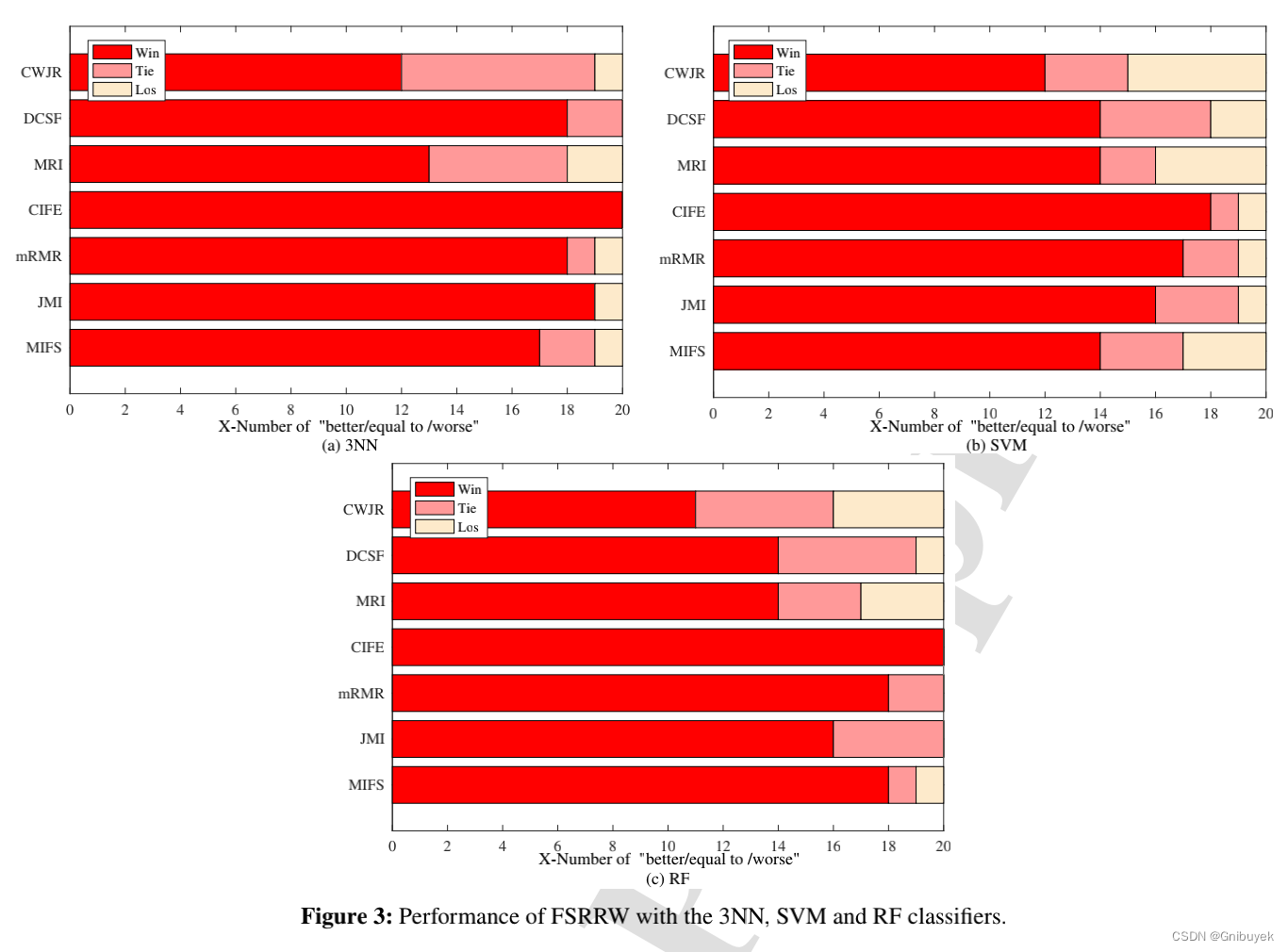

FSRRW的W/T/L统计结果对比其他算法如图3所示。3NN、SVM和RF分类器上的优于和平局占提出算法的大部分。这个结果验证了所选的特征包含更多的重要信息,可以在一定程度上改进分类。所提出的方法比各种基于信息论的特征选择算法具有更强的竞争力。

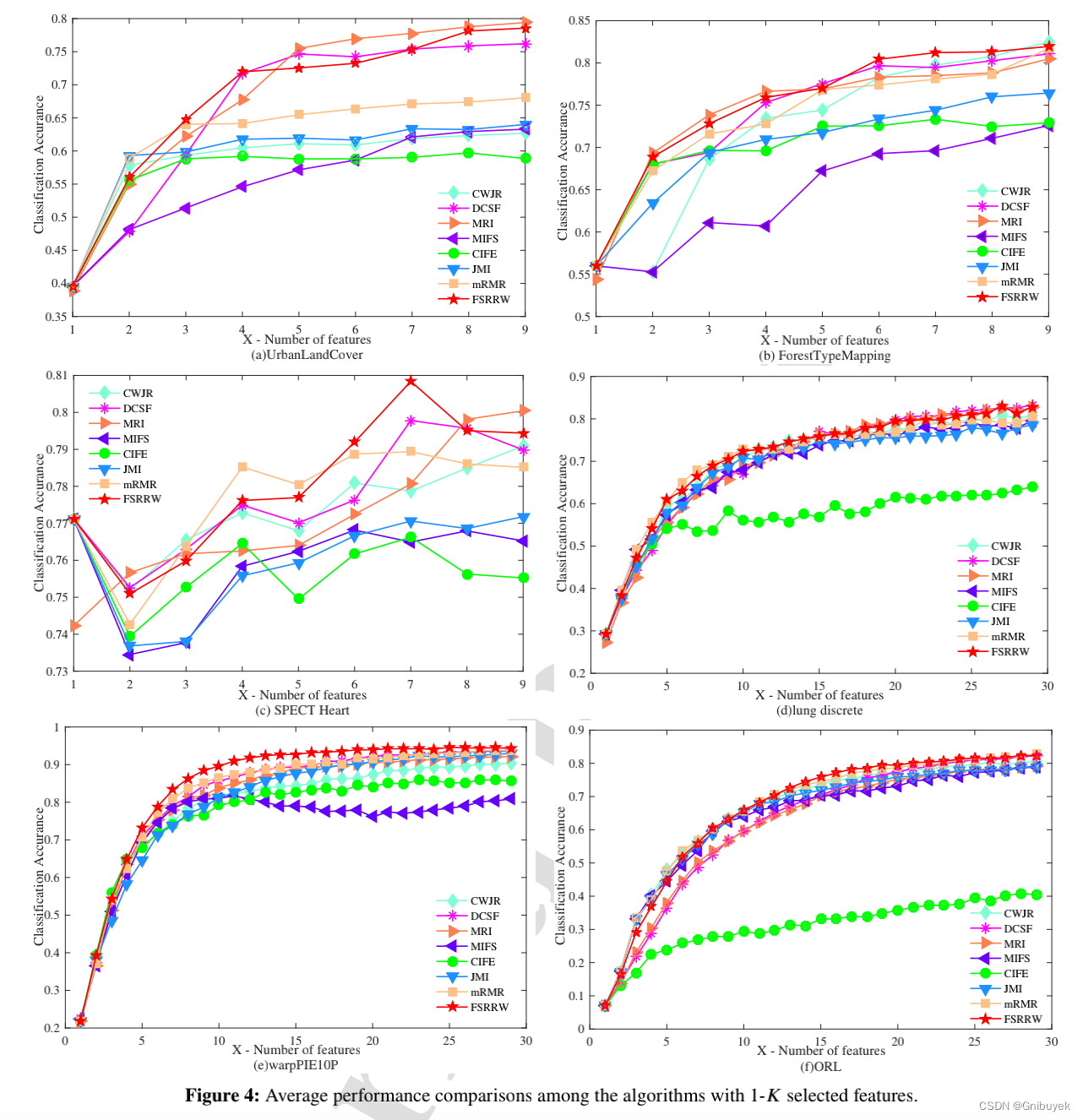

为了评估FSRRW的适用性和可行性,特征选择数量从1变化到,在6个数据集上实现的平均分类准确率如图4所示。不同颜色和类型的点代表不同的特征评价标准。X轴表示所选子集的大小,Y轴表示当前所选特征的分类准确率。在数据集ForestTypeMapping、SPECT_Heart、lung_discrete、warpPIE10P和ORL上,FSRRW持续保持着更高的分类准确率。在数据集UrbanLandCover上,FSRRW选择几个特征时可以达到峰值。随着特征数量的增加,FSRRW保持着第二好的分类准确率。因此,在7个比较算法中,所提出的方法是综合最佳的。这说明了所选特征表现出更好的质量,有利于分类器的分类能力。

4.3.2 AUC评估

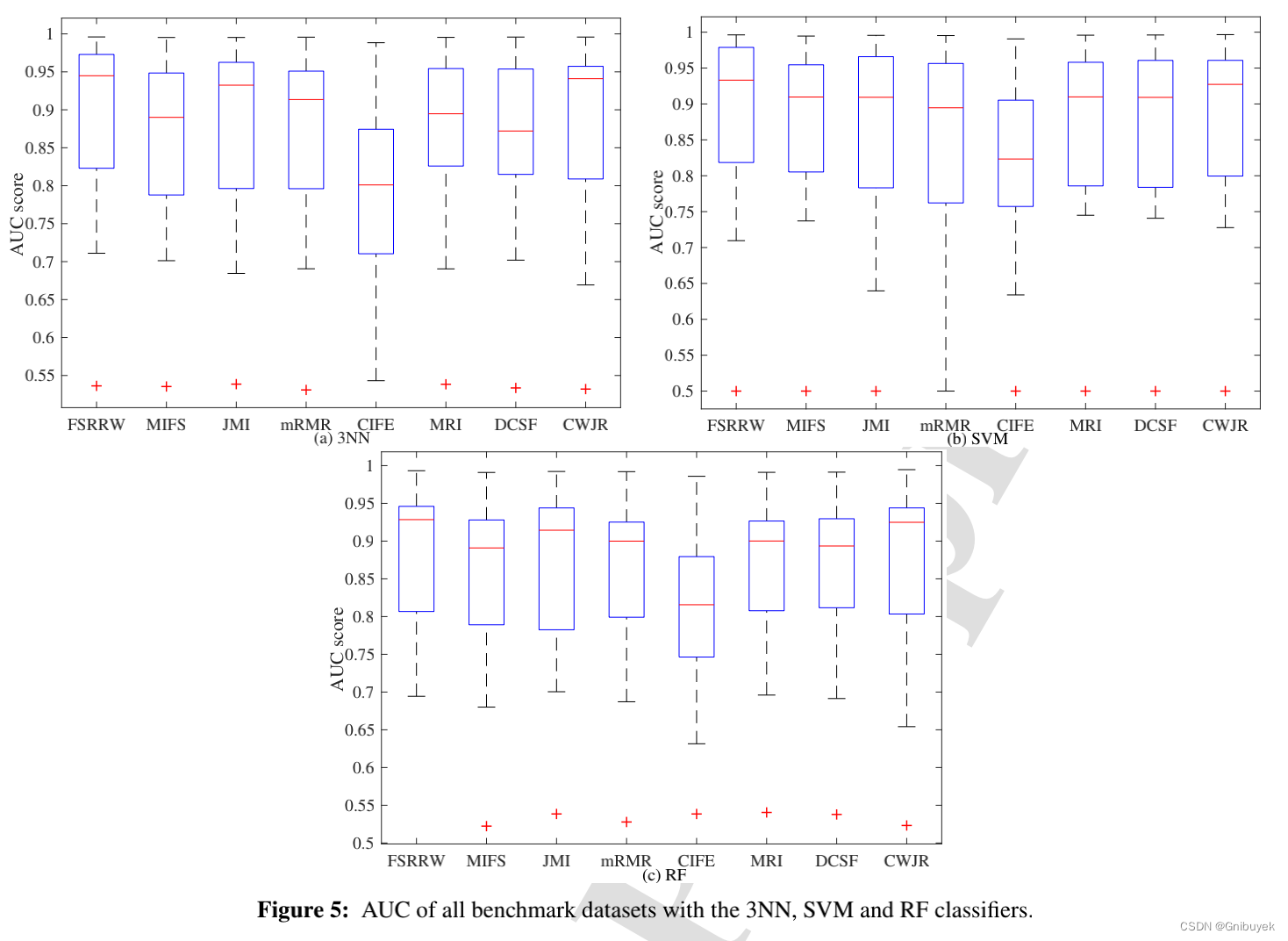

AUC用来计算提出算法在所有数据集上的分类能力。它的取值范围从0.5到1,AUC越高,分类效果越好。在所有数据上,基于三种分类器的平均AUC值如图5的箱线图所示。FSRRW在3NN和SVM分类器上的最大值、最小值和中值都犹豫其他对比算法。在RF分类器上,所提出方法在最大值和中值上表现较好,与DCSF和MRI的最小值差距很小。上述结果表明,FSRRW可以稳定地提高所选分类器的性能。

5 讨论

通过以上分析,FSRRW优于七种对比方法。我们从不同角度总结并分析实验结果的原因。

提出算法在低维数据集上获得了最好的分类准确率如数据集FTM、QSAR_B和ThoracicSurgery。在这种情况下,冗余特征对特征选择是致命的。在单独定义冗余的基础上,FSRRW还增加了冗余干扰来构建相关术语。因此,在低维数据集上,与其他算法相比,冗余特征更难进入选择子集。

FSRRW在高维数据集上表现比在低维数据上更好。例如数据集ALLAML、GLIOMA、lung_discrete、lymphoma、ORL和warpPIE10P上,所提出的方法在三种分类器上比其他算法表现更好。在全部高维数据集上,产生两个以上最佳分类准确率的数据集站81.82%。显然,选择包含最多信息的特征对于特征选择至关重要。条件互信息主要用于评估具有强相关性的特征。然后,新的权重增加了特征的贡献,并具有一定的波动性。这两个步骤都有效提高了所选子集的质量。

在高维和小样本数据集上的特征评价很难表现出明显的差异。特征必须使用有限的样本进行有效的区分。我们选择了一下三个有代表性的数据集:CLL_SUB_111、PProstate_GE和warpAR10P。FSRRW寻找信息量最大的特征,这些特征有利于达到分类准确率的峰值,因为RRW可以增强特征分数的差异。因此,特征评价标准可以提高更清晰的边界,在高维和小样本数据集上表现出更好的性能。

6 结论和未来工作

为减少基于过滤式和信息论特征选择方法的冗余,提出一种新的相关-冗余权重RRW。此外,基于权重定义特征相关性以覆盖从特征和类中提取的多种类型的信息。通过最大化特征相关性和最小化特征冗余,构造一种新的特征评价标准FSRRW以更清楚地区分具有相似作用的特征。大量实验表明,提出算法获得最佳平均分类准确率,证明了该方法的有效性和适用性。

基于相关-冗余权重,提出方法表现出更好的特征子集筛选能力。在未来,特征冗余可以基于这个权重被定义以获得更好的特征评价标准。此外,所提出的特征选择算法可以被应用于医疗诊断、文件分类和垃圾邮件检测仪拓宽其实际应用。

4434

4434

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?