Hirano 和 Imbens 基于预设的临界t值来设定预测变量的方法

- 逻辑回归:逻辑回归虽然带有回归字样,但是逻辑回归属于分类算法。逻辑回归可以进行多分类操作,但由逻辑回归算法本身性质决定其更常用于二分类。

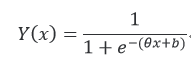

a.逻辑回归公式如下:

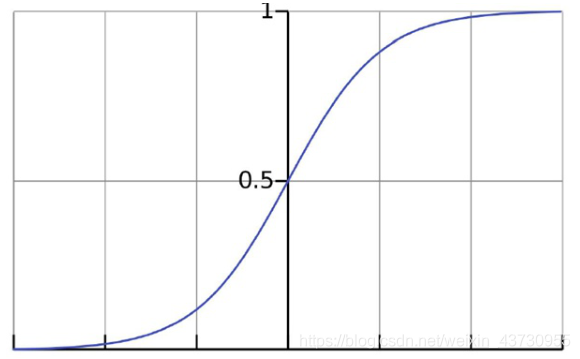

其中,Y为决策值,x为特征值,e为自然对数。Y(x)的图形如下:

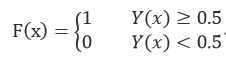

对于常见二分类,逻辑回归通过一个区间分布进行划分,即如果Y值大于等于0.5,则属于正样本,如果Y值小于0.5,则属于负样本,这样就可以得到逻辑回归模型,判别函数如下:

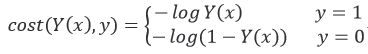

在模型参数w与b没有确定的情况下,模型是无法工作的,因此接下来就是在实际应用期间最重要的是模型参数w和b的估计。其代价函数如下:

给定y值为1时,代价函数曲线横坐标为决策函数Y(x)的值越接近1,则代价越小,反之越大。当决策函数Y(x)的值为1时,代价为0。类似的,当给定y值为0时有同样的性质。

b.Logistic回归虽然名字叫”回归” ,但却是一种分类学习方法。使用场景大概有两个:第一用来预测,第二寻找因变量的影响因素。

c.odds: 称为几率、比值、比数,是指某事件发生的可能性(概率)与不发生的可能性(概率)之比。用p表示事件发生的概率,则:odds = p/(1-p)。

OR:比值比,为实验组的事件发生几率(odds1)/对照组的事件发生几率(odds2)。

d.最大似然法是要解决这样一个问题:给定一组数据和一个参数待定的模型,如何确定模型的参数,使得这个确定参数后的模型在所有模型中产生已知数据的概率最大。

e.可以通过逻辑回归系数衡量自变量对分类因变量的影响。详见链接中包含一个连续变量的模型部分

http://blog.sina.com.cn/s/blog_44befaf60102vznn.html

f.关于逻辑回归的代码分析见链接

本文探讨了倾向值分析中选择协变量的方法,包括Hirano和Imbens的预设临界t值法、逐步回归法、OLS线性回归和逻辑回归。介绍了逻辑回归的原理和应用,如最大似然法、几率比和t检验。同时讨论了如何通过psestimate命令选择处理变量的最佳一阶和二阶形式,以及利用随机森林和逻辑回归计算特征重要性。

本文探讨了倾向值分析中选择协变量的方法,包括Hirano和Imbens的预设临界t值法、逐步回归法、OLS线性回归和逻辑回归。介绍了逻辑回归的原理和应用,如最大似然法、几率比和t检验。同时讨论了如何通过psestimate命令选择处理变量的最佳一阶和二阶形式,以及利用随机森林和逻辑回归计算特征重要性。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?