1.2 基本术语

这里有一批关于西瓜的数据:(色泽=青绿;根蒂=蜷缩;敲声=浊响),(色泽=乌黑;根蒂=稍蜷;敲声=沉闷),(色泽=浅白;根蒂=硬挺;敲声=清脆),……

- “=”:取值为;

- 数据集:这组记录的集合;

- 示例/样本:每条关于一个事件或对象的描述记录;

- 属性/特征:反映事件或对象在某方面的表现或性质的事项,如“色泽”、“根蒂”……

- 属性值:属性上的取值,如“青绿”……

- 属性空间/样本空间/输入空间:属性张成的空间;如把“色泽”、“根蒂”和“敲声”作为三个坐标轴,则它们张成一个用于描述西瓜的三维空间;

- 特征向量:一个事件或对象,即示例,因为空间中每个点对应一个坐标向量;

- 标记:关于示例结果的信息,如“好瓜”;

- 样例:拥有标记信息的示例,如 ((色泽=青绿;根蒂=蜷缩;敲声=浊响),好瓜)

- 标记空间/输出空间:所有标记的集合。

如果预测的是离散值,例如“好瓜”、“坏瓜”,此类学习任务称为“分类”;如果预测的是连续值,例如西瓜成熟度0.95、0.37…,此类学习任务称为“回归”。对于只涉及两个类别的“二分类”任务,通常称其中一个类为“正类”,另一个为“反类”或“负类”;涉及多个类别时,则称为“多分类”任务。

还可以对西瓜做聚类任务,即将训练集中的西瓜分成若干组,每组称为一个簇。

根据训练数据是否拥有标记信息,学习任务可以分为“监督学习”和“无监督学习”两类。分类和回归是前者的代表,聚类则是后者的代表。

泛化能力:学得模型适用于新模型的能力。

通常假设样本空间的全体样本服从一个未知分布,我们获得的每个样本都是独立地从这个分布上采样获得的,即“独立同分布”。

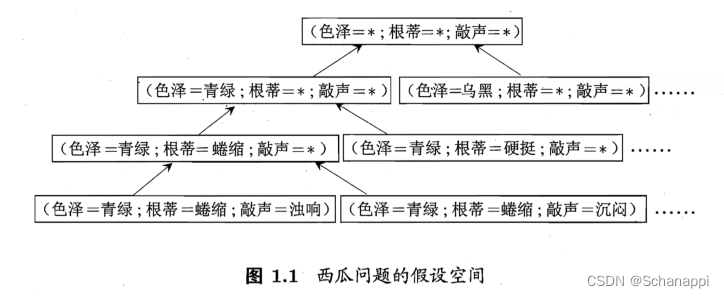

1.3 假设空间

归纳和演绎是科学推理的两大手段:

- 归纳:是从特殊到一般的泛化过程,从具体的事实归结出的一般性规律;

- 演绎:是从一般到特殊的特化过程,从基础原理推演出具体状况。

归纳学习有广义和狭义的区分;广义的归纳学习相当于从样例中学习,而狭义的归纳学习则要求从训练数据中学得概念,也称为“概念学习”或“概念形成”。

概念学习中最基础的是“布尔概念学习”,即对“是”,“不是”这样的可表示为0/1布尔值的目标概念的学习。

学习过程就是在所有假设组成的空间中进行搜索的过程,搜索目标是找到与训练集匹配的假设,即能够将训练集中的瓜判断正确的假设。

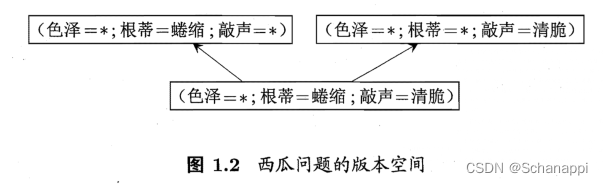

可能有多个假设与训练集一致,即存在着一个与训练集一致的“假设集合”,称之为“版本空间”。

假设空间和版本空间的计算

1.4 归纳偏好

问题:现在有三个与训练集一致的假设,但与它们对应的模型在面临新样本的时候,却会产生不同的输出。

如,对(色泽=青绿;根蒂=蜷缩;敲声=沉闷),如果采用“好瓜<->(色泽= * )^ (根蒂=蜷缩) ^ (敲声= * )”这个假设,那么该瓜会被认为是好瓜,而如果采用其他两个假设,则会被认为是坏瓜。

那么,应该采用哪一个模型(假设)呢?

这时,学习算法本身的“偏好”会起到关键作用。如,算法喜欢“尽可能特殊”的模型,则它会选择“好瓜<->(色泽= * )^ (根蒂=蜷缩) ^ (敲声= 浊响 )”;而算法如果喜欢“尽可能一般”的模型,则他会选择“好瓜<->(色泽= * )^ (根蒂=蜷缩) ^ (敲声= * )”。

机器学习在学习过程中对某种类型假设的偏好,称为“归纳偏好”或者简称为“偏好”。任何一个有效的机器学习算法必定有它的归纳偏好。

“奥卡姆剃刀”,是一种常用的、自然科学研究中最基本的原则,能够引导算法确立“正确的”偏好。即“若有多个假设与观察一致,则选最简单的那个”。那么怎么判定哪个假设更“简单”呢,这个问题需要借助其他机制才能解决。

文中通过算式推导出了一个结论:对于任意两个学习算法,总误差都相等。这就是“没有免费的午餐定理(NFL)”。NFL的前提是:所有“问题”出现的机会相同、或所有问题同等重要。然后实际情况并非这样,因此,NFL定理让我们认识到,脱离具体问题,空泛地谈论“什么样的学习算法更好”毫无意义。

464

464

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?