本文仅对所读论文进行总结仅供参考,原文请谷歌学术搜索

一、SAR-U-Net网络基本架构

SAR-U-Net网络是基于传统U-Net网络进行改进的模型,论文对FCN网络和其衍生模型U-Net对于相邻的两个像素点之间的语义联系不敏感、在进行深度学习时当层数过高或将出现梯度消失的问题、对于图像特征提取不完全三个问题提供了思路。

对于相邻像素点之间语义联系不敏感, SAR-U-Net网络采用SE结构加强像素点之间的联系。

层数过高时梯度消失,SAR-U-Net网络采用ResNet网络提出的残差结构来改善层数增加时梯度消失问题

图像特征提取不完全,创意性的提出ASPP结构来替代传统U-Net网络中的过渡层,从多方面来对图像特征进行提取,使得图像提取到的特征更加完善。

1.1 整体模型

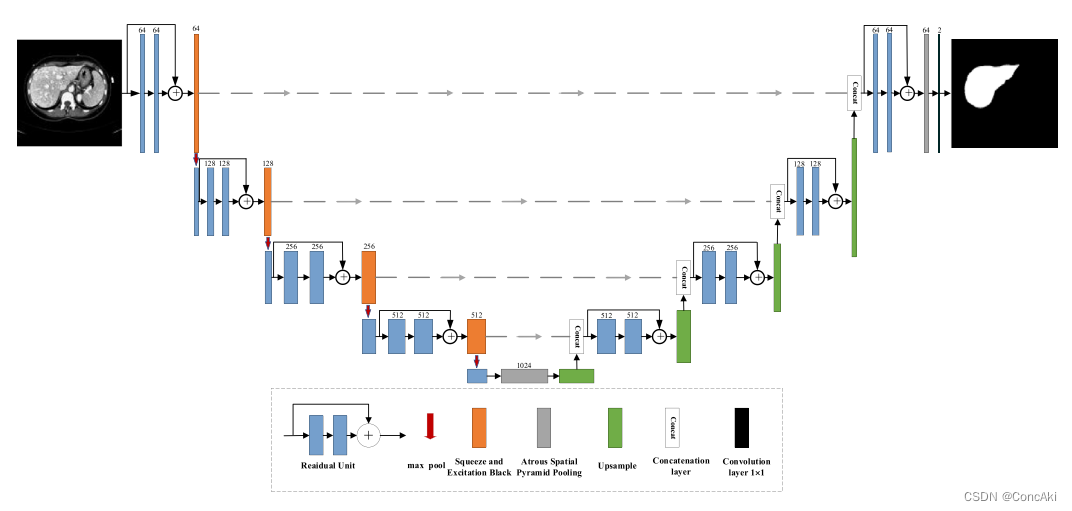

整个模型同传统U-Net网络没有较大的分别,将SE模块、残差结构、ASPP分别嵌入U-Net网络结构中,如图1所示:

图1 (论文原图,详细请参考原论文)

1.2 模块构成

1.2.1 SE结构

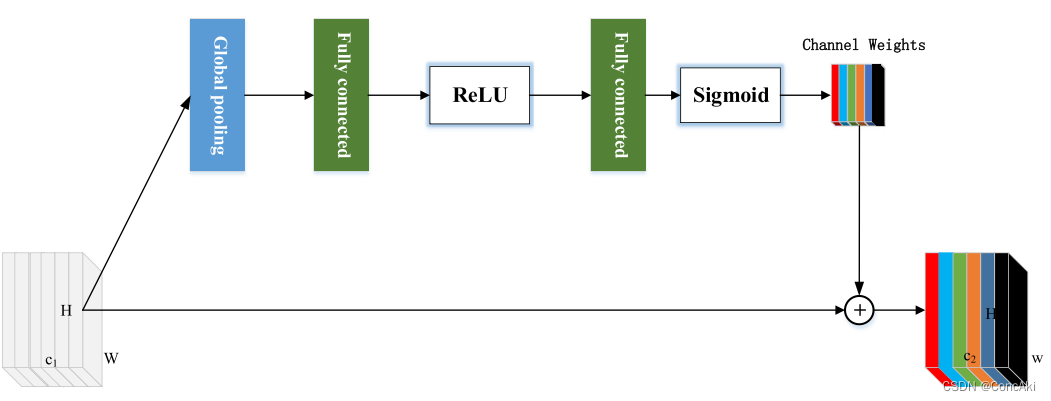

SE结构通过提全局池化、全连接层、Relu、Sigmoid 来调整一个体素块(感知野)中每个通道所占的比重,同时也知道了每个像素点之间的联系,以此解决像素点与像素点之间不敏感的问题。具体结构如图2所示:

图2

1.2.2 Res unit

Res-unit 网络结构则不必要太多解释,从ResNet网络的提出其结构也广泛的应用于各大主流网络模型之中,ResNet unit 能很好的解决在深度学习中,随着模型层数的增加,梯度出现消失的问题。

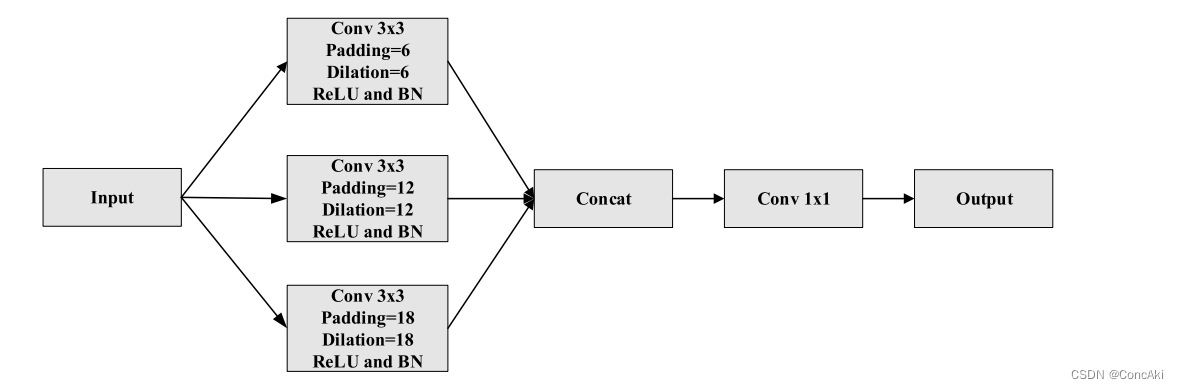

1.2.3 ASPP

ASPP具体名称为:空洞空间卷积池化金字塔 ,相较于其他博客所展示的经典ASPP结构,论文的ASPP有其独特的设计,如图3所示

图3

这里值得注意的是图中的 Dilation 参数,dilation通常指代膨胀,在卷积运算中,拿线性卷积来说,w[0] * x[0] + w[1] * x[1] + w[2] * x[2]。若dilation = 2,过滤器会计算:w[0] * x[0] + w[1] * x[2] + w[2] * x[4];

通过膨胀率设置不同和Padding(边界补零,提取更多边界信息)的值不同,在过渡层中,整个网络就获取到了更多的来自不同层次的特征信息。

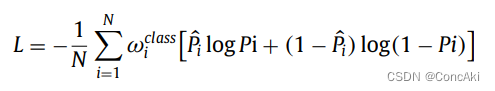

1.3 损失函数

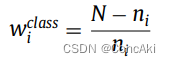

SAR-U-Net网络的损失函数是基于Cross entropy函数改进的损失函数,通过增加一个参数 w 来调整整个损失函数。

图4

N为真个区域所有的像素点的数量,n为类别为class i 的数量多少。根据损失函数的定义,就可以知道该系数的妙处,增大无关区域内的损失,减小类别所在区域内的损失,

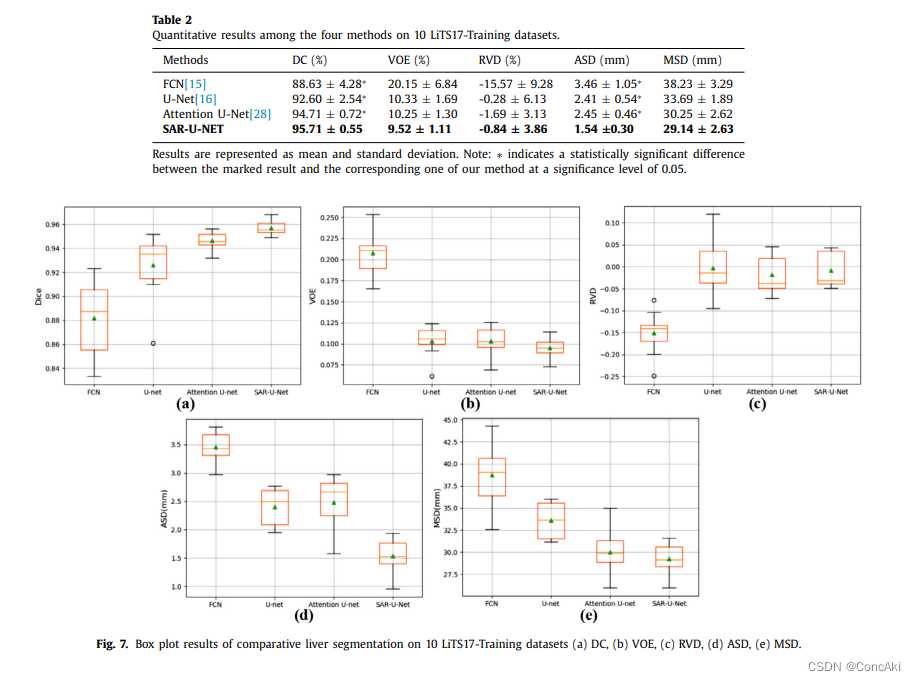

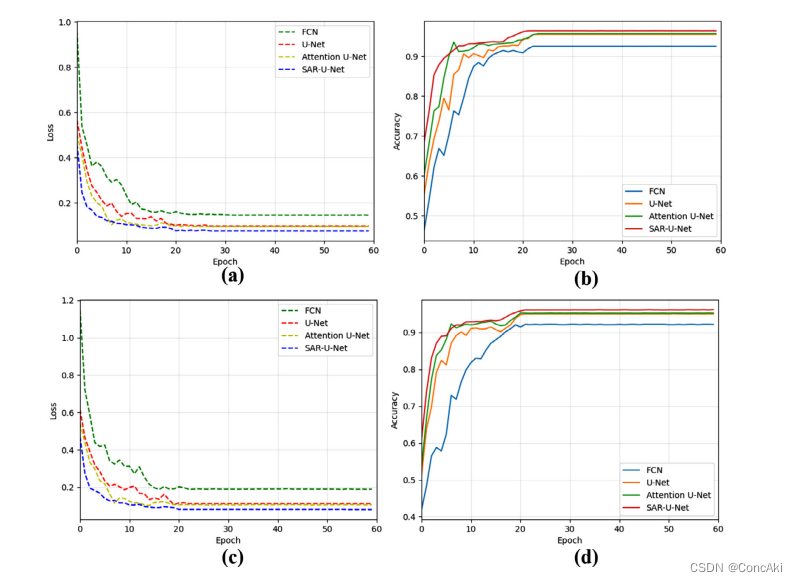

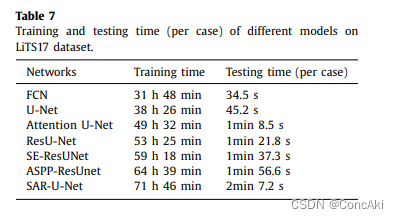

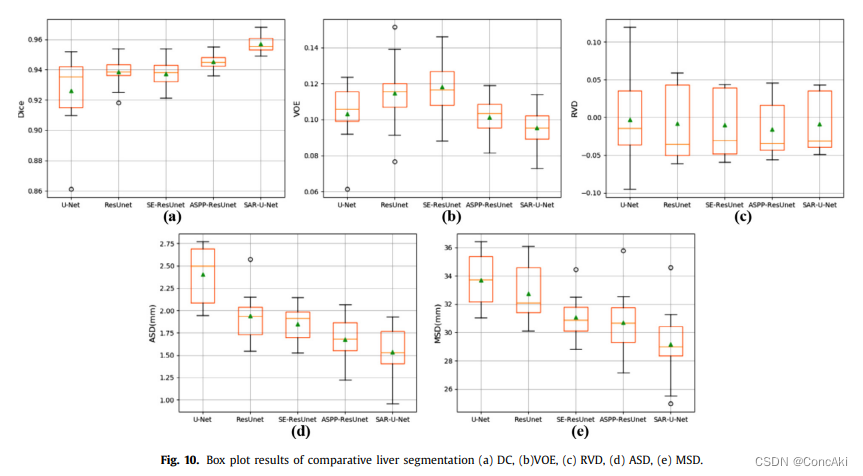

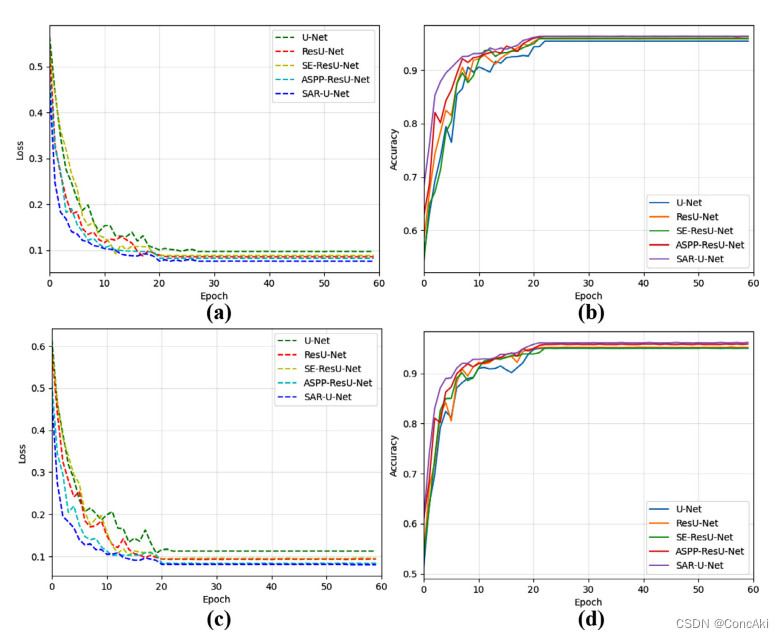

二、SAR-U-Net对比试验

相较于其他网络,SAR-U-Net网络在性能确实更占优势,由于结构的增加,训练所需要的时间也更多了。

三、模型消融实验

在消融实验中,可以很容易看出来SE模块、ASPP对于网络性能具有正面效果。

四、创新点以及一些思考

以上就是正片文章所阐述的几大重点,文章通过消融实验和对比实验来展示所提出模型的优越性,文章的创新点主要集中在SE、ASPP、 Res unit 在文章中的结合应用,其次让人眼前一亮的是对于损失函数的细小改进,所取得的显著成果,其设计思路给了我极大的启发。

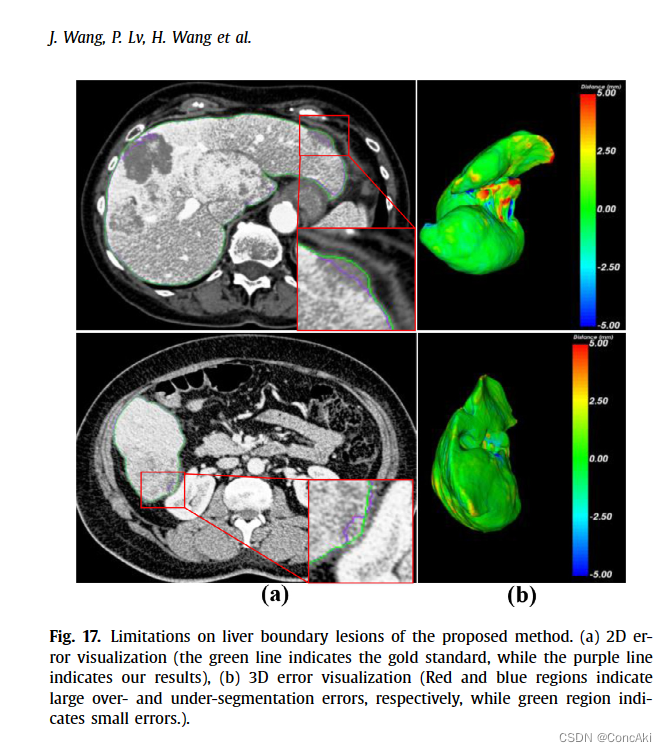

文章也提出了一些展望,对于CT扫描图像而言,CT扫描所得到的图像通常是3D的,而文章只探讨了关于2D图像的处理方案。同时对于2D图像的边界仍然缺乏更好的解决方案。

1446

1446

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?