点击进入专栏:

《人工智能专栏》 Python与Python | 机器学习 | 深度学习 | 目标检测 | YOLOv5及其改进 | YOLOv8及其改进 | 关键知识点 | 各种工具教程

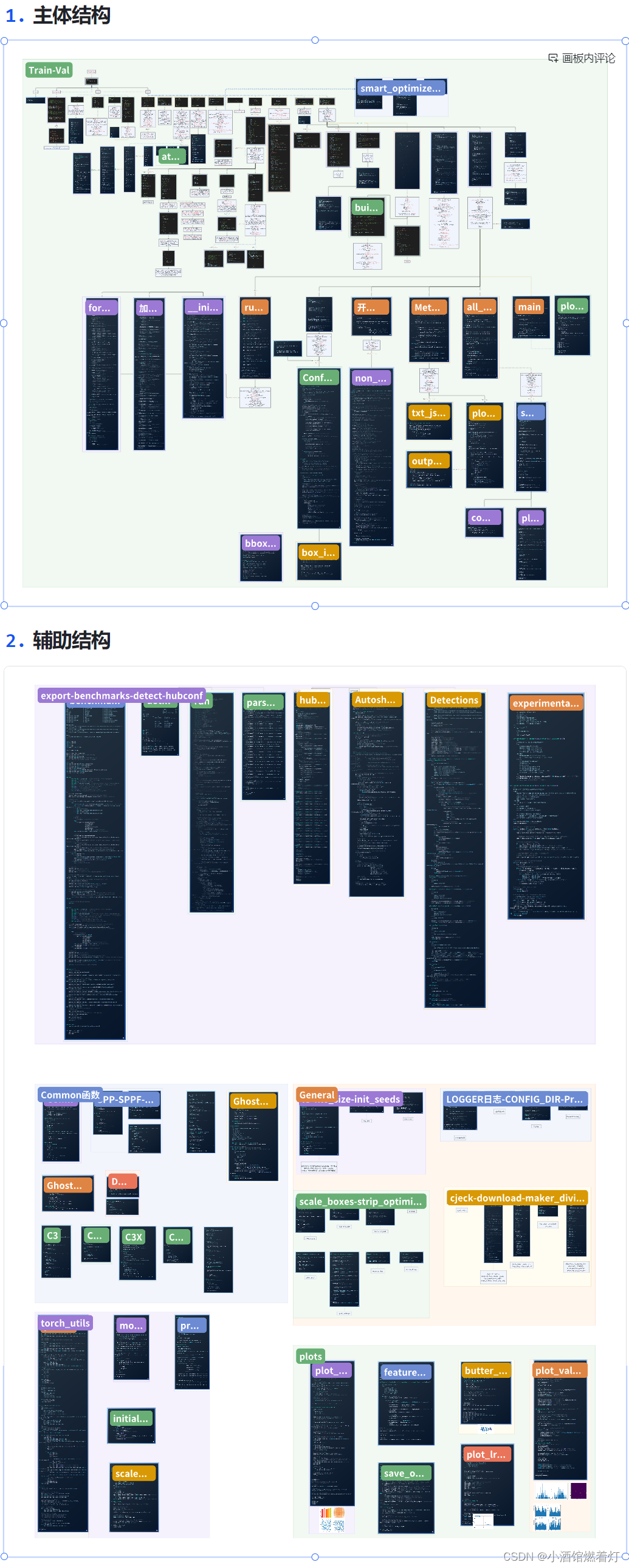

代码函数调用关系图(全网最详尽-重要)

因文档特殊,不能在博客正确显示,请移步以下链接!

图解YOLOv5_v7.0代码结构与调用关系(点击进入可以放大缩小等操作)

预览:

文章目录

-

- 一、激活函数的简介

-

- 1.1 什么是激活函数?

- 1.2 激活函数有什么用?

- 二、一些常见的激活函数

-

- 2.1 sigmoid函数

- 2.2 tanh / 双曲正切激活函数

- 2.3 ReLU激活函数

- 2.4 SiLU

- 2.5 swish激活函数

- 2.6 hardswish激活函数

- 2.7 Mish激活函数

- 2.8 ELU激活函数

- 2.9 AconC/MetaAconC激活函数

- 2.10 Softplus激活函数

- 2.11 Leaky ReLU、 PReLU

- 2.12 代码复现

-

- 复现一

- 复现二

- 三、更换激活函数的步骤

-

-

- 第①步 打开activations.py文件,查看已有函数

- 第②步 在common.py中更换激活函数

-

- 四、如何选择合适的激活函数

一、激活函数的简介

1.1 什么是激活函数?

在接触到深度学习(Deep Learning)后,特别是神经网络中,我们会发现在每一层的神经网络输出后都会使用一个函数(比如sigmoid,tanh,Relu等

已下架不支持订阅

已下架不支持订阅

7992

7992

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?