改进yolov8|注意力机制:CoTAttention

各位哥哥姐姐弟弟妹妹大家好,我是干饭王刘姐,主业干饭,主业2.0计算机研究生在读。

和我一起来改进yolov8变身计算机大牛吧!

本文中的论文笔记都是刘姐亲自整理,原创整理哦~

CoTAttention简介

论文链接

https://arxiv.org/pdf/2107.12292.pdf

代码链接

https://github.com/JDAI-CV/CoTNet

论文内容(原创整理)

前述

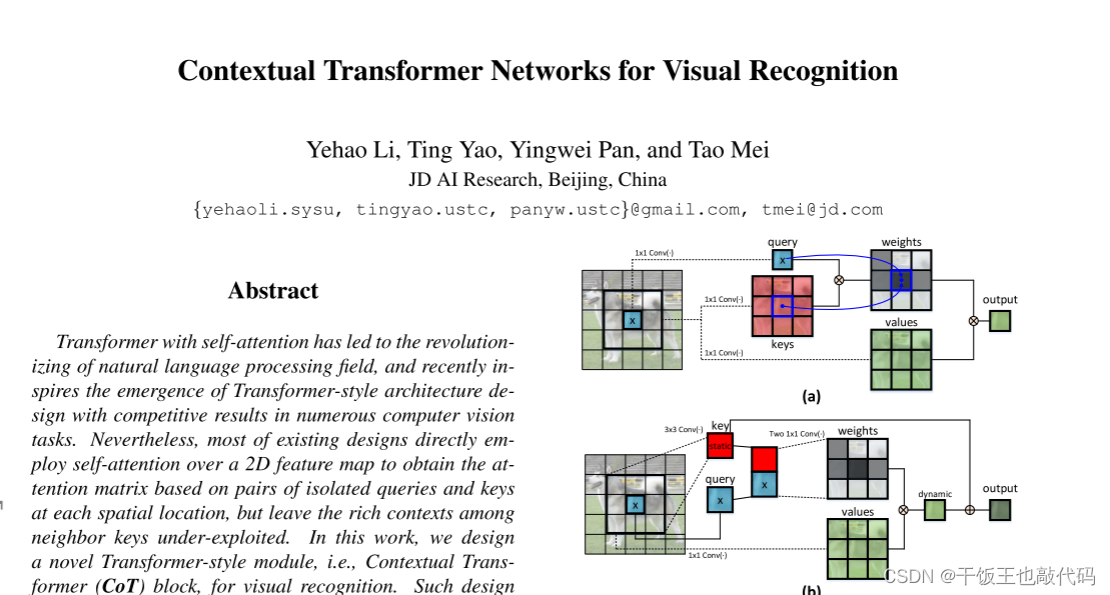

- 上下文Transformer(CoT)块,用于视觉识别。这种设计充分利用了输入键之间的上下文信息来指导动态注意矩阵的学习,从而增强了视觉表征能力

具体

- 提出了一个独特的设计transformer风格的块,命名为上下文transformer(CoT),如图所示。这种设计将关键字之间的上下文挖掘和2D特征图上的自注意学习统一在单个架构中,从而避免引入用于上下文挖掘的额外分支。

订阅专栏 解锁全文

订阅专栏 解锁全文

2329

2329

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?