文章目录

1. 标题:在变分推断中使用GMM和householder

2. 摘要精读

3. 文中需要掌握的知识点

3.1 什么是Normalizing Flow

3.2 通过NF得到了什么样得变分下界

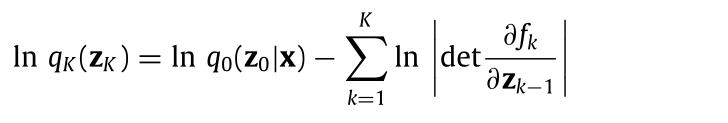

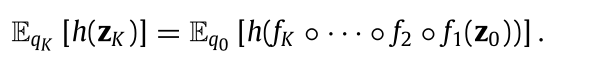

- 通过NF,我们得后验分布可以变为如下,其中,z维随机变量,服从q分布,行列式维雅可比矩阵。

- 然后利用性质:

- 得到变分下界

3.3 网络的结构

3.4 如何计算两个GMM之间的KL散度(会推导)

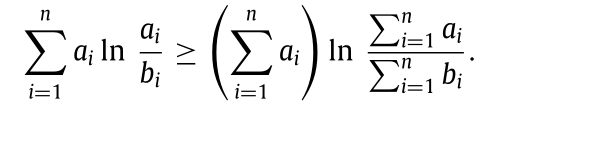

- 利用一个log-sum不等式

- 我们知道单个高斯之间的KL散度是有解析解的,我们通过这样的不等式得到了一个有解析解的上界,这对我们计算KL散度有很大的帮助。所以我们定义,

3.5 Householder Flow

- 这样就解决了变分下界的第二项

3.6 总结算法

4. 实验部分需要注意的地方

- 通过实验证明,GMM分布中的mixture_logits的系数不会影响实验的效果,所以可以将mixture_logits平均分配即可

- VAEGH表现比其他模型都要好。

- 随着components M的增大,我们可以得到一个更加灵活和复杂的近似后验分布,因此,重构误差会变得越来越好。但是另一方面,当M 很大时,整个网络的参数量会急剧增加,这肯定会影响网络的性能

- 所以说我们的后验分布的灵活性不仅取决于M的选择,而且更重要的是取决于从GMM中学习到的均值和方差。

5. 我觉得比较好的图

- MNIST和Fashion-MNIST两个数据集的µ平均值的二维可视化。每个图形由40维潜在变量空间的t-SNE进行转换。在每一行中,从左到右,结果与VAE和我们的方法相对应,依次为M、2、3、10和50。每种颜色代表一个类别标签。

971

971

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?