BERT使用transformer encoder架构

self supervised learning:在无标签情况下,充分运用数据自己卷自己进行学习

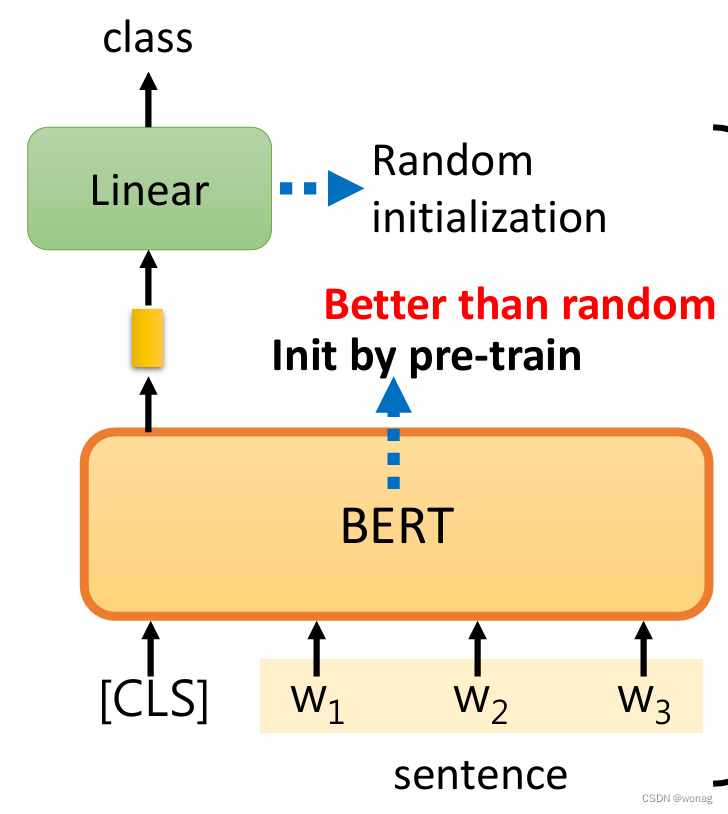

1.使用self supervised learning(pretrain) 进行填词游戏和判断两个句子是否连接游戏的训练。

2.之后在具体的下游任务上fine tune,进行有监督训练。

通过进行填词游戏的训练,BERT可以学习到词义,因此BERT是优秀的word embedding 模型

关于cls token:

cls token一般用于fine tune任务中

可以将BERT视作attention层,丢弃其余输出,只保留cls对应的输出

可以将BERT视作attention层,丢弃其余输出,只保留cls对应的输出

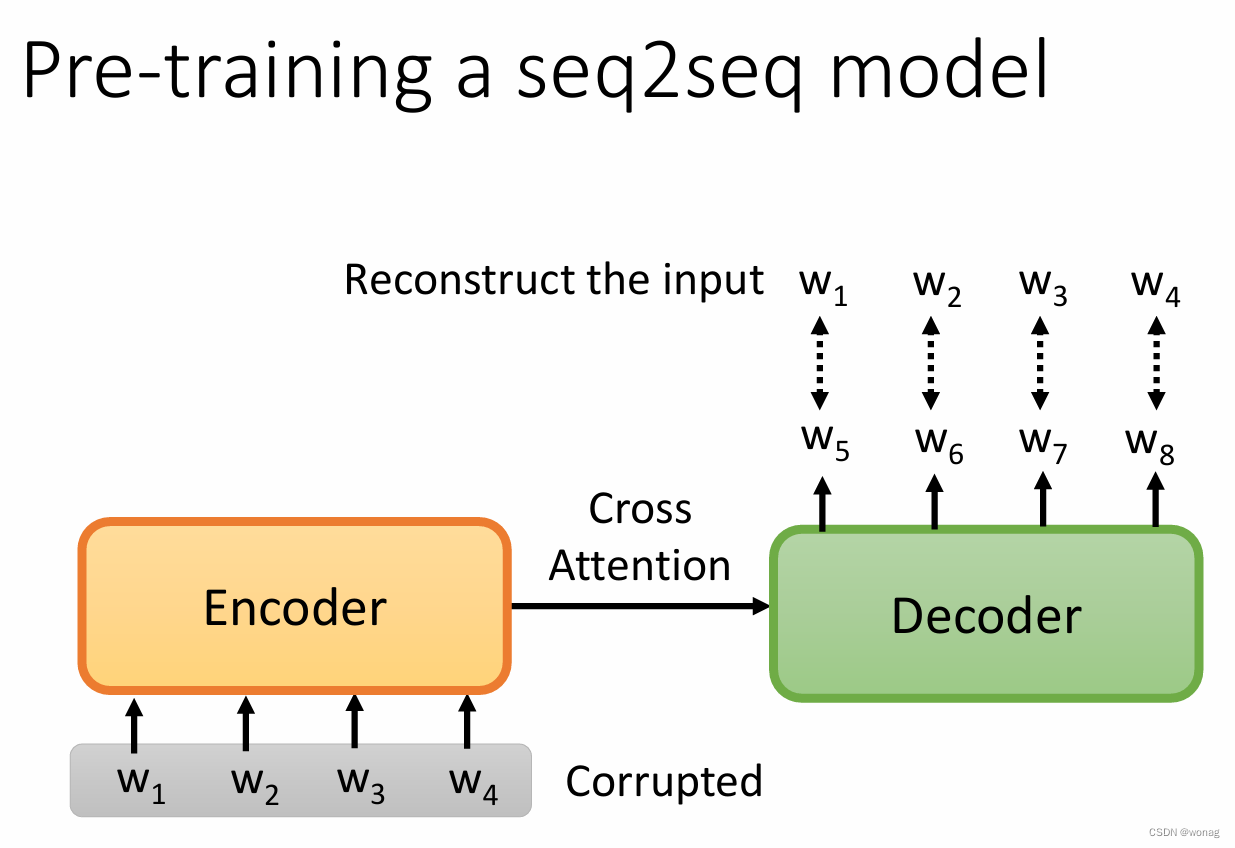

关于T5:

T5是google预训练出的一个encoder decoder model(BERT只是encoder model)

seq2seq model的pretrain主要是进行还原游戏

还原游戏的定义图

还原游戏的定义图

google使用了各式各样的游戏进行预训练,包括删字还原,打乱顺序还原等

492

492

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?