基于计算机视觉中的分类检测任务时,选择模型和对不同模块的整合与修改,以契合任务问题的解决方法十分重要(ps:曾有同学问过笔者是否越高级的算法就越能代表个人水平,对此观点是如何更好更高效解决特定的需求才是关键!!实事求是,别整那些花里胡哨最后把电脑搞崩的玩意儿,比如搞个超级炫酷的GUI界面来拖模型)

教训图:

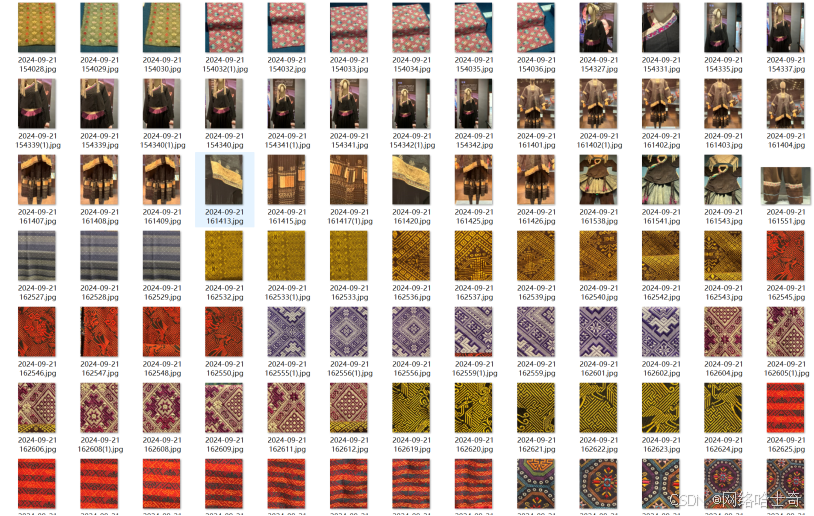

来自伙伴的数据集(1000+),需要可以联系我:

背景:对于民族服饰上的图案是民族文化的特征,特点是颜色多样且不规律,图案形状抽象不规则。在分类检测中的难度较大,在少数民族服饰文化保护的研究中,也在使用有关图像处理的关键技术。通过对民族服饰区域分割提取图案,使用 (HOG+Hu) 融合特征结合 SVM 分类器识别模型对少数民族服饰图腾图像的分类识别,民族服饰图案识别精度达到 89.3%常用的局部特征提取方法有 Harris 特征提取、SIFT 特征提取等,而在图像纹理特征提取方面则有局部二值模式特征、局部方向模式特征等。在特征处理与服饰识别方面,通过最优节点优先(BBF)算法将服饰图像中的 SIFT 特征和 SURF特征进行特征匹配点的确认。

ResNet网络

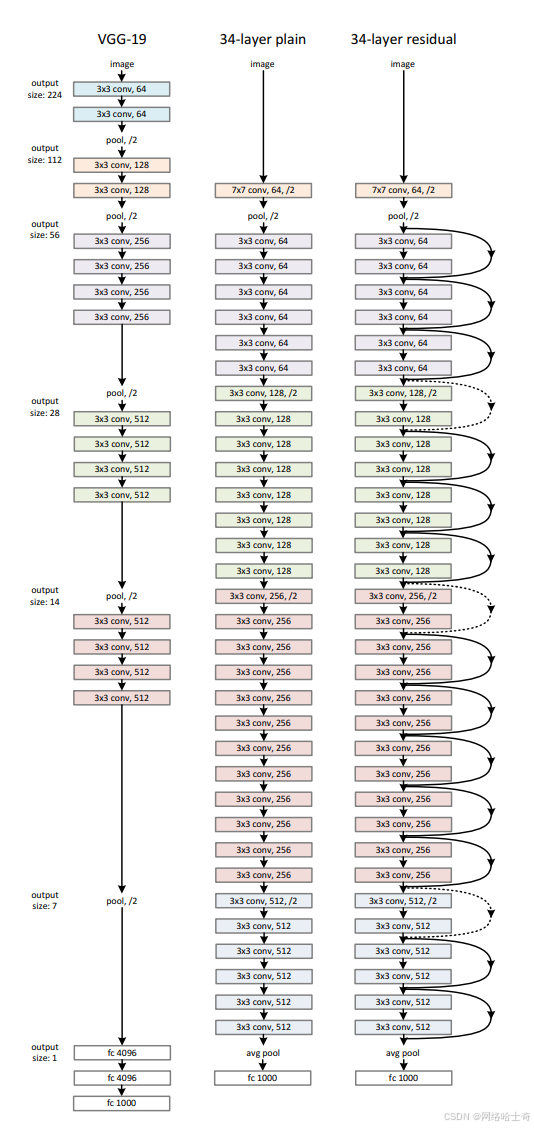

ResNet(Residual Network) 是一种深度卷积神经网络,由何凯明等人于 2015 年提出,并在图像分类领域取得了显著成果。ResNet 通过引入 残差连接(Residual Connections) 解决了传统深层神经网络中的梯度消失问题,成功训练出非常深的网络,在多个计算机视觉任务中表现出色。

1. ResNet 的基本思想

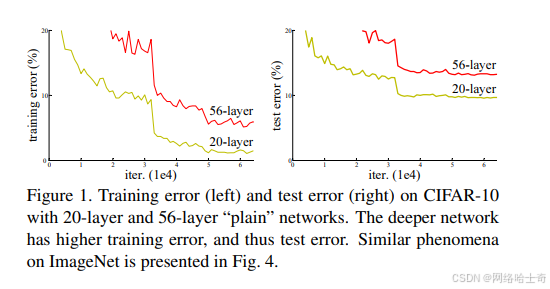

传统的神经网络随着网络层数的加深,梯度消失或梯度爆炸的问题愈加严重,导致模型训练困难,性能提升有限。ResNet 的核心创新点是 残差学习,通过增加 跳跃连接(skip connections),允许信息绕过几层神经网络直接传递给后续层。这种结构的好处是,即使深层网络中的某些层未能学习到有效特征,网络也能通过残差连接将输入的特征传递给后续层,减少信息丢失。

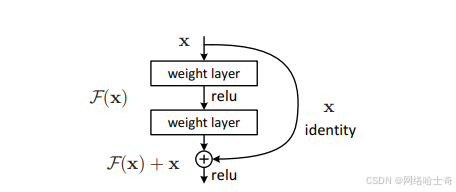

跳跃连接(Skip Connections): 将输入直接通过恒等映射(identity mapping)跳过若干层后与输出相加,从而形成一个“残差块”(Residual Block)

残差学习: 假设原始输入为 \( x \),通过网络学习到的表示为 \( F(x) \),那么残差块实际上学习的是 \( F(x) + x \),而不是仅学习 \( F(x) \)。这种设计降低了深层网络的训练难度。

2. ResNet 的网络结构

ResNet 网络由多个 残差块 组成,每个残差块都有一个跳跃连接,通常分为以下几部分:

卷积层: 进行特征提取,通常包括多个 3x3 或 1x1 卷积核的卷积操作。

批量归一化(Batch Normalization): 用于加速收敛,稳定训练过程。

激活函数: ReLU(Rectified Linear Unit) 用作激活函数,增强网络的非线性表达能力。

残差连接: 将输入跳跃传递,避免信息在深层网络中丢失。

ResNet 中有不同深度的版本,包括:

ResNet18: 含 18 层卷积层。

ResNet34: 含 34 层卷积层。

ResNet50: 含 50 层卷积层,使用了 1x1 卷积来降低维度。

ResNet101: 含 101 层卷积层。

ResNet152: 含 152 层卷积层,是最深的版本之一。

3. ResNet 的创新点

残差连接: 通过这种跳跃连接,ResNet 避免了梯度消失和梯度爆炸问题,使得更深的网络也能有效训练。传统的深层网络在深度超过 20 层时常常面临梯度消失的问题,ResNet 通过引入残差块成功训练出超过 100 层的网络。

简化网络的优化: 残差连接将深层网络的优化问题转化为对残差的学习问题,网络仅需学习对输入的微小调整,而不需要直接学习复杂的映射函数,这大大简化了优化过程。

4. ResNet 的优势

深度优势: ResNet 可以通过使用更深的网络结构来捕获复杂的特征模式,适合处理复杂的图像分类任务。

解决梯度消失问题: 通过残差连接,ResNet 有效解决了梯度消失问题,使得深层网络能够成功训练,并且提升了分类任务的精度。

广泛应用: ResNet 已成为计算机视觉领域的经典架构,并被广泛应用于图像分类、目标检测、图像分割等任务中。其变体(如 ResNeXt、SEResNet 等)进一步提升了模型性能。

5. ResNet 的变体

ResNeXt: 引入了组卷积&#x

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?