人体,很奇妙吧?人眼以及事件相机

一种新的传感器进入研究者们的视野:事件相机。本文对这种新玩意一探究竟,主要参考文献 Event-based Vision: A Survey1。限于笔者水平有任何错误欢迎指出和探讨。

如何看到你视网膜上的血管

当你在纸上画两个叉,间隔十到二十公分,闭上左眼,用右眼盯住左边那个叉,缓慢前后移动你的头,那么你就会在某一时刻右边的叉消失了。那就是你的盲点。

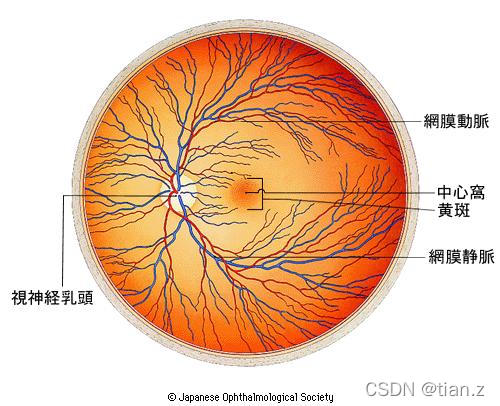

发现为什么我们的视野中存在盲点?因为我们的视网膜前端有着许多神经和血管,这些神经和血管连接着你的视锥细胞,负责把图像信号传进你的大脑。但我们的大脑和这些神经和血管还隔着一层视网膜,于是它们便穿过视网膜并留下了一个洞(视神经盘、视神经乳头)。

我们为什么看不见这些血管呢?因为我们的大脑只会对动的物体进行采样,而这些血管和视网膜是相对静止的,所以我们看不到它们。(而你无法控制你的眼球完全不动,所以你能看到所有可见光波段的静止物体!)

你用笔在一张纸上戳一个小洞,然后把小洞靠近眼睛,你的目光穿过小洞对着灯或者比较亮的屏幕并轻轻晃动纸,幅度不要超过小洞的直径,就能看到你视网膜上的血管!这是因为一束光从不同角度照射视网膜,血管的投影发生了移动。

灵感来源于这种原理,研究者们研制出了“事件相机”,这种相机有别于传统的CMOS器件,只会异步地输出亮度产生变化的像素点,称之为一个事件(event):

ϵ

=

(

x

i

,

y

i

,

t

i

,

p

i

)

\epsilon = (x_i,y_i,t_i,p_i)

ϵ=(xi,yi,ti,pi)

参数为坐标、时间戳、极性(从亮到暗还是从暗到亮)

事件相机

其实也不新了,早在2008年就已经商用。目前价格在五位数。

优势:高时间分辨率、低时延、超高动态范围(

140

d

B

140dB

140dB对比普通相机的

60

d

B

60dB

60dB)、低功耗。

第一代原型机在上世纪九十年代就被设计出来了,不过性能很差。现在Samsung、iniVation、CelePixel(国内厂商,现被韦尔半导体收购,而韦尔半导体也收购了豪威,并将二者合并)等厂商有产品推出。

一篇文章介绍了市面上能买到的事件相机。

传感器类型

- DVS :Dynamic Vision Sensor ,只提供事件信息

- ATIS :Asynchronous Time Based Image Sensor,除了事件信息还能提供绝对亮度

- DAVIS :Dynamic and Active Pixel Vision Sensor,能够提供事件信息和绝对亮度,比ATIS像素点更小,目前主流事件相机用此方案

应用

- 特征检测跟踪

- 光流估计

- 三维重建、姿态估计和SLAM :单个事件相机可以定深度,已有相关研究234

- 图像重建 Image Reconstruction

- 运功分割 Motion Segmentation

- 神经形态控制 Neuromorphic Control: 一个早期的演示用了两个DVS观测一支铅笔的三维姿态,铅笔放在一个小车上并使用一个手调的PID控制器实现了一个倒立摆。5

目前价格偏高的主要原因是设计成本高、经济不规模和良率问题。原文 : The high costs are due to non-recurring engineering costs for the silicon design and fabrication (even when much of it is provided by research funding) and the limited samples available from prototype runs.

思考

能不能用FPGA和CMOS模拟一个低成本低性能的事件相机?笔者认为这种模仿应该是没法模拟出事件相机的主要特性的,但我还是准备买一块FPGA在寒假的时候学一学玩一玩。

参考文献

Gallego G , Delbruck T , Orchard G M , et al. Event-based Vision: A Survey[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2020, PP(99):1-1. ↩︎

H. Rebecq, G. Gallego, E. Mueggler, and D. Scaramuzza, “EMVS:

Event-based multi-view stereo—3D reconstruction with an event

camera in real-time,” Int. J. Comput. Vis., vol. 126, no. 12, pp.

1394–1414, 2018. ↩︎H. Kim, S. Leutenegger, and A. J. Davison, “Real-time 3D reconstruction and 6-DoF tracking with an event camera,” in Eur. Conf.

Comput. Vis. (ECCV), 2016. ↩︎G. Gallego, H. Rebecq, and D. Scaramuzza, “A unifying contrast

maximization framework for event cameras, with applications

to motion, depth, and optical flow estimation,” in IEEE Conf.

Comput. Vis. Pattern Recog. (CVPR), 2018. ↩︎J. Conradt, M. Cook, R. Berner, P. Lichtsteiner, R. J. Douglas,

and T. Delbruck, “A pencil balancing robot using a pair of AER

dynamic vision sensors,” in IEEE Int. Symp. Circuits Syst. (ISCAS),

2009, pp. 781–784. ↩︎

事件相机是一种新型传感器,不同于传统的CMOS设备,它仅在亮度变化时输出像素点信息,具有高时间分辨率、低延迟和超高动态范围等优点。这种技术已应用于特征检测、光流估计、三维重建等领域。尽管目前价格较高,但其独特性能引发研究者的关注,未来有望降低成本并广泛应用。

事件相机是一种新型传感器,不同于传统的CMOS设备,它仅在亮度变化时输出像素点信息,具有高时间分辨率、低延迟和超高动态范围等优点。这种技术已应用于特征检测、光流估计、三维重建等领域。尽管目前价格较高,但其独特性能引发研究者的关注,未来有望降低成本并广泛应用。

1557

1557

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?