文章目录

多层感知机和激活函数

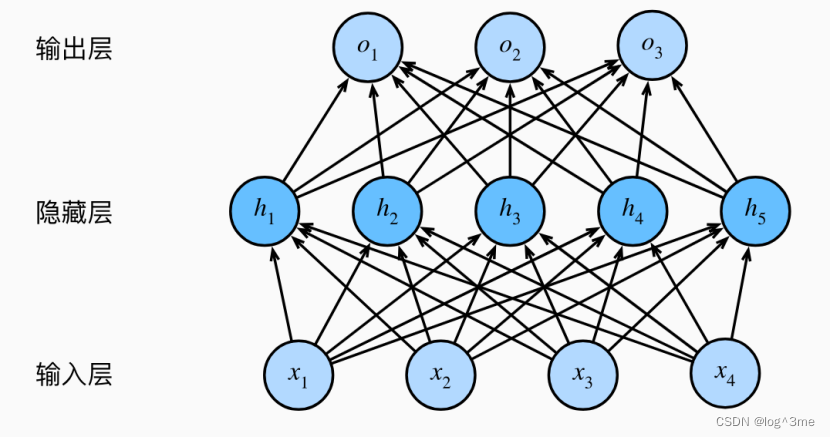

通过在网络中加入一个或多个隐藏层来克服线性模型的限制,使其能处理更普遍的函数关系类型。最简单的方法是将多个全连接层堆叠在一起。每一层都输出到上面的层,直到生成最后的输出,把最后一层看作线性预测器。这种架构通常称为多层感知机。

这个多层感知机有4个输入,3个输出,其隐藏层包含5个隐藏单元。输入层不涉及任何计算,只需要实现隐藏层和输出层的计算。这个多层感知机中的层数为2。这两个层都是全连接的。每个输入都会影响隐藏层中的每个神经元,而隐藏层中的每个神经元又会影响输出层中的每个神经元。

为了发挥多层架构,在仿射变换之后对每个隐藏单元应用非线性的激活函数。

激活函数(activation function)通过计算加权和并加上偏置来确定神经元是否应该被激活, 它们将输入信号转换为输出的可微运算。 常用激活函数:Sigmoid和ReLU

代码

代码如下(部分代码和问题和上篇文章中类似,可以参考上篇文章):

import torch

import torchvision

from torch.utils import data

from torchvision import transforms

from d2l import torch as d2l

from torch import nn

# 处理anaconda和torch重复文件

import os

os.environ["KMP_DUPLICATE_LIB_OK"] = "TRUE"

def get_dataloader_workers():

"""使用4个进程来读取数据"""

return 4

def load_data_fashion_mnist(batch_size, resize=None):

"""下载Fashion-MNIST数据集,然后将其加载到内存中"""

trans = [transforms.ToTensor()] # 把图片转换为pytorch tensor

if resize:

trans.insert(0, transforms.Resize(resize))

trans = transforms.Compose(trans)

mnist_train = torchvision.datasets.FashionMNIST(

root="D:/python_project/fashion-mnist-master/fashion-mnist-master/data/fashion",

train=True,

transform=trans,

download=False

)

mnist_test = torchvision.datasets.FashionMNIST(

root="D:/python_project/fashion-mnist-master/fashion-mnist-master/data/fashion",

train=False,

transform=trans,

download=False

)

return (data.DataLoader(mnist_train, batch_size, shuffle=True,

num_workers=get_dataloader_workers()),

data.DataLoader(mnist_test, batch_size, shuffle=False,

num_workers=get_dataloader_workers()))

# 第一层是隐藏层,它包含256个隐藏单元,并使用了ReLU激活函数。 第二层是输出层。

net = nn.Sequential(nn.Flatten(),

nn.Linear(784, 256),

nn.ReLU(),

nn.Linear(256, 10))

def init_weights(m):

# 初始化参数

if type(m) == nn.Linear:

nn.init.normal_(m.weight, std=0.01)

net.apply(init_weights)

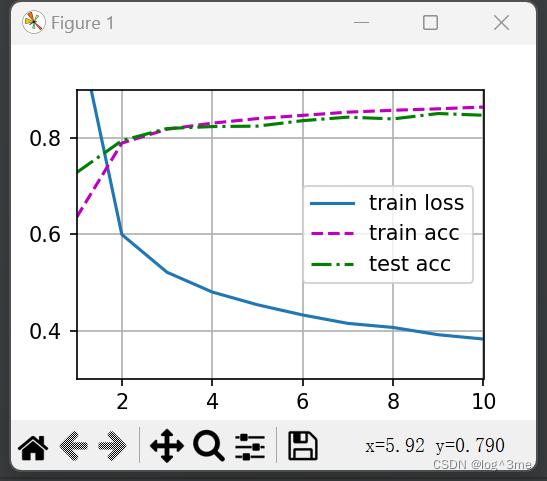

batch_size, num_epochs = 256, 10

loss = nn.CrossEntropyLoss()

trainer = torch.optim.SGD(net.parameters(), lr=0.1)

train_iter, test_iter = load_data_fashion_mnist(batch_size)

d2l.train_ch3(net, train_iter, test_iter, loss, num_epochs, trainer)

来源

b站 跟李沐学AI 动手学深度学习v2 10

1114

1114

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?