打卡第2天,通过MindSpore的API来快速实现一个简单的深度学习模型,实现手写数字识别。

1. 数据集处理

1.1 可以基于MindSpore提供的数据引擎Pipeline,采用数据集(Dataset)和数据变换(Transforms)实现高效的数据预处理。

1.2 对dataset使用数据处理流水线(Data Processing Pipeline),使用map对图像数据及标签进行变换处理,将输入的图像缩放为1/255,根据均值0.1307和标准差值0.3081进行归一化处理,然后将处理好的数据集打包为大小为64的batch。

1.3 使用create_tuple_iterator 或create_dict_iterator对数据集进行迭代访问,查看数据和标签的shape和datatype。

2. 网络构建

mindspore.nn类是构建所有网络的基类,也是网络的基本单元。当用户需要自定义网络时,可以继承nn.Cell类,并重写__init__方法和construct方法。__init__包含所有网络层的定义,construct中包含数据(Tensor)的变换过程。

class Network(nn.Cell):

def __init__(self):

super().__init__()

self.flatten = nn.Flatten()

self.dense_relu_sequential = nn.SequentialCell(

nn.Dense(28*28, 512),

nn.ReLU(),

nn.Dense(512, 512),

nn.ReLU(),

nn.Dense(512, 10)

)

def construct(self, x):

x = self.flatten(x)

logits = self.dense_relu_sequential(x)

return logits

model = Network()3. 模型训练

在模型训练中,一个完整的训练过程(step)需要实现以下三步:

-

正向计算:模型预测结果(logits),并与正确标签(label)求预测损失(loss)。

# 1. Define forward function def forward_fn(data, label): logits = model(data) loss = loss_fn(logits, label) return loss, logits -

反向传播:利用自动微分机制,自动求模型参数(parameters)对于loss的梯度(gradients)。

# 2. Get gradient function grad_fn = mindspore.value_and_grad(forward_fn, None, optimizer.parameters, has_aux=True) -

参数优化:将梯度更新到参数上。

# 3. Define function of one-step training def train_step(data, label): (loss, _), grads = grad_fn(data, label) optimizer(grads) return loss

4. 保存模型

使用save_checkpoint函数进行保存ckpt模型权重。

# Save checkpoint

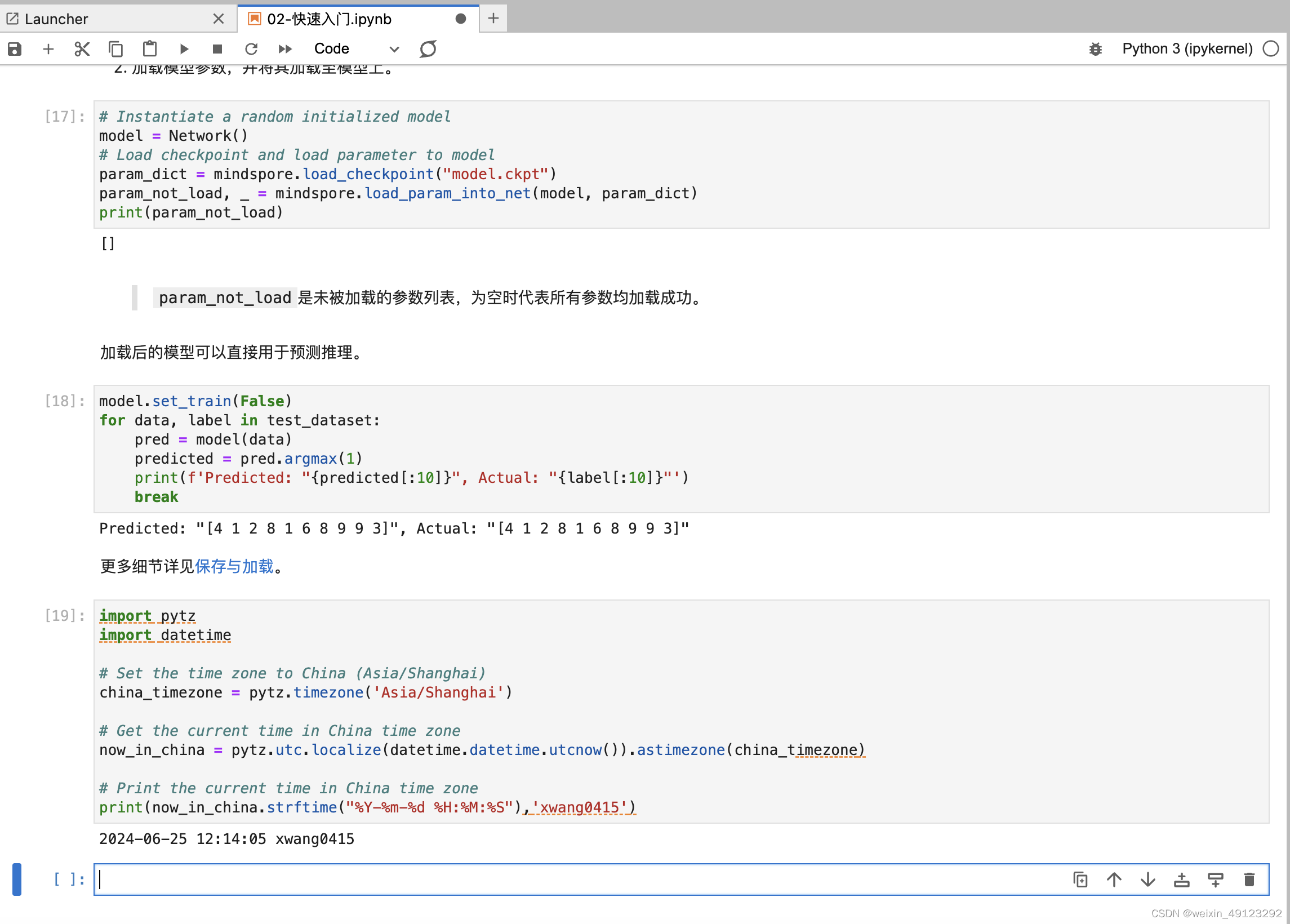

mindspore.save_checkpoint(model, "model.ckpt")5. 加载模型

加载保存的权重分为两步:

-

重新实例化模型对象,构造模型。

-

加载模型参数,并将其加载至模型上。

然后就可以进行推理

1046

1046

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?