文章简介

- 本文对VMamba进行了较为全面的综述,重点介绍了 Mamba 在各种可视化任务和数据类型中的应用,并探讨了它的发展变化

思维导图

Overview

由于自然语言与计算机视觉已逐渐形成融合趋势,将性能卓越的大型语言模型(LLM)Mamba 扩展到计算机视觉是一个极具吸引力的方向。Vim 是第一个处理密集预测任务的纯 SSM 模型,也是第一个将 SSM 应用于视觉领域通用背骨的模型。该框架解决了 Mamba 在处理图像序列时遇到的两个难题:建模的单一性和位置感知的缺乏。VMamba 提出了一种交叉扫描策略,以弥补一维阵列和二维序列扫描之间的差距。Mamba-ND 旨在将 Mamba 架构扩展到多维数据上的各种视觉任务,包括一维、二维和三维数据,以及更多其他视觉任务,如图像复原、红外小目标检测、点云等以及视频建模。这些成果发掘了曼巴的潜力,在视觉领域大有可为。

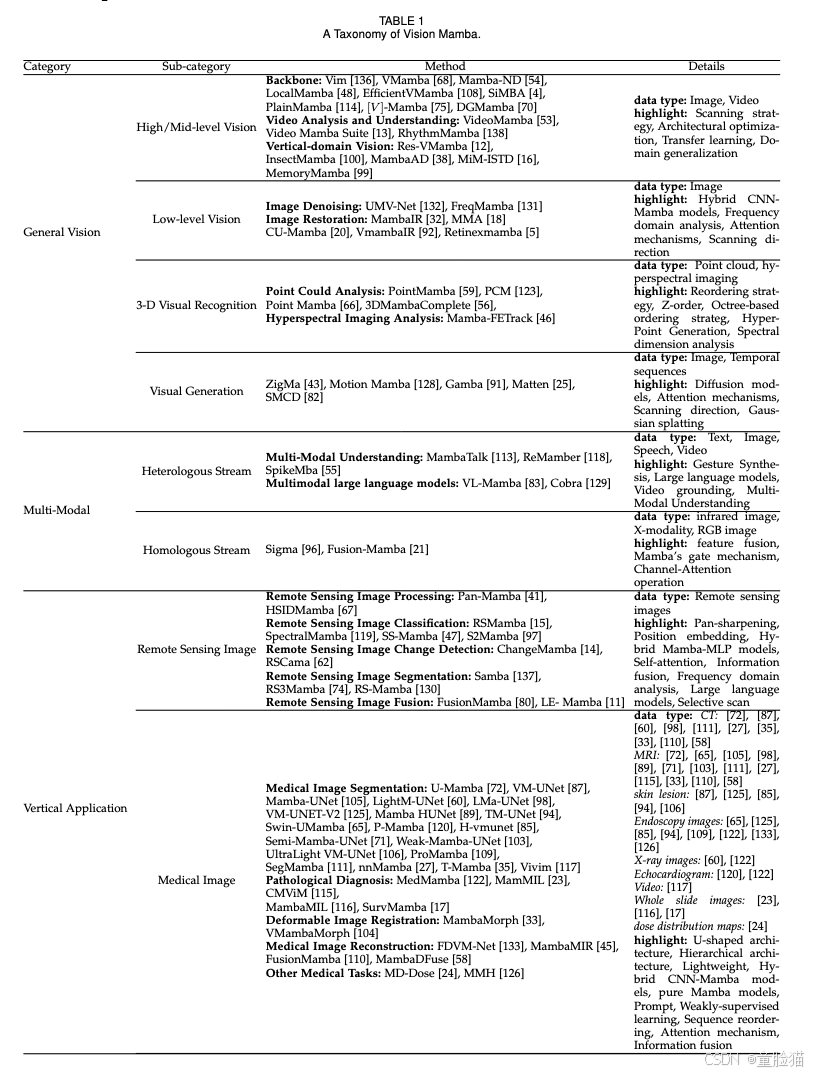

人们在 Mamba 架构的各个方面开展了大量工作, 以探索 SSM 在垂直域视觉任务中的应用。我们根据下游应用场景或任务对 Mamba 模型进行了分类,如下表所示。

主要包括一般视觉任务、多模态任务和垂直领域任务,其中垂直领域任务包括遥感图像分析和医学图像分析,一般视觉任务包括高级/中级视觉、低级视觉、三维视觉和多类型数据流。由于很难区分 Mamba 在高级视觉和中级视觉中的目标,我们将它们归为一类。低级视觉的典型任务包括图像处理、图像修复和图像生成。用于三维视觉的 Mamba 主要指用于三维视觉识别的点云分析。

SSM基本架构和原理

本章略,每篇讲Mamba的文章都会在相关基础知识的部分提一嘴Vanilla Mamba(原始Mamba模型)的结构,具体会在另一篇文章中进行详尽的解读和总结。

只需要知道:选择性机制使 Mamba 具备线性计算复杂度和长程依赖关系建模能力,硬件感知状态扩展则使其具有内存效率。凭借这两项关键技术,Mamba 在各种应用中展现出超越以往状态空间模型的巨大潜力。

一般视觉任务中的Mamba

本节回顾了 Mamba 及其变体在普通视觉中的应用, 包括高级/中级视觉、低级视觉和 3D 视觉。在接下来的小节中,我们将介绍针对每项任务重新设计的 Mamba 变体。考虑到选择性扫描策略在视觉任务中的重要性,我们在图 3 中进一步总结了现有的经典二维扫描机制。

用于高级/中级视觉的Mamba

使用Mamba的Vision Backbone

Mamba在语言建模场景中的成功促使研究人员利用先进的Mamba模型设计通用、高效的视觉主干。

Vim

Vim 提出了第一个纯基于 SSM 的模型来处理密集型预测任务。作者认为 SSM 在视觉应用中面临两大挑战:建模单向性和缺乏位置感知。为此,Vim 采用了双向 SSM 和位置嵌入技术。

如图 5 所示,为了处理视觉任务,它首先将多维图像 t ∈ R H × W × C t ∈ R^{H×W×C} t∈RH×W×C 转换为扩展的二维块 x p ∈ R J × ( P 2 ⋅ C ) x_p ∈ R^{J×(P^2·C)} xp∈RJ×(P2⋅C) ,其中 ( H , W ) (H, W) (H,W) 是输入图像的大小,C 是通道数,P 是图像块的大小。与 Transformer 的位置嵌入方法类似,Vim 将 x p x_p

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4570

4570

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?