最近要看一些推理攻击的内容,把看过的都放过来吧

One Parameter Defense—Defending Against Data Inference Attacks via Differential Privacy

参数防御——通过差分隐私防御数据推理攻击

TIFS 2022

一、论文信息

1. 题目

One Parameter Defense—Defending Against Data Inference Attacks via Differential Privacy

参数防御——通过差分隐私防御数据推理攻击

2. 作者

Dayong Ye , Sheng Shen, Tianqing Zhu ,Bo Liu,Wanlei Zhou

悉尼科技大学

3. 期刊年限

- TIFS

- IEEE TRANSACTIONS ON INFORMATION FORENSICS AND SECURITY

- 6.8

- 2022年

4. 关键词

Deep learning, data privacy, differential privacy

二、背景

- 模型对训练集预测结果较模拟结果而言,更有自信,攻击者可以利用这种置信度差异来确定给定的数据记录是否是目标模型训练数据集的成员。

- 攻击者可以训练攻击模型,仅使用置信度得分向量准确地重建输入数据记录,即使攻击模型从未见过该数据记录。 因此,防御数据推理攻击一直是隐私界关注的焦点

- 四种应对上述问题的方法(分析):正则化、对抗性示例(噪声加到置信度得分里面)、神经网络训练一个新的防御模型、差分隐私

- 上述应对方法都有或多或少的缺点,基于此进行改进

三、创新

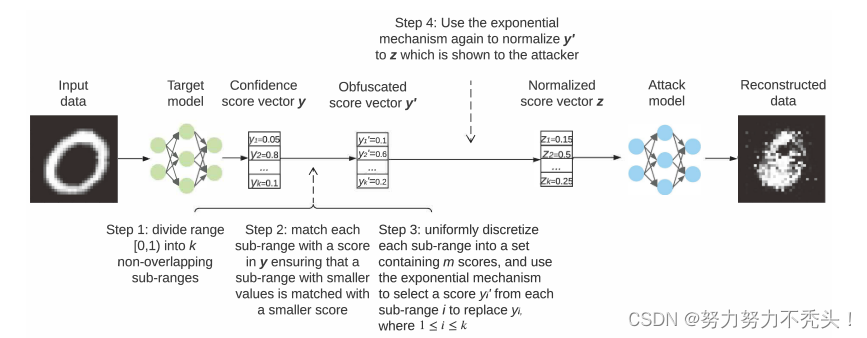

- 解决方案是一种差分隐私机制,可以修改和标准化置信度向量以迷惑攻击者的分类器

- 第一个单参数防御方法,该方法只需要调整一个参数,即隐私预算

- 有效性得到了验证

四、方法

五、实验部分

- 攻击模型和本地训练架构相同,只不过是逆转形式的

- [推理攻击的模型CNN]

- 采用的反演攻击方法:

- 对抗性模型反演攻击[5]:对手训练反演模型来推断输入数据记录的重建。 我们使用与[5]中相同的反演模型架构,它由四个转置的 CNN 块组成。 前三个块各有一个转置卷积层,后跟一个 sigmoid 激活函数,该函数将神经信号转换为 [0, 1] 中的实际值。

- 采用的反演攻击的模型:

- [5]:Z. Yang, J. Zhang, E. Chang, and Z. Liang, “Neural network inversion in adversarial setting via background knowledge alignment,” in Proc.CCS, London, U.K., Nov. 2019, pp. 225–240

1582

1582

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?