景深融合(Depth of Field Fusion,又称多焦点图像融合)是一种图像处理技术,用于将多张具有不同焦点的图像合成为一张全焦点图像。目的是在一张图像中同时获得所有焦点区域的清晰细节,避免单张图像由于景深限制而导致的某些区域模糊的问题。详细目的包括:图像锐化、提高几何校正精度、为立体摄影测量提供立体观测能力;增强原单一传感器图像数据中不明显的特征、改善检测、分类、理解、识别性能从而获取补充的图像数据信息、利用多时域数据序列检测场景与目标的变化情况、克服目标提取与识别中图像数据的不完整性等。当采用工业相机对显微镜的图像进行采集时,只有一定高度范围内的物体能在物镜的放大作用下获得清晰的成像,这个高度范围就是景深。而景深又分为几何景深和物理景深。

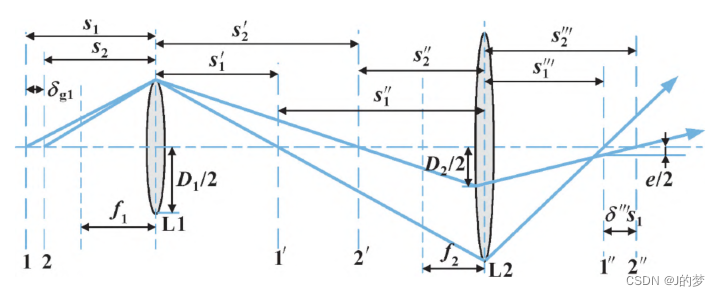

当观测物体刚好位于对准面时,成像会刚好位于相机CMOS接受面,而当观测物体位于对准面之前或之后时,相应的成像则也会位于相机CMOS接受面之前或之后,而此时在相机CMOS接收器上则形成一个弥散圆。当弥散圆直径等于相机CMOS极限分辨率时,此时的物平面距离对准面之间的距离就被定义为几何景深。下图为几何景深原理图。平面1为对准平面,1″为相机CMOS接受面,平面2为物平面,2″为像平面。

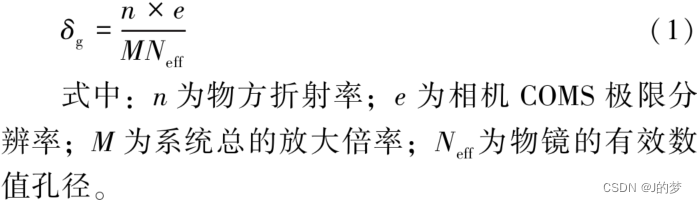

几何景深的计算公式为:

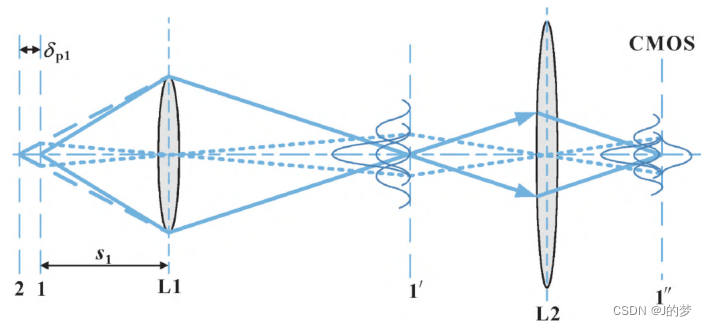

由于光的衍射效应,点光源经过透镜后在CMOS接受面上的成像会形成艾里斑,即一个三维的不同强度的光能分布。物理景深是指当物像移动距离引起的接收器上的光强变化不超过20%时的距离。下图为物理景深原理图:

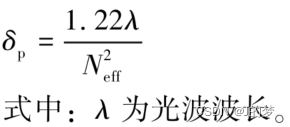

物理景深的计算公式为:

研究发现,由相机CMOS成像的显微镜系统的实际景深由下式计算得出:

研究发现,由相机CMOS成像的显微镜系统的实际景深由下式计算得出:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3147

3147

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?