摘要:我们建议从关系的角度通过元学习“观察什么”和“去哪里参加”来解决少镜头分类的问题。我们的方法通过自相关表示(SCR)和交叉相关注意(CCA)利用图像内和图像之间的关系模式。在每个图像中,SCR模块将基本特征图转换为自相关张量,并学习从张量中提取结构模式。在图像之间,CCA模块计算两个图像表示之间的互相关,并学习在它们之间产生共同注意。我们的关系嵌入网络(RENet)将两个关系模块结合起来,以端到端的方式学习关系嵌入。在实验评估中,它在四个广泛使用的少镜头分类基准(miniImageNet、tieredImageNet、CUB200-2011和CIF AR-FS)上实现了与最先进方法的一致改进

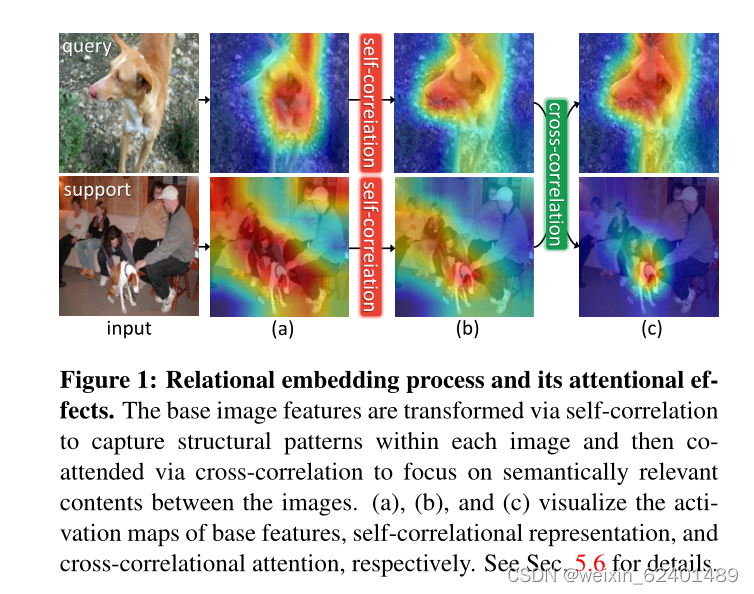

我们通过(1)自相关表示(SCR)和(2)交叉相关注意(CCA)利用图像内和图像之间的关系模式来实现这一目标。SCR模块将基本表示转换为其自相关张量,并学习从中提取结构模式。深度特征图的自相关通过将特征图的每次激活与其邻域相关联来编码丰富的语义结构。我们在此基础上进行表示学习,以使图像的相关结构模式脱颖而出(图1(a)→(b) )。另一方面,CCA模块计算两个图像表示之间的互相关,并从中学习产生一致性。互相关对两个图像之间的语义对应关系进行编码。我们在互相关张量上学习高维卷积,以通过卷积匹配对其进行细化,并基于查询和支持之间的语义关系产生自适应共注意(图1(b)→(c) )。

图1:关系嵌入过程及其注意力效应。通过自相关对基本图像特征进行转换以捕获每个图像内的结构模式,然后通过互相关对其进行叠加以关注图像之间的语义相关内容。(a) ,(b)和(c)分别可视化基本特征、自相关表示和交叉相关注意的激活图。详见第5.6节

我们建议学习少镜头分类的自相关表示,它可以提取图像中的可转移结构模式。•我们提出了用于少镜头分类的交叉相关注意力模块,该模块通过卷积滤波学习图像之间的可靠一致性。•在四个标准基准上的实验表明,我们的方法达到了最先进的水平,消融研究验证了组件的有效性。

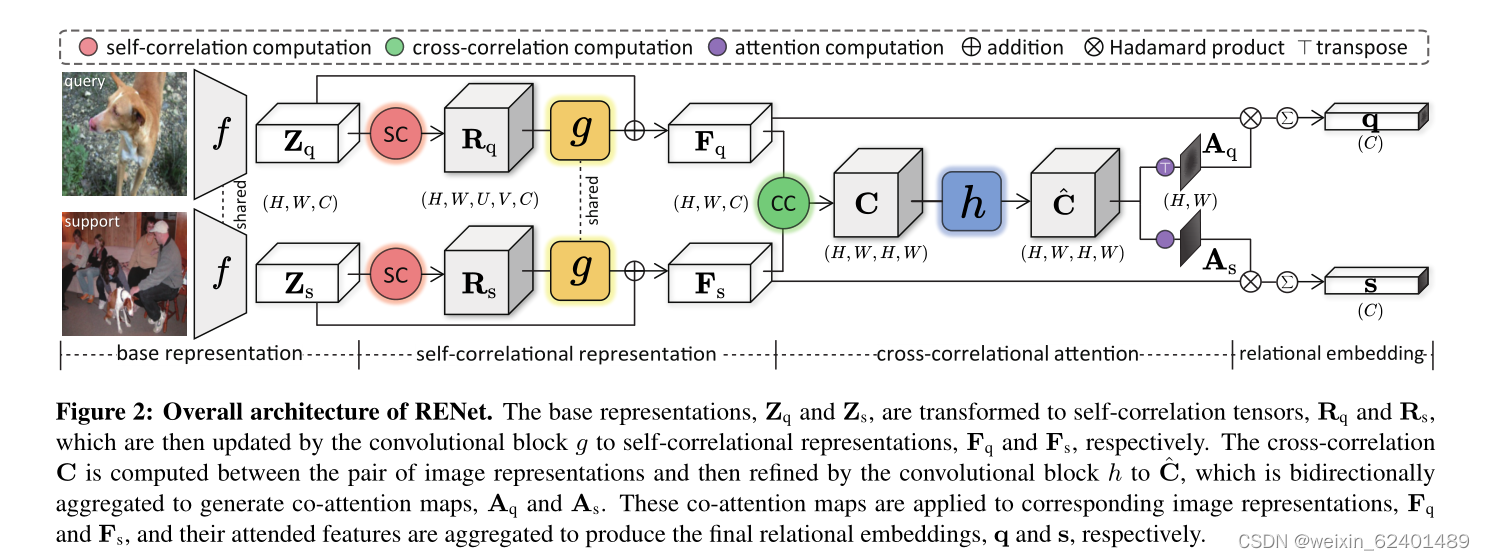

图2:RENet的总体架构。基本表示Zq和Zs被转换为自相关张量Rq和Rs,然后卷积块g将它们分别更新为自相关表示Fq和Fs。计算这对图像表示之间的互相关C,然后通过卷积块h将其细化为ŞC,双向聚合以生成共注意图Aq和As。这些共注意图被应用于相应的图像表示Fq和Fs,并且它们的关注特征被聚合以生成最终的关系嵌入q和s,分别地

方法:给定一对查询和一个支持图像Iq和Is,骨干特征提取器提供基本表示Zq和Zs∈RH×W×C。SCR模块通过以卷积方式分析图像表示中的特征相关性,将基本表示转换为自相关表示,Fq和Fs∈RH×W×C。然后,CCA模块采用自相关表示来生成共注意图,Aq和As∈RH×W,它们给出了将Fq和Fs聚合到图像嵌入的空间注意权重,q和s∈RC。图2所示的过程并行应用于所有支持图像is∈S,然后将查询分类为其最近支持嵌入的类。

6407

6407

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?