一、过拟合

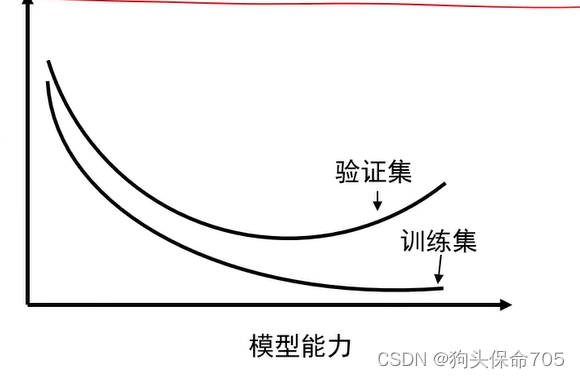

定义:学习时选择的模型中参数过多,导致对训练数据集表现效果很好,但是在测试集上表现得很差的现象,即模型的泛化能力很弱,并没有评估能力。

二、解决过拟合问题

1.使验证集和训练集的损失值都比较小,输出验证集和训练集误差值都达到极小值的参数,该参数泛化能力优化能力都较好。

最优方案:获取更多的训练数据

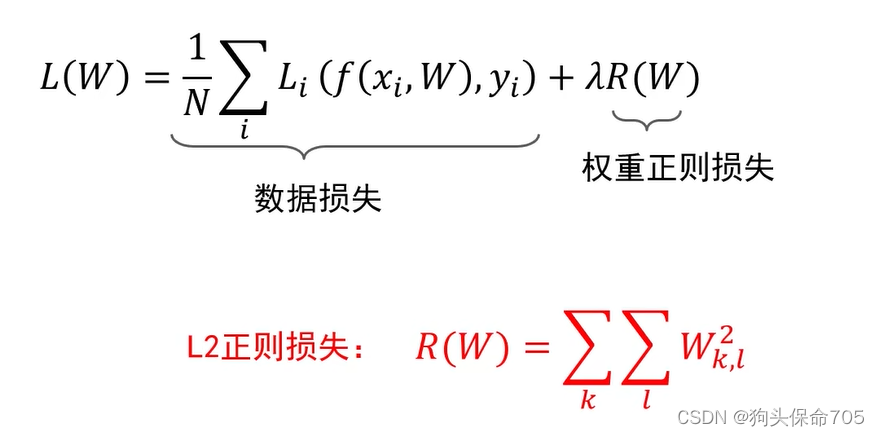

次优方案:调节模型允许存储的信息量,或者对模型允许存储的信息加以约束,这类方案被称为正则化。

(1)L2正则化

对大数值的权值向量进行严厉惩罚,鼓励更分散的权值向量,提高模型的泛化能力。

(2)随机失活(Dropout)

定义:让隐层中的神经元以一定概率不被激活。

实现方式:在某一层中使用Dropout,即将该层的输出值进行一部分的随机的舍弃,将该部分输出设置为0。

失活比例(Dropout ratio):被设为0的特征所占比例,通常在范围0.2-0.5之间。

原理

(1)将一部分特征设置为0,相当于减少了神经网络中参与计算的参数(参数乘以特征,值为0),降低了模型的容量。

(2)随机失活鼓励权重均匀分配,具体原理如下:

下述神经网络中,假设标红的2个神经元起主要作用,如果通过随机失活使2个神经元失效,那么这个神经网络就起不到作用了。因此,为了在随机失活后神经网络仍能起到作用,应该使每个神经元的参数均匀分配。

(3)Dropout可看作模型集成

3888

3888

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?