一.决策树

决策树是一种基本的机器学习算法,它通过对数据集进行递归地划分,构建一个树形结构来进行分类和预测。在决策树中,每个内部节点代表一个属性测试,每个分支代表一个测试结果,而每个叶节点代表一种分类结果或预测结果。

决策树的主要优点包括:

1. **易于理解和解释**:决策树可以直观地表示分类过程,易于人们理解和解释,因此被广泛应用于各个领域。

2. **适用于各种数据类型**:决策树可以处理离散型和连续型数据,以及多分类问题。

3. **能够处理大型数据集**:决策树算法的时间复杂度通常为数据集的对数阶,因此能够处理大型数据集。

4. **具有特征选择能力**:决策树能够自动选择重要特征,从而减少了特征工程的工作量。

然而,决策树也有一些缺点:

1. **容易过拟合**:决策树容易过于复杂,导致过拟合问题,特别是当树的深度很大或者训练数据噪声较多时。

2. **对数据的不稳定性敏感**:小的数据变化可能会导致生成完全不同的树,因此决策树对数据的不稳定性敏感。

3. **可能产生不平衡的树**:决策树的生成算法有时倾向于生成高度倾斜的树,这可能会导致一些类别的分类效果不佳。

决策树算法有多种变体,包括ID3、C4.5、CART等,它们在树的构建和剪枝等方面有所不同,但基本思想都是相似的。

二.如何构建决策树

构建决策树的一般步骤如下:

1. **选择特征**:从训练数据集中选择一个最佳的特征作为根节点。

2. **划分数据集**:根据所选择的特征将数据集划分成子集,使得每个子集中的样本属于同一类别或具有相似的特征。

3. **递归构建子树**:对每个子集重复步骤1和步骤2,递归地构建决策树的子树。

4. **停止条件**:在构建过程中,需要定义停止条件,例如树的深度达到预定值、节点中的样本数量小于某个阈值等。

5. **剪枝**:在决策树构建完成后,可以对树进行剪枝操作,减少过拟合的风险。

下面是构建决策树的一般算法流程:

### ID3算法(基于信息增益)

1. 计算数据集的熵(Entropy)或基尼不纯度(Gini Impurity)。

2. 对每个特征,计算其信息增益(Information Gain)或基尼不纯度的减少量。

3. 选择信息增益(或减少基尼不纯度)最大的特征作为当前节点的划分特征。

4. 根据该特征的取值将数据集划分成子集。

5. 对每个子集,重复步骤1到步骤4,直到满足停止条件。

6. 构建完整的决策树后,对树进行剪枝操作,以防止过拟合。

### CART算法(分类与回归树)

CART算法可以用于分类问题和回归问题,其构建过程与ID3算法类似,但是划分的标准不同。在分类问题中,CART算法使用基尼不纯度来选择最佳划分特征和划分点;在回归问题中,CART算法使用平方误差最小化准则来选择最佳划分特征和划分点。

### C4.5算法

C4.5算法是ID3算法的改进版,它使用信息增益比来选择最佳划分特征,同时可以处理缺失值。

以上是构建决策树的一般方法和常用算法。在实际应用中,可以根据具体情况选择适合的算法,并对其进行调参和优化。

三.部分代码实现

from sklearn.tree import DecisionTreeClassifier

# 定义训练数据

X = [

[0, 0, 0, 0], # 青年,无工作,无房,一般信贷

[0, 0, 0, 1], # 青年,无工作,无房,好信贷

[1, 0, 0, 1], # 中年,无工作,无房,好信贷

[2, 1, 0, 1], # 老年,有工作,无房,好信贷

[2, 2, 1, 1], # 老年,有工作,有房,好信贷

[2, 2, 1, 2], # 老年,有工作,有房,非常好信贷

[1, 2, 1, 2], # 中年,有工作,有房,非常好信贷

[0, 1, 0, 1], # 青年,有工作,无房,好信贷

[0, 2, 1, 2], # 青年,有工作,有房,非常好信贷

[2, 1, 1, 2] # 老年,有工作,有房,非常好信贷

]

y = [0, 1, 1, 1, 1, 1, 1, 1, 1, 0]

# 创建决策树模型

clf = DecisionTreeClassifier()

# 使用训练数据训练模型

clf.fit(X, y)

# 定义函数用于预测贷款下发情况

def predict_loan(age, has_job, has_house, credit):

# 将输入特征转换成模型需要的格式

input_features = [[age, has_job, has_house, credit]]

# 使用模型进行预测

prediction = clf.predict(input_features)

if prediction[0] == 0:

return "不下发贷款"

else:

return "下发贷款"

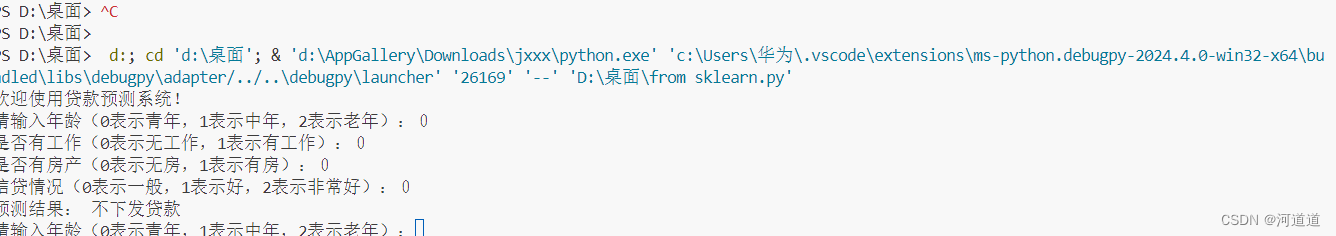

# 定义函数用于获取用户输入

def get_input():

age = input("请输入年龄(0表示青年,1表示中年,2表示老年):")

has_job = input("是否有工作(0表示无工作,1表示有工作):")

has_house = input("是否有房产(0表示无房,1表示有房):")

credit = input("信贷情况(0表示一般,1表示好,2表示非常好):")

return int(age), int(has_job), int(has_house), int(credit)

# 主函数,用于交互和测试

def main():

print("欢迎使用贷款预测系统!")

while True:

try:

age, has_job, has_house, credit = get_input()

result = predict_loan(age, has_job, has_house, credit)

print("预测结果:", result)

except ValueError:

print("输入有误,请重新输入。")

if __name__ == "__main__":

main()

这次实验主要涉及了以下几个方面:

1. 决策树模型:使用了Python中的scikit-learn库中的DecisionTreeClassifier来构建和训练了一个决策树模型。决策树是一种基于树结构的机器学习算法,适用于分类和回归任务。

2. 数据预处理:对示例数据进行了预处理,包括将文本标签转换为数值标签,以便模型能够处理。

3. 用户交互:编写了交互式程序,允许用户输入自己的数据,然后使用训练好的决策树模型来预测贷款情况。

4. 功能完善:通过函数封装,提高了代码的可复用性和可扩展性,使得程序更加完整和实用。

这个实验展示了如何使用决策树模型来进行简单的贷款预测,并通过用户交互的方式使得程序更加灵活和可操作。

本文介绍了决策树作为一种机器学习算法在贷款预测中的应用,包括决策树的构建原理、优点与缺点,以及Python中的sklearn库实现。重点展示了如何通过ID3、C4.5和CART算法训练模型,处理数据预处理和用户交互功能。

本文介绍了决策树作为一种机器学习算法在贷款预测中的应用,包括决策树的构建原理、优点与缺点,以及Python中的sklearn库实现。重点展示了如何通过ID3、C4.5和CART算法训练模型,处理数据预处理和用户交互功能。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?