目录

TensorRT是英伟达公司给N卡开发的一个推理加速代码,因此,要使用TrnsorRT需要具备两个条件:1.需要有GPU。2.GPU需要是英伟达的卡。此外,TensorRT有C++版本与python版本,下面介绍一下python版本的TensorRT安装。

TensorRT安装(Windows10)

安装TensorRT之前,需要先先安装CUDA以及CUDNN,这一部分的安装不属于本文内容,参考方法。

(1)查询安装的CUDA版本

在cmd中运行nvidia-smi,查看驱动版本,如下面的图,我的版本是12.2,然后百度一下与你的CUDA对应的TensorRT版本,在这里看。

(2)下载TensorRT

然后去官网下载对应版本的TensorRT,下载完成之后解压下载的文件,就会看到如下的几个文件

将这个文件里的lib文件拷贝到cuda的lib文件夹下,具体路径参考下面的路径。

此外,需要将include、bin、lib等路径添加到系统路径中。bin中的trtexec.exe文件用于将各种格式的权重转换为tenrotRT所支持的.engin文件。

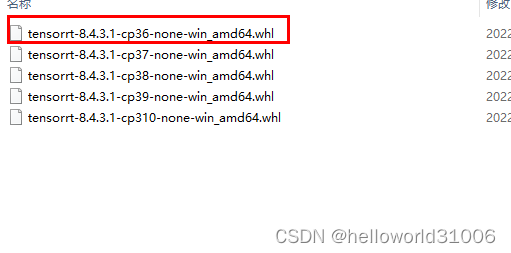

进入上述的python路径,会看到如下的安装包

在python环境中,进行pip安装即可。

推理加速实验

本文基于YOLOv8n,测试了在推理一张图片时,使用TensorRT与不使用TensorRT的推理时间区别

实验结果如下:

| 平台 | 推理时间(S) |

| CPU(opencv) | 1.02787 |

| GPU | 1e-3 |

| GPU+TensorRT | 3.7e-4 |

找合作

智妍工作室招合作:

工作室微信号:hello_world_uuu

工作室微信号二维码:

合作内容包括:计算机视觉AI算法设计、虚拟人定制、详情请移步淘宝店铺,或加工作室微信私聊。

624

624

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?