代码生成——CodeX (OpenAI)

最近非常火的OpenAI的Copilot背后的模型。文章35页,58位作者,6位共同一作。

顺理成章的,把模型做的再大一点,训练数据集做的再大一些,计算资源再多一些,就可以生成更长的代码。这篇文章做的事情就是把GPT模型应用在代码生成上,具体来说输入函数的签名和注释(prompt),告诉模型这个函数要做什么事情,然后模型输出实现代码。

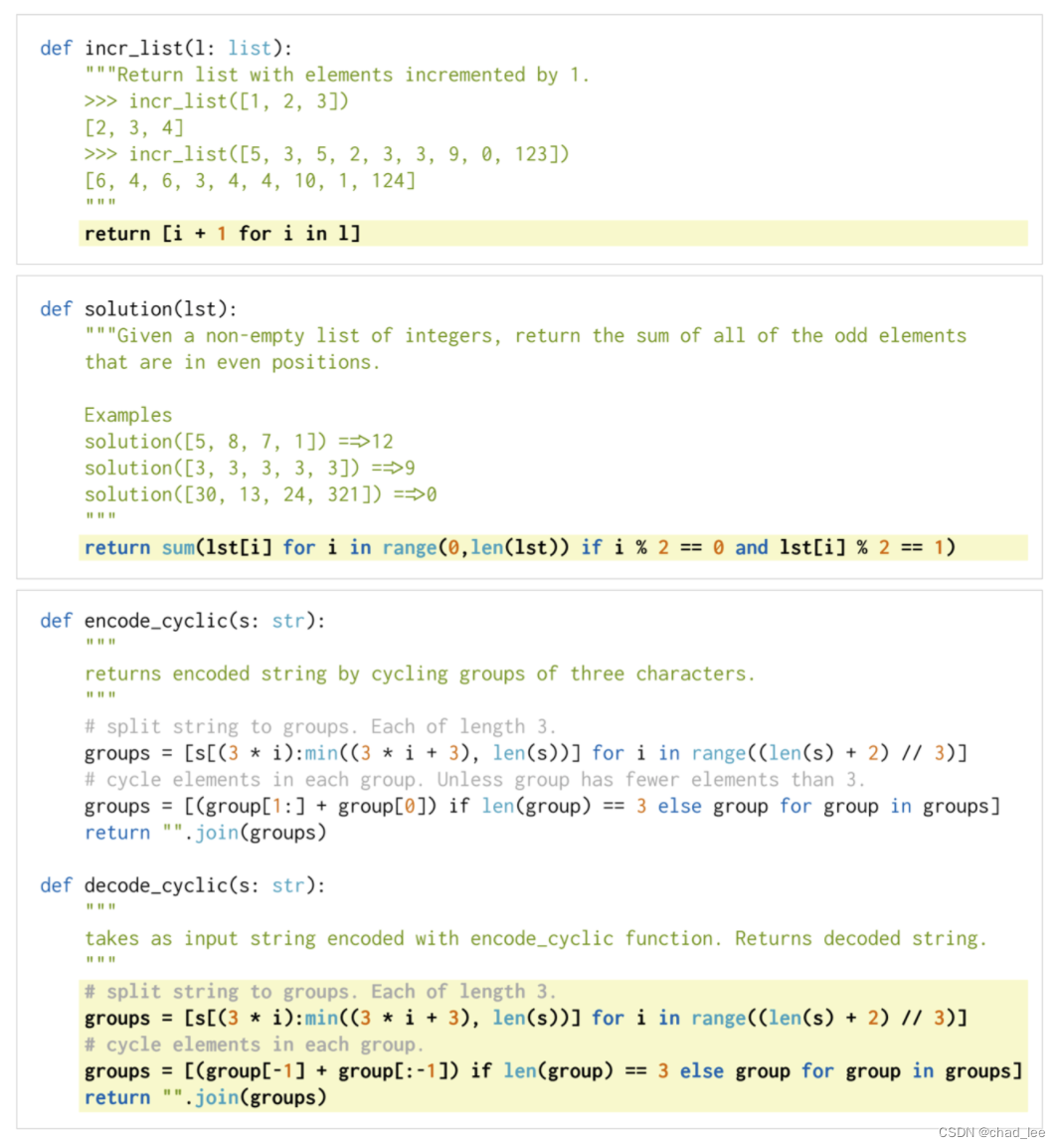

这里有三个示例,白色背景的是 prompt,黄色背景的是模型补全的代码。

想完成这件事情其实很难,有很多工作要做,所以这篇文章有58个作者,6个共同一作。

评测模型

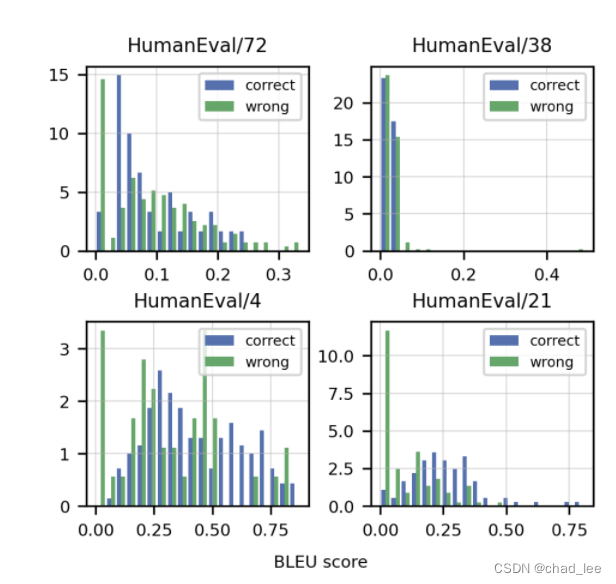

首先要有一个方法能够评测模型的能力。这里虽然是一个将注释 “翻译”成代码的任务,但是不能用BLEU指标来衡量质量,这是因为基于匹配的方法即使代码语义相近,但是不能评价代码功能的正确性。所以论文将代码功能的正确性作为评测指标,具体来说是用单元测试的方法<

CodeX尝试了从头训练和基于GPT-3的参数fine-tuning,结果发现基于GPT-3的参数fine-tuning并没有取得效果上的提升,但基于GPT-3的参数fine-tuing可以收敛的更快,因此,论文中都采用的是这种训练策略。CodeX是在Github的159GB的代码文本上无监督的训练的,论文造了一个和HumanEval数据集格式一致的SupervisedFine-Tuning数据集,在这个数据集上fine-tuning后的模型效果更好。这点想的有点科幻了。...

CodeX尝试了从头训练和基于GPT-3的参数fine-tuning,结果发现基于GPT-3的参数fine-tuning并没有取得效果上的提升,但基于GPT-3的参数fine-tuing可以收敛的更快,因此,论文中都采用的是这种训练策略。CodeX是在Github的159GB的代码文本上无监督的训练的,论文造了一个和HumanEval数据集格式一致的SupervisedFine-Tuning数据集,在这个数据集上fine-tuning后的模型效果更好。这点想的有点科幻了。...

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3451

3451

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?