PointRCNN

Key Knowledgeable:

-

Foreground point segmentation.

利用PointNet++网络学习语义特征,实现前景与背景分割。并将语义特征与前景点信息传递 -

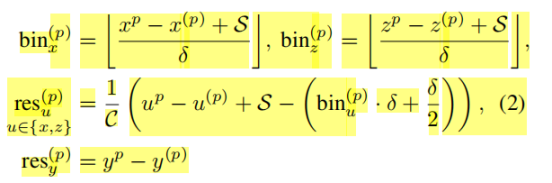

Bin-based 3D bounding box generation.

每个前景点以自己为中心在X,Z平面上建立刻度为δ,范围为[-S,S]的坐标,预测3DBox的刻度数bin(整数)与偏移量res(小数),将原本的偏移量回归学习任务转为了bin的分类任务+偏移量的回归任务。采用这些方法,模型在训练过程中能够更快收敛。

转换过程(公式理解):

将S作为偏置,就可以将任务转为0到floor(2S/δ)的一个分类任务,表示需要走多少个δ。并算出x、z对应的映射到整数产生的小数偏移量,y的范围比较小则不需要采用上述方法。

+δ/2?:是否为将偏移量值域从[0,δ)改为[-δ/2,δ/2),减少回归难度?

Loss:

之后每个前景点都产生了一个对应的3D Bounding box,使用NMS保留300(100)个proposals,这是每个前景点预测的proposals,后续根据全局特征与局部特征进一步回归出box。 -

Point cloud region pooling

将proposals尺寸略微扩大(为了提取更多点的特征?)

同一个bi内的点有特征:坐标点信息、反射强度、前背景点信息。 -

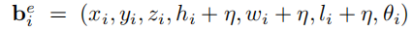

Canonical 3D bounding box refinement

为每个proposal建立一个坐标系:

(1)坐标系的原点为proposal的中点;

(2)X和Z轴与水平地面平行。且X轴为proposal朝向的位置;

(3)Y轴水平向下;并将原雷达坐标系的信息通过平移和旋转转到对应的proposal坐标系中。

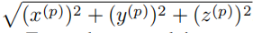

并对每个点建立深度信息弥补坐标系刚体转换损失的深度信息。

对每个bi经过MLP进行特征提取:坐标点信息、反射强度、前背景点信息、深度信息得到局部特征。 -

Merged Features

将局部特征与之前得到的全局语义特征堆叠融合作为精细定位的特征用于proposals的进一步定位与置信度的预测。

-

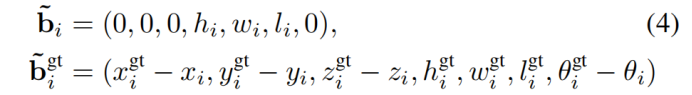

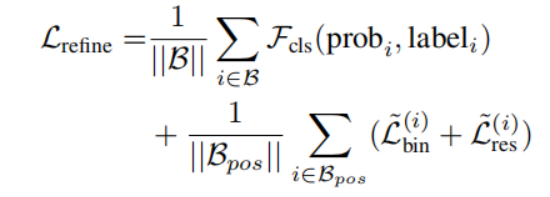

Losses for box proposal refinement

将IoU>0.55的gt bbox转换到对应的坐标系下,仍然是采用了bin-res的方法根据bi的信息进一步回归出box。

另外,为了获得更准确的朝向估计,考虑到proposal和gt bbox的IOU>0.55,因此作者假设预测角度和真实朝向的范围 ,将S设为Π/2,刻度为w进行角度的bin-res的分类回归预测。

,将S设为Π/2,刻度为w进行角度的bin-res的分类回归预测。

最后将loss合并:

1556

1556

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?