该项目利用yolov5+reid实现的行人重识别功能,可做跨视频人员检测。

应用场景:

可根据行人的穿着、体貌等特征在视频中进行检索,可以把这个人在各个不同摄像头出现时检测出来。可应用于犯罪嫌疑人检索、寻找走失儿童等。

已更新内容:

1.reid训练

2.继续训练和微调训练

3.冻结训练

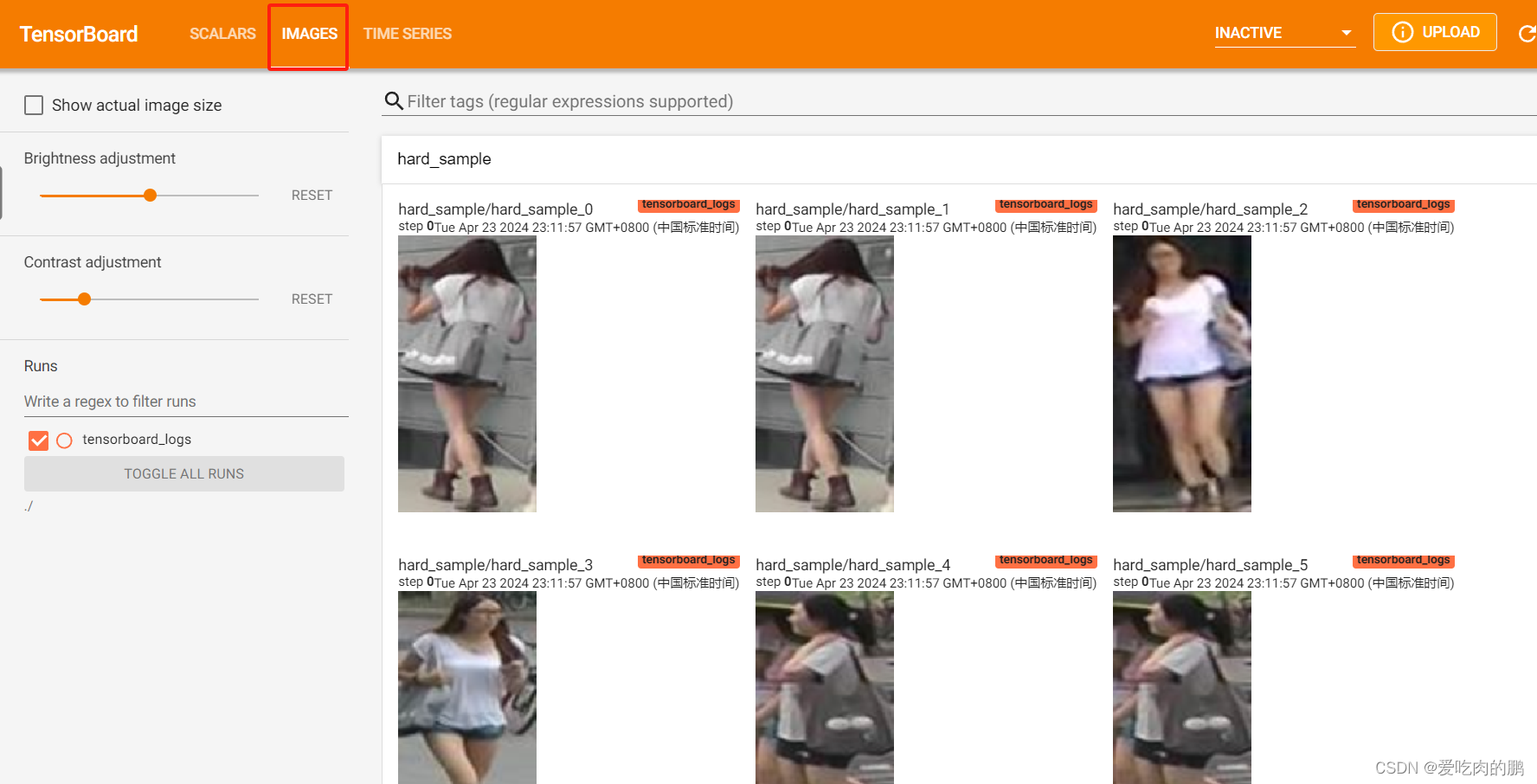

4.tensorboard可视化(已支持评价指标、困难样本可视化)

5.评价指标复现测试

6.人员标注

7.人员查找(可做跨视频人员检测)

8.可使用reid应用程序直接执行(暂时只支持windows系统)

环境说明:

matplotlib>=3.2.2

numpy>=1.18.5

opencv-python>=4.1.2

Pillow>=7.1.2

PyYAML>=5.3.1

requests>=2.23.0

scipy>=1.4.1

torch>=1.7.0

torchvision>=0.8.1

tqdm>=4.41.0pytorch-ignite=0.4.11

目录

Reid训练

ps:Reid理论部分参考:Reid理论视频参考课程

项目支持多网络,如resnet50, resnet50_ibn_a, se_resnext50等主干网络。

train.py训练可选参数 :

参数说明:

--config_file: 配置文件路径,默认configs/softmax_triplet.yml

--weights: pretrained weight path

--neck: If train with BNNeck, options: bnneck or no

--test_neck: BNNeck to be used for test, before or after BNNneck options: before or after

--model_name: Name of backbone.

--pretrain_choice: Imagenet

--IF_WITH_CENTER: us center loss, True or False.

--resume:继续训练

配置文件的修改:

(注意:项目中有两个配置文件,一个是config下的defaults.py配置文件,一个是configs下的yml配置文件,一般配置yml文件即可,当两个配置文件参数名相同的时候以yml文件为主,这个需要注意一下)

configs文件:

以softmax_triplet.yml为例(其中softmax_triple.yml是配置文件(里面包含了训练epochs,学习率,优化器等参数配置)

SOLVER:

OPTIMIZER_NAME: 'Adam' # 优化器

MAX_EPOCHS: 120 # 总epochs

BASE_LR: 0.00035

IMS_PER_BATCH: 8 # batchCHECKPOINT_PERIOD: 1 # 权重保存周期

LOG_PERIOD: 1 # 日志周期

EVAL_PERIOD: 1 # 测试周期,测map

TEST:

IMS_PER_BATCH: 4 # test batch

RE_RANKING: 'no'

WEIGHT: "path" # test weight path

FEAT_NORM: 'yes'

OUTPUT_DIR: "/logs" # model save path

下载代码后输入:

python tools/train.py --config_file configs/softmax_triplet.yml MODEL.DEVICE_ID "('0')" DATASETS.NAMES "('market1501')" DATASETS.ROOT_DIR "(r'./data')或直接输入以下命令:

python tools/train.py输入命令后打印如下:

=> Market1501 loaded

Dataset statistics:

----------------------------------------

subset | # ids | # images | # cameras

----------------------------------------

train | 751 | 12936 | 6

query | 750 | 3368 | 6

gallery | 751 | 15913 | 6

----------------------------------------

Loading pretrained ImageNet model......

2023-02-24 21:08:22.121 | INFO | engine.trainer:log_training_loss:194 - Epoch[1] Iteration[19/1484] Loss: 9.194, Acc: 0.002, Base Lr: 3.82e-05

2023-02-24 21:08:22.315 | INFO | engine.trainer:log_training_loss:194 - Epoch[1] Iteration[20/1484] Loss: 9.156, Acc: 0.002, Base Lr: 3.82e-05

2023-02-24 21:08:22.537 | INFO | engine.trainer:log_training_loss:194 - Epoch[1] Iteration[21/1484] Loss: 9.119, Acc: 0.002, Base Lr: 3.82e-05

训练好的权重会自动保存在logs下。

中断后的继续训练或微调训练

如果训练意外终止,或者希望继续训练,可以适用本功能。只需要传入--resume参数即可

python tools/train.py --weights 【your weight path】 --resume注意:在训练期间会保存两种格式,一个是mAP_xx_model_model_name.pth,一个是mAP_xx_optimizer_model_name.pth。后者保存的是训练期间优化器等参数。【不建议修改保存的名字,因为训练期间会根据权重名字自动加载优化器权重】。保存如下:

冻结训练

新增冻结训练,加快网络前期训练速度。

训练中只需传入:--freeze --freeze_epoch 20即可,其中--freeze表示是否开启冻结训练,--freeze_epoch是冻结训练后的epoch,这里默认为20,那么网络会在前20个epoch冻结训练,从21个epoch开始解冻训练

示例如下:

python tools/train.py --weights your weight path --freeze --freeze_epoch 20测试

输入以下命令即可快速开启测试,获得测试结果

【此脚本是针对训练后的模型单独获得测试结果,例如mAP、Rank等指标】

python tools/test.py --weights weights/ReID_resnet50_ibn_a.pth测试结果如下:

Validation Results

mAP: 92.0%

CMC curve, Rank-1 :97.2%

CMC curve, Rank-5 :99.1%

CMC curve, Rank-10 :99.5%

人员标注

可将视频中嫌疑人(特定人员),可以运行person_search/get_query.py,按住鼠标左键不放,拖动进行人员款选标注,标注后的人员会自动保存在query文件中(命名格式为markt1501),按空格键继续播放视频。

也可以直接将图像放在query文件中,但名字也需要按mark1501命名。

人员查找(yolov5+Reid)

参数说明:

--weights: yolov5权重路径

--source: video/file/ path

--data: data/coco128.yaml

--imgsz: 输入图像大小,默认(640,640)

--conf_thres:置信度阈值

--iou_thres:iou阈值

--classes:过滤的类

--half:半精度推理

--dist_thres:reid对比的距离阈值(小于该阈值判断为同一个人)

--save_res:保存视频图像

python search.py --weights yolov5s.pt --source 0 --dist_thres 1.5

如果需要检测视频或者多视频(跨视频检测),需要指定source路径。

代码:

git clone https://github.com/YINYIPENG-EN/yolov5_reid.git权重下载:

检测:将 ReID_resnet50_ibn_a.pth放在👂person_search/weights文件下,yolov5s.pt放person_search下

训练:将 r50_ibn_2.pth,resnet50-19c8e357.pth放在yolov5_reid/weights下

注意:训练和检测(person_search)是两个独立的项目!!

链接:百度网盘 请输入提取码 提取码:yypn

Reid应用程序

福利来啦~2024.5.1本项目做了重大更新,已将本项目生成exe应用程序直接执行,让操作更便捷,脱离繁琐的代码~

有很多代码基础比较差的同学在使用项目的时候会私信我说不太会用,或者不会配置深度学习环境,因此我将GUI检测部分的代码和人员标注功能分别导成了exe应用程序。哪怕你的电脑没有安装python、pytorch、cuda,也照样可以使用本项目,只需双击exe就可以轻松实现reid啦~(不支持跨平台)

不过本部分为有偿提供~

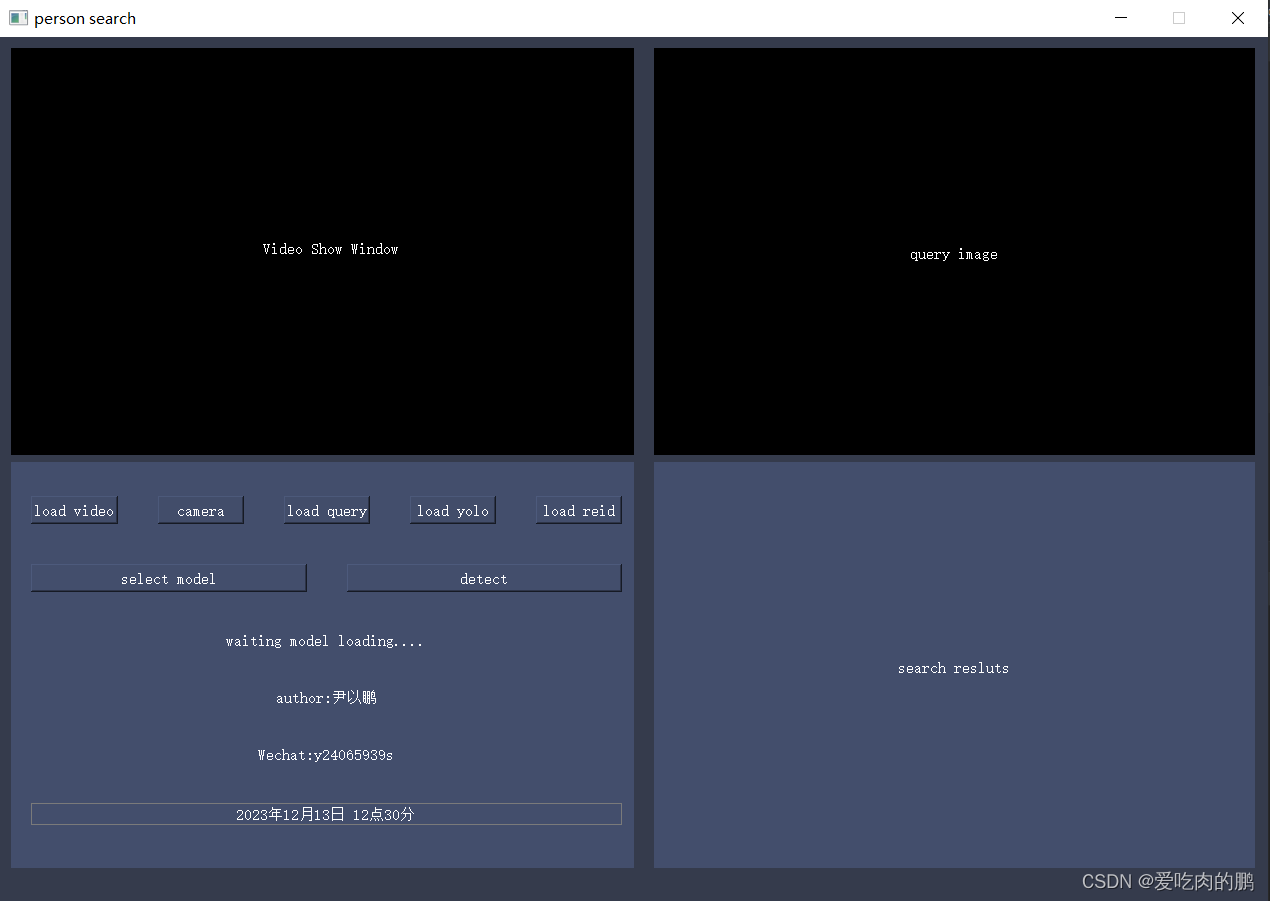

下载程序到本地后,如下图所示:

本项目包含了两个exe应用程序,get_query.exe和Search_GUI.exe。

人员标注应用程序(get_query.exe)

1.get_query.exe是用来标注人员的应用程序,可直接双击打开,默认打开的是demo.mp4文件,如果需要指定其他的视频,那么可以打开cmd,输入命令:

get_query.exe --video_path xxx.mp4在跳出的视频画面中可以用鼠标直接框选人物(建议这里只选一个人),程序会自动将截图以markt1501格式保存到query文件中,按键盘空格键会继续播放视频。按键盘q键退出程序。如下图所示:

Reid应用程序

可直接双击Search_GUI.exe,将会显示Reid GUI界面。此时只需在界面上加载好权重和视频,最后点击检测即可。效果图:

说明

开发不易,本项目部分功能有偿提供(请按需购买)。联系方式可扫描本末二维码添加,或直接微信搜索:y24065939s。

1.训练核心代码

有偿训练代码有两种:含tensorboard与不含tensorboard(价格不一样,与旧版本相比均支持继续训练)

tensorboard包含(loss、acc、mAP、Rank、lr)曲线的可视化。

需要安装:

protobuf==3.20.0

tensorboardX==2.6.2.2

开启tensorboard命令(需要在conda的pytorch环境下进行):

cd logs/

tensorboard --logdir=./tensorboard效果图如下:

2024.4.24 tensorboard更新记录:

tensorboard中新增加hard sample的可视化,效果如下:

2.已加入GUI界面,效果如下(该部分有偿提供):

pyqt需要安装:

PyQt5 5.15.9

pyqt5-plugins 5.15.9.2.3

PyQt5-Qt5 5.15.2

PyQt5-sip 12.11.0

pyqt5-tools 5.15.9.3.3qt5-applications 5.15.2.2.3

qt5-tools 5.15.2.1.3

QtPy 2.1.0

3.Reid应用程序为收费内容

详细效果和说明可见Reid应用程序章节。

后续将不断更新针对reid代码的详解。请持续关注。

Reid训练代码之数据集处理:reid数据集处理代码详解

3533

3533

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?