目录

1. 什么是 GAN?

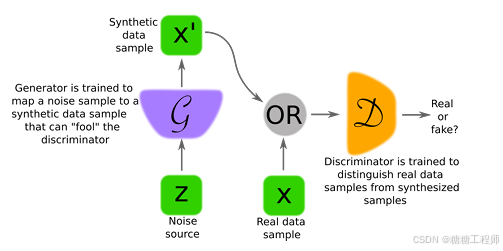

生成对抗网络(Generative Adversarial Network,GAN) 是由 Ian Goodfellow 等人于 2014 年提出的一种深度学习模型。GAN 的核心思想是通过两个神经网络的对抗训练来生成逼真的数据。这两个网络分别是:

-

生成器(Generator):生成假数据。

-

判别器(Discriminator):区分真实数据和生成器生成的假数据。

GAN 在图像生成、图像修复、风格迁移等领域取得了显著成果。

2. GAN 的基本原理

生成器(Generator)

生成器的作用是从随机噪声中生成假数据。它的目标是生成足够逼真的数据,以欺骗判别器。

判别器(Discriminator)

判别器的作用是区分输入数据是真实的还是生成的。它的目标是尽可能准确地区分真实数据和假数据。

对抗过程

GAN 的训练过程是一个对抗过程:

-

生成器生成假数据。

-

判别器对真实数据和假数据进行分类。

-

通过反向传播,生成器学习生成更逼真的数据,判别器学习更准确地区分数据。

3. GAN 的数学原理

GAN 的目标是最小化以下损失函数:

![]()

其中:

-

D(x)D(x) 是判别器对真实数据的输出。

-

G(z)G(z) 是生成器生成的假数据。

-

D(G(z))D(G(z)) 是判别器对假数据的输出。

生成器的目标是最大化判别器对假数据的误判概率,而判别器的目标是最大化对真实数据和假数据的正确分类概率。

4. GAN 的实现

以下是一个简单的 GAN 实现示例,使用 PyTorch 框架。

代码示例

import torch

import torch.nn as nn

import torch.optim as optim

from torchvision import datasets, transforms

from torch.utils.data import DataLoader

# 定义生成器

class Generator(nn.Module):

def __init__(self, latent_dim, img_shape):

super(Generator, self).__init__()

self.model = nn.Sequential(

nn.Linear(latent_dim, 128),

nn.LeakyReLU(0.2),

nn.Linear(128, 256),

nn.LeakyReLU(0.2),

nn.Linear(256, 512),

nn.LeakyReLU(0.2),

nn.Linear(512, img_shape),

nn.Tanh()

)

def forward(self, z):

return self.model(z)

# 定义判别器

class Discriminator(nn.Module):

def __init__(self, img_shape):

super(Discriminator, self).__init__()

self.model = nn.Sequential(

nn.Linear(img_shape, 512),

nn.LeakyReLU(0.2),

nn.Linear(512, 256),

nn.LeakyReLU(0.2),

nn.Linear(256, 1),

nn.Sigmoid()

)

def forward(self, img):

return self.model(img)

# 超参数

latent_dim = 100

img_shape = 28 * 28

lr = 0.0002

batch_size = 64

epochs = 200

# 初始化网络

generator = Generator(latent_dim, img_shape)

discriminator = Discriminator(img_shape)

# 优化器

optimizer_G = optim.Adam(generator.parameters(), lr=lr)

optimizer_D = optim.Adam(discriminator.parameters(), lr=lr)

# 损失函数

criterion = nn.BCELoss()

# 数据加载

transform = transforms.Compose([transforms.ToTensor(), transforms.Normalize((0.5,), (0.5,))])

dataset = datasets.MNIST(root='./data', train=True, transform=transform, download=True)

dataloader = DataLoader(dataset, batch_size=batch_size, shuffle=True)

# 训练过程

for epoch in range(epochs):

for i, (imgs, _) in enumerate(dataloader):

# 真实数据

real_imgs = imgs.view(imgs.size(0), -1)

real_labels = torch.ones(imgs.size(0), 1)

# 生成假数据

z = torch.randn(imgs.size(0), latent_dim)

fake_imgs = generator(z)

fake_labels = torch.zeros(imgs.size(0), 1)

# 训练判别器

optimizer_D.zero_grad()

real_loss = criterion(discriminator(real_imgs), real_labels)

fake_loss = criterion(discriminator(fake_imgs.detach()), fake_labels)

d_loss = real_loss + fake_loss

d_loss.backward()

optimizer_D.step()

# 训练生成器

optimizer_G.zero_grad()

g_loss = criterion(discriminator(fake_imgs), real_labels)

g_loss.backward()

optimizer_G.step()

# 打印损失

if i % 100 == 0:

print(f"[Epoch {epoch}/{epochs}] [Batch {i}/{len(dataloader)}] "

f"[D loss: {d_loss.item()}] [G loss: {g_loss.item()}]")5. GAN 的变体与应用

GAN 的变体

-

DCGAN(深度卷积 GAN):使用卷积神经网络改进生成器和判别器。

-

WGAN(Wasserstein GAN):通过 Wasserstein 距离改进训练稳定性。

-

CycleGAN:用于图像风格迁移。

-

StyleGAN:生成高分辨率、高质量图像。

GAN 的应用

-

图像生成(如人脸生成、风景生成)。

-

图像修复(如去除水印、修复老照片)。

-

风格迁移(如将照片转换为油画风格)。

-

数据增强(生成更多训练数据)。

6. 总结

GAN 是一种强大的生成模型,通过生成器和判别器的对抗训练,能够生成逼真的数据。本文介绍了 GAN 的基本原理、数学公式、实现代码以及变体和应用。希望这篇博文能帮助你更好地理解 GAN,并为你的项目提供灵感。

参考资料

1046

1046

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?