目录

前言

📅大四是整个大学期间最忙碌的时光,一边要忙着备考或实习为毕业后面临的就业升学做准备,一边要为毕业设计耗费大量精力。近几年各个学校要求的毕设项目越来越难,有不少课题是研究生级别难度的,对本科同学来说是充满挑战。为帮助大家顺利通过和节省时间与精力投入到更重要的就业和考试中去,学长分享优质的选题经验和毕设项目与技术思路。

🚀对毕设有任何疑问都可以问学长哦!

选题指导:

大家好,这里是海浪学长毕设专题,本次分享的课题是

🎯基于机器学习的土地裂缝图像分割方法

设计思路

一、课题背景与意义

土地裂缝是一种常见的地质灾害现象,对土地安全和人类生活造成了严重威胁。准确地进行土地裂缝图像分割可以帮助地质工程师和环境专家及时识别、定位和监测土地裂缝,从而采取有效的防护和修复措施。传统的土地裂缝图像分割方法通常依赖于人工特征提取和手动标注,存在效率低下和主观性强的问题。基于机器学习的土地裂缝图像分割方法的研究具有重要的现实意义。通过结合深度学习和计算机视觉技术,可以实现自动化的土地裂缝图像分割,提高分割准确性和效率,为地质灾害的预防和治理提供科学依据。

二、算法理论原理

2.1 目标检测算法

二阶段目标检测算法如SSD和YOLO系列算法在目标检测中先生成候选区域,然后利用CNN对这些候选区域进行分类和定位。这种算法耗费大量时间在生成候选区域的阶段,但只需要一次检测就能获得目标图像的类别置信度和区域信息。相比之下,一阶段目标检测算法省略了生成候选区域的步骤,直接通过一次检测得到目标的类别置信度和区域信息。

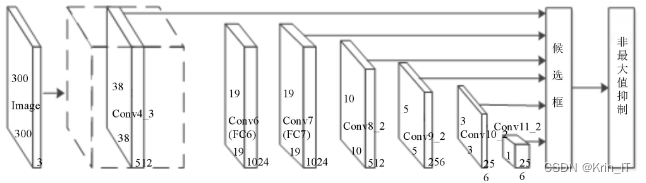

SSD算法是一种代表作,它由三个主要组成部分构成:基础网络层、辅助网络层和预测层。SSD模型使用VGG16作为基础网络层,其中包含用于分类的全连接层。辅助网络层连接基础网络层,通过卷积网络输出高尺度的特征映射图。最后,预测层对特征映射图进行预测,生成目标的类别概率并计算目标类别概率和定位边界框。SSD模型通过减少网络参数数量和采用先进的原理,有效地改进了目标检测。它具有重要的意义对于目标检测领域的发展。

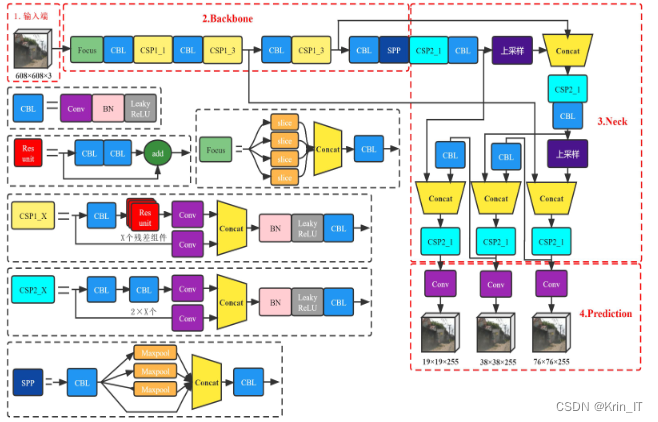

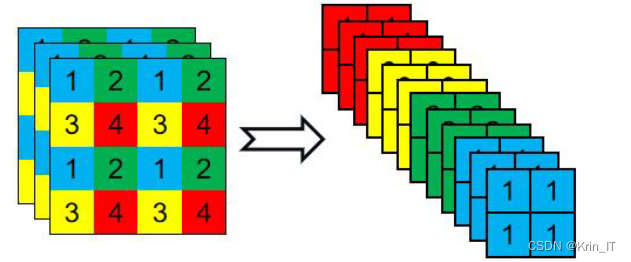

YOLOv5s是一种目标检测算法,具有快速的检测速度和适合在移动设备上部署的特点。它采用了Mosaic数据增强方法,通过对图像进行多种缩放、裁剪等操作并拼接在一起作为输入,提高了数据集的丰富性和鲁棒性。为了适应不同的数据集,YOLOv5s使用自适应锚框计算,并通过反向传播算法对网络参数进行迭代更新。

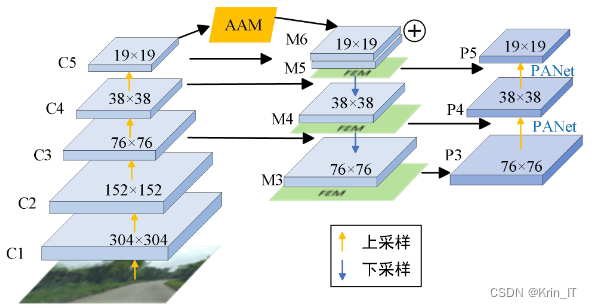

在骨干网络方面,YOLOv5s采用了CSPDarknet53作为其Backbone结构,结合了CSP模块来提取图像不同层次的特征信息。CSP模块通过跨阶段层次结构合并特征映射,减少梯度信息重复导致的推理计算量,并提升检测速度。此外,YOLOv5s还使用了SPP层进行空间金字塔池化,通过对局部特征和全局特征进行多尺度融合,提高了特征图的表达能力和检测精度。

为了加强对不同大小目标检测的能力,YOLOv5s采用了路径聚合网络(PANet)作为Neck结构。PANet通过加速信息流与整合多种层级特征,增强了对Backbone的表征能力,提升了目标检测的性能。

YOLOv5s的Prediction部分采用了多种方法来处理检测到的对象,其中主要包括在对象周围绘制矩形框并显示概率。Prediction部分由标准卷积模块组成,用于降低维度并提取特征。激活函数方面,YOLOv5s采用了Leaky ReLU函数,以缩短训练时间、缓解梯度消失问题并提高模型的鲁棒性。

2.2 注意力机制

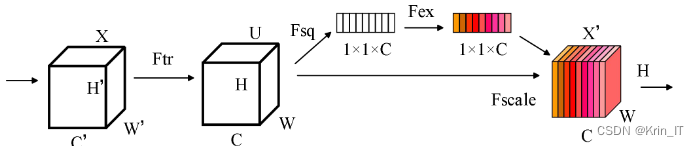

SE通道注意力模块是一种用于提取图像特征的注意力机制,它能够对特征图中的通道进行自适应权重的调整。SE模块主要分为两个步骤:Squeeze和Excitation。

-

Squeeze(压缩):在这一步骤中,SE模块通过全局平均池化操作将输入的特征图进行压缩,将其从三维张量压缩为一维向量。这样做的目的是为了减少计算量和参数数量。

-

Excitation(激发):在这一步骤中,SE模块使用全连接层将压缩后的特征向量映射到一个更高维度的表示。然后,通过激活函数(如sigmoid或ReLU)对每个通道的权重进行建模,使得模型可以学习到每个通道在特征表示中的重要性。

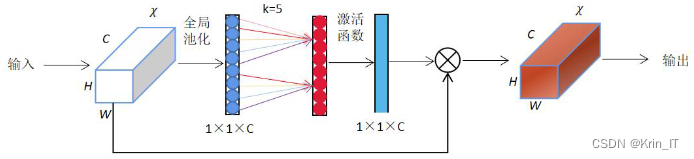

ECA通道注意力模块是一种用于增强特征表示的注意力机制,它能够通过自适应地调整特征图中通道之间的关系来提高模型的性能。ECA模块的核心是一个一维卷积操作,该操作用于建模特征图中通道之间的依赖关系。通过在每个通道上进行一维卷积,ECA模块可以学习到每个通道的权重,以便更好地捕捉特征图中的关键信息。与SE模块不同,ECA模块没有Squeeze和Excitation两个阶段,而是通过一维卷积操作直接对特征图中的通道进行建模。这样可以减少模块的复杂性和计算量,同时具有较好的性能提升效果。

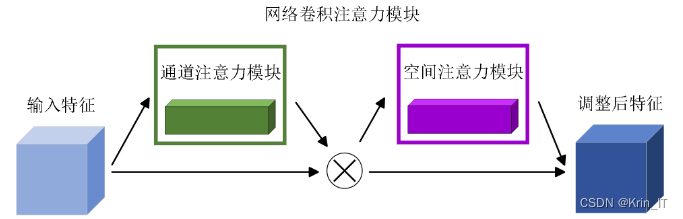

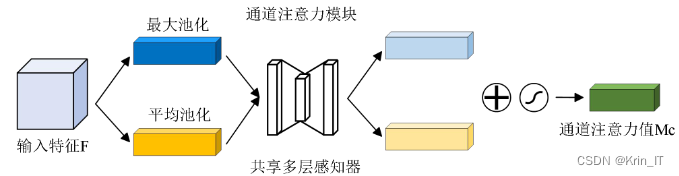

CBAM通道注意力模块是一种综合利用空间注意力和通道注意力的注意力机制,它能够同时关注特征图中的空间维度和通道维度,提升模型的表达能力和性能。CBAM模块主要由两个部分组成:通道注意力和空间注意力。

-

通道注意力:通道注意力通过利用SE模块或其他通道注意力机制,对特征图中的通道进行加权,以捕捉不同通道的重要信息。

-

空间注意力:空间注意力通过对特征图进行空间维度上的注意力操作,可以在不同空间位置上关注不同的特征信息。一种常用的空间注意力机制是空间金字塔池化(Spatial Pyramid Pooling),它通过对不同大小的感受野进行池化操作,捕获不同尺度的特征信息。

空间注意力通过对特征图进行空间维度上的注意力操作,可以在不同空间位置上关注不同的特征信息。一种常用的空间注意力机制是空间金字塔池化(Spatial Pyramid Pooling),它通过对不同大小的感受野进行池化操作,捕获不同尺度的特征信息。首先,对输入的特征图沿着通道轴方向进行平均池化和最大池化操作,然后将结果连接起来生成有效的特征描述符,得到H×W×2的特征图。最后,通过标准卷积层对连接的结果进行卷积操作,并通过激活函数得到最终的H×W×1的空间注意特征图。这样可以在空间维度上对不同位置的特征进行加权,提高模型对关键区域的关注能力。

三、检测的实现

3.1 数据集

为了支持土地裂缝图像分割模型的训练和评估,决定自制一个全新的数据集。在多个地理区域收集了大量土地裂缝图像,并进行了图像预处理和标注。通过现场拍摄和地质专家的协助,能够捕捉到真实的土地裂缝场景和多样的环境背景。这个自制的数据集包含了各种不同类型和程度的土地裂缝图像,以及与土地裂缝相关的地质信息。通过这个自制的数据集,能够提供更准确、可靠的数据基础,为土地裂缝图像分割方法的研究和应用提供有力的支持。相信这个自制的数据集将为土地工程和环境保护领域的发展做出积极的贡献。

在训练过程中对原始数据进行一系列变换和扩充的技术,旨在增加训练样本的多样性,提高模型的泛化能力。通过引入不同的变换和扩充操作,可以生成更多的训练样本,从而增加数据集的大小。常见的数据增强操作包括图像翻转、旋转、缩放、裁剪、平移、亮度调整、对比度调整、颜色变换等。

datagen = ImageDataGenerator(

rotation_range=20, # 随机旋转角度范围

width_shift_range=0.2, # 随机水平平移范围

height_shift_range=0.2, # 随机垂直平移范围

shear_range=0.2, # 随机错切变换范围

zoom_range=0.2, # 随机缩放范围

horizontal_flip=True, # 随机水平翻转

vertical_flip=True # 随机垂直翻转

)

train_dataset = tf.keras.preprocessing.image_dataset_from_directory(

'path_to_train_directory',

image_size=(224, 224),

batch_size=32

)

# 对训练数据进行数据增强

augmented_train_dataset = train_dataset.map(lambda x, y: (datagen.flow(x, batch_size=32), y)).unbatch()在模型训练过程中,训练集用于模型的参数更新和优化,验证集用于模型的评估和调整超参数,测试集用于最终模型的性能评估。常见的数据集划分方法包括随机划分和分层划分。随机划分是将数据集随机分成训练集、验证集和测试集,可以根据具体需求设置划分比例。分层划分是根据数据集中不同类别的样本进行划分,可以保证训练集、验证集和测试集中都包含各类别的样本,从而更加公平地评估模型的性能。

train_size = int(0.8 * len(augmented_train_dataset))

val_size = int(0.1 * len(augmented_train_dataset))

test_size = len(augmented_train_dataset) - train_size - val_size

train_dataset = augmented_train_dataset.take(train_size)

val_dataset = augmented_train_dataset.skip(train_size).take(val_size)

test_dataset = augmented_train_dataset.skip(train_size + val_size).take(test_size)

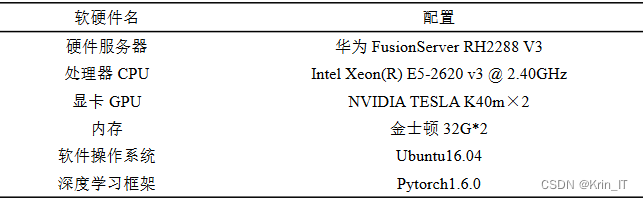

3.2 实验环境搭建

3.3 实验及结果分析

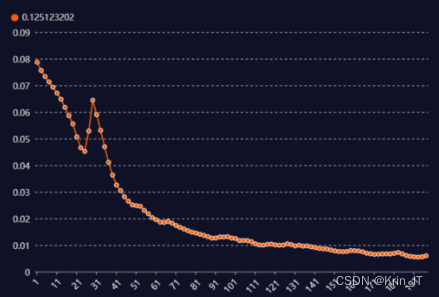

在训练过程中,使用训练数据集对模型进行训练。这包括通过前向传播将输入样本传递到模型中,计算损失函数并使用反向传播算法将梯度传播回网络参数。梯度用于更新参数,以最小化损失函数。优化器(如随机梯度下降SGD、Adam等)在更新参数时可以加速训练过程,并且需要设置合适的学习率和批量大小。通过多次迭代训练,模型逐渐学习到数据中的模式和规律。

在训练过程中,可以使用验证集对模型进行评估,以判断其性能和泛化能力。常见的评估指标包括准确率、精确率、召回率、F1分数等。准确率衡量模型对正常和异常样本的整体分类准确性。精确率衡量模型将异常样本正确分类的能力,而召回率衡量模型发现异常样本的能力。F1分数综合考虑了精确率和召回率,并可作为综合评估指标。根据评估结果,可以进行模型参数调整和优化,以提高模型的性能。

在模型训练完成后,使用独立的测试数据集对模型进行最终的测试和评估。模型根据输入样本的特征进行预测,并基于预设的阈值判断每个样本是正常行为还是异常行为。通过与真实标签进行对比,可以计算出模型在测试集上的性能指标,评估模型的泛化能力和实际应用效果。

相关代码示例:

import torch

import torch.nn as nn

import torchvision.models as models

# 定义Res2Net模块

class Res2Net(nn.Module):

def __init__(self):

super(Res2Net, self).__init__()

# 在这里定义Res2Net的结构

def forward(self, x):

# 在这里实现Res2Net的前向传播逻辑

return x

# 定义Res2-Unet模型

class Res2Unet(nn.Module):

def __init__(self):

super(Res2Unet, self).__init__()

# 编码器部分

self.encoder = Res2Net()

# 解码器部分

self.decoder = nn.Sequential(

# 在这里定义解码器的结构

)

def forward(self, x):

# 编码器部分的前向传播

enc_output = self.encoder(x)

# 解码器部分的前向传播

dec_output = self.decoder(enc_output)

return dec_output

# 创建Res2-Unet模型实例

model = Res2Unet()

# 打印模型结构

print(model)创作不易,欢迎点赞、关注、收藏。

毕设帮助,疑难解答,欢迎打扰!

2346

2346

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?