今天分享的是人工智能专题系列深度研究报告:《人工通用智能微软研究结果报告》。

(报告出品方:微软研究院)

报告共计:101页

摘要

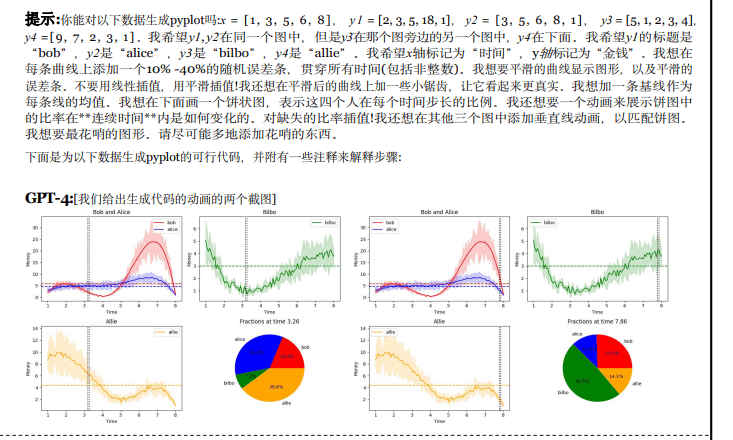

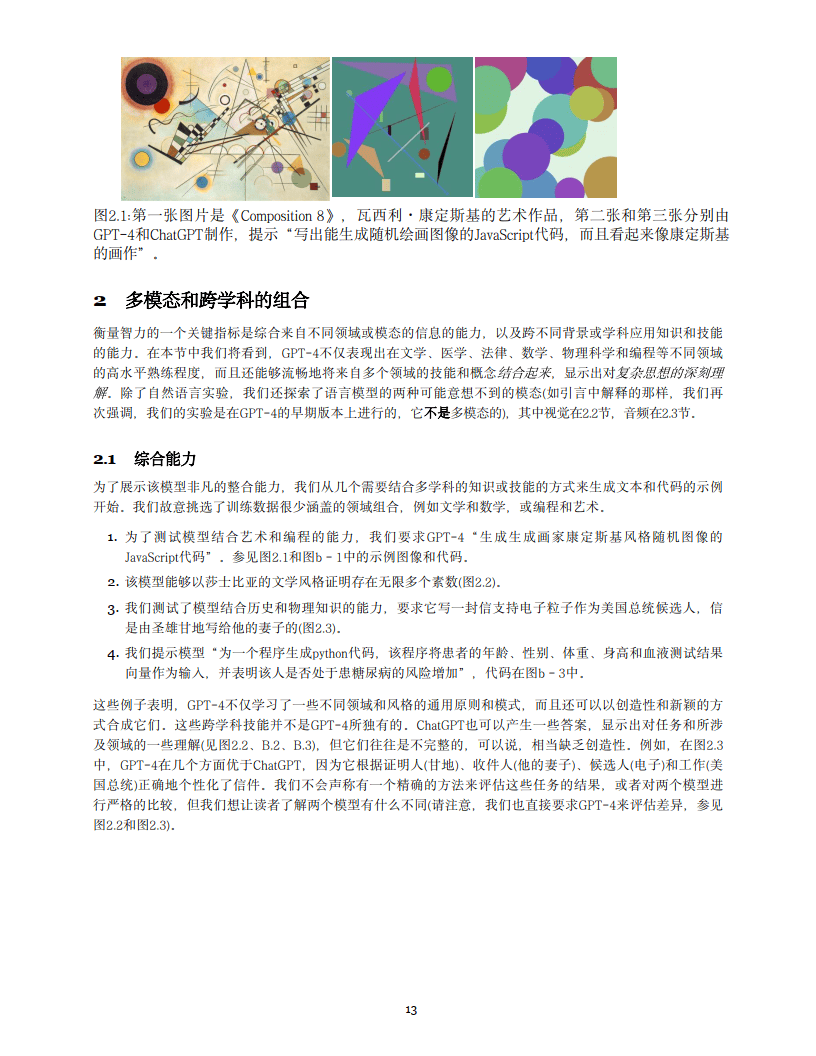

人工智能(AI)研究人员一直在开发和完善大型语言模型(LLM),这些模型在各种领域和任务中表现出非凡的能力,挑战了我们对学习和认知的理解。OpenAI开发的最新模型GPT-4[0pe23]是使用前所未有的计算和数据规模进行训练的。在本文中,我们报告了我们对早期版本的GPT-4的调查,当时它还在OpenAI的积极开发中,我们认为(这个早期版本)GPT-4是新一批LLM的一部分(例如ChatGPT和谷歌的PaLM),它们比之前的AI模型表现出更多的通用智能。我们讨论了这些模型不断提升的能力和影响。我们证明,除了对语言的掌握,GPT-4可以解决跨越数学、编码、视觉、医学、法律、心理学等新颖和困难的任务,而不需要任何特别的提示,此外,在所有这些任务中,GPT-4的表现惊人地接近人类的表现,而且大大超过之前的模型,如ChatGPT。鉴于GPT-4能力的广度和深度,我们相信它可以被合理地视为人工通用智能(AGI)系统的早期版本(但仍不完整)。在我们对GPT-4的探索中,我们特别强调发现其局限性,并讨论了向更深人、更全面的AGI版本推进所面临的挑战,包括可能需要追求超越下一个单词预测的新范式。最后,我们对最近技术飞跃的社会影响和未来研究方向进行了反思。

介绍

智能是一个多方面的、难以捉摸的概念,长期以来一直挑战着心理学家、哲学家和计算机科学家。1994年,52名心理学家组成的小组签署了一个宽泛的定义,并发表在一篇关于智力科学的社论中,试图抓住它的本质[Goi97]。共识派将智力定义为一种非常普遍的心智能力,其中包括推理、计划、解决问题、抽象思考理解复杂概念、快速学习和从经验中学习的能力,这一定义意味着智力并不局限于特定的领域或任务,而是包含了广泛的认知技能和能力。构建一个显示出1994共识定义所表述的那种通用智能的人工系统,是人工智能研究的一个长期而雄心勃勃的目标。在早期的著作中,人工智能(AI)研究的现代学科的创始人为理解智能提出了一系列雄心勃勃的目标[MMRS06].几十年来,人工智能研究人员一直在追求智能的原则,包括可泛化的推理机制(例如[INSS59], [LBFL93])和构建包含大量常识语料库的知识库[Len95].然而,AI研究中许多较近期的成功可以被描述为狭隘地专注于明确定义的任务和挑战,例如下国际象棋或围棋,这些分别在1996年和2016年被AI系统掌握。在20世纪90年代末和21世纪初,开发更通用的AI系统的呼声越来越高(例如,[SBD*96]),该领域的学术界试图确定可能作为更通用智能系统基础的原则(例如,[eg08,GHT15D)。“人工通用智能”(AGI)一词在21世纪初得到普及(见[Goe14),以强调从“狭义A”(如正在开发的集中的、现实世界的应用程序所示)转向更广泛的智能概念的愿望,这又回到了早期A研究的长期愿望和梦想。我们用AGI来指代上述1994年定义中所描述的展示广泛智能能力的系统,并有额外的要求,这些能力可能隐含在共识派的工作中,即达到或超过人类水平,然而,我们注意到,AGI并没有一个被广泛接受的单一定义,我们在结论部分讨论了其他定义。

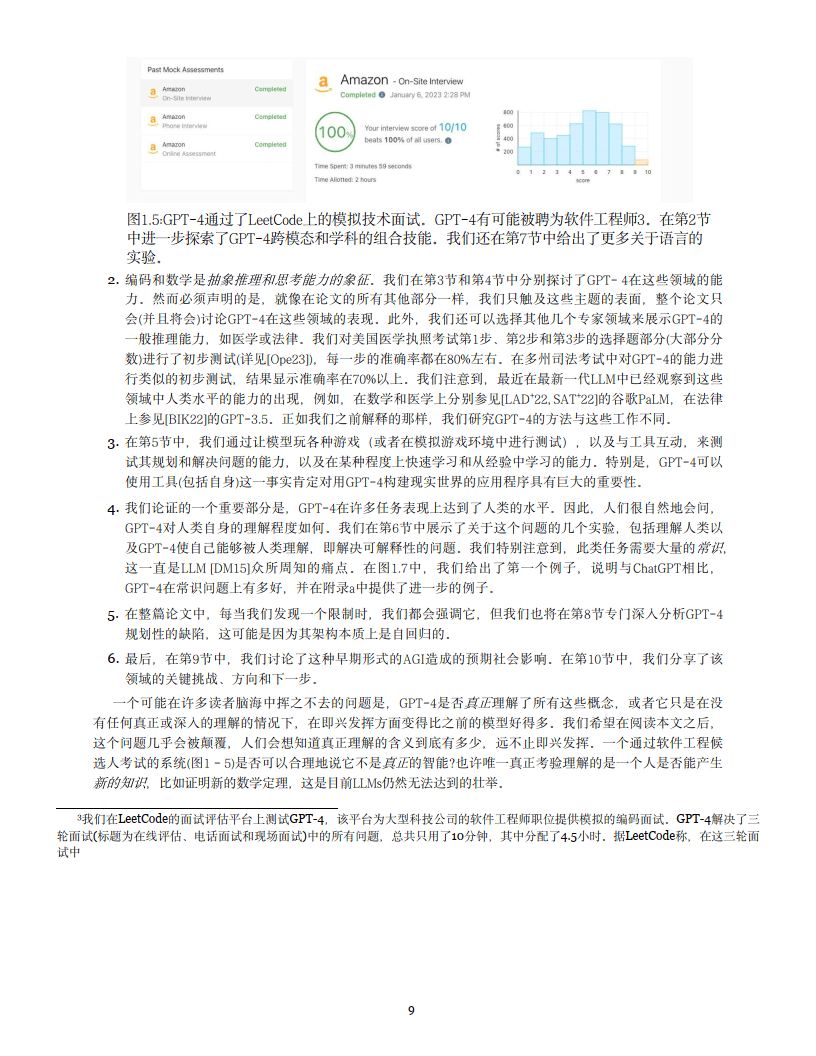

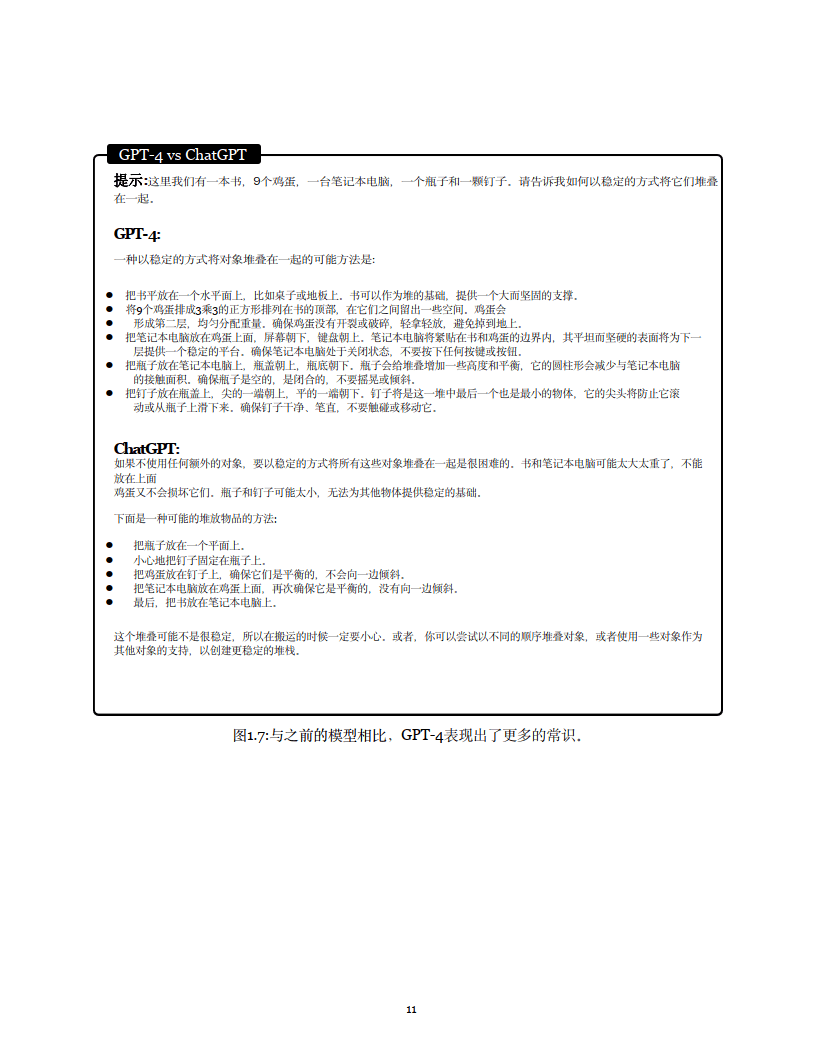

我们声称GPT-4代表着向AGI的进步,并不意味着它在它所做的事情上是完美的,或者它接近于能够做任何人类可以做的事情(这是AGI的通常定义之一;关于这一点,请参阅结论部分了解更多),或者它具有内在的动机和目标(在某些AGI定义中,这是另一个关键方面).事实上,即使在1994年智能定义的限制范围内,GPT-4可以沿着智能中的某些方向走多远,这也不完全清楚,例如计划性(见第8节),可以说它完全缺失了“快速学习并从经验中学习”的部分,因为模型没有不断更新(尽管它可以在一个会话内学习,例如见第5节)。总体而言,GPT-4仍然有许多局限性和偏见,我们将在下文详细讨论,这些也在OpenAI的报告[0pe23]中有所涉及.特别是它仍然遭受的一些证据确凿的LLM缺点如幻想(MNBM20)的问题(见图1.8)或犯基本的算术错误(CKB+21)(见附录D),然而它也克服一些基本的障碍,如获得许多非语言功能(例如,它解决了大部分[MIB+231中描述的LLM 失效状况,并在常识性上取得了很大的进步,参见图1.7第一个例子和附录a)。这突出了一个事实,尽管GPT-4在许多任务上都达到或超过了人类的水平,但总体上它的智能模式显然不像人类。然而,GPT-4只是朝着一系列越来越普遍的智能系统迈出的第一步,事实上,在我们对它的测试过程中,GPT-4本身已经有所改进,参见图1.3在一个月的训练2过程中,独角兽绘画的演变,不管怎样,即使是作为第一步,GPT-4也挑战了相当多被广泛接受的关于机器智能的假设,并展示了突现的行为和能力,它们的来源和机制目前还难以精确地识别(再次参见结论部分对此进行的更多讨论),我们撰写这篇论文的主要目标是分享我们对GPT-4的能力和局限性的探索,以支持我们的看法--即技术飞跃已经实现。我们认为GPT-4的智能标志着计算机科学及其他领域真正的范式转变。

我们研究GPT-4智能的方法

我们如何测量一个在未知但极其庞大的web-text数据语料库上训练过的LLM的智能?机器学习中的标准方法是在一组标准基准数据集上评估系统,确保它们独立于训练数据,并覆盖一系列任务和领域。这种方法旨在将真正的学习与单纯的记忆区分开来,并有丰富的理论框架支持[SSBD14,MRT18]。然而,这种方法并不一定适合研究GPT-4,原因有二。首先,由于我们无法获得其大量训练数据的全部细节,我们必须假设它可能已经看到了所有现有的基准,或者至少是一些类似的数据。例如,似乎GPT-4知道最近提出的BIG-bench[SRR*22](至少GPT-4知道BIG-bench中的金丝雀GUID)。当然,OpenAI本身可以接触到所有的训练细节,因此他们的报告[Ope23]中包含了很多详细的基准测试结果。尽管如此,超出传统基准的第二个原因可能更重要:GPT-4智能的一个关键方面是它的通用性,即表面上能够理解和连接任何主题,并且能够执行超出狭义AI系统典型范围的任务,GPT-4最令人印象深刻的一些表现是在不承认单一解决方案的任务上,例如编写图形用户界面(GUI)或帮助人类对一些与工作有关的问题进行头脑风暴。这种生成式或交互式任务的基准也可以设计,但评估的指标成为一个挑战(参见例如IPSZ211,以了解NLP中这一活跃研究领域的一些最新进展)。我们注意到,[Cho19]中也对衡量AI系统的标准方法提出了批评,其中提出了一个新的基准来评估通用智能。我们没有在后一个基准上测试GPT-4,原因是前面提到的,以及该基准本质上是视觉的,因此更适合[Ope231中描述的GPT-4的多模态版本。

为了克服上述限制,我们在这里提出了一种不同的方法来研究GPT-4,它更接近于传统心理学而不是机器学习,利用人类的创造力和好奇心,我们的目标是生成新颖而困难的任务和问题,今人信服地证明GPT-4不是光靠记忆,并且它对概念、技能和领域有深刻而灵活的理解([(CWF*22]中也提出了一种有点类似的方法).我们还旨在探索GPT-4的反应和行为,以验证其一致性、连贯性和正确性,并揭示其局限性和偏见。我们承认,这种方法在某种程度上是主观和非正式的,它可能无法满足科学评估的严格标准。然而,我们相信这是欣赏GPT-4的非凡能力和冲击有用和必要的第一步,这样的第一步为发展更正式和全面的方法来测试和分析具有更一般智能的AI系统开辟了新的机会。

为了说明我们评估GPT-4智能的方法,让我们考虑图1.1中我们与GPT-4的前两个交互示例,第一个例子是要求GPT-4以一首诗的形式写出质数无限多的证明,这是一项具有挑战性的任务,需要结合初等。

报告共计:101页

海量电子版报告来源:公众号《海选智库》

5179

5179

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?