1. 引言

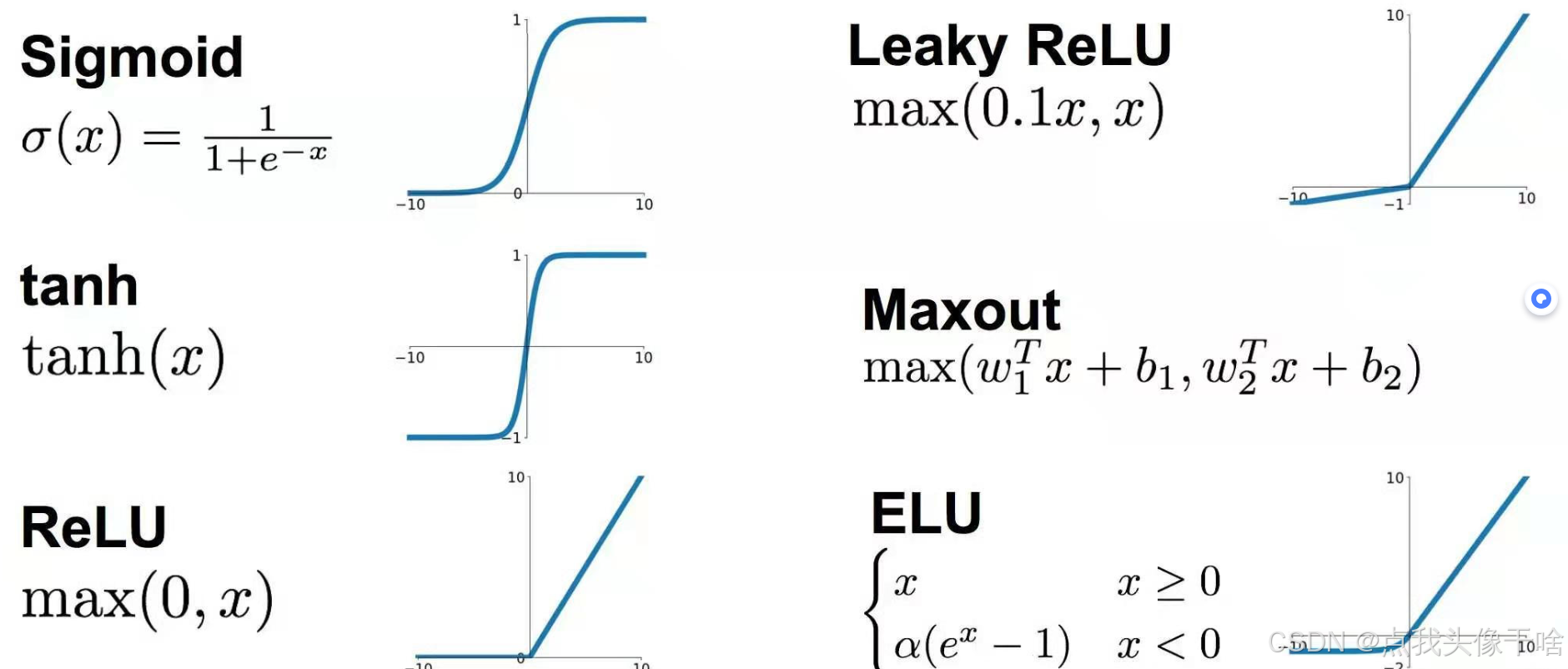

在深度学习领域,激活函数是神经网络中至关重要的组成部分

它决定了神经元是否应该被激活以及如何将输入信号转换为输出信号

激活函数为神经网络引入了非线性因素,使其能够学习并执行复杂的任务

没有激活函数,无论神经网络有多少层,都只能表示线性变换,极大地限制了网络的表达能力

本文将深入探讨三种最常用的激活函数:ReLU(Rectified Linear Unit)、Sigmoid和Tanh(双曲正切函数),从数学定义、特性、优缺点到实际应用场景进行全面比较。

2. 激活函数概述

2.1 激活函数的作用

激活函数在神经网络中扮演着多重重要角色:

-

引入非线性:使神经网络能够学习和表示复杂的数据模式

-

决定神经元输出:基于输入决定神经元是否应该被激活(输出非零值)

订阅专栏 解锁全文

订阅专栏 解锁全文

2173

2173

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?