随着人工智能技术的不断发展,大模型在各个领域的应用越来越广泛。不过随着模型规模的增大,一个不容忽视的问题也逐渐浮现出来——幻觉问题,就是指模型在处理数据时产生的错误认知或偏差,这些问题可能会导致预测结果的偏差或误判。

那该如何解决大模型的「幻觉」问题呢?今天就汇总了一些各种克服大模型幻觉的相关论文,这些论文中提出了多种方法来缓解大模型中的幻觉问题,大家可以学习参考一下!

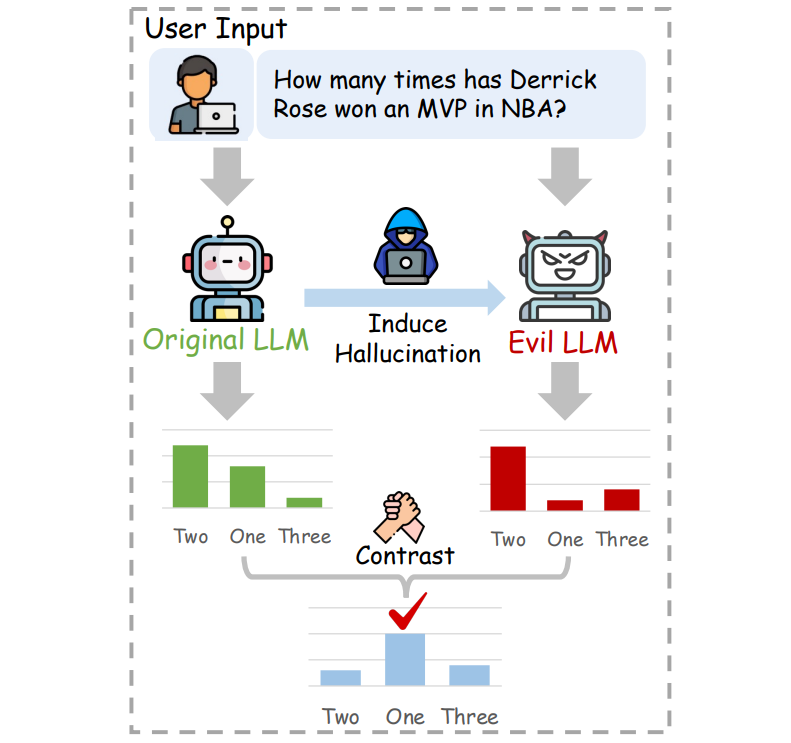

1、Alleviating Hallucinations of Large Language Models through Induced Hallucinations

通过诱发幻觉缓解大型语言模型的幻觉

简述:苏州大学和腾讯 AI Lab 的研究者提出了一种名为“诱导-然后-对比”解码(ICD)的策略,为了减少大型语言模型(LLMs)生成的幻觉(即不准确或捏造的信息)。这种方法首先创建一个易于产生幻觉的LLM,然后在解码时减少这些幻觉,从而提高内容的真实性。通过对比解码放大真实预测,降低不真实预测,确定最终预测。实验显示,应用ICD的模型在真实性评估上与ChatGPT和GPT4相媲美。

本文汇总了针对大模型幻觉问题的研究,包括通过诱导幻觉缓解、OPERA解码、视觉对比解码、Woodpecker纠正、规则学习等方法,旨在提高模型的准确性和真实性。

本文汇总了针对大模型幻觉问题的研究,包括通过诱导幻觉缓解、OPERA解码、视觉对比解码、Woodpecker纠正、规则学习等方法,旨在提高模型的准确性和真实性。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

892

892

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?