网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

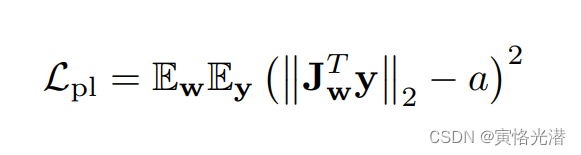

2.4、路径长度正则化Path length regularization

路径长度正则化是一种用于控制神经网络模型复杂度的正则化方法。在深层神经网络中,由于模型的复杂度很高,容易导致过拟合的现象。而路径长度正则化方法可以通过对网络中路径长度的约束,来限制模型的复杂度,从而提高模型的泛化能力。该方法在计算机视觉和自然语言处理等领域有着广泛的应用。

该方法的基本思想是,通过限制神经网络中每个神经元到输出层的路径长度,来控制模型的复杂度。具体来说,该方法会对每个神经元到输出层的路径长度进行计算,并对这些路径长度进行惩罚项的加权和。这个惩罚项可以理解为对模型复杂度的约束,从而可以有效避免过拟合现象的发生。

优点在于,与其他正则化方法相比,它不会引入额外的超参数。这意味着,在使用该方法时,不需要手动调整超参数,可以直接使用默认参数。并且,该方法的计算量也相对较小,适用于大规模的深度神经网络。

来看下公式:

w是隐藏空间点,y是在生成的图像空间里的单位正态分布随机变量(RGB图像的维度是3*w*h),J是雅可比矩阵,a是表示期望的梯度规模的全局值,当雅可比矩阵J正交时,内部期望(近似)最小化。当然这个地方将转化成一些正交操作,有兴趣的可以看论文,更加细致的去了解,这里就不贴公式了。

2.5、渐进式增长的优缺点

渐进式增长在稳定高分辨率图像合成方面非常成功,但它会导致自己的特征伪像。关键问题在于渐进式增长的生成器似乎对细节具有很强的位置偏好,我们先来看张图:

仔细观察,我们发现人的头部偏移的时候,牙齿的位置没有跟着发生变动,而是跟相机保持对齐。

仔细观察,我们发现人的头部偏移的时候,牙齿的位置没有跟着发生变动,而是跟相机保持对齐。

我们认为问题在于,在渐进式增长中,每个分辨率都瞬间充当输出分辨率,迫使它产生最大频率的细节,然后导致训练过的网络在中间层具有过高的频率,从而损害了平移不变性。

这些问题促使我们寻找一种保留渐进式增长的优点而避免其缺点的替代方法,我们来看下三种没有渐进式增长的架构图以及实验的结果:

**1、MSG-GAN:**使用多个跳跃连接将生成器和辨别器的匹配分辨率连接起来,输出mipmap而不是图像。这mipmap是多级贴图,一种计算机图形技术,用于在不同分辨率下更高效地显示纹理。

**2、Input/output skips:**通过上采样和总结对应于不同分辨率的RGB输出的贡献来简化此设计。辨别器里面,我们同样将下采样图像提供给辨别器的每个分辨率块。我们在所有上采样和下采样操作中使用的是双线性滤波。

**3、Residual nets:**使用的是残差连接。这个设计类似于LAPGAN,但没有Denton等人使用的每个分辨率辨别器。

通过9种组合的FID和PPL,我们可以看到两个广泛的趋势:跳跃连接在所有配置中显著提高了PPL,而残差辨别器网络对FID显然是有益的,因为辨别器的结构类似于分类器。然而,残差网络的架构在生成器中是有害的(唯一的例外是LSUN CAR中的FID),当两个网络都是残差时。

综合考虑我们使用跳跃连接生成器和残差辨别器。

2.6、StyleGAN2能耗

原始的StyleGAN在NVIDIA DGX-1上配备8个Tesla V100 GPU时以每秒37张图像的速度训练,而我们训练速度达到了每秒61张图片 。大部分加速来自由于权重解调,懒惰的正则化和代码优化而导致的简化数据流程。其总训练时间为FFHQ为9天,LSUN CAR为13天&

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

864

864

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?