文章目录

提示:这里可以添加系列文章的所有文章的目录,目录需要自己手动添加

SVeriFL: Successive verifiable federated learning with

privacy-preserving

提示:写完文章后,目录可以自动生成,如何生成可参考右边的帮助文档

概括

提示:这里可以添加本文要记录的大概内容:

联邦学习最显著的特点之一是可以在不使用用户本地数据的情况下更新全局模型参数。

但是,在联邦学习过程中仍然存在着各种安全和隐私问题。

如何设计一个安全的、可验证的联邦学习框架,以获得高性能的联邦学习模型,并保护参与者的权益,这一问题尚未得到充分的研究,恶意服务器可能会进行欺骗性的数据聚合,并向所有参与者返回错误的聚合梯度。更有甚者,别有用心的服务器可能会向某些参与者返回正确的聚合结果,但向特定参与者返回错误的结果。

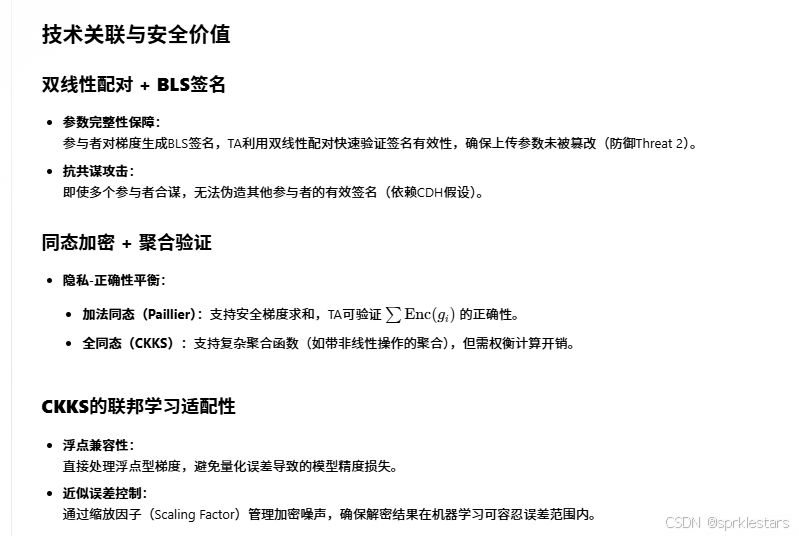

为解决上述问题,提出了一种具有隐私保护的连续可验证联邦学习算法–SVeriFL.具体地,提出了一种基于BLS签名和多方安全的协议,该协议可以验证参与者上传参数的完整性和服务器聚合结果的正确性,也可以验证任意多个参与者之间从服务器接收到的聚合结果的一致性。

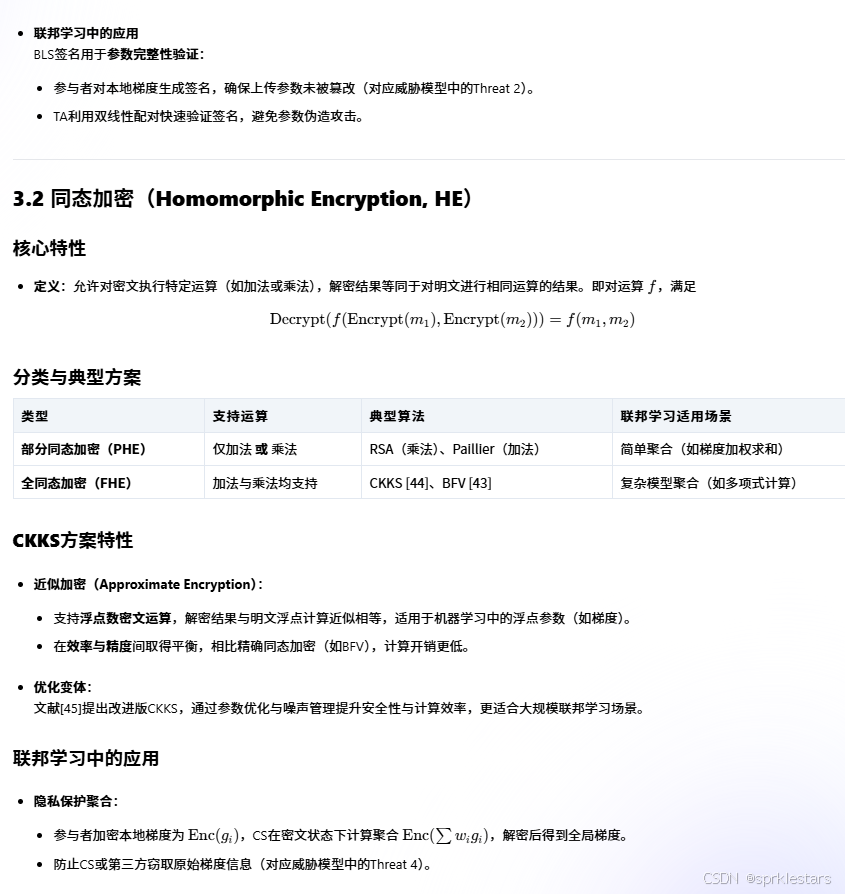

此外,还采用CKKS近似同态加密算法来保护参与者的数据隐私。实验结果和分析验证了该算法的实用性和计算效率。

提示:以下是本篇文章正文内容,下面案例可供参考

背景

近年来,深度学习(Deep Learning, DL)在社会生活领域取得了快速发展并得到广泛应用,例如智能机器人配送和智能车辆自动目标识别[1]等。深度学习正在通过医疗保健、智慧出行和智慧城市等场景改变世界并重塑我们的生活方式[2-3]。

高性能深度学习模型的构建依赖于海量大数据,但在现实场景中,由于数据的敏感性和机密性,用户往往不愿提供大量数据。

以医疗健康数据为例,患者的诊疗信息具有隐私属性,当这些数据被用于深度学习时,存在敏感信息泄露的风险。

为了实现高性能模型训练与用户隐私保护的双重目标,学术界提出了联邦学习(Federated Learning, FL)等安全方案,其通过避免数据集中收集和模型集中训练的方式保护隐私[4-6]。

由于联邦学习的参与者无需将原始数据上传至服务器,因此其数据隐私能得到更好的保护。正是由于这一特性,联邦学习受到学术界与工业界的广泛关注,并被应用于工业物联网(IIoT)、交通管理和推荐系统等多个领域[7-9]。

然而在实际研究与应用中,研究者发现共享的梯度等敏感信息可能遭受投毒攻击(Poisoning Attacks)[10]和拜占庭攻击(Byzantine Attacks)[11]的威胁。为此,学者们提出了多种防御方案以增强联邦学习模型的鲁棒性和安全性[12-14]。另一方面,联邦学习中的数据完整性问题也备受关注:出于非法利益驱动,恶意云服务器可能对参与方参数进行恶意聚合,最终向参与者返回错误的聚合结果,从而危及模型性能;若服务器对特定参与者返回错误结果而对其他参与者返回正确结果,还将损害部分参与方的权益。因此,如何确保参与者上传至服务器的数据完整性成为影响深度学习性能的重要课题。

针对上述问题,研究者开发了多种在保护参与者隐私的同时获得高质量联邦学习模型的策略[15-35]。其中,

Ma等人[16]基于Diffie-Hellman密钥交换协议、

ElGamal加密和聚合签名技术,提出了一种支持隐私保护与聚合结果验证的深度学习框架,能有效防止参与者接收服务器的错误输入。

Xu等人[17]提出的VerifyNet通过双掩码协议支持用户中途退出训练,并可通过向服务器索取证明实现聚合结果的验证。

Guo等人[18]结合线性同态哈希与承诺机制,确保服务器必须使用与预发布哈希一致的提交参数,从而实现聚合结果的验证。

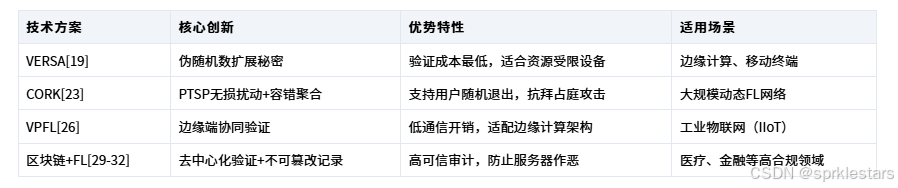

Hahn等人[19]提出的VERSA协议通过伪随机数生成器(PRG)实现秘密扩展,在保护隐私的同时以最低验证成本完成模型聚合验证。

Zhang等人[20]利用中国剩余定理(CRT)与Paillier同态加密技术保护数据隐私,并引入双线性聚合签名技术实现梯度聚合结果的验证。

Tran等人[21]设计的高效安全求和协议(ESSP)支持多方私密输入求和计算,并在协议中实现了聚合结果的可验证性。

Fu等人[22]基于拉格朗日插值法精心设置插值点,通过插值验证机制保障梯度聚合的正确性,同时有效防止模型参数泄露。

Zhao等人[23]提出的CORK框架采用PTSP无损模型扰动机制保护全局模型参数中的敏感数据,并支持全参与方的容错安全聚合。

其他支持聚合结果验证的方案还包括:具备可验证与高效重连特性的VREFL框架[24]、

面向边缘计算系统的可验证隐私保护联邦学习方案VPFL[26]、

无需完全可信中心的验证型隐私保护联邦学习方案[27]。

特别地,Zhao等人[28]提出的PVD-FL去中心化联邦学习框架,通过高效可验证的密文矩阵乘法(EVCM)技术,在确保全局模型与本地更新机密性的同时,实现了每个训练步骤的可验证性。

此外,基于区块链的数据完整性验证研究也取得重要进展[29-32]。

Zhang等人[29]构建了面向工业物联网故障检测的区块链平台架构,通过周期性构建以客户端数据记录为叶子节点的Merkle树实现数据完整性验证。

Jiang等人[30]提出的PFLM模型突破了传统秘密共享中阈值必须超过用户数半数的限制,利用公有区块链实现联邦学习的成员资格证明,可验证云服务器返回的聚合结果。

Peng等人[32]设计的VFChain框架创新性地采用委员会集体聚合模型并将验证证明记录于区块链,通过优化实现了高性能的可审计联邦学习模型。

总结:

(1)加密与数学工具驱动的隐私保护

密钥交换与同态加密

Ma等人[16]结合Diffie-Hellman密钥交换与ElGamal加密,实现参数传输的端到端保护。

Zhang等人[20]利用Paillier同态加密支持密文聚合,避免明文梯度暴露。

数学构造优化

中国剩余定理(CRT)[20]分割数据分片,攻击者需获取全部分片才能重构原始参数。

拉格朗日插值法[22]通过插值点验证聚合结果,数学约束保障不可篡改性。

(2)验证机制设计

轻量化验证协议

VERSA[19]通过伪随机数生成器(PRG)扩展秘密,以最低计算成本实现聚合验证。

VerifyNet[17]的双掩码协议允许用户动态退出,验证时仅需服务器提供数学证明。

密码学承诺与哈希

Guo等人[18]采用线性同态哈希绑定参数与承诺,确保服务器必须使用合法输入聚合。

(3)去中心化与区块链融合

去中心化联邦框架

PVD-FL[28]通过密文矩阵乘法(EVCM)实现完全去中心化验证,消除单点故障风险。

VFChain[32]引入委员会机制聚合模型,区块链记录验证证据,支持审计追溯。

数据完整性保障

区块链+Merkle树[29]周期性验证客户端数据完整性,防止历史记录篡改。

公有链成员证明[30]突破传统秘密共享阈值限制,实现灵活可验证的聚合

医疗领域:保护患者诊疗数据隐私(如电子健康记录EHR),支持跨机构联合建模。

智慧城市:交通流量预测模型训练中,确保各参与方数据主权不被侵犯。

工业物联网:设备故障检测场景下,防止恶意服务器伪造聚合结果导致误判。

金融风控:银行间反欺诈模型协作时,满足GDPR等数据合规要求。

关于本文:

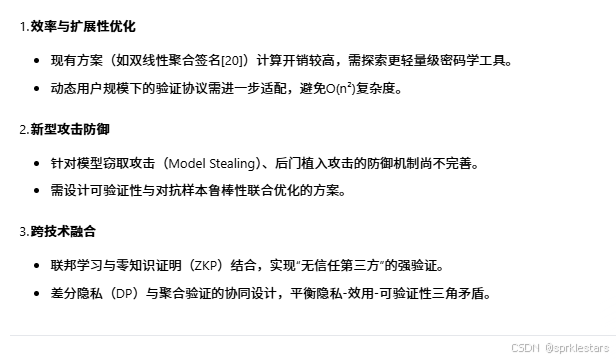

通过上述综述与分析可见,数据完整性验证与隐私保护对联邦学习(FL)中全局模型的构建至关重要。

出于恶意目的,聚合服务器可能蓄意向部分参与者返回特定设计结果,进而分析参与方数据的统计特征[33]。当前已有方案主要聚焦于在保护数据隐私的同时验证聚合结果的正确性。然而,与聚合结果正确性验证同等重要的是参与者上传参数的完整性验证,因为不可信节点参与联邦学习可能导致全局模型被投毒或梯度聚合协议遭破坏[34,35]。因此,若能在联邦学习全流程中实现数据交换的完整性验证,将大幅提升系统的安全性与效率。由此可见,针对联邦学习中存在的多重问题,亟需研究综合性解决方案。

本文提出一种名为SVeriFL的连续可验证隐私保护方案,该方案重点关注参与者上传至服务器的参数完整性验证与聚合结果正确性验证,同时支持多参与者接收聚合结果的一致性验证。

本协议通过可信权威机构(TA)[36-39]执行数据完整性验证。尽管引入TA会带来一定计算开销,但计算成本评估分析表明,该方案增加的验证开销处于可接受范围,且不会损害原有联邦学习性能。据我们所知,这是首度提出基于数据审计的联邦学习全程完整性验证方案。

本文的主要贡献总结如下:

- 参与者上传参数的完整性安全验证

通过精心设计的验证协议,确保参与者加密的本地更新参数对聚合服务器保密,并能动态验证本地模型参数的完整性。

协议中动态参数的引入增强了算法安全性,为获得高质量联邦学习模型提供保障。

-

服务器聚合结果的正确性安全验证

采用同一验证协议体系,系统可验证云服务器聚合结果的正确性。同时,为维护参与者权益,该协议还能验证特定参与者接收的聚合结果是否与其他参与者一致,防止服务器差异化攻击。 -

无损原有联邦学习性能

方案采用贯穿训练过程的动态连续验证机制。虽然TA参与验证流程,但全同态加密技术的应用既保护参与者数据隐私,又确保SVeriFL不会导致联邦学习性能损失。 -

完备的安全性与有效性验证

综合安全分析表明,SVeriFL能够有效保护参与者隐私并实现联邦学习过程的连续可验证性。大量实验证明,系统在计算成本适度增加的前提下具有显著有效性。

SVeriFL方案核心贡献

- 技术创新点

全流程连续验证

参数上传阶段:TA基于动态参数验证加密本地模型的完整性,防止恶意节点注入污染数据。

聚合阶段:验证服务器是否按协议规则执行聚合,避免伪造结果。

结果分发阶段:多参与者交叉验证接收结果一致性,阻止服务器差异化攻击。

动态验证机制

采用动态参数生成(如时间戳或随机数绑定),防止重放攻击与静态验证漏洞。

验证过程嵌入联邦学习迭代流程,形成连续审计链条。

2. 关键技术实现

全同态加密(FHE)集成

支持在密文状态下完成完整性验证,确保参与者本地参数隐私不泄露。

结合TA的公钥基础设施(PKI),实现加密参数的可验证性。

轻量化验证协议设计

通过双线性映射优化验证方程计算,避免复杂零知识证明(ZKP)带来的高开销。

基于哈希承诺的预提交-验证机制,降低实时通信负载。

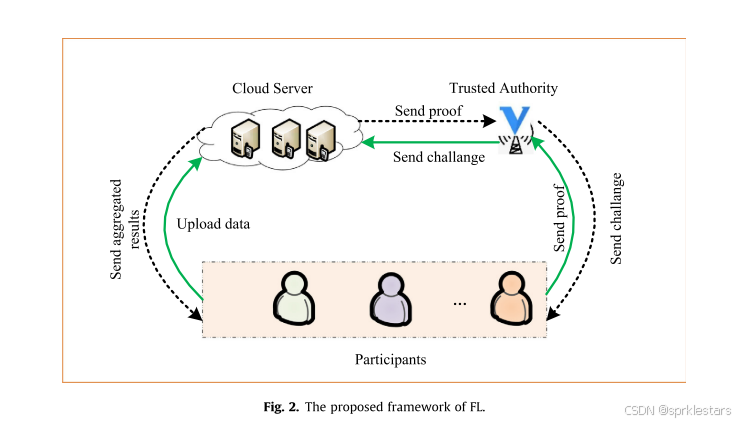

系统架构

- 参与者(Participant)

核心职责

接收与初始化:从CS获取聚合后的全局参数,并将其作为本地模型的初始参数。

本地训练:使用自身私有数据集训练本地模型,生成加密的本地梯度(encrypted local gradients)。

参数上传:将加密后的梯度发送至CS,并附加辅助信息(auxiliary information),用于后续参数完整性验证。

技术要点

隐私保护:梯度需加密传输(如使用全同态加密),确保CS无法反推原始数据。

验证支持:辅助信息可能包含哈希承诺、数字签名等,用于TA验证参数未被篡改。

- 云服务器(Cloud Server, CS)

核心职责

梯度聚合:对接收的所有参与者加密梯度执行聚合操作(如加权平均)。

参数分发:将聚合后的全局参数广播至所有参与者。

验证支持:

完整性证明:向TA提交验证证明(proof),协助TA验证参与者上传梯度的完整性。

正确性辅助:向参与者提供附加信息,用于验证聚合结果的正确性。

技术要点

可信操作假设:CS需遵循协议执行聚合,但可能因“诚实但好奇”特性试图窃取隐私。

证明生成:证明可能基于零知识证明(ZKP)或哈希树结构,确保验证过程可审计。

- 可信权威机构(Trusted Authority, TA)

核心职责

全局初始化:

生成系统公共参数(如椭圆曲线基点、双线性对参数)。

发布密码学原语(哈希函数、伪随机数生成器)。

双重验证:

聚合正确性验证:检查CS提供的聚合结果是否符合协议规则。

参数完整性验证:利用CS提交的证明,确认参与者上传梯度未被篡改。

技术要点

非共谋假设:TA独立运行,不与任何参与者或CS勾结,确保验证公正性。

离线/在线模式:TA可仅在初始化阶段活跃,或在每轮训练中实时参与验证。

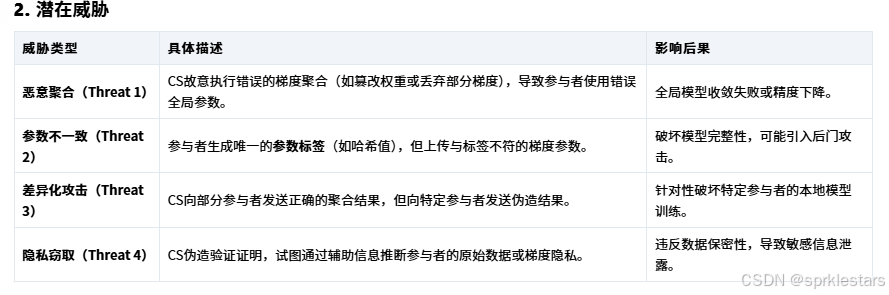

威胁模型

- 基本假设

协议合规性:所有参与者与CS默认遵循参数上传/下载协议流程。

TA可信性:TA绝对可信且不会与任何实体共谋。

诚实但好奇(Honest-but-Curious)模型:

参与者与CS严格按协议执行操作,但可能试图通过协议交互数据推断其他方隐私

. 设计目标

为应对上述威胁,本方案需实现以下目标:

聚合正确性验证(Correctness Verification)

参与者可验证CS返回的聚合结果是否按预设规则(如FedAvg)正确计算。

对应威胁:Threat 1 & 3

参数一致性保障(Parameter Consistency)

确保参与者上传的梯度与其生成的验证标签严格匹配,防止参数替换攻击。

对应威胁:Threat 2

结果一致性验证(Result Consistency)

所有参与者可交叉验证各自收到的聚合结果是否一致,阻止CS差异化分发。

对应威胁:Threat 3

隐私保护强化(Privacy Preservation)

即使CS或恶意参与者试图通过辅助信息或证明推断隐私,也无法破解加密梯度或原始数据。

对应威胁:Threat 4

技术实现关联性

加密与验证分离:通过TA独立验证机制,避免CS同时掌握数据与验证权导致的单点风险。

动态标签生成:参数标签可能结合时间戳或随机数,防止重放攻击(Replay Attack)导致的Threat 2。

零知识证明:在Threat 4中,CS生成的证明需满足ZKP特性,确保验证过程不泄露额外信息。

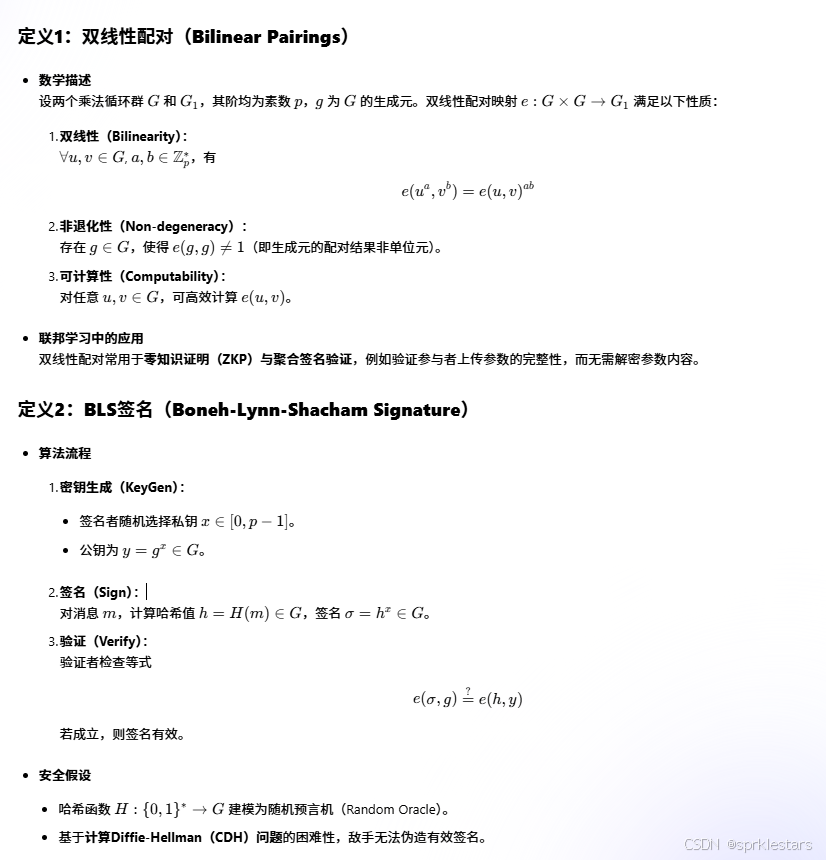

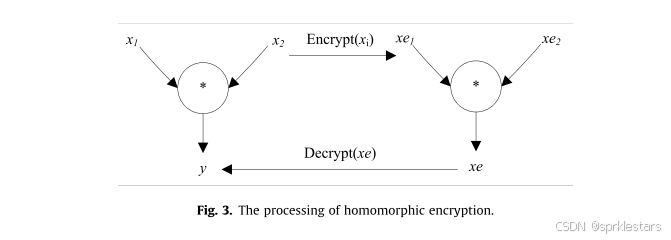

加密源语

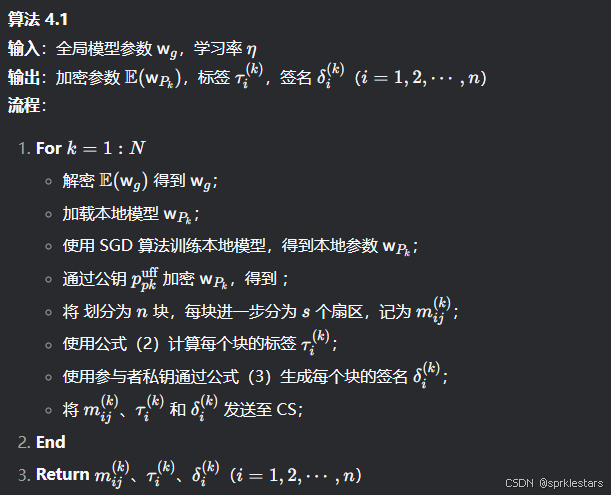

算法流程

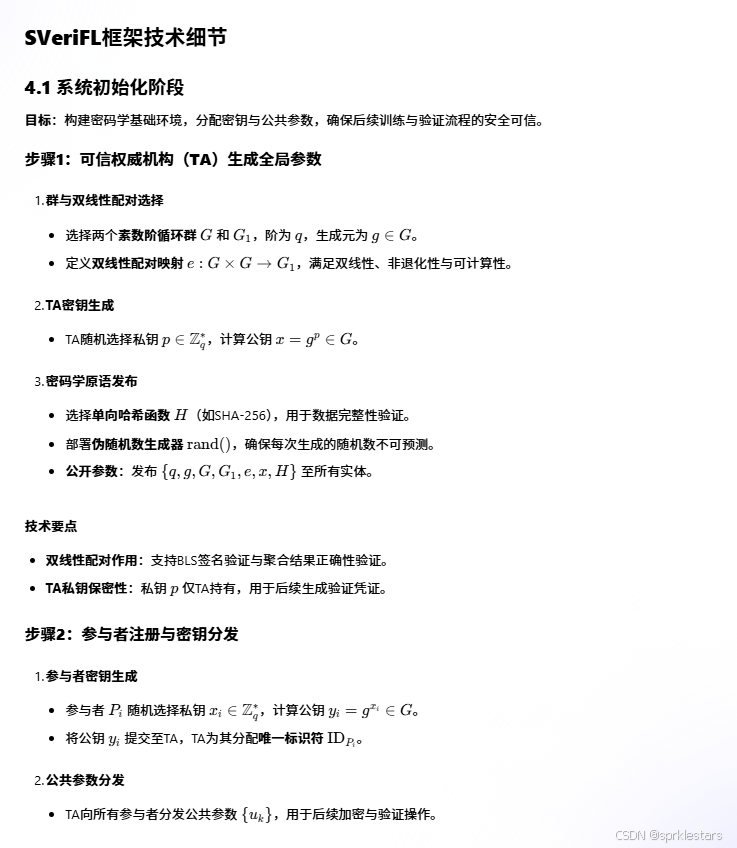

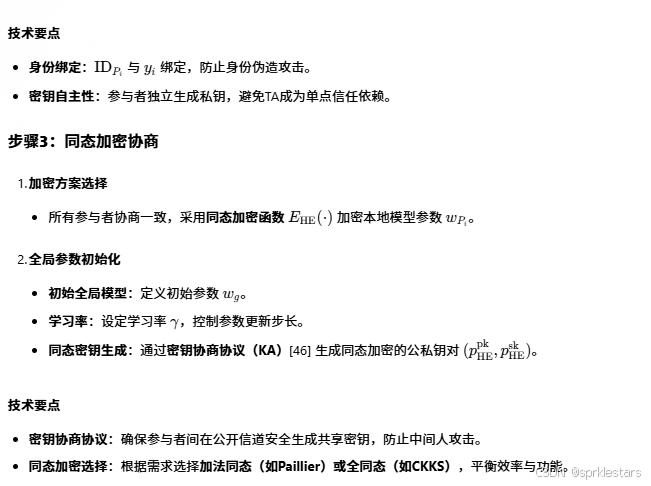

1初始化

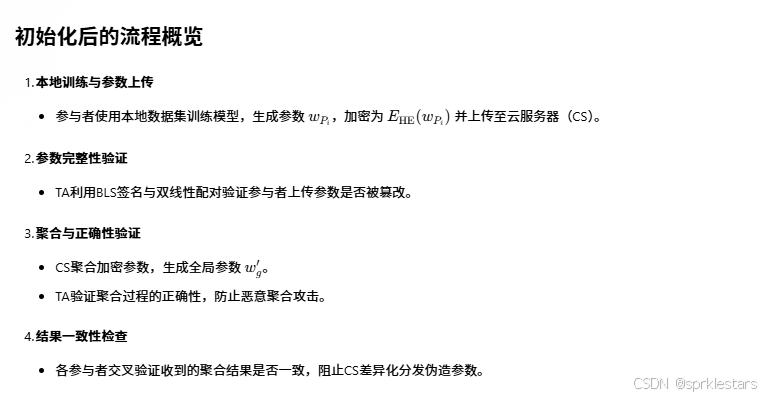

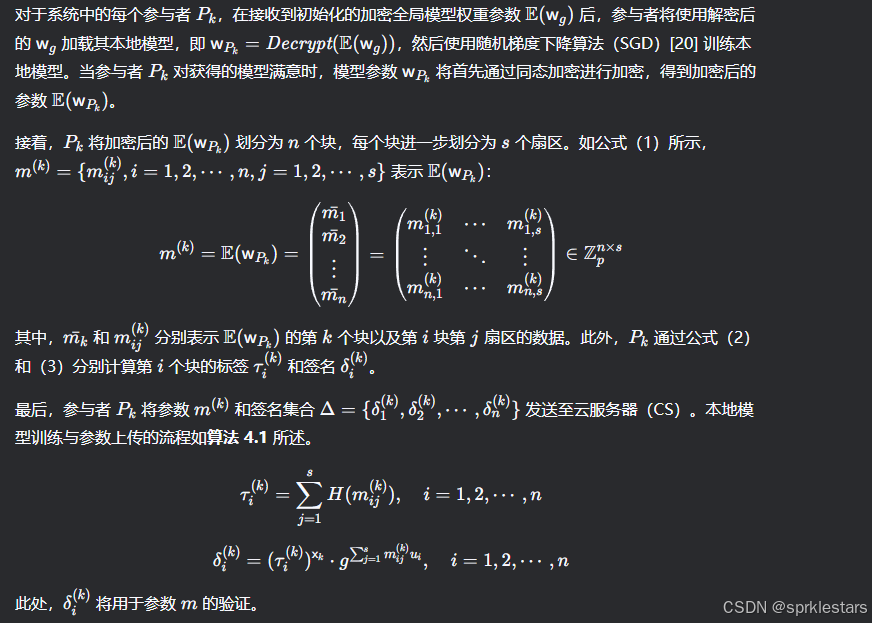

本地模型训练和参数上传

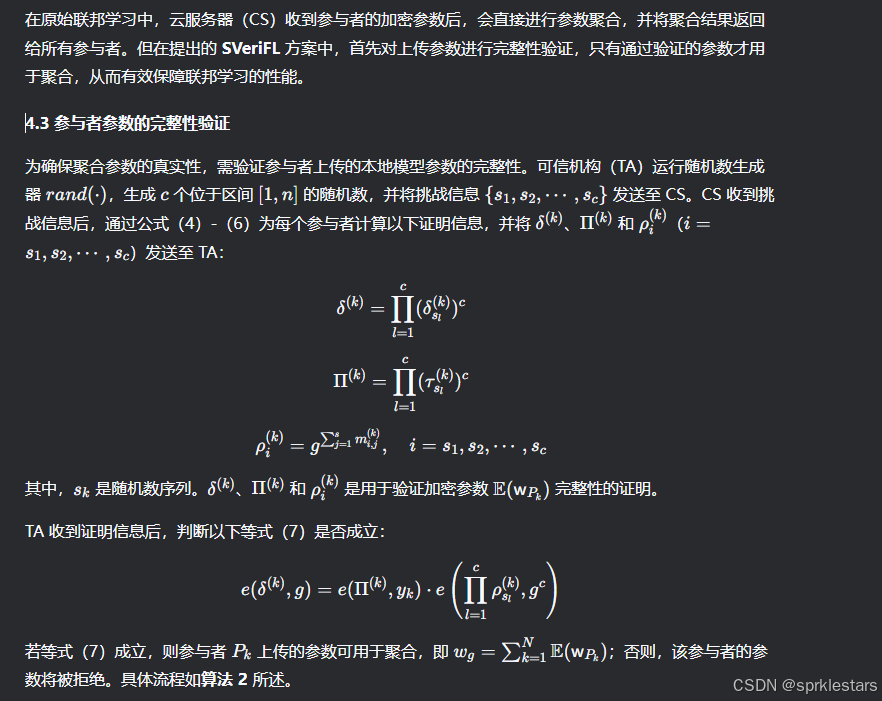

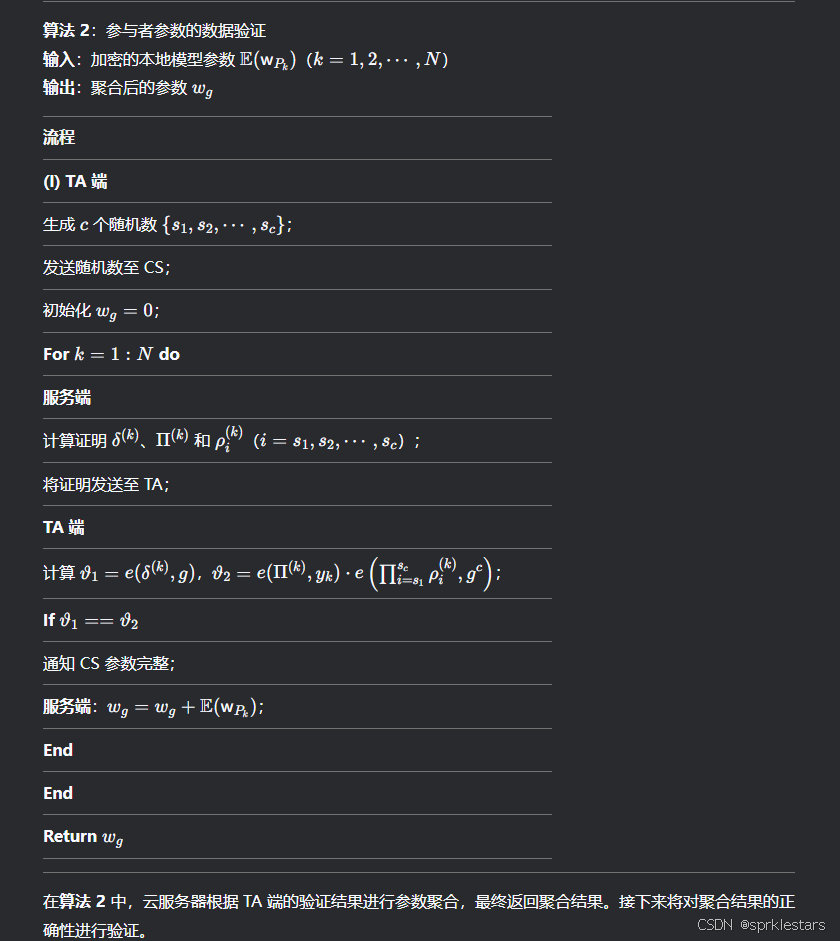

参数完整性验证与聚合

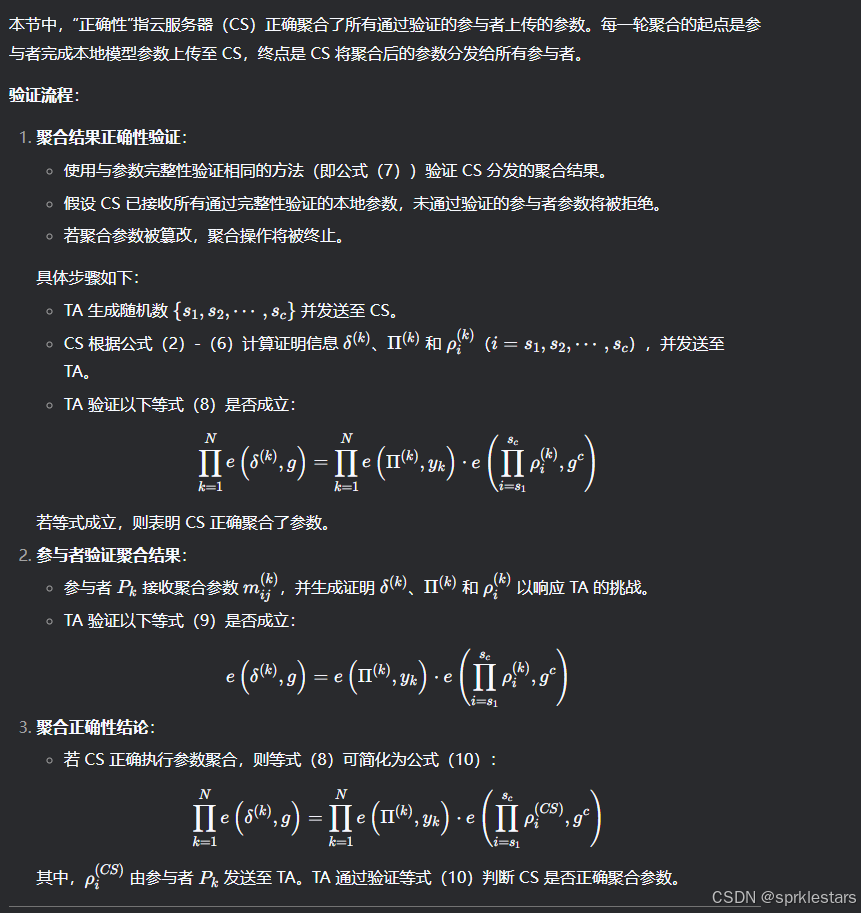

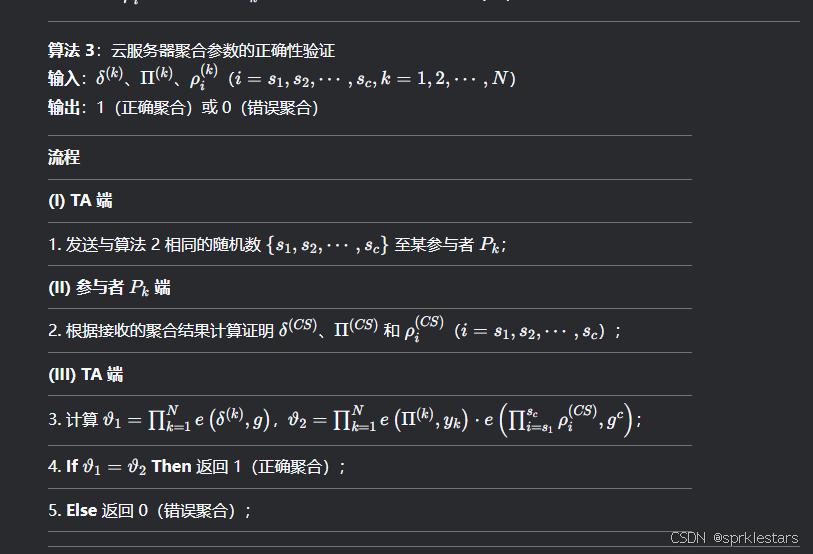

云服务器聚合参数的正确性验证

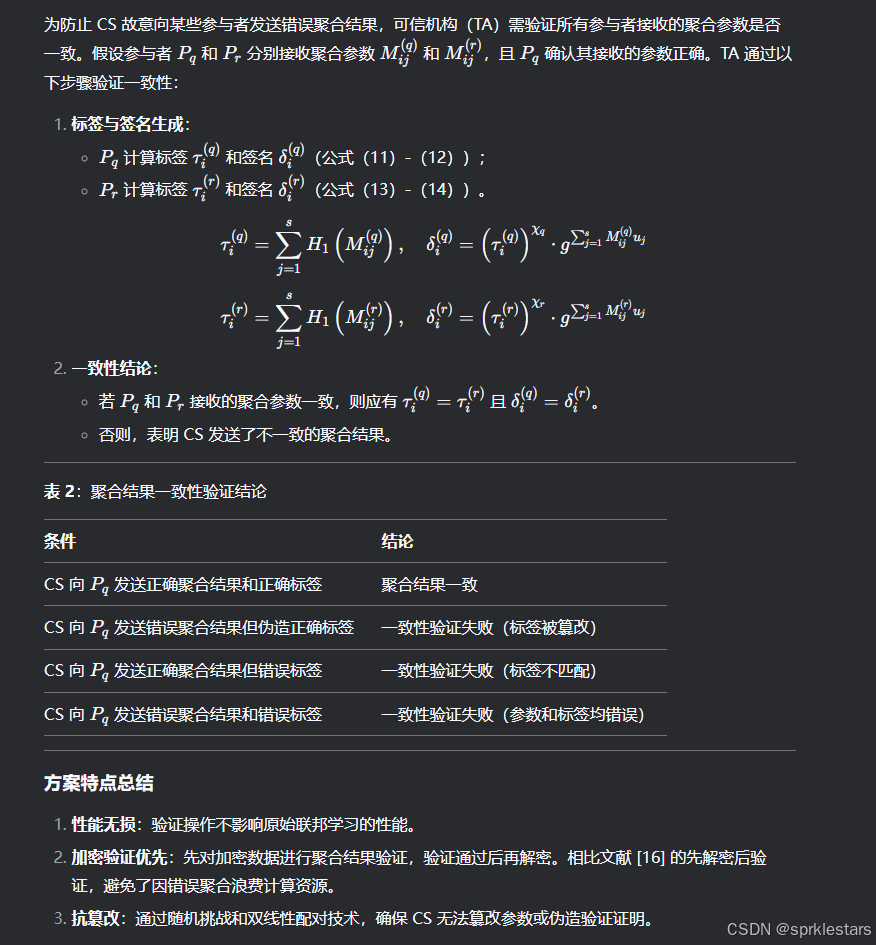

云服务器聚合结果的一致性验证

总结

提示:这里对文章进行总结:

本篇文章主要利用了双线性映射,blk加密,首先用户保证自己的本地模型没有恶意而且没有篡改才能进行加密聚合,然后加密聚合后,加密聚合的结果必须先保证参与者完成了本地模型参数的上传,验证完整性聚合后,才能分发给参与者,参与者接收到聚合结果,必须要进行验证,才能进行新一轮的训练

1997

1997

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?