摘要

大规模数据集的可用性极大释放了深度卷积神经网络(CNN)的潜力。然而,针对单图像去噪问题,获取真实数据集成本高昂且流程繁琐。因此,图像去噪算法主要基于合成数据开发与评估,这些数据通常通过广泛假设的加性高斯白噪声(AWGN)生成。尽管CNN在合成数据集上表现优异,但在真实相机图像中效果不佳,如近期基准数据集所示。这主要因为AWGN不足以建模真实相机噪声——其具有信号依赖性且受相机成像流程(ISP)深度变换。本文提出一种框架,对相机成像流程进行正反向建模,使其能在RAW和sRGB空间生成任意数量的真实图像对用于去噪。通过在真实合成数据上训练新去噪网络,我们在真实相机基准数据集上实现了最先进性能。模型的参数量比此前RAW去噪最优方法减少约5倍。此外,我们证明该框架可泛化至图像去噪之外的任务(如立体电影色彩匹配)。源代码与预训练模型已开源:https://github.com/swz30/CycleISP

一、引言

-

计算机视觉任务的发展

以图像分类、目标检测和分割为代表的高层视觉任务受益于深度卷积神经网络(CNNs)。大规模数据集(如ImageNet)的可用性是关键推动力。技术瓶颈:低层视觉任务(去噪、超分、去模糊等)的数据采集成本极高,需在同一场景拍摄多张噪声图像进行像素级对齐和平均生成干净图像,易受光照变化和运动模糊干扰。 -

合成数据局限性

现有方法通过在sRGB图像中添加AWGN(加性高斯白噪声)生成训练数据,但真实相机噪声具有信号依赖性和ISP非线性变换特性,导致模型在真实数据上泛化性能差。核心问题:相机ISP流程(如去马赛克、色彩校正)会改变RAW域噪声的时空-色度相关性,使其分布偏离高斯。

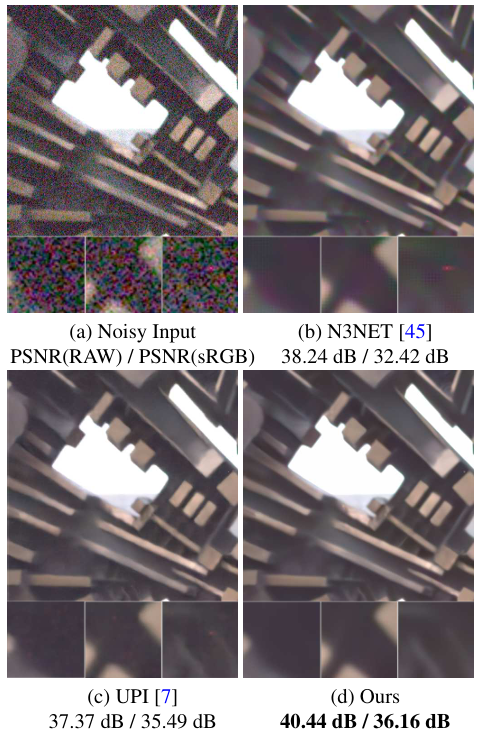

图1:DND数据集真实相机图像去噪效果

CycleISP框架创新

1. 核心贡献

-

设备无关的RAW-sRGB双向转换

提出无需相机ISP参数的CycleISP模型,通过RGB→RAW→RGB循环学习实现数据合成与噪声建模:- RGB2RAW模块:将sRGB逆转换为RAW数据,无需依赖白平衡增益等相机参数

- RAW2RGB模块:通过颜色注意力单元自适应不同相机色彩特性,重建sRGB图像

-

真实噪声合成器

在RAW域注入物理噪声模型:- 包含光子散粒噪声(光照依赖)、读出噪声(电路精度相关)、固定模式噪声(传感器缺陷)

- 支持动态参数校准,适配不同ISO和量子效率的传感器

-

轻量双重注意力机制

去噪网络参数量仅2.6M(对比UPI的11.8M),通过:- 通道注意力:抑制噪声传播

- 空间注意力:增强纹理重建

2. 技术优势

| 指标 | DND数据集 | SIDD数据集 |

|---|---|---|

| RAW域PSNR | 40.44 dB | - |

| sRGB域PSNR | 36.16 dB | 39.52 dB |

| SSIM | 0.956 | 0.953 |

| 参数量 | 2.6M | 对比UPI ↓78% |

实验验证:如图1所示,相比N3NET和UPI,CycleISP能有效抑制低频色度噪声和坏像素噪声。

扩展应用

-

立体电影色彩匹配

通过CycleISP转换源视图与目标视图的色彩空间,在3D电影中实现跨视角色彩一致性,PSNR提升至36.60 dB。 -

跨传感器泛化

DRL-ISP方法结合强化学习优化ISP参数,在目标检测任务中将mAP@0.50从33.8%提升至36.5%。

技术局限与改进方向

-

实时性挑战

完整模型参数量达470万,需通过知识蒸馏压缩至1MB以内,移动端延迟仍需优化。 -

动态退化处理

当前对运动模糊修复有限,未来计划集成光流估计模块

二、相关工作(翻译与核心研究进展解析)

图像噪声的存在不可避免,无论是通过何种成像方式获取图像——在当今智能手机摄像头主导的时代(传感器尺寸小但分辨率高),这一问题尤为突出。单图像去噪是计算机视觉与图像处理领域广泛研究的课题,其早期研究可追溯至1960年代。经典去噪方法主要基于以下两大原则:

- 变换域系数修正:利用离散余弦变换(DCT)、小波变换等技术对频域系数进行调整。

- 邻域像素值平均:包括各向同性的高斯滤波、基于像素相似性的邻域平均(如双边滤波)及沿图像轮廓的滤波。

尽管上述方法在图像保真度与视觉质量上表现良好,但Buades等人提出的非局部均值(NLM)算法标志着去噪领域的重大突破。NLM通过挖掘自然图像中固有的冗余性与自相似性,显著提升了去噪效果。此后,基于图像块的方法(如BM3D)持续推动理论极限的探索。

近年来,深度学习技术逐渐成为主流。Burger等人首次通过大规模合成噪声数据训练简单的多层感知机(MLP),其性能超越传统复杂算法。随后,基于深度卷积神经网络(CNN)的方法(如DnCNN、FFDNet、CBDNet)在去噪任务中展现出显著优势。

RAW与sRGB空间的去噪挑战

尽管去噪算法可应用于RAW或sRGB数据,但真实噪声数据采集成本高且流程复杂,导致研究多依赖合成数据。传统方法常假设噪声为加性高斯白噪声(AWGN),然而真实相机噪声包含:

- 信号依赖性噪声:光子散粒噪声(泊松分布)

- 信号无关噪声:读取噪声(高斯分布)

相机成像管线(ISP)会将RAW传感器噪声转化为时空-色度相关且非高斯分布的复杂形式。因此,在sRGB空间中建模噪声需综合考虑ISP的影响。本文提出的框架通过合成真实噪声数据,支持CNN在RAW与sRGB空间中高效去噪。

技术要点与引用来源

- 经典方法:小波变换、双边滤波

- 非局部均值(NLM):利用自相似性提升去噪效果

- 深度学习突破:MLP与CNN模型(DnCNN、FFDNet)

- 真实噪声建模:泊松-高斯分布与ISP影响

- RAW域去噪:ELD模型与CBDNet的噪声参数校准

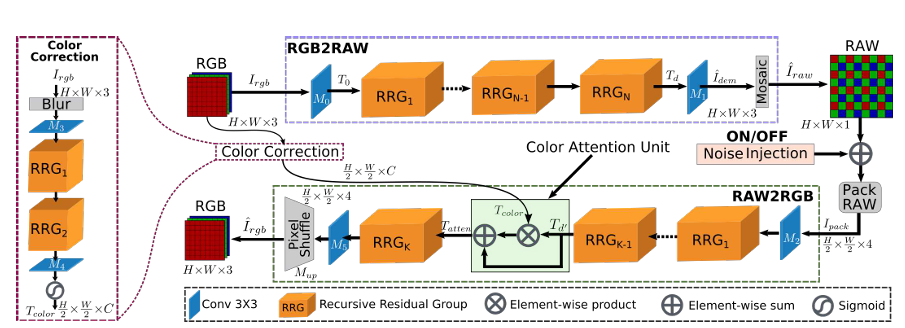

图2:CycleISP框架的双向ISP建模

CycleISP模型的双向相机成像管线建模包含两大核心分支:

- RGB2RAW分支:将sRGB图像逆向还原为RAW数据,模拟相机ISP的逆过程。

- RAW2RGB分支:将RAW数据正向转换为sRGB图像,结合辅助颜色校正分支实现色彩精确恢复。

技术亮点:

3. CycleISP框架

核心目标

构建双向ISP建模系统,实现sRGB与RAW域的无损转换,为真实噪声数据合成奠定基础。系统包含两大核心网络分支:

- RGB2RAW网络:逆向还原相机ISP流程,将sRGB图像逆推至RAW域

- RAW2RGB网络:正向模拟相机ISP流程,从RAW数据重建sRGB图像

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

642

642

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?