1.再提逻辑回归

之前已经讲过了逻辑回归,这里不再细讲,只是简单的说一个函数,主要是方便大家更好的理解概率校准。

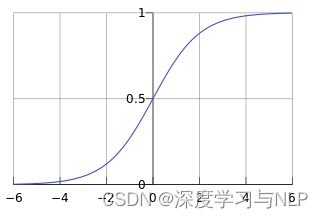

在逻辑回归中,用的最多的就是sigmod函数,这个函数的作用就是把无限大或者无限小的数据压缩到[0,1]之间,用来估计概率。图像大致为:

基本上是以0.5分界,0.5以上为1,0.5以下为0。但是这个分界值可以自己设定。

2.分类函数的原理

在进行分类时,基本上和逻辑回归的原理一样,计算出某个数据属于各分类的概率,然后取概率最大的那个作为最终的分类标签。

但是假设我们考虑这样的一种情况:在二分类中,属于类别0的概率为0.500001,属于类别1的概率为0.499999。假若按照0.5作为判别标准,那么毋庸置疑应该划分到类别0里面,但是这个真正的分类却应该是1。如果我们不再做其他处理,那么这个就属于错误分类,降低了算法的准确性。

如果在不改变整体算法的情况下,我们是否能够做一些补救呢?或者说验证下当前算法已经是最优的了呢?

这个时候就用到了概率校准。

3.Brier分数

在说概率校准前,先说下Brier分数,因为它是衡量概率校准的一个参数。

简单来说,Brier分数可以被认为是对一组概率预测的“校准”的量度,或者称为“ 成本函数 ”,这一组概率对应的情况必须互斥,并且概率之和必须为1.

Brier分数对于一组预测值越低,预测校准越好。

其求解公式如下:(此公式只适合二分类情况,还有原始定义公式)

其中

![]()

是预测的概率,

本文介绍了概率校准在机器学习中的重要性,特别是在逻辑回归和分类问题中。通过对Brier分数的讨论,解释了如何衡量概率预测的准确性,并以 sklearn.calibration.CalibratedClassifierCV 函数为例,阐述了概率校准的过程。最后,通过实例展示了概率校准如何影响分类结果和Brier分数,强调了校准在评估和改进模型性能中的作用。

本文介绍了概率校准在机器学习中的重要性,特别是在逻辑回归和分类问题中。通过对Brier分数的讨论,解释了如何衡量概率预测的准确性,并以 sklearn.calibration.CalibratedClassifierCV 函数为例,阐述了概率校准的过程。最后,通过实例展示了概率校准如何影响分类结果和Brier分数,强调了校准在评估和改进模型性能中的作用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

189

189

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?