研讨会介绍

本跨学科研讨会的目的是召集研究人员和从业人员讨论在知识管理和创新中应用的各种AI方法和技术的经验。它包括用于知识管理的AI的方法,技术和组织,以及使用AI的KM应用程序的反馈。要解决的主题包括:知识管理方法,模型,决策支持系统,管理顾问,虚拟培训等,这些将为多学科应用以及应用于全球安全和可持续性的知识管理提供启发。

相关论文

1.论文名称:Enriching Documents with Compact, Representative, Relevant Knowledge Graphs

论文链接:https://www.aminer.cn/pub/5eafe7e091e01198d39865a7?conf=ijcai2020

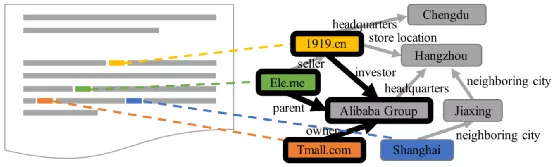

简介:知识图谱(KG)的一个重要应用是文档丰富化。现有方法识别背景KG中对实体的提及,并使用实体类型和直接关系来丰富文档。我们计算了一个实体关系子图(ERG),它可以更富表现力地表示一组提到的实体之间的间接关系。为了找到紧凑,代表性和相关的ERG,以进行有效富集,我们提出了一种高效的最佳优先搜索算法,以解决新的组合优化问题,从而实现代表性和紧凑性之间的折衷,然后利用本体知识通过以下方法对ERG进行排名 基于实体的文档KG和KG内部的相关性。大量的实验和用户研究表明,我们的方法很有前景。

2.论文名称:Reasoning Like Human: Hierarchical Reinforcement Learning for Knowledge Graph Reasoning

论文链接:https://www.aminer.cn/pub/5ef96b048806af6ef27720d1?conf=ijcai2020

简介:知识图通常遭受不完整的困扰。知识图完成的一种流行方法是通过对沿连接一对实体的其他路径上找到的信息进行多跳推理来推断缺失的知识。但是,多跳推理仍具有挑战性,因为推理过程通常会遇到关系或实体具有多种含义的多种语义问题。为了应对这种情况,我们提出了一种新颖的“层次强化学习”框架,以自动从“知识图”中学习推理链。我们的框架的灵感来自于人们处理认知上模棱两可的案件的层次结构。整个推理过程被分解为两层的强化学习策略层次结构,用于对历史信息进行编码并学习结构化的动作空间。结果,处理多重语义问题更加可行和自然。实验结果表明,我们提出的模型在模糊关系任务方面取得了实质性的改进

3.论文名称:BERT-INT:A BERT-based Interaction Model For Knowledge Graph Alignment

论文链接:https://www.aminer.cn/pub/5ef96b048806af6ef27720ed?conf=ijcai2020

简介:知识图对齐旨在将不同知识图之间的等效实体链接起来。为了同时利用图结构和辅助信息(例如名称,描述和属性),大多数工作通过图神经网络通过链接的实体传播辅助信息,尤其是名称。但是,由于不同知识图的异质性,聚集不同的邻居会影响对齐精度。这项工作提出了仅利用辅助信息的交互模型。我们不汇总邻居,而是计算邻居之间的交互,这些交互可以捕获邻居的细粒度匹配。同样,还对属性的交互进行了建模。实验结果表明,就数据集DBP15K上的HitRatio @ 1而言,我们的模型明显优于最佳方法(1.9-9.7%)。

4.论文名称:KGNN: Knowledge Graph Neural Network for Drug-Drug Interaction Prediction

论文链接:https://www.aminer.cn/pub/5ef96b048806af6ef2772133?conf=ijcai2020

简介:药物相互作用(DDI)预测是药理学和临床应用中一个具有挑战性的问题,在临床试验期间有效识别潜在的DDI对患者和社会至关重要。现有的大多数采用AI技术的计算模型通常都集中于集成多个数据源并将流行的嵌入方法结合在一起。然而,研究人员很少关注药物与其他实体(例如靶标和基因)之间的潜在关联。此外,最近的研究还采用知识图(KG)进行DDI预测。然而,这一系列方法直接学习节点潜在的嵌入,但是它们在获得KG中每个实体的丰富邻域信息方面受到限制。为了解决上述局限性,我们提出了一个端到端框架,称为知识图神经网络(KGNN),以解决DDI预测问题。我们的框架可以通过在KG中挖掘与毒品及其潜在邻域的关联关系来有效地捕获毒品。为了提取KG的高级结构和语义关系,我们从KG中每个实体的邻域中学习作为它们的本地接受者,然后将邻域信息与来自当前实体表示的偏差进行整合。这样,可以将接收域自然地扩展到多个跃点,以对高阶拓扑信息进行建模并获得潜在的药物长距离相关性。我们已经实现了我们的方法,并基于几个广泛使用的数据集进行了实验。实证结果表明,KGNN优于经典模型和最新模型

5.论文名称:Knowledge Graphs Enhanced Neural Machine Translation

论文链接:https://www.aminer.cn/pub/5ef96b048806af6ef27721e2?conf=ijcai2020

简介:知识图(KG)在各种实体上存储许多结构化的信息,神经机器翻译(NMT)的并行句子对未涵盖其中的许多实体。为了提高这些实体的翻译质量,本文提出了一种新的KGs增强NMT方法。具体来说,我们首先通过将源和目标KG转换为统一的语义空间,来诱导这些实体的新翻译结果。然后,我们生成包含这些归纳实体对的足够的伪并行句子对。最后,NMT模型由原始句和伪句对共同训练。关于汉英英和英日日语翻译任务的大量实验表明,我们的方法在翻译质量方面明显优于强大的基线模型,尤其是在处理归纳实体方面

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?