北京时间5月14日凌晨,OpenAI 最新发布了ChatGPT-4o,这无疑是人工智能领域的一次革命性飞跃。o代表Omnimodel(代表全能模型之意),ChatGPT-4o 旨在提供更加自然和高效的人机交互体验。本文将体验和探究 ChatGPT-4o 的新特性,并与其前身 ChatGPT-4 进行比较。

ChatGPT-4o 的新特性

1、多模态交互:

ChatGPT-4o 最显著的特点之一是其强大的多模态交互能力。它不仅能够处理文本,还能同时接受音频和图像输入,并生成相应的输出。这使得 ChatGPT-4o 在各种应用场景中表现出色,例如实时翻译、图像识别和语音助手等。

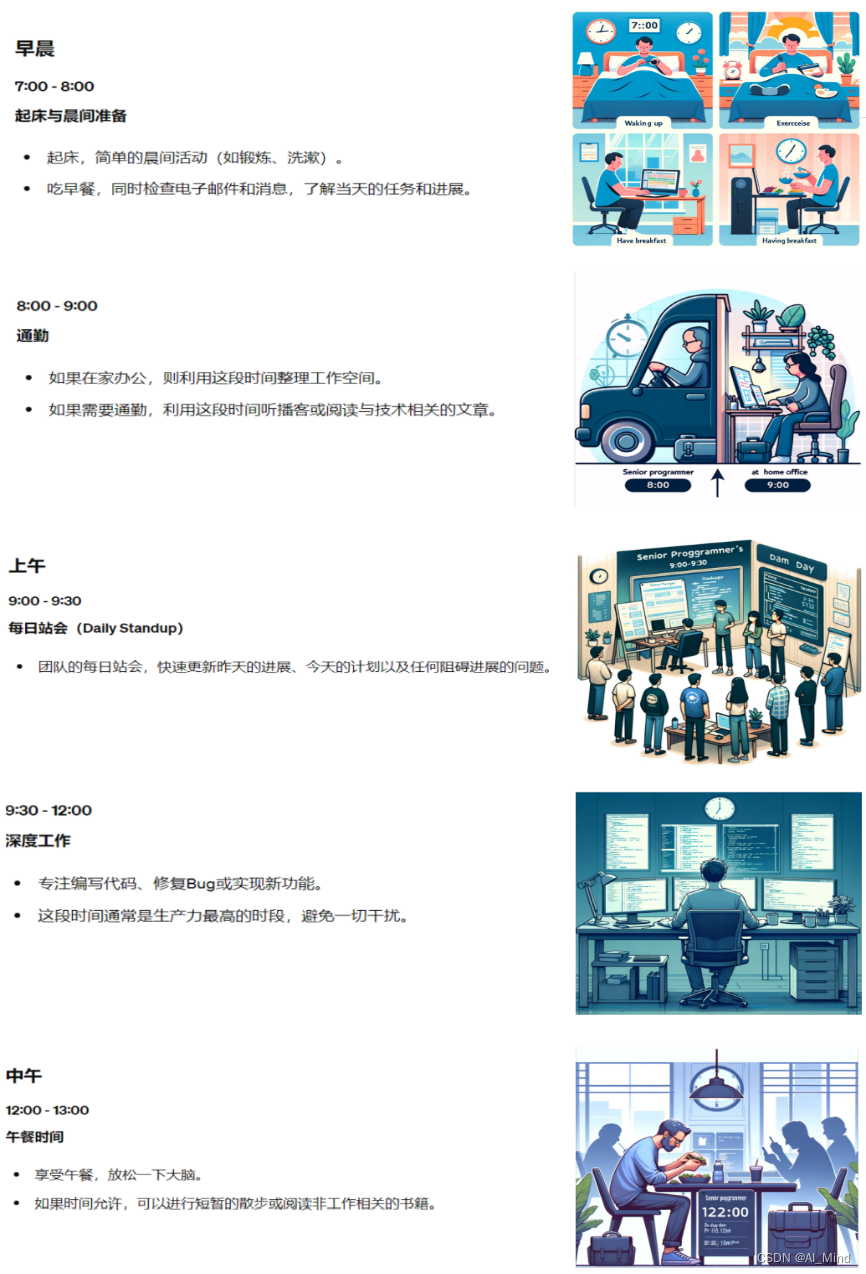

体验案例(视觉叙事--程序员的一天)展示如下:

2、情感理解:

ChatGPT-4o 的另一个创新点是其情感识别能力。在演示中,ChatGPT-4o 可以通过分析用户的表情和语气,判断其情绪。这一特性使得人机交互更加人性化和自然。

官方案例:

Zoph将手机举到自己面前正对着脸,要求ChatGPT告诉他自己长什么样子。最初,GPT参考了他之前分享的一张照片,将他识别为“木质表面”。经过第二次尝试,GPT给出了更好的答案。GPT注意到了Zoph脸上的微笑,对他说:“看起来你感觉非常快乐,喜笑颜开。”

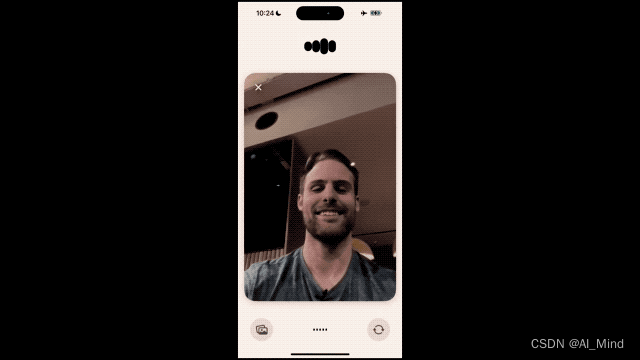

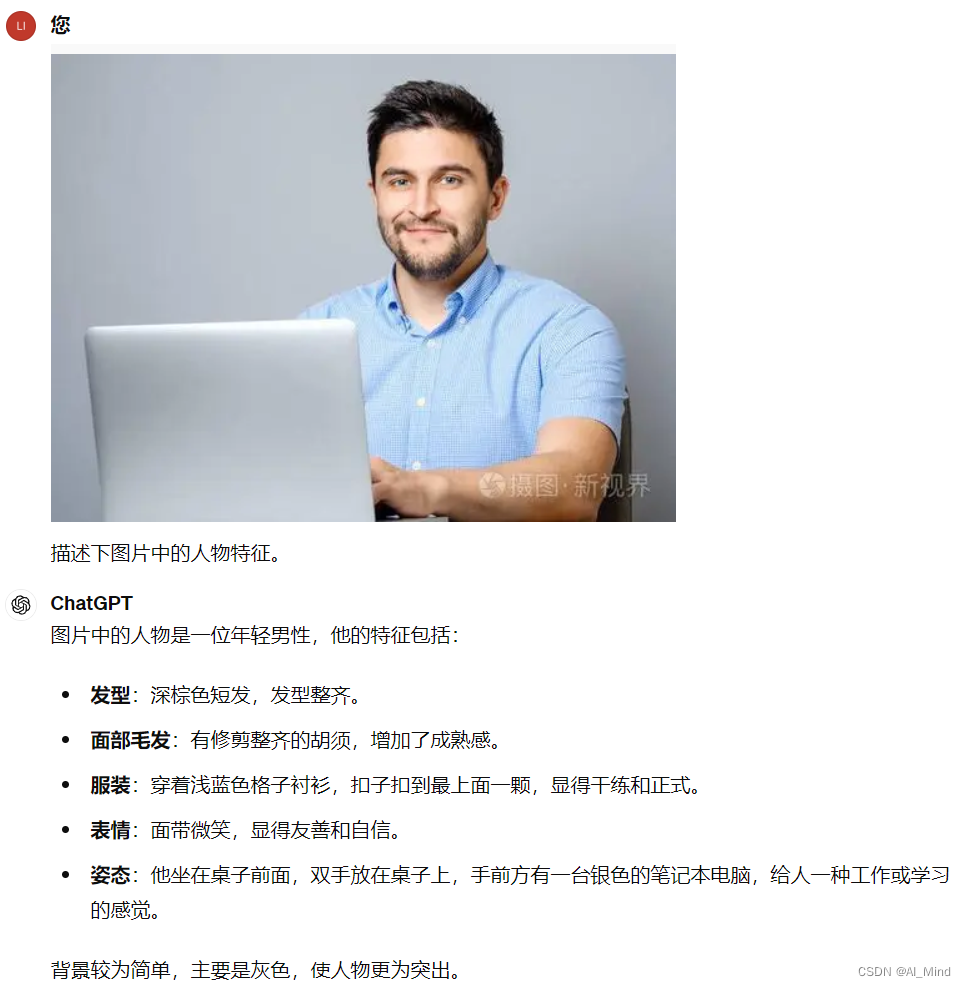

体验案例:

描述人物特征

描述人物心情

3、卓越的图像和音频理解:

ChatGPT-4o 在图像和音频理解方面表现出色。它能够理解复杂的图像内容,识别和生成音频,并能处理实时音频输入。这使得它在实时翻译、图像识别和语音助手等应用中表现优异。

体验案例:

多图像理解

照片到漫画

3D物体合成

4、实时响应:

与前代模型相比,ChatGPT-4o的响应速度显著提高。体验过 ChatGPT 语音对话能力的用户能够感知到 ChatGPT 的平均延迟为 2.8 秒 (GPT-3.5) 和 5.4 秒 (GPT-4)。但ChatGPT-4o的平均响应时间为 320 毫秒,最短响应时间为 232 毫秒,几乎与人类的反应时间相当。这意味着用户在与 ChatGPT-4o 互动时,几乎不需要等待,体验更加流畅。

5、增强的语言支持:

ChatGPT-4o 在多语言支持方面也有显著提升,特别是在非英语语言的处理上。目前能支持50种语言,改进后的分词器能够更好地压缩和处理多种语言,使得 ChatGPT-4o 成为一个真正的多语言智能助手。

6、收费方面:

每周都有超过一亿人使用 ChatGPT,OpenAI 表示 GPT-4o 的文本和图像功能免费在 ChatGPT 中推出,并向 Plus 用户提供高达 5 倍的消息上限。

OpenAI官方还声称:

- 向 Plus 用户提供高达 5 倍的消息限制。

- 开发人员现在还可以在 API 中访问 GPT-4o 作为文本和视觉模型。与 GPT-4 Turbo 相比,GPT-4o 速度提高 2 倍,价格降低一半,速率限制提高 5 倍。

(后续将带来对ChatGPT-4o的分析,以及与ChatGPT-4 的比较)

1306

1306

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?