国内端到端的技术路线已经明确:就是端到端+大模型!据自动驾驶之心了解,除了理想,像长安/小鹏都宣称大模型上车了。智能座舱和具身智能这块也是当下非常火爆的方向。未来大模型除了指导快系统外,像数据挖掘、标注等等应该都值得进一步探索。

拼团优惠立减130!

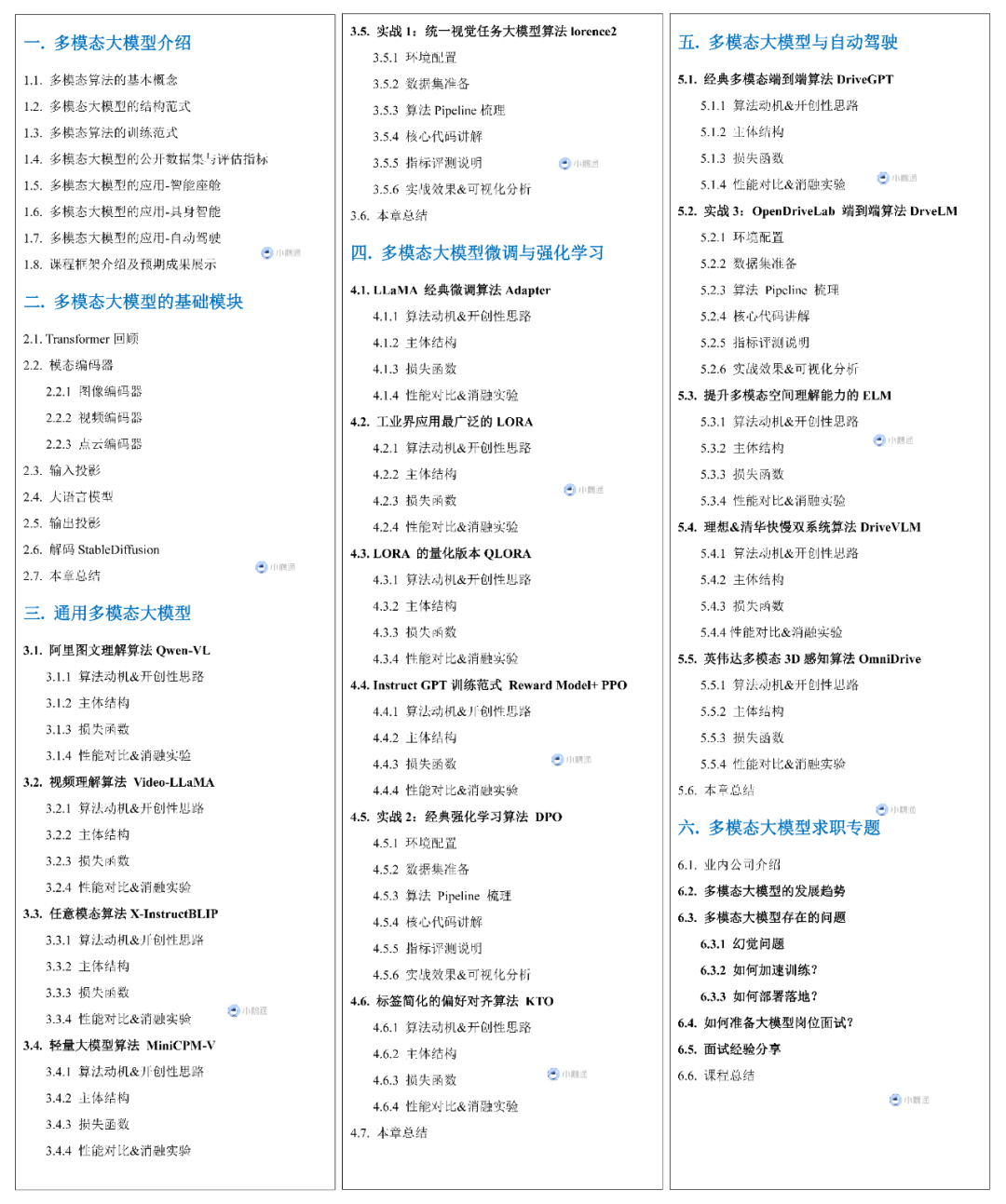

这里也推荐下平台最新的多模态大模型课程,课程从通用多模态大模型,到大模型微调,最终在聚焦在端到端自动驾驶多模态大模型,基本上面试的东西课程里面都有介绍。课程大纲如下:

课程内容一览

第一章:多模态大模型介绍

第一章主要介绍多模态大模型的基础概念,在整体上帮助同学们了解多模态大模型,打开大模型之路的大门。老师从多模态算法的概念出发,延伸到多模态大模型的结构&训练范式及公开数据集的介绍。在整体上对多模态大模型有一定了解后,我们会进一步聊聊实际的应用场景,让大家对未来可能从事的工作方向和工作内容有一定的了解,最后老师会介绍咱们课程的整体框架及预期的实战学习成果。

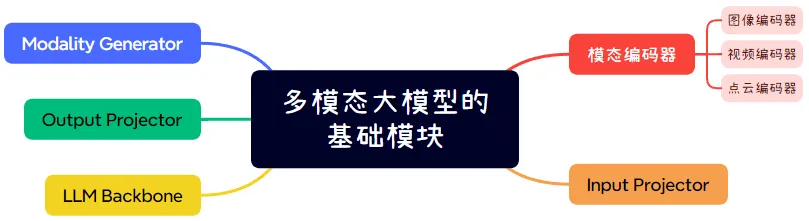

第二章:多模态大模型的基础模块

第二章正式进入多模态大模型的基础模块学习。老师会首先介绍多模态大模型的整体架构。模态编码器是什么?Input Projector有什么作用?LLM Backbone是什么?Output Projector又用来做什么?最后的Modality Generator又如何应用到具体的模态生成?在这一章都会得到解答!

第三章:通用多模态大模型

第三章聚焦于通用多模态大模型的讲解与实战。作为多模态大模型下游应用的基石,可以说没有通用多模态大模型的蓬勃发展,就不会有当下大模型应用百花齐放的局面。这一章节老师选取了五个算法展开详细介绍:涵盖了图文理解、视频理解、任意模态、轻量大模型以及实战-统一视觉任务大模型算法,即兼顾了学术界又兼顾了学术界。这一章老师将会带领同学们真正进入多模态大模型的世界。

实际效果:

第四章:多模态大模型微调与强化学习

第四章则聚焦于业内应用最广泛的微调与强化学习技术。如果把通用多模态大模型比作大树的枝干,那么微调技术则是大模型开枝散叶的核心技术。这一章老师首先会做一个训练策略的概述,微调到底微调个啥?接下来则会进入六篇论文的精讲和实战,涉及Adapter、LoRA、QLoRA、Reward Model+PPO、KTO和实战算法DPO,这一章仍会兼顾学术界和工业界,学完这一章,你将有能力训练面向特定业务需求的多模态大模型。

第五章:多模态大模型在自动驾驶中的应用

在讲解完通用大模型和微调技术后,第五章则聚焦于多模态大模型在自动驾驶中的应用,尤其是在端到端自动驾驶中的应用。老师选取了五个最有代表性的算法一一讲解,其中包含理想端到端自动驾驶量产方案参考的算法DriveVLM!在这一章,大家将会掌握最前沿的端到端自动驾驶大模型,为后面就业和升学增添助力!

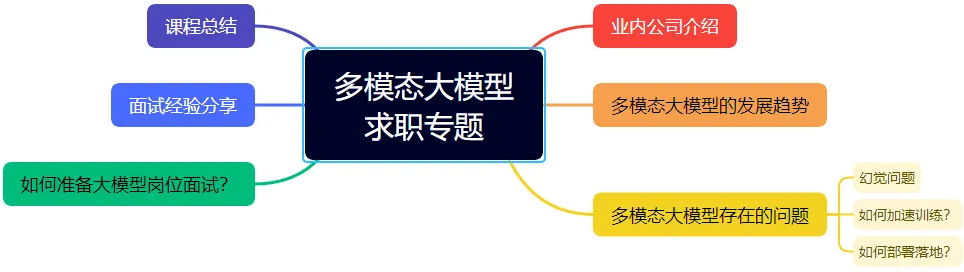

第六章:多模态大模型求职专题

第六章:多模态大模型求职专题

有了前面五个章节的技术积累,第六章咱们进入求职专题!这一章都是实打实老师工作多年的经验积累。业内有哪些公司?毕业应该从事什么方向?未来发展如何?多模态大模型当下应用的瓶颈在哪里?哪些问题是面试公司真正关心的?我们又该如何准备面试?在这一章你都讲得到答案!

适合人群

高校研究人员与学生;

初创企业技术团队;

企业技术专家、骨干;

想要转行从事大模型的同学;

讲师介绍

Sora老师,业内一线大厂高级算法工程师。研究方向多模态大语言模型、Agent等,从事座舱大模型落地和端到端大模型落地工作。在算法设计、模型部署、工程化落地上具有丰富经验,参与过国内、国外多个车厂与车型的poc及sop交付量产项目。

课程收获

掌握通用大模型的核心理论与微调技术;

掌握自动驾驶大模型在学术界&工业界的前沿算法;

具备大模型微调&部署的实际能力;

应用大模型解决实际问题的能力;

提升科研&工作核心竞争力。

课程所需基础

一定的深度学习与大模型基础;

了解Transformer模型结构

Python和PyTorch基础,具备代码读写的能力;

需要自备GPU,显存不低于12G;

课程咨询

拼团优惠立减130!

欢迎咨询小助理了解更多!

版权声明

自动驾驶之心所有课程最终版权均归自动驾驶之心团队及旗下公司所属,我们强烈谴责非法盗录行为,对违法行为将第一时间寄出律师函。也欢迎同学们监督举报,对热心监督举报的同学,我们将予以重报!

投诉微信:AIDriver004(备注:盗版举报)

726

726

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?