点击下方卡片,关注“3D视觉之心”公众号

第一时间获取3D视觉干货

更多干货,欢迎加入国内首个具身智能全栈学习社区:具身智能之心知识星球(戳我),这里包含所有你想要的。

当前VO的局限性

视觉里程计(VO)通过图像序列预测相机的相对位姿,通常作为同时定位与建图(SLAM)系统的前端模块。过去几十年间,几何方法和基于学习的方法均取得了显著进展,在泛化性和精度方面实现了重要突破。然而,在真实场景中,VO仍面临诸多挑战,特别是在低光照、动态物体和纹理缺失等视觉退化环境中。

为提高复杂场景下的鲁棒性,基于几何的VO算法采用了离群点过滤策略,并通过观测特征的协方差矩阵对优化残差进行加权。然而,如何有效选择可靠关键点并建立其协方差模型仍是两大核心挑战。现有方法通常基于局部强度梯度设置人工阈值进行关键点选择,这类方法未建模环境的结构或上下文信息(例如重复图案区域虽具有高图像梯度但并非理想候选特征),易导致误差和离群点。此外,协方差模型常被简化为恒定参数的经验模型,这种次优方案难以适应不同环境,且参数需针对不同场景进行大量调整。

随着学习型视觉特征的进步,更多算法利用学习特征优化相机位姿。这些特征点的置信度分数或权重通常以无监督方式获取,其学习得到的置信度虽有助于特征跟踪和优化可靠性建模,但存在尺度无关性问题——即无法反映三维空间中的真实估计误差。这种尺度无关性带来双重局限:

首先,导致室内外等不同尺度场景的协方差不一致

其次,难以融合多模态或多传感器的约束。

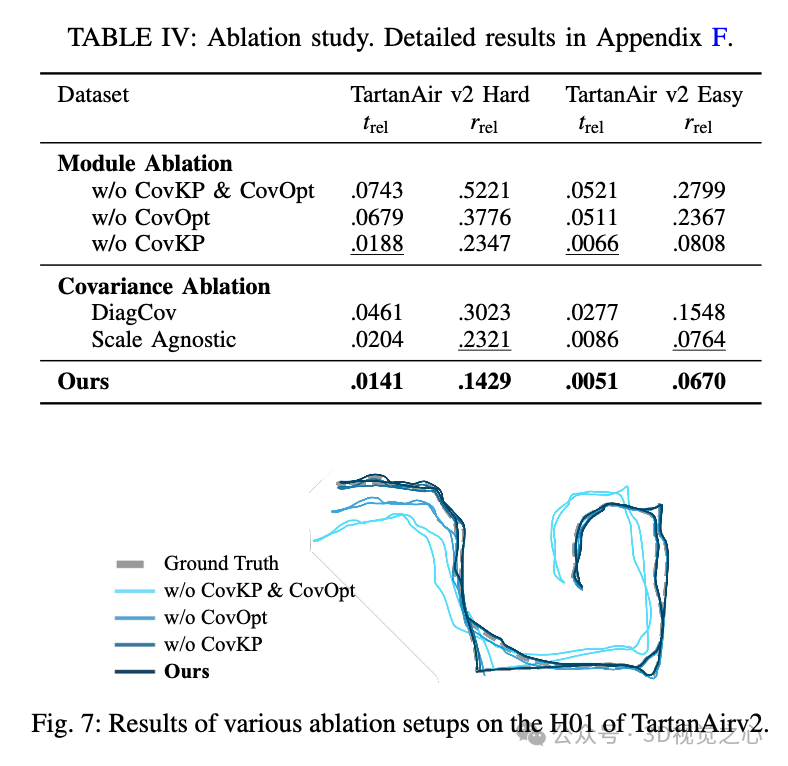

为解决上述挑战,本文提出为三维关键点建立度量感知协方差模型,通过两项创新实现:第一,我们设计学习型二维度量感知特征匹配不确定性模型,借鉴FlowFormer和GMA框架,采用迭代更新模块和运动聚合器预测图像空间的不确定性,有效过滤遮挡区域或低光照区域的不可靠特征;第二,基于学习得到的二维不确定性,通过度量感知三维协方差模型建立特征点的空间协方差。相较于DROID-SLAM采用的尺度无关对角协方差矩阵,我们的方法通过建模三维特征点协方差(包含轴间相关性)实现了更精确的表征,消融实验验证了该协方差模型的帧间一致性与帧内一致性。

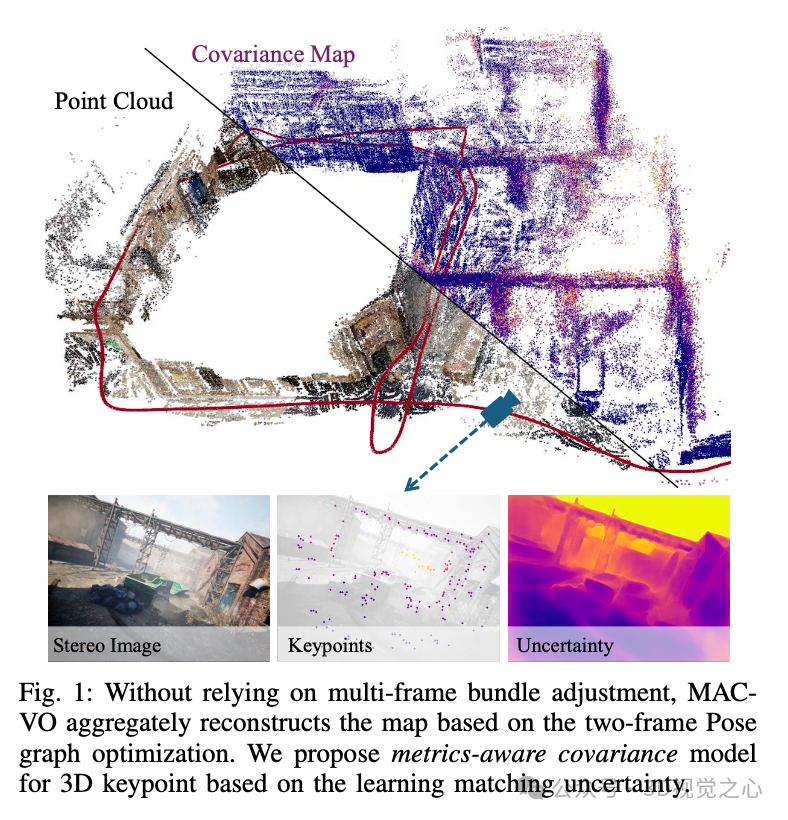

本文介绍的MAC-VO是一个具有卓越关键点选择和基于度量感知协方差模型的姿态图优化能力的立体视觉里程计系统。实验表明,与现有VO算法相比,MAC-VO在复杂场景下展现出更高的跟踪精度,甚至无需调参和多帧优化即可超越部分SLAM系统。

项目链接:https://mac-vo.github.io/

核心贡献可概括为:

度量感知的二维不确定性学习网络:利用迭代运动聚合器捕捉特征匹配的不一致性,通过度量感知不确定性评估特征质量,指导关键点选择与后端优化。

新型度量感知三维协方差模型:基于特征匹配和深度估计的二维不确定性构建,消融实验验证了尺度一致性与非对角项在姿态图优化中的必要性。

MAC-VO系统实现:提出完整立体视觉里程计框架,通过度量感知协方差实现相机位姿估计与三维特征配准,在复杂环境下的性能超越现有VO及部分SLAM算法。

该工作为视觉里程计在真实复杂场景中的应用提供了新思路,其建立的度量感知协方差模型也为多传感器融合等扩展应用奠定了基础。未来工作将探索该模型在集束调整、多帧优化和闭环检测中的潜力,以进一步提升系统性能。

具体方法

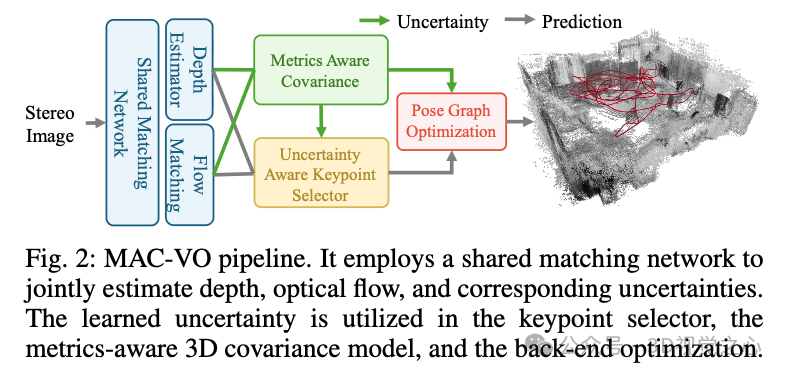

如图2所示,MAC-VO通过度量感知协方差模型实现了学习型前端与几何约束后端的有效集成。前端通过训练不确定性感知匹配网络建模特征缺陷导致的对应不确定性。利用学习得到的不确定性,我们在第III-B节开发了关键点选择器来筛选可靠特征。提出了度量感知协方差模型。在后端优化中,我们通过最小化由3D协方差加权的配准关键点距离来优化相对运动。

网络与不确定性训练

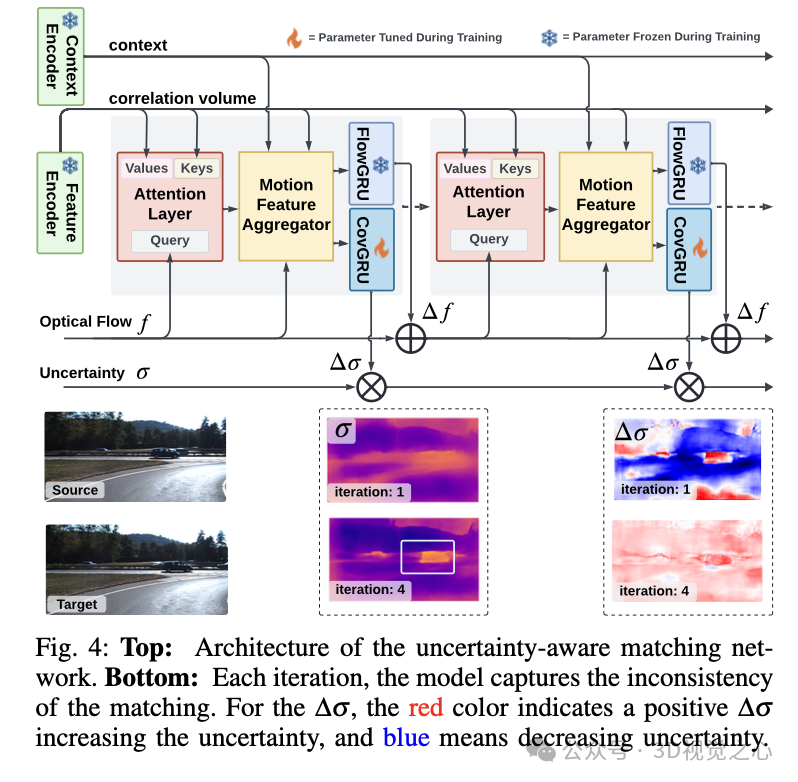

我们的网络以连续两帧图像作为输入,预测光流估计 及其对应不确定性 。采用FlowFormer的transformer架构作为光流估计主干网络,其循环解码器通过代价体匹配空间的特征对应模糊性,利用编码代价记忆的全局上下文迭代优化光流预测。

为扩展该框架并融合全局运动线索与局部特征,我们引入协方差解码器预测对数空间的不确定性迭代更新量 。在迭代更新过程中,对数方差通过指数激活函数转换为最终不确定性。

采用保形预测中的负对数似然损失函数进行不确定性监督:

其中y为真实光流, 表示第i次迭代的网络输出, 为指数衰减的迭代权重(衰减率0.8)。网络编码器参数使用FlowFormer预训练模型初始化,在合成数据集TartanAir上训练协方差模块,实验表明该模型可零样本迁移至真实数据集。

基于不确定性的关键点选择

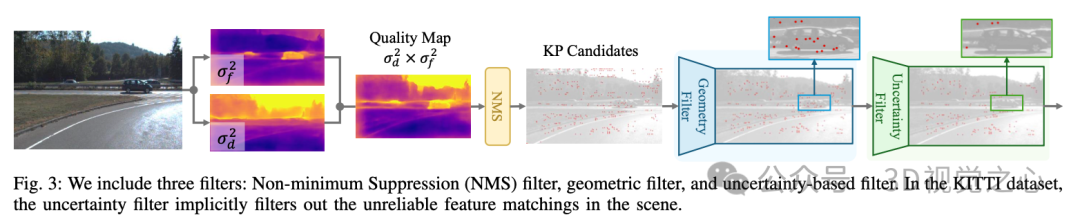

相较于DPVO的随机选择器和ORB-SLAM的手工特征选择器,我们通过三级级联过滤器筛选可靠特征: 非极大值抑制(NMS):防止关键点候选聚集,确保空间均匀分布

几何过滤器:剔除图像边界和无效深度观测区域的关键点

不确定性过滤器:滤除光流和深度不确定性高于当前帧中位数1.5倍的像素

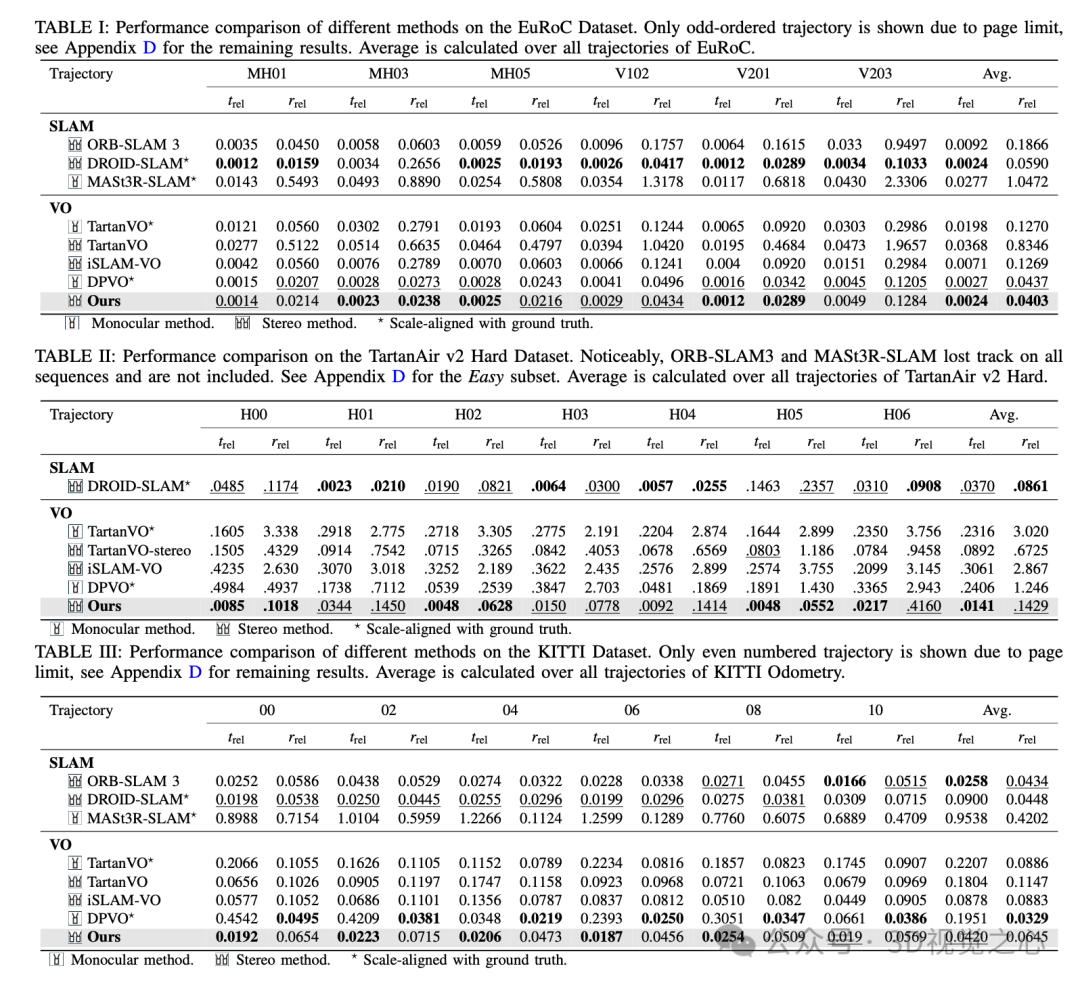

如图3所示,在KITTI轨迹中,不确定性过滤器可有效去除动态车辆上的关键点候选,同时过滤遮挡物体、反光表面和无纹理区域的关键点,生成更鲁棒的特征集。

如图3所示,在KITTI轨迹中,不确定性过滤器可有效去除动态车辆上的关键点候选,同时过滤遮挡物体、反光表面和无纹理区域的关键点,生成更鲁棒的特征集。

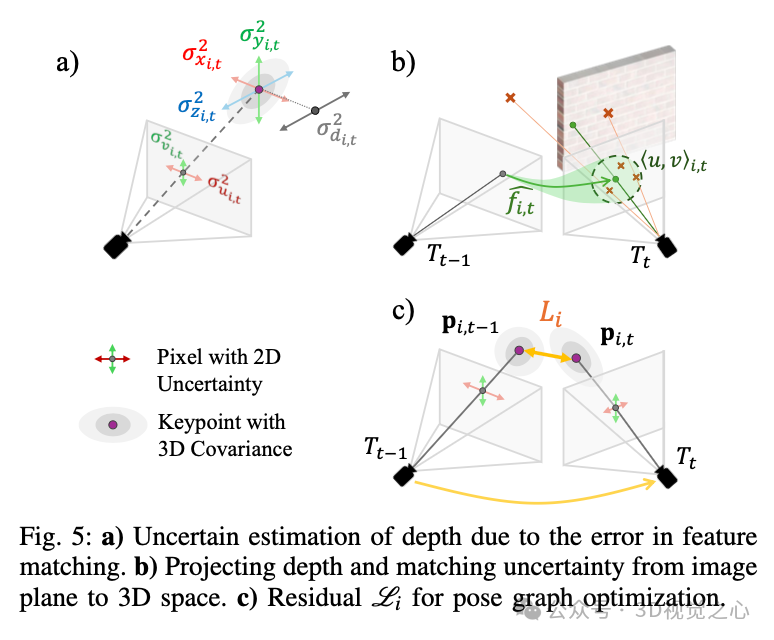

度量感知3D协方差模型

在针孔相机模型下,3D关键点的协方差由深度不确定性 和匹配不确定性( , )共同决定。建立精确的3D协方差模型需要解决两个核心问题: 匹配点的深度不确定性 估计

2D-3D投影过程中的非对角协方差项建模

2D不确定性到3D协方差的投影

设相机焦距为

,

,光心为(

,

),关键点坐标计算为:

协方差矩阵主对角线元素为:

考虑深度 的公共乘数效应,3D关键点在相机坐标系下的协方差矩阵需包含非对角项:

其中:

关键点匹配后的不确定性校正

如图5(b)所示,匹配特征点可能位于物体边缘等敏感区域,微小的特征匹配扰动会导致3D配准误差放大。为此,我们基于局部深度图块

(核尺寸32)的加权方差估计深度不确定性:

其中权重 为由 和 构建的2D高斯核。

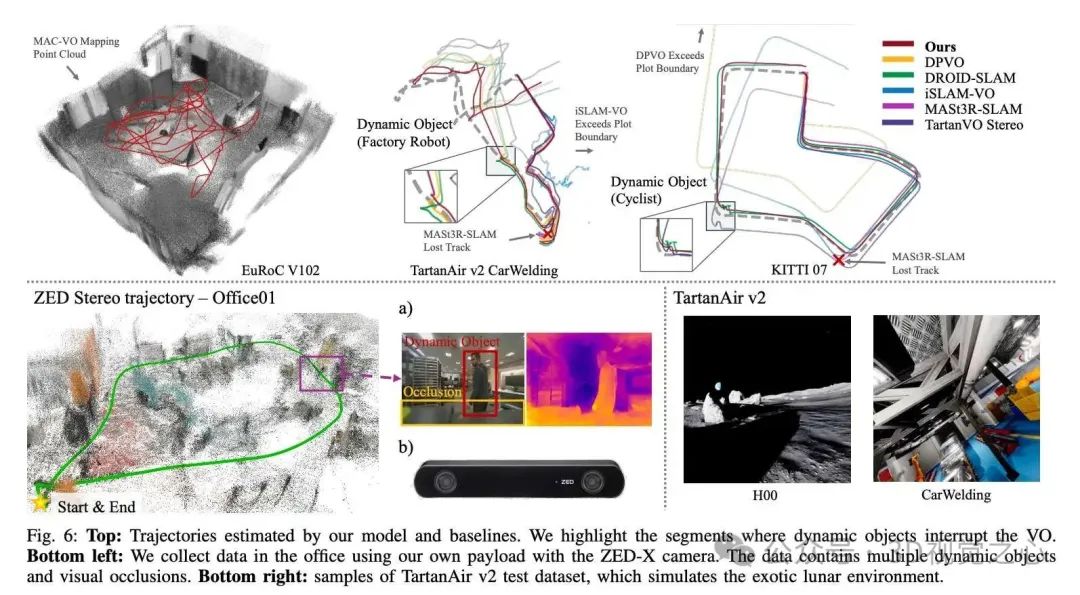

姿态图优化

通过最小化配准关键点间的马氏距离优化世界坐标系下的相机位姿 :

其中 表示以协方差矩阵 加权的马氏距离。相较于DROID-SLAM使用的对角协方差矩阵,我们建模了轴间相关性以更准确捕捉空间依赖关系。该优化问题通过PyPose库的Levenberg-Marquardt算法求解。

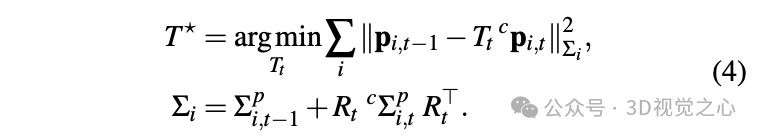

实验效果

总结一下

MAC-VO是一种基于学习的立体视觉里程计方法,在挑战性数据集上超越了大多数视觉里程计甚至部分SLAM算法。当前工作聚焦于两帧姿态优化,我们相信结合多帧优化(如集束调整)和闭环检测将进一步提升精度。此外,我们计划将度量感知协方差模型应用于多传感器(如IMU)融合领域。

参考

[1] MAC-VO: Metrics-aware Covariance for Learning-based Stereo Visual Odometry

【3D视觉之心】技术交流群

3D视觉之心是面向3D视觉感知方向相关的交流社区,由业内顶尖的3D视觉团队创办!聚焦三维重建、Nerf、点云处理、视觉SLAM、激光SLAM、多传感器标定、多传感器融合、深度估计、摄影几何、求职交流等方向。扫码添加小助理微信邀请入群,备注:学校/公司+方向+昵称(快速入群方式)

扫码添加小助理进群

【具身智能之心】知识星球

具身智能之心知识星球是国内首个具身智能开发者社区,也是最专业最大的交流平台,近1500人。主要关注具身智能相关的数据集、开源项目、具身仿真平台、VLA、VLN、Diffusion Policy、强化学习、具身智能感知定位、机器臂抓取、姿态估计、策略学习、轮式+机械臂、双足机器人、四足机器人、大模型部署、端到端、规划控制等方向。星球内部为大家汇总了近40+开源项目、近60+具身智能相关数据集、行业主流具身仿真平台、各类学习路线等,涉及当前具身所有主流方向。

扫码加入星球,享受以下专有服务:

1. 第一时间掌握具身智能相关的学术进展、工业落地应用;

2. 和行业大佬一起交流工作与求职相关的问题;

3. 优良的学习交流环境,能结识更多同行业的伙伴;

4. 具身智能相关工作岗位推荐,第一时间对接企业;

5. 行业机会挖掘,投资与项目对接;

263

263

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?